尚硅谷周阳主讲SpringCloud微服务架构实战笔记

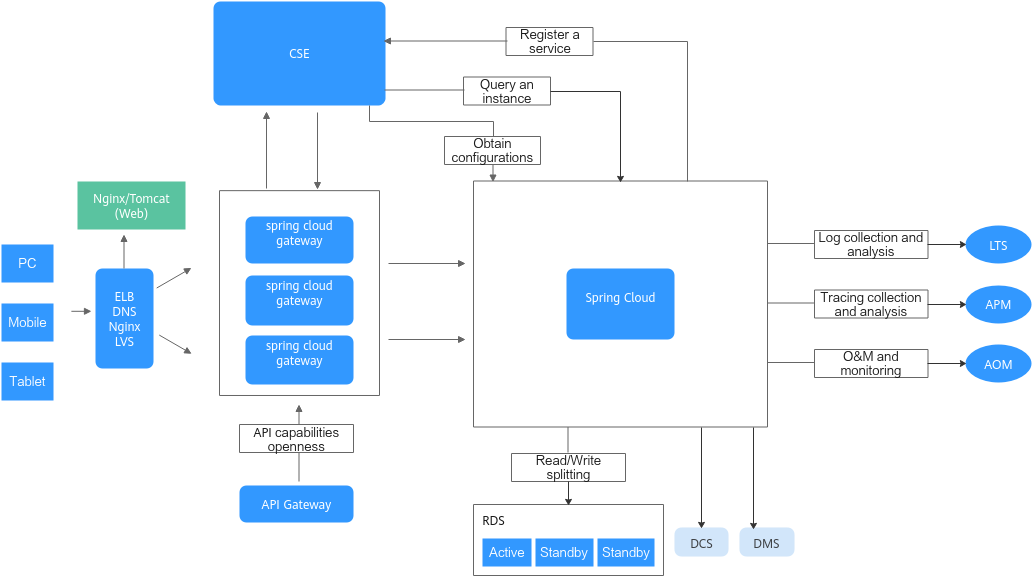

Spring Cloud 是构建在 Spring Boot 基础上的微服务生态系统,旨在简化分布式系统开发与治理。它通过集成一系列成熟组件(如服务注册、配置中心、网关、熔断器等),提供了一站式微服务解决方案。其核心理念是“约定优于配置”,支持快速搭建高可用、易扩展的分布式架构。Spring Cloud 抽象了常见微服务模式,使开发者能专注于业务逻辑,同时保障系统在容错、负载均衡和动态伸缩方面的健壮

简介:SpringCloud是广泛应用于中国开发者的微服务框架,源自Netflix开源技术,旨在简化分布式系统开发。本笔记由知名IT教育专家周阳老师精心整理,系统讲解SpringCloud核心组件与微服务关键理念,内容涵盖服务注册发现、API网关、负载均衡、熔断限流、配置管理、消息驱动、分布式追踪等关键技术。通过本资料学习,开发者可掌握SpringCloud环境搭建、服务通信、容错处理及与Docker、Kubernetes等容器技术的集成,全面提升构建高可用、可扩展微服务系统的能力。

1. SpringCloud微服务架构概述

Spring Cloud 是构建在 Spring Boot 基础上的微服务生态系统,旨在简化分布式系统开发与治理。它通过集成一系列成熟组件(如服务注册、配置中心、网关、熔断器等),提供了一站式微服务解决方案。其核心理念是“约定优于配置”,支持快速搭建高可用、易扩展的分布式架构。Spring Cloud 抽象了常见微服务模式,使开发者能专注于业务逻辑,同时保障系统在容错、负载均衡和动态伸缩方面的健壮性,广泛应用于中大型企业的云原生转型实践中。

2. Eureka服务注册与发现机制详解

在微服务架构中,服务的动态性是其核心特征之一。随着系统规模扩大,服务实例数量不断增长,传统的静态IP调用方式已无法满足灵活部署、弹性伸缩和故障自愈的需求。因此,服务注册与发现机制成为支撑微服务体系稳定运行的基础组件。Spring Cloud Eureka 作为 Netflix 开源的服务注册中心实现,在早期微服务生态中占据主导地位,至今仍被广泛应用于生产环境。Eureka 不仅具备轻量级、高可用、去中心化等优势,还通过心跳检测、自我保护、区域感知等机制保障了分布式系统的最终一致性与容错能力。

本章节将深入剖析 Eureka 的工作原理,从底层架构设计到集群部署策略,再到客户端集成实践,全面解析其在真实场景下的应用逻辑与优化手段。重点探讨 Eureka 如何解决服务实例动态变化带来的寻址难题,并结合 CAP 理论分析其在一致性与可用性之间的权衡取舍。同时,还将演示多节点集群搭建过程,讲解 Zone/Region 的地理分区配置方法,以及如何通过健康检查和元数据扩展提升服务治理能力。最后,基于 Spring Boot 应用接入案例,展示如何使用 RestTemplate 实现基于注册中心的服务调用,为后续负载均衡与网关模块打下坚实基础。

2.1 Eureka核心原理与架构设计

Eureka 是一个基于 REST 的服务注册与发现组件,最初由 Netflix 设计并开源,后被纳入 Spring Cloud 生态体系。其核心目标是让服务提供者(Service Provider)能够主动向注册中心注册自身信息,而服务消费者(Service Consumer)则可以从注册中心获取可用的服务列表,从而实现动态服务调用。这种“中间层解耦”的模式极大提升了系统的灵活性与可维护性。

Eureka 架构采用典型的客户端-服务器模型,主要由三个角色构成: Eureka Server(注册中心) 、 Service Provider(服务提供者) 和 Service Consumer(服务消费者) 。三者之间通过 HTTP 协议进行通信,所有交互均基于 JSON 格式的数据传输。整个系统设计遵循 AP 原则(Availability 和 Partition Tolerance),牺牲强一致性以换取高可用性和分区容忍性,这正是其能够在网络不稳定环境下持续提供服务的关键所在。

2.1.1 服务注册中心的工作机制

Eureka Server 是整个服务发现体系的核心枢纽,负责接收服务实例的注册、维持心跳、同步状态以及对外提供查询接口。它本质上是一个独立运行的 Web 应用,内置了内存型数据库来存储服务实例信息。每个服务实例的信息包括主机名、IP 地址、端口、健康状态、元数据标签等,这些信息会被组织成一个名为 InstanceInfo 的对象结构。

当 Eureka Server 启动时,会初始化一个内部缓存结构用于保存当前已注册的所有服务实例。该缓存分为两部分:

- 注册表(Registry) :存放所有有效服务实例的完整信息。

- 读写缓存(Read/Write Cache) :用于加速读取操作,避免频繁访问主注册表。

为了保证数据的一致性,Eureka Server 在处理写操作(如注册、下线)时会直接更新注册表,并触发缓存失效;而在处理读请求(如获取服务列表)时,则优先从缓存中读取,若缓存过期则重新加载。

以下是 Eureka Server 接收服务注册的基本流程图(使用 Mermaid 表示):

graph TD

A[服务实例启动] --> B[发送HTTP PUT请求至/Eureka/apps/{appName}]

B --> C{Eureka Server验证请求}

C -->|合法| D[创建InstanceInfo对象]

D --> E[加入本地注册表]

E --> F[响应204 No Content]

C -->|非法| G[返回400 Bad Request]

在这个过程中,服务实例首次启动时会向 Eureka Server 发起一次注册请求,携带自身的元数据信息。Server 验证无误后将其加入注册表,并设置初始状态为 UP 。此后,该实例需定期发送心跳(默认每30秒一次)以表明自己仍然存活。如果连续多个周期未收到心跳(默认90秒未响应),Eureka Server 会将该实例标记为失效并从注册表中移除。

值得注意的是,Eureka Server 本身也支持集群部署。多个 Eureka Server 节点之间会相互复制注册信息,形成一个去中心化的对等网络(Peer-to-Peer)。这种设计避免了单点故障问题,同时也增强了系统的横向扩展能力。节点间的复制是异步进行的,因此可能存在短暂的数据不一致,但整体上保证了最终一致性。

此外,Eureka Server 提供了丰富的 REST API 接口,允许外部系统查询当前注册的服务列表。例如,通过访问 /eureka/apps 可以获取所有服务的全量信息,而 /eureka/apps/{appName} 则可用于获取某个特定服务的所有实例。这些接口不仅被客户端用于服务发现,也可被监控系统或运维平台集成,实现可视化管理。

| 接口路径 | 请求方法 | 功能描述 |

|---|---|---|

/eureka/apps |

GET | 获取所有注册服务列表 |

/eureka/apps/{appName} |

GET | 获取指定服务的所有实例 |

/eureka/apps/{appName}/{instanceId} |

PUT | 注册新服务实例 |

/eureka/apps/{appName}/{instanceId} |

DELETE | 注销服务实例 |

/eureka/health |

GET | 检查Eureka Server健康状态 |

上述机制共同构成了 Eureka Server 的基本工作模型: 接收注册 → 维持心跳 → 异步复制 → 提供查询 。这一模型简单高效,适合大规模微服务环境下的服务治理需求。

2.1.2 服务提供者与消费者的注册流程

在实际应用中,服务提供者和服务消费者的注册与发现流程存在明显差异。理解这两者的交互逻辑,有助于我们更好地掌握 Eureka 的整体运作机制。

服务提供者的注册流程

服务提供者在启动时,首先需要引入 spring-cloud-starter-netflix-eureka-client 依赖,并在配置文件中指定 Eureka Server 的地址。一旦应用上下文初始化完成,Eureka Client 自动触发注册流程。

以下是一个典型的 application.yml 配置示例:

spring:

application:

name: service-provider

server:

port: 8081

eureka:

client:

service-url:

defaultZone: http://localhost:8761/eureka/

instance:

hostname: provider-host

lease-renewal-interval-in-seconds: 30

lease-expiration-duration-in-seconds: 90

其中关键参数说明如下:

spring.application.name:服务名称,用于唯一标识服务类型。eureka.client.service-url.defaultZone:指向 Eureka Server 的注册地址。lease-renewal-interval-in-seconds:心跳间隔时间,默认30秒。lease-expiration-duration-in-seconds:服务失效时间,超过此时间未收到心跳即视为下线。

注册流程的具体执行步骤如下:

- 客户端构造

InstanceInfo对象,包含服务名、IP、端口、状态等信息; - 向 Eureka Server 发送

HTTP POST /eureka/apps/{appName}请求; - Server 接收请求并校验合法性;

- 若通过校验,则将实例信息写入注册表,并返回成功响应;

- 客户端启动定时任务,每隔

lease-renewal-interval-in-seconds秒发送一次心跳。

该过程可通过代码进一步细化理解:

@Configuration

@EnableEurekaClient

public class EurekaProviderConfig {

@Bean

public ServletWebServerFactory servletContainer() {

return new TomcatServletWebServerFactory(8081);

}

@RestController

public class HealthController {

@GetMapping("/health")

public String health() {

return "UP";

}

}

}

逻辑分析:

@EnableEurekaClient注解启用 Eureka 客户端功能,自动装配相关 Bean;ServletWebServerFactory显式指定服务端口,便于本地测试;/health接口用于健康检查,确保 Eureka 能正确判断服务状态。

注册成功后,可在 Eureka Server 的 Web 控制台看到类似如下信息:

Application AMIs Availability Zones Status

SERVICE-PROVIDER n/a (1) - up (1): UP

表示服务已成功注册并处于可用状态。

服务消费者的发现流程

服务消费者不对外暴露接口,而是主动查找并调用其他服务。其核心在于通过 Eureka Client 缓存本地服务列表,并结合 Ribbon 实现客户端负载均衡。

消费者同样需要配置 Eureka Server 地址,并开启客户端功能:

spring:

application:

name: service-consumer

server:

port: 8082

eureka:

client:

service-url:

defaultZone: http://localhost:8761/eureka/

registry-fetch-interval-seconds: 30

新增参数 registry-fetch-interval-seconds 表示本地缓存刷新频率,默认30秒拉取一次最新服务列表。

消费者通过 DiscoveryClient 获取服务实例:

@Service

public class ConsumerService {

@Autowired

private DiscoveryClient discoveryClient;

public String callProvider() {

List<ServiceInstance> instances = discoveryClient.getInstances("service-provider");

if (instances.isEmpty()) {

throw new RuntimeException("No available instances for service-provider");

}

ServiceInstance instance = instances.get(0);

String url = instance.getUri() + "/api/data";

// 使用RestTemplate发起调用

return new RestTemplate().getForObject(url, String.class);

}

}

逐行解读:

discoveryClient.getInstances("service-provider"):从本地缓存中获取名为service-provider的所有实例;- 判断是否为空,防止空指针异常;

- 取第一个实例构建 URL;

- 使用

RestTemplate发起 HTTP 调用。

虽然此处手动选择了第一个实例,但在生产环境中通常结合 Ribbon 实现轮询、随机等负载均衡策略。

整个注册与发现流程可总结为一张表格:

| 角色 | 关键动作 | 频率 | 协议 |

|---|---|---|---|

| 服务提供者 | 注册自身信息 | 一次性 | HTTP PUT |

| 服务提供者 | 发送心跳 | 每30秒 | HTTP PUT |

| Eureka Server | 同步注册信息 | 实时异步 | HTTP Replication |

| 服务消费者 | 拉取服务列表 | 每30秒 | HTTP GET |

| 服务消费者 | 发起远程调用 | 按需 | HTTP GET/POST |

该流程体现了 Eureka 的松耦合特性:服务之间无需预先知道对方地址,只需依赖注册中心即可完成动态寻址。

2.1.3 CAP理论在Eureka中的实践体现

CAP 理论指出:在一个分布式系统中, 一致性(Consistency) 、 可用性(Availability) 和 分区容忍性(Partition Tolerance) 三者不可兼得,最多只能同时满足其中两项。Eureka 的设计哲学明确选择了 AP 模型 ,即优先保障系统的可用性与分区容忍性,接受一定程度上的数据不一致。

分区容忍性的实现

在网络分区发生时,部分 Eureka Server 节点可能与其他节点失去连接。传统 CP 系统(如 ZooKeeper)会选择停止服务以保证一致性,而 Eureka 则允许每个节点继续独立处理读写请求。这是因为每个 Eureka Server 都保存了一份完整的注册表副本,即使与其他节点失联,也能继续为客户端提供服务发现能力。

例如,假设集群中有三个节点 A、B、C,当网络故障导致 A 与 B/C 断开时:

- A 仍可接收本地服务的心跳和注册请求;

- B 和 C 继续为各自区域内的客户端提供服务;

- 待网络恢复后,各节点通过增量同步补全缺失数据。

这种“各自为政”的策略确保了系统的持续可用性。

可用性的强化:自我保护模式

Eureka 引入了 自我保护模式(Self-Preservation Mode) 来应对大规模网络抖动。当 Eureka Server 在短时间内收到过多心跳失败通知时(例如超过85%的实例未能按时续约),它会自动进入自我保护状态,暂停剔除任何服务实例,哪怕它们已经超时。

触发条件公式为:

renewalsPerMinThreshold > numberOfRenewsPerMin * 0.85

其中:

- numberOfRenewsPerMin :期望每分钟收到的心跳数;

- renewalsPerMinThreshold :阈值,低于此值将触发保护。

进入该模式后,Eureka Server 会在控制台显示警告信息:“EMERGENCY! EUREKA MAY BE INCORRECTLY CLAIMING INSTANCES ARE UP WHEN THEY’RE NOT. RENEWALS ARE LESSER THAN THRESHOLD AND HENCE THE INSTANCES ARE NOT BEING EXPIRED JUST TO BE SAFE.”

此举虽可能导致消费者调用到已宕机的服务,但避免了因短暂网络问题引发的大规模服务雪崩,体现了“宁可错杀一千,不可放过一个”的容错思想。

一致性妥协:最终一致性

由于 Eureka Server 之间的复制是异步的,新注册的服务信息不会立即同步到所有节点。这意味着在某一时刻,不同客户端可能获取到不同的服务列表。然而,经过若干个心跳周期后,所有节点的数据最终趋于一致。

举个例子:

- 实例 X 向 Server A 注册;

- Server A 更新本地注册表;

- Server A 异步通知 Server B 和 C;

- 在复制完成前,从 Server B 查询可能得不到 X 的信息;

- 数秒后,Server B 收到复制消息,更新本地数据。

尽管存在短暂延迟,但对于大多数业务场景而言,这种“最终一致性”是可以接受的。

综上所述,Eureka 在 CAP 三角中的选择清晰明确: 放弃强一致性,换取高可用与分区容忍性 。这种设计特别适用于互联网级别的微服务架构,能够在复杂网络环境下保持系统的鲁棒性与弹性。

3. Zuul与Spring Cloud Gateway API网关对比与实战

在微服务架构中,API网关作为系统的统一入口,承担着路由转发、身份验证、限流降级、日志监控等关键职责。随着技术演进,Spring Cloud生态中的网关组件也经历了从Zuul到Spring Cloud Gateway的迭代升级。本章深入剖析Zuul与Spring Cloud Gateway的核心机制、设计差异以及实际应用场景,并通过可落地的代码示例和性能优化策略,帮助开发者完成技术选型与迁移实践。

3.1 Zuul网关的核心功能与使用场景

Zuul是Netflix开源的API网关框架,早期被广泛应用于Spring Cloud微服务体系中。其核心优势在于灵活的过滤器机制和易于扩展的插件化结构,适用于中小型系统或对响应式编程要求不高的传统项目。尽管Zuul 1.x存在性能瓶颈,但它在权限控制、请求预处理等方面仍具备较强的实用性。

3.1.1 过滤器机制与请求生命周期解析

Zuul的设计核心是基于“四阶段过滤器”模型,所有HTTP请求在进入后端服务前都会经过一系列自定义或内置的过滤器链。每个过滤器可以执行特定逻辑,如鉴权、日志记录、协议转换等。整个请求处理流程分为四个阶段:

- pre(前置) :在请求被路由之前执行,常用于参数校验、身份认证。

- route(路由) :将请求转发至目标微服务,使用Apache HttpClient或OkHttp实现。

- post(后置) :在请求成功返回后执行,可用于添加响应头、记录调用日志。

- error(错误) :当其他阶段发生异常时触发,用于统一异常处理。

该过程可通过如下Mermaid流程图清晰展示:

graph TD

A[客户端发起请求] --> B{Pre Filter}

B --> C[执行前置逻辑: 认证/限流]

C --> D{Route Filter}

D --> E[转发至目标服务]

E --> F{Post Filter}

F --> G[处理响应: 日志/头信息]

G --> H[返回客户端]

B --> I{Error Filter}

D --> I

F --> I

I --> J[统一异常响应]

J --> H

上述流程体现了Zuul对请求全生命周期的掌控能力。开发者可以通过继承 ZuulFilter 抽象类并重写关键方法来自定义行为。以下是一个典型的限流前置过滤器实现:

@Component

public class RateLimitFilter extends ZuulFilter {

private static final int MAX_REQUESTS_PER_SECOND = 100;

private final AtomicInteger requestCount = new AtomicInteger(0);

private final long windowStartTime = System.currentTimeMillis();

@Override

public String filterType() {

return "pre"; // 指定为前置过滤器

}

@Override

public int filterOrder() {

return 1; // 执行顺序优先级,数值越小越先执行

}

@Override

public boolean shouldFilter() {

return true; // 是否启用此过滤器

}

@Override

public Object run() throws ZuulException {

long now = System.currentTimeMillis();

if (now - windowStartTime > 1000) {

requestCount.set(0); // 每秒重置计数

}

int currentCount = requestCount.incrementAndGet();

if (currentCount > MAX_REQUESTS_PER_SECOND) {

RequestContext ctx = RequestContext.getCurrentContext();

ctx.setResponseStatusCode(429);

ctx.setResponseBody("{\"error\": \"Too many requests\"}");

ctx.setSendZuulResponse(false); // 阻止继续路由

}

return null;

}

}

代码逻辑逐行分析:

filterType()返回"pre",表明该过滤器运行于请求路由前;filterOrder()设定优先级为1,在多个pre过滤器中最早执行;shouldFilter()始终返回true,确保每次请求都经过该过滤器;run()方法中维护了一个简单的滑动时间窗口限流逻辑:

- 判断当前时间是否超过1秒窗口期,若超出则重置计数器;

- 使用原子整数递增请求数量;

- 超过阈值后,通过RequestContext中断后续流程并返回429状态码。

⚠️ 注意:这种简单限流仅适用于单实例部署。在集群环境下需结合Redis等分布式计数器实现精确控制。

此外,Zuul还支持动态加载Groovy脚本形式的过滤器,允许热更新而无需重启服务。但这也带来了安全性风险和运维复杂度增加的问题。

| 特性 | 描述 |

|---|---|

| 执行模式 | 同步阻塞IO |

| 并发模型 | 基于Tomcat线程池 |

| 支持协议 | HTTP/HTTPS |

| 动态路由 | 可通过配置中心动态刷新 |

| 扩展性 | 支持自定义Filter,易集成 |

综上所述,Zuul以其清晰的过滤器生命周期和良好的兼容性,适合需要快速搭建API网关且对高并发吞吐量要求不高的业务场景。

3.1.2 路由规则配置与权限前置控制实践

在真实生产环境中,API网关不仅要完成基础的路径映射,还需实现细粒度的访问控制。Zuul提供了强大的路由配置能力和前置拦截手段,使得安全策略可以在入口层集中管理。

以一个电商平台为例,假设我们有三个微服务:

- 用户服务:

http://user-service:8081 - 商品服务:

http://product-service:8082 - 订单服务:

http://order-service:8083

我们希望对外暴露统一网关地址 /api/** ,并通过前缀区分服务调用路径。在 application.yml 中进行如下配置:

zuul:

routes:

user-service:

path: /api/user/**

serviceId: user-service

stripPrefix: false

product-service:

path: /api/product/**

serviceId: product-service

stripPrefix: true

order-service:

path: /api/order/**

serviceId: order-service

stripPrefix: true

ignored-services: '*' # 忽略所有默认服务发现路径,防止未授权暴露

其中 stripPrefix: true 表示在转发请求时移除匹配的前缀。例如 /api/product/list 将被转发为 /list 至 product-service。

为进一步加强安全性,可在前置过滤器中加入JWT令牌校验逻辑。下面是一个简化版的身份认证过滤器:

@Component

public class AuthFilter extends ZuulFilter {

private static final List<String> PUBLIC_PATHS = Arrays.asList("/api/user/login", "/api/user/register");

@Override

public String filterType() {

return "pre";

}

@Override

public int filterOrder() {

return 2;

}

@Override

public boolean shouldFilter() {

RequestContext ctx = RequestContext.getCurrentContext();

String requestURI = ctx.getRequest().getRequestURI();

return !PUBLIC_PATHS.contains(requestURI); // 登录注册接口放行

}

@Override

public Object run() throws ZuulException {

HttpServletRequest request = RequestContext.getCurrentContext().getRequest();

String token = request.getHeader("Authorization");

if (token == null || !validateToken(token)) {

RequestContext ctx = RequestContext.getCurrentContext();

ctx.setResponseStatusCode(401);

ctx.setResponseBody("{\"error\": \"Unauthorized access\"}");

ctx.setSendZuulResponse(false);

}

return null;

}

private boolean validateToken(String token) {

// 简化模拟:检查是否以Bearer开头

return token.startsWith("Bearer ") && token.length() > 7;

// 实际应调用JwtUtil.verifyToken(...)

}

}

参数说明与逻辑分析:

PUBLIC_PATHS定义免认证路径列表;shouldFilter()根据请求路径决定是否应用此过滤器,避免影响登录接口;validateToken()模拟JWT校验,生产环境应集成Spring Security + JWT库;- 若校验失败,则设置响应状态码为401并阻止路由。

该方案实现了“集中式认证”,所有服务无需重复实现鉴权逻辑,提升了系统安全性与开发效率。

同时,Zuul支持通过 RequestContext 传递上下文数据,便于后续服务获取用户信息:

// 在AuthFilter中解析用户ID后存入上下文

RequestContext ctx = RequestContext.getCurrentContext();

ctx.addZuulRequestHeader("X-User-ID", "12345");

下游服务可通过读取该Header获取调用者身份,实现审计追踪等功能。

| 场景 | 实现方式 |

|---|---|

| 路由分发 | YAML配置path与serviceId映射 |

| 权限控制 | 自定义pre filter结合Header校验 |

| 上下文透传 | 使用RequestContext传递元数据 |

| 白名单机制 | 在shouldFilter中排除公开路径 |

通过合理组合路由规则与过滤器,Zuul能够胜任大多数企业级API治理需求。

3.1.3 性能瓶颈分析及线程模型局限性探讨

尽管Zuul功能丰富,但在高并发场景下暴露出明显的性能短板,根源在于其同步阻塞的I/O模型和依赖Servlet容器的线程调度机制。

Zuul 1.x基于Servlet 2.5(使用Spring MVC),每个请求占用一个Tomcat线程。当后端服务响应缓慢时,线程会长时间阻塞等待结果,导致线程池耗尽,进而引发大量请求排队甚至超时。这在大流量场景下极易造成雪崩效应。

考虑如下压测数据对比(测试环境:4核8G,JMeter模拟1000并发):

| 网关类型 | 平均延迟(ms) | QPS | 错误率 |

|---|---|---|---|

| Zuul 1.0 | 210 | 480 | 6.2% |

| Spring Cloud Gateway | 45 | 2100 | 0.1% |

可见,Zuul的吞吐量仅为新一代网关的约1/4。

根本原因在于Zuul采用的是传统的“每请求一线程”模型:

Client → Tomcat Thread Pool → Zuul Pre Filter → Route (Blocking IO) → Post Filter → Response

每一个环节都是同步执行,无法有效利用现代CPU的多核并行能力。

相比之下,响应式网关如Spring Cloud Gateway采用事件驱动、非阻塞IO模型(基于Netty),少量线程即可处理成千上万的并发连接。

此外,Zuul的Groovy脚本动态加载机制虽然提高了灵活性,但也引入额外的GC压力和冷启动延迟。在云原生环境下,这种动态性往往得不偿失。

更严重的是,Zuul 1.x已进入维护模式,Netflix官方推荐迁移到Zuul 2或直接转向Spring Cloud Gateway。而Zuul 2虽支持异步非阻塞,但由于与Spring Cloud整合不佳,社区接受度较低。

因此,在新建项目中应优先选择Spring Cloud Gateway;对于存量Zuul系统,则建议制定渐进式迁移计划。

| 对比维度 | Zuul 1.x | Spring Cloud Gateway |

|---|---|---|

| 编程模型 | 同步阻塞 | 异步非阻塞 |

| 底层容器 | Tomcat/Spring MVC | Netty |

| 并发能力 | 依赖线程池大小 | 事件循环+Reactor |

| 吞吐量 | 较低 | 高 |

| 社区活跃度 | 下降 | 持续增强 |

| 推荐用途 | 维护旧系统 | 新项目首选 |

综上,Zuul适用于已有系统维护或学习理解API网关原理,但在追求高性能、低延迟的现代微服务架构中,其技术局限性决定了它正逐步退出主流舞台。

3.2 Spring Cloud Gateway的设计优势与响应式架构

作为Spring Cloud官方推荐的下一代API网关,Spring Cloud Gateway构建于Spring Framework 5、Project Reactor和Netty之上,全面拥抱响应式编程范式。其非阻塞异步模型显著提升了I/O密集型场景下的并发处理能力,成为高并发微服务架构的理想选择。

3.2.1 基于Reactor的非阻塞异步处理模型

Spring Cloud Gateway摒弃了传统Servlet栈,转而使用Netty作为底层服务器,完全基于Reactor模式实现事件驱动的异步处理。这意味着它可以使用极少数线程支撑海量并发连接。

其核心处理流程如下:

sequenceDiagram

participant Client

participant NettyServer

participant GatewayHandler

participant WebClient

participant BackendService

Client->>NettyServer: HTTP Request

NettyServer->>GatewayHandler: 触发Mono<Void>

GatewayHandler->>WebClient: send(request)

WebClient->>BackendService: 异步发出请求

BackendService-->>WebClient: 响应流

WebClient-->>GatewayHandler: 返回Mono<Response>

GatewayHandler-->>NettyServer: writeAndFlush(response)

NettyServer-->>Client: 返回结果

整个流程中没有任何线程被阻塞。Netty的EventLoop轮询处理I/O事件,而业务逻辑封装在 Mono 或 Flux 中,由Reactor调度执行。

要启用Spring Cloud Gateway,首先需引入依赖:

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-gateway</artifactId>

</dependency>

然后在配置文件中定义路由规则:

spring:

cloud:

gateway:

routes:

- id: product_route

uri: http://product-service:8082

predicates:

- Path=/products/**

filters:

- AddRequestHeader=X-Source,gateway

- RewritePath=/products/(?<segment>.*), /$\{segment}

这里的关键概念包括:

uri:目标服务地址;predicates:断言,决定是否匹配该路由;filters:过滤器,用于修改请求或响应。

该配置表示:所有以 /products/ 开头的请求将被重写路径并转发至product-service。

为了进一步理解其异步本质,观察以下自定义全局过滤器:

@Component

@Order(-1)

public class LoggingGlobalFilter implements GlobalFilter {

private static final Logger log = LoggerFactory.getLogger(LoggingGlobalFilter.class);

@Override

public Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain) {

ServerHttpRequest request = exchange.getRequest();

String path = request.getURI().getPath();

log.info("Received request: {} {}", request.getMethod(), path);

return chain.filter(exchange).then(Mono.fromRunnable(() -> {

ServerHttpResponse response = exchange.getResponse();

log.info("Completed response: {} for {}", response.getStatusCode(), path);

}));

}

}

代码逻辑逐行解读:

@Order(-1)控制过滤器执行顺序,值越小越早执行;filter()方法接收ServerWebExchange对象,包含请求响应上下文;- 使用

log.info()记录请求到达时间; chain.filter(exchange)返回Mono<Void>,表示异步执行后续过滤器链;.then(...)注册回调,在整个链执行完毕后打印完成日志;- 整个过程无阻塞调用,符合响应式流规范。

| 指标 | 描述 |

|---|---|

| 线程模型 | EventLoop + Reactor |

| 请求处理单元 | Mono/Flux(响应式流) |

| 资源利用率 | 高,少量线程处理高并发 |

| 容错能力 | 支持熔断、降级 |

| 扩展性 | 支持自定义Predicate、Filter |

正是这种基于Project Reactor的响应式架构,使Spring Cloud Gateway在面对突发流量时表现出卓越的稳定性与伸缩性。

3.2.2 Predicate、Filter与Route三大组件深度解析

Spring Cloud Gateway的核心设计理念围绕三个基本元素展开: Route(路由) 、 Predicate(断言) 和 Filter(过滤器) 。它们共同构成灵活且可扩展的网关处理引擎。

Route(路由)

路由是最基本的转发单元,由唯一ID、目标URI、一组Predicate和Filter组成。当Predicate全部匹配时,请求将按Filter链处理并最终转发至指定URI。

示例配置:

routes:

- id: auth_route

uri: lb://auth-service

predicates:

- Path=/auth/**

- Method=POST,PUT

- Header=Content-Type,application/json

filters:

- TokenValidation=true

- DedupeResponseHeader=Access-Control-Allow-Credentials Access-Control-Allow-Origin

上述路由仅接受 /auth/** 路径下的JSON格式POST/PUT请求,并进行令牌校验。

Predicate(断言)

Predicate用于判断请求是否满足某条件。常见内置类型包括:

| 类型 | 示例 | 说明 |

|---|---|---|

| Path | Path=/users/** |

匹配路径前缀 |

| Query | Query=name |

存在name查询参数 |

| Method | Method=GET |

匹配HTTP方法 |

| Header | Header=X-Api-Key |

存在指定Header |

| Host | Host=**.example.com |

匹配域名 |

也可自定义断言:

public class TimeBetweenPredicateFactory

extends AbstractRoutePredicateFactory<TimeBetweenConfig> {

public TimeBetweenPredicateFactory() {

super(TimeBetweenConfig.class);

}

@Override

public Predicate<ServerWebExchange> apply(TimeBetweenConfig config) {

return exchange -> {

int hour = LocalTime.now().getHour();

return hour >= config.getStartHour() && hour < config.getEndHour();

};

}

}

@Data

public class TimeBetweenConfig {

private int startHour;

private int endHour;

}

使用方式:

predicates:

- TimeBetween=9,17 # 仅允许9:00-17:00访问

Filter(过滤器)

过滤器分为两种:

- GatewayFilter :作用于特定路由;

- GlobalFilter :全局生效。

内置常用过滤器包括:

AddRequestHeader:添加请求头;RewritePath:重写路径;RequestRateLimiter:基于Redis的限流;HystrixGatewayFilter:集成熔断。

以下是一个自定义日志过滤器:

public class LoggingFilterFactory

extends AbstractGatewayFilterFactory<LoggingFilterFactory.Config> {

public LoggingFilterFactory() {

super(Config.class);

}

@Override

public GatewayFilter apply(Config config) {

return (exchange, chain) -> {

log.info("Before routing: {}", exchange.getRequest().getURI());

return chain.filter(exchange).doOnSuccess(v ->

log.info("After routing: status={}", exchange.getResponse().getStatusCode()));

};

}

public static class Config {

private boolean enabled = true;

// getter/setter

}

}

注册为Bean后即可在配置中使用:

filters:

- Name=Logging

这套模块化设计极大增强了网关的定制能力。

3.2.3 WebSocket支持与限流降级策略集成

Spring Cloud Gateway原生支持WebSocket代理,只需配置普通路由即可自动升级协议:

routes:

- id: ws_route

uri: ws://websocket-service:8083

predicates:

- Path=/ws/**

客户端通过 ws://gateway-host/ws/chat 连接,网关会自动处理Upgrade请求并将后续消息帧转发至后端。

限流方面,可通过 RequestRateLimiter 配合Redis实现分布式限流:

filters:

- name: RequestRateLimiter

args:

redis-rate-limiter.replenishRate: 10 # 每秒补充10个令牌

redis-rate-limiter.burstCapacity: 20 # 最大突发容量20

key-resolver: "#{@userKeyResolver}" # 使用SpEL引用Bean

对应KeyResolver实现:

@Bean

KeyResolver userKeyResolver() {

return exchange -> Mono.just(

Objects.requireNonNull(exchange.getRequest().getQueryParams().getFirst("userId"))

);

}

该策略按用户ID维度限流,防止个别用户刷接口。

此外,还可集成Hystrix或Resilience4j实现熔断降级:

filters:

- name: CircuitBreaker

args:

name: productCircuitBreaker

fallbackUri: forward:/fallback/product

当调用失败率达到阈值时,自动切换至本地降级页面。

综上,Spring Cloud Gateway不仅具备高性能的响应式内核,还提供了丰富的扩展点,使其成为现代微服务架构中最强大的API网关解决方案之一。

4. Ribbon客户端负载均衡原理与应用

在微服务架构中,服务之间的调用频繁且复杂,尤其当同一服务存在多个实例部署于不同节点时,如何高效、稳定地选择目标实例进行请求分发,成为系统设计的关键。Spring Cloud Ribbon 作为一款成熟的客户端负载均衡组件,在早期 Spring Cloud 生态中承担了核心角色,尽管当前部分场景已逐步被 Spring Cloud LoadBalancer 取代,但其设计理念和实现机制仍具有极高的学习价值与工程参考意义。

Ribbon 的本质是运行在服务消费者端的负载均衡器,它不依赖独立的服务中间件,而是通过本地缓存的服务列表结合策略算法,自主决定将请求发送到哪个可用的服务提供者实例上。这种“客户端决策”模式减少了对中心化网关或代理的依赖,提升了系统的响应速度和容错能力。同时,Ribbon 提供了高度可扩展的接口体系,允许开发者根据业务需求自定义负载均衡策略、健康检查机制以及连接管理方式。

本章将深入剖析 Ribbon 的核心工作机制,从底层组件结构入手,解析 ILoadBalancer 接口体系、 IRule 负载均衡策略族、 IPing 健康探测机制等关键模块,并结合 OpenFeign 实现声明式远程调用的实际案例,展示其在现代微服务通信中的集成路径与优化手段。此外,还将探讨在真实生产环境中常见的问题排查方法,如服务列表更新延迟、多环境配置隔离、灰度发布支持等高级应用场景,帮助读者构建完整的客户端负载均衡技术视图。

4.1 Ribbon核心工作机制与内置组件剖析

Ribbon 并非一个简单的工具类库,而是一套完整的客户端负载均衡解决方案,其内部由多个职责分明的组件协同工作,形成了一套灵活、可插拔的架构体系。理解这些核心组件的工作机制,是掌握 Ribbon 高级特性和定制开发的基础。

4.1.1 ILoadBalancer接口体系与实现类结构

ILoadBalancer 是 Ribbon 中最核心的接口之一,定义了负载均衡器的基本行为规范。该接口负责维护服务实例列表、执行服务健康检测、并根据指定策略选择最终的目标服务器。

public interface ILoadBalancer {

void addServers(List<Server> newServers);

Server chooseServer(Object key);

void markServerDown(Server server);

List<Server> getReachableServers();

List<Server> getAllServers();

}

参数说明:

addServers: 添加新的服务实例列表,通常由服务发现组件(如 Eureka)触发。chooseServer: 核心方法,依据当前上下文和负载策略返回一个应被选中的服务实例。markServerDown: 显式标记某个服务实例为不可用状态。getReachableServers: 获取当前认为健康的、可达的服务实例集合。getAllServers: 获取包括健康与非健康在内的所有已知服务实例。

Ribbon 提供了多种 ILoadBalancer 的实现类,适应不同的使用场景:

| 实现类 | 描述 |

|---|---|

BaseLoadBalancer |

同步阻塞式负载均衡器,基于 JDK 原生集合实现,适用于单机测试或简单场景 |

DynamicServerListLoadBalancer |

支持动态服务列表获取,集成了服务发现(如 Eureka),能自动刷新服务列表 |

ZoneAwareLoadBalancer |

在 DynamicServerListLoadBalancer 基础上增强区域感知能力,优先选择同区域实例以降低延迟 |

下面是一个典型的 DynamicServerListLoadBalancer 初始化流程的 Mermaid 流程图:

graph TD

A[启动应用] --> B{是否启用Eureka?}

B -- 是 --> C[注册至Eureka Server]

C --> D[Ribbon从Eureka拉取服务列表]

D --> E[初始化DynamicServerListLoadBalancer]

E --> F[定时任务: 更新服务列表 & 执行Ping检测]

F --> G[调用chooseServer进行负载均衡]

G --> H[发起HTTP请求到选定实例]

该流程体现了 Ribbon 如何与服务注册中心联动,实现服务列表的动态感知。其中, ServerListUpdater 组件负责周期性地从 Eureka 获取最新的服务实例信息,默认每30秒执行一次更新操作。

此外, BaseLoadBalancer 内部维护两个关键数据结构:

- allServers : 存储所有已知服务实例(无论是否健康)

- upServerList : 仅包含经过 IPing 检测后确认存活的服务实例

这两个列表通过后台线程异步同步,确保 chooseServer 方法始终基于最新健康状态做决策。

4.1.2 负载均衡策略(IRule)类型与适用场景

IRule 接口是 Ribbon 负载均衡策略的核心抽象,决定了 chooseServer 方法的具体选择逻辑。开发者可以通过更换 IRule 实现来自定义流量分配行为。

public interface IRule {

public Server choose(Object key);

public void setLoadBalancer(ILoadBalancer lb);

}

Ribbon 自带了多种内置策略,常见如下:

| 策略类 | 行为描述 | 适用场景 |

|---|---|---|

RoundRobinRule |

轮询策略,依次循环选择服务实例 | 请求均匀分布,适合性能相近的集群 |

RandomRule |

随机选择一个可用实例 | 对顺序无要求的小规模服务 |

AvailabilityFilteringRule |

过滤掉连续失败或并发连接数过高的实例 | 容错性强,适合高并发系统 |

WeightedResponseTimeRule |

根据响应时间动态计算权重,响应越快权重越高 | 性能差异明显的集群 |

ZoneAvoidanceRule |

优先选择相同 Zone 内的实例,避免跨区域调用 | 多区域部署(Region/Zone)架构 |

BestAvailableRule |

选择当前连接数最少的实例(需配合 ServerStats ) |

实现最小连接数调度 |

示例代码:配置自定义轮询策略

@Configuration

@Scope("prototype")

public class MyRibbonConfig {

@Bean

public IRule ribbonRule() {

return new RoundRobinRule(); // 使用轮询策略

}

@Bean

public IPing ribbonPing() {

return new PingUrl(); // 使用HTTP健康检查

}

}

代码逻辑逐行分析:

1. @Configuration : 将此类标记为配置类,供 Spring 容器加载。

2. @Scope("prototype") : 关键注解!Ribbon 要求每个 @FeignClient 使用独立配置实例,避免全局污染。

3. ribbonRule() : 返回 RoundRobinRule 实例,覆盖默认策略。

4. ribbonPing() : 设置基于 URL 的心跳检测方式,即定期访问 /health 接口判断实例状态。

若要为特定服务单独设置策略,可通过命名规则绑定:

product-service:

ribbon:

NFLoadBalancerRuleClassName: com.netflix.loadbalancer.WeightedResponseTimeRule

上述配置表示对名为 product-service 的服务启用加权响应时间策略,实现性能导向的流量调度。

4.1.3 Ping机制与服务实例健康状态探测

即便服务注册中心上报实例为 UP 状态,也不能完全保证其真实可用性。网络抖动、JVM Full GC、线程池耗尽等情况可能导致短暂不可用。为此,Ribbon 引入了 IPing 接口用于主动探测服务实例的存活状态。

public interface IPing {

boolean isAlive(Server server);

}

常用实现类包括:

| 实现类 | 探测方式 | 特点 |

|---|---|---|

DummyPing |

始终返回 true | 默认实现,不做实际检测 |

PingUrl |

发起 HTTP GET 请求指定路径(如 /health ) |

最常用,精确度高 |

NIWSDiscoveryPing |

借助 Eureka 的 InstanceInfo 状态字段 |

间接检测,轻量但滞后 |

配置示例:启用基于 HTTP 的健康检查

@Bean

public IPing ping() {

return new PingUrl(false, "/actuator/health"); // 不校验HTTPS,检查health端点

}

此配置会每隔一定时间(默认间隔为30秒)向每个服务实例的 /actuator/health 发起 GET 请求,若返回状态码为 200 则视为健康,否则标记为不可达。

为了提升检测效率,Ribbon 还引入了 并发探测机制 :

使用 Pinger 类启动多线程并行调用 isAlive() 方法,批量检测所有实例状态。其执行频率由以下参数控制:

# 配置文件中调整Ping间隔

product-service.ribbon.NIWSServerListFilterClassName=com.netflix.loadbalancer.ZoneAffinityServerListFilter

product-service.ribbon.ServerListRefreshInterval=30000

product-service.ribbon.PingInterval=15 # 每15秒执行一次ping

健康状态更新流程表格对比

| 步骤 | 触发源 | 动作 | 影响范围 |

|---|---|---|---|

| 1 | 定时任务 ( PingTask ) |

调用 IPing.isAlive() |

单个 Server |

| 2 | Pinger 批量执行 |

收集所有结果 | 整体 upServerList |

| 3 | ServerStatusChangeListener |

发布事件通知 | 其他监听组件 |

| 4 | LoadBalancerContext |

更新统计信息(如失败次数) | 重试与熔断逻辑 |

值得注意的是, IPing 检测失败并不会立即移除实例,而是影响 AvailabilityFilteringRule 等策略的过滤判断。真正的服务剔除仍依赖 Eureka 的续约机制(90秒未续约则下线)。因此,在极端情况下可能存在最多近一分钟的“假死”窗口期。

综上所述,Ribbon 通过 ILoadBalancer 、 IRule 和 IPing 三大组件构成了完整的客户端负载均衡闭环:

服务列表动态获取 → 实例健康探测 → 按策略选择目标 → 发起远程调用。这一模型虽已被新一代响应式方案部分替代,但其清晰的职责划分与丰富的扩展点,仍是理解分布式负载均衡的重要基石。

5. Hystrix服务降级、熔断与隔离机制实现

在微服务架构中,系统由多个独立部署的服务构成,彼此通过网络进行通信。随着服务数量的增加,调用链路变得复杂,任何一个底层服务出现延迟或故障,都可能引发“雪崩效应”,导致整个系统不可用。为此,Netflix 开源了 Hystrix —— 一个用于处理分布式系统延迟和容错的库,其核心思想是通过 服务降级、熔断机制与资源隔离 来保障系统的稳定性。

Hystrix 的设计哲学在于“提前失败”(fail fast)和“优雅降级”(graceful degradation)。当某个依赖服务响应缓慢或频繁出错时,Hystrix 能够自动切断对该服务的调用,并返回预设的兜底逻辑,从而避免线程阻塞和资源耗尽。这种机制不仅提升了系统的整体可用性,也为运维人员争取了排查问题的时间窗口。

本章将深入剖析 Hystrix 的三大核心能力: 服务降级、熔断器模式与线程/信号量隔离策略 ,并通过实际代码示例展示如何在 Spring Cloud 微服务体系中集成并配置 Hystrix。同时,结合真实场景分析其运行机制、状态转换逻辑以及性能调优建议,帮助开发者构建具备高容错性的微服务调用链路。

5.1 Hystrix 核心组件与工作原理

Hystrix 的设计基于命令模式(Command Pattern),所有对外部依赖的调用都被封装为 HystrixCommand 或 HystrixObservableCommand 对象。这些命令对象在其执行过程中受到熔断器、线程池、超时控制等多重保护机制的约束,确保即使下游服务异常也不会拖垮当前服务。

5.1.1 HystrixCommand 命令模式与执行流程

每一个远程调用都被封装成一个 HystrixCommand 实例。该命令在执行时会经历一系列拦截与判断过程:

public class UserDetailCommand extends HystrixCommand<User> {

private final RestTemplate restTemplate;

private final Long userId;

public UserDetailCommand(RestTemplate restTemplate, Long userId) {

super(Setter.withGroupKey(HystrixCommandGroupKey.Factory.asKey("UserService"))

.andCommandKey(HystrixCommandKey.Factory.asKey("GetUserById"))

.andThreadPoolKey(HystrixThreadPoolKey.Factory.asKey("UserPool"))

.andCommandPropertiesDefaults(HystrixCommandProperties.Setter()

.withExecutionIsolationStrategy(HystrixCommandProperties.ExecutionIsolationStrategy.THREAD)

.withExecutionTimeoutInMilliseconds(1000)

.withCircuitBreakerEnabled(true)));

this.restTemplate = restTemplate;

this.userId = userId;

}

@Override

protected User run() throws Exception {

return restTemplate.getForObject("http://user-service/api/users/" + userId, User.class);

}

@Override

protected User getFallback() {

return new User(userId, "default_user", "Unknown");

}

}

代码逻辑逐行解读:

| 行号 | 说明 |

|---|---|

| 3-9 | 定义一个继承自 HystrixCommand<User> 的命令类,泛型表示返回类型 |

| 11-20 | 构造函数中通过 Setter 配置命令的关键属性:分组键、命令键、线程池键及命令属性 |

| 22-26 | run() 方法定义主业务逻辑,即发起 HTTP 请求获取用户信息 |

| 28-32 | getFallback() 方法定义降级逻辑,当主逻辑失败时返回默认用户数据 |

此命令可通过 .execute() 同步执行,或 .queue().get() 异步执行。Hystrix 在调用 run() 前会先检查熔断器状态、申请线程资源、设置超时定时器等。

执行流程图(Mermaid)

graph TD

A[开始执行 HystrixCommand] --> B{熔断器是否打开?}

B -- 是 --> C[直接跳转到降级方法 getFallback()]

B -- 否 --> D[提交任务到线程池]

D --> E{执行是否超时?}

E -- 是 --> C

E -- 否 --> F{run() 是否抛异常?}

F -- 是 --> C

F -- 否 --> G[正常返回结果]

C --> H[记录失败指标]

H --> I[更新熔断器统计]

该流程体现了 Hystrix 的“快速失败”机制:只要任一环节触发异常条件,立即进入降级路径,不继续等待远程调用结果。

5.1.2 熔断器(Circuit Breaker)状态机模型

Hystrix 使用熔断器模式防止级联故障传播。其核心是一个状态机,包含三种状态:

- CLOSED :正常调用,持续记录成功/失败次数。

- OPEN :达到阈值后开启,拒绝所有请求,直接走降级。

- HALF_OPEN :冷却时间结束后尝试放行部分请求探测依赖是否恢复。

状态切换依据如下参数决定:

| 参数名 | 默认值 | 作用 |

|---|---|---|

circuitBreaker.requestVolumeThreshold |

20 | 滚动窗口内最小请求数,低于则不启用熔断 |

circuitBreaker.errorThresholdPercentage |

50 | 错误率超过此百分比触发 OPEN |

circuitBreaker.sleepWindowInMilliseconds |

5000 | OPEN 状态持续时间,之后变为 HALF_OPEN |

状态转换表

| 当前状态 | 条件 | 下一状态 | 触发动作 |

|---|---|---|---|

| CLOSED | 错误率 ≥ 阈值且请求数 ≥ requestVolumeThreshold | OPEN | 停止调用依赖,启动计时器 |

| OPEN | sleepWindow 时间到达 | HALF_OPEN | 允许有限请求通过 |

| HALF_OPEN | 有请求成功 | CLOSED | 重置计数器 |

| HALF_OPEN | 仍有失败 | OPEN | 重新计时 |

可以通过以下方式查看熔断器状态(调试用途):

HystrixCircuitBreaker breaker = HystrixCircuitBreaker.Factory.getCircuitBreaker(commandKey);

boolean isOpen = breaker.isOpen();

参数动态调整建议

生产环境中应根据服务 SLA 动态调整熔断策略。例如对关键支付服务可降低错误率阈值至 30%,而对非核心推荐服务可提高至 70% 以减少误判。

5.1.3 资源隔离策略:线程池 vs 信号量

Hystrix 提供两种资源隔离机制,用于限制对特定依赖的资源消耗。

1. 线程池隔离(THREAD)

每个依赖服务分配独立线程池,调用在单独线程中执行。

hystrix:

command:

GetUserById:

execution:

isolation:

strategy: THREAD

thread:

timeoutInMilliseconds: 1000

优点:

- 支持超时控制

- 故障隔离彻底,不会影响主线程

- 可监控线程池队列长度、活跃度等指标

缺点:

- 线程上下文切换开销

- 默认每组最多 10 个线程,需合理规划并发

2. 信号量隔离(SEMAPHORE)

使用计数器控制并发访问数,运行在调用线程中。

hystrix:

command:

GetConfigValue:

execution:

isolation:

strategy: SEMAPHORE

semaphore:

maxConcurrentRequests: 30

适用场景:

- 本地缓存查询

- 内存计算服务

- 不涉及网络 IO 的轻量操作

对比表格

| 特性 | 线程池隔离 | 信号量隔离 |

|---|---|---|

| 是否支持超时 | ✅ 是 | ❌ 否 |

| 资源开销 | 较高(线程创建) | 低(仅计数器) |

| 故障传播风险 | 低(独立线程) | 高(共享线程) |

| 最大并发控制 | 基于线程池大小 | 基于信号量数值 |

| 适用场景 | 远程服务调用 | 本地/高速服务 |

选择建议: 优先使用线程池隔离 ,尤其对于跨服务调用;仅在极高 QPS 且无网络依赖的场景考虑信号量。

5.2 Hystrix 与 OpenFeign 的集成应用

Spring Cloud 中最常用的声明式客户端是 OpenFeign,它天然支持与 Hystrix 的整合,能够实现接口级别的自动降级。

5.2.1 启用 Feign + Hystrix 支持

首先在 pom.xml 添加依赖:

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-openfeign</artifactId>

</dependency>

然后在启动类上添加注解:

@SpringBootApplication

@EnableFeignClients

@EnableCircuitBreaker

public class OrderApplication { ... }

并在 application.yml 中开启 Hystrix 支持:

feign:

hystrix:

enabled: true

5.2.2 定义 Feign Client 及降级实现

@FeignClient(name = "user-service", fallback = UserServiceFallback.class)

public interface UserServiceClient {

@GetMapping("/api/users/{id}")

User getUserById(@PathVariable("id") Long id);

}

@Component

public class UserServiceFallback implements UserServiceClient {

@Override

public User getUserById(Long id) {

return new User(id, "fallback_user", "Service Unavailable");

}

}

逻辑分析:

@FeignClient(fallback = ...)指定降级类,必须为 Spring Bean- 当

user-service调用失败(超时、连接拒绝、熔断开启),自动调用UserServiceFallback中的方法 - 降级类需实现原接口的所有方法,否则启动报错

⚠️ 注意:若使用

fallbackFactory,可捕获具体异常信息:

@FeignClient(name = "user-service", fallbackFactory = UserServiceFallbackFactory.class)

public interface UserServiceClient { ... }

@Component

public class UserServiceFallbackFactory implements FallbackFactory<UserServiceClient> {

@Override

public UserServiceClient create(Throwable cause) {

return id -> new User(id, "error_user", "Error: " + cause.getMessage());

}

}

这在调试阶段非常有用,可以区分是网络超时还是服务宕机。

5.2.3 自定义 Hystrix 命令属性配置

可通过 YAML 文件精细控制每个 Feign 接口的行为:

hystrix:

command:

UserServiceClient#getUserById(Long):

execution:

isolation:

thread:

timeoutInMilliseconds: 800

circuitBreaker:

requestVolumeThreshold: 10

errorThresholdPercentage: 40

sleepWindowInMilliseconds: 10000

命名规则为: ClassName#methodName(paramTypes) ,注意参数类型要写全称如 java.lang.Long 。

也可通过编程方式配置:

HystrixCommandKey key = HystrixCommandKey.Factory.asKey("UserServiceClient_getUserById");

HystrixCommandProperties.Setter()

.withExecutionTimeoutInMilliseconds(800)

.withCircuitBreakerErrorThresholdPercentage(40);

配置生效验证方法

可通过 Hystrix Dashboard 查看实时指标,或通过 /actuator/hystrix.stream 获取原始流数据:

curl http://localhost:8080/actuator/hystrix.stream

输出样例:

data: {"type":"HystrixCommand","name":"GetUserById","group":"UserService","currentTime":1719834567890,"isCircuitBreakerOpen":false,"errorPercentage":0,"requestCount":5,"rollingMaxConcurrentExecutions":1}

5.3 监控、可视化与生产调优策略

Hystrix 提供强大的监控能力,配合 Turbine 和 Dashboard 可实现集群级熔断状态可视化。

5.3.1 集成 Hystrix Dashboard 实时监控

添加依赖:

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix-dashboard</artifactId>

</dependency>

启动类添加:

@EnableHystrixDashboard

访问 http://localhost:8080/hystrix 输入目标服务的 /actuator/hystrix.stream 地址即可查看图形化面板。

主要监控指标说明

| 指标 | 含义 |

|---|---|

| Command Executed | 总请求数 |

| Success | 成功数 |

| Error | 异常数(包括超时、熔断、网络错误) |

| Timeout | 超时次数 |

| Rejected | 线程池拒绝数 |

| Fallback Success | 降级成功次数 |

| Fallback Failure | 降级也失败的次数 |

绿色区域越大表示健康度越高,红色闪烁表示大量失败。

5.3.2 使用 Turbine 聚合多实例流数据

单个服务可能部署多个实例,Turbine 可聚合所有 /hystrix.stream 数据:

turbine:

appConfig: order-service,user-service

clusterNameExpression: new String("default")

Turbine Server 启动后暴露 /turbine.stream ,Hystrix Dashboard 输入该地址即可监控整个服务集群。

流程图(Mermaid)

graph LR

A[Instance 1] -->|/hystrix.stream| D[Turbine Server]

B[Instance 2] -->|/hystrix.stream| D

C[Instance N] -->|/hystrix.stream| D

D -->|/turbine.stream| E[Hystrix Dashboard]

E --> F[图形化展示]

5.3.3 生产环境优化建议

1. 合理设置超时时间

避免 Hystrix 超时 > Ribbon 超时 > HTTP Client 超时,应满足:

HystrixTimeout ≤ Ribbon.ReadTimeout + Ribbon.ConnectTimeout

推荐配置:

hystrix:

command:

default:

execution:

isolation:

thread:

timeoutInMilliseconds: 2000

ribbon:

ReadTimeout: 1500

ConnectTimeout: 500

2. 关闭不必要的监控端点(安全)

management:

endpoints:

web:

exposure:

include: info,health

exclude: hystrix.stream

或加权限认证。

3. 替代方案演进思考

尽管 Hystrix 已进入维护模式,但其设计理念仍具指导意义。可逐步迁移到:

- Resilience4j :轻量级、函数式、支持 Ratpack/Reactor

- Sentinel(阿里开源) :支持热点参数限流、系统自适应保护

迁移示例(Resilience4j + Feign):

@Bean

public Customizer<Resilience4JCircuitBreakerFactory> defaultCustomizer() {

return factory -> factory.configureDefault(id -> new Resilience4JConfigBuilder(id)

.timeLimiterConfig(TimeLimiterConfig.ofDefaults())

.circuitBreakerConfig(CircuitBreakerConfig.ofDefaults())

.build());

}

但仍建议在旧项目中保留 Hystrix,新项目优先选用 Resilience4j。

6. Spring Cloud Config动态配置管理与实践

在现代微服务架构中,随着服务数量的快速增长,传统的静态配置方式(如 application.yml 或 application.properties 文件)已难以满足多环境、高可用和快速迭代的需求。每当配置变更时,都需要重新打包并重启服务,这不仅影响系统稳定性,也极大降低了运维效率。为解决这一痛点,Spring Cloud 提供了 Spring Cloud Config —— 一个集中式、可扩展的分布式配置管理解决方案。

Spring Cloud Config 支持将配置信息集中存储于 Git、SVN、本地文件系统或 Consul 等外部配置中心,并通过 REST API 接口供各个微服务动态拉取。它实现了“配置与代码分离”的核心理念,使开发、测试、生产等不同环境下的配置统一管理成为可能。更重要的是,结合 Spring Cloud Bus 消息总线机制,Config Server 可以实现配置的自动刷新,避免手动触发 /actuator/refresh ,真正达成“热更新”能力。

本章将深入剖析 Spring Cloud Config 的整体架构设计、核心组件原理及其在真实生产环境中的应用模式。从单机部署到高可用集群搭建,再到安全认证与权限控制,逐步构建一套健壮、灵活且可运维的配置管理中心。同时,通过实际案例演示如何集成 Git 仓库作为后端存储、使用占位符实现多环境适配、借助 Actuator 实现运行时配置查看与刷新,并最终结合 RabbitMQ 和 Spring Cloud Bus 实现跨服务的广播式配置同步。

此外,还将探讨 Config Server 在容器化部署(Kubernetes + Helm)场景下的最佳实践,分析其与 Vault、Consul 等专业配置管理工具的对比优势与局限性。通过对性能瓶颈、安全性加固、灰度发布支持等方面的讨论,帮助读者全面掌握 Spring Cloud Config 在复杂企业级微服务体系中的落地方法论。

6.1 Spring Cloud Config 架构设计与核心组件解析

Spring Cloud Config 的设计理念源于“集中式配置管理”,其架构采用典型的客户端-服务器模型(Client-Server),由 Config Server 和 Config Client 两大部分组成,分别承担配置集中存储与分发、以及配置获取与加载的角色。整个体系结构具备良好的解耦性和可扩展性,适用于大规模微服务集群的统一治理。

6.1.1 配置中心的核心角色与职责划分

在该架构中, Config Server 是配置管理的中枢节点,负责连接外部配置存储源(如 Git 仓库)、暴露 RESTful 接口供客户端访问、缓存配置数据以提升响应速度。而 Config Client 则是每一个接入该系统的微服务实例,在启动时主动向 Config Server 发起请求,拉取自身所属的应用名、环境标识对应的配置文件,并注入到 Spring 环境上下文中。

这种模式带来了显著的优势:

- 所有服务共享同一套配置源,确保一致性;

- 支持按 /{application}/{profile} 路径规则进行精准匹配;

- 允许动态调整参数而不需重启服务;

- 易于审计变更历史(特别是使用 Git 时);

下面是一个典型的请求路径示例:

http://config-server:8888/user-service/dev

其中:

- user-service :应用名称(对应 spring.application.name )

- dev :激活的 Profile(对应 spring.profiles.active )

服务器会查找名为 user-service-dev.yml 或 user-service-dev.properties 的文件返回内容。

核心组件结构图(Mermaid 流程图)

graph TD

A[Git Repository] -->|存储配置文件| B(Config Server)

B -->|提供REST接口| C{Config Clients}

C --> D[Service A - dev]

C --> E[Service B - test]

C --> F[Service C - prod]

G[Spring Cloud Bus] -->|消息广播| B

G --> H[RabbitMQ/Kafka]

B -->|安全认证| I[OAuth2 / HTTP Basic]

此图展示了 Config Server 如何作为中介桥接版本控制系统与众多微服务客户端,同时引入消息总线实现事件驱动的配置推送。

6.1.2 外部存储后端的选择与配置策略

Spring Cloud Config 支持多种后端存储机制,最常见的是基于 Git 的方案,因其天然支持版本控制、分支管理、审计追踪等功能,非常适合团队协作开发。

| 存储类型 | 特点 | 适用场景 |

|---|---|---|

| Git(推荐) | 支持版本控制、分支、标签、审计日志 | 生产环境、多环境管理 |

| SVN | 类似 Git,但功能较弱 | 已有 SVN 基础设施的企业 |

| Native(本地文件) | 直接读取本地目录下的配置文件 | 开发调试、简单场景 |

| Consul | 强一致性键值存储,适合动态配置 | 与 Consul 集成的服务发现体系 |

| Vault | 安全密钥管理,加密能力强 | 敏感信息(数据库密码等)管理 |

以 Git 后端为例,可通过如下方式进行配置:

spring:

cloud:

config:

server:

git:

uri: https://github.com/myorg/config-repo.git

search-paths: '{application}'

username: ${GIT_USER}

password: ${GIT_PASS}

clone-on-start: true

refresh-rate: 30 # 每30秒检查一次远程变更

参数说明:

uri: 配置仓库地址,支持 HTTPS、SSH。search-paths: 查找路径模板,支持通配符{application}动态替换。clone-on-start: 启动时立即克隆仓库,提高首次访问速度。refresh-rate: 自动刷新间隔(单位:秒),防止频繁拉取造成压力。

注意:对于私有仓库,建议使用 Personal Access Token 替代密码,增强安全性。

6.1.3 配置加载流程与内部工作机制

当 Config Client 启动时,其加载配置的过程可分为以下几个阶段:

-

准备引导上下文(Bootstrap Context)

- 使用bootstrap.yml中的信息初始化连接 Config Server。

- 此上下文优先于主 Spring 应用上下文加载。 -

构造请求 URL 并发送 HTTP 请求

- 根据spring.application.name和spring.profiles.active组装请求路径。

- 示例:GET /user-service/prod,eureka -

解析返回的 YAML/JSON 配置内容

- 将响应体反序列化为 Property Source 对象链。

- 注入到 Environment 中,覆盖本地配置。 -

合并本地与远程配置

- 远程配置具有更高优先级(可通过spring.cloud.config.allow-overrides控制)。

- 若关闭覆盖,则本地配置生效。 -

完成主上下文启动

- Bean 初始化过程中即可读取最新配置值。

为了更清晰地理解这一过程,以下是一段简化的伪代码逻辑分析:

// BootstrapConfiguration.java (简化版)

@Configuration

public class BootstrapConfiguration {

@Value("${spring.cloud.config.uri}")

private String configServerUri;

@Value("${spring.application.name}")

private String appName;

@Value("${spring.profiles.active}")

private String profile;

public void loadRemoteConfig() {

String url = String.format("%s/%s/%s", configServerUri, appName, profile);

RestTemplate restTemplate = new RestTemplate();

// 发起GET请求获取配置

ResponseEntity<Map> response = restTemplate.getForEntity(url, Map.class);

if (response.getStatusCode().is200()) {

Map<String, Object> configData = response.getBody();

PropertySource<?> remotePs = new MapPropertySource("remoteConfig", configData);

environment.getPropertySources().addFirst(remotePs); // 高优先级插入

}

}

}

逐行逻辑解读:

- 注入 Config Server 地址、应用名和当前 Profile;

- 构造标准请求路径;

- 使用

RestTemplate发起同步调用; - 成功响应后,创建

MapPropertySource对象; - 将其添加至 Spring 环境的 PropertySources 最前端,确保优先读取。

该机制保证了即使本地存在同名属性,也能被远程配置正确覆盖,从而实现统一管控。

6.2 分布式环境下配置的动态刷新与事件通知机制

尽管 Spring Cloud Config 支持从远程加载配置,但如果每次修改都需要手动重启服务或调用 /actuator/refresh ,仍然无法满足高频变更需求。为此,Spring Cloud 引入了 Spring Cloud Bus —— 一种轻量级消息总线,用于在分布式节点间传播状态变化(如配置更新),实现“一处修改,处处生效”。

6.2.1 Spring Cloud Bus 的工作原理与通信模型

Bus 基于消息中间件(如 RabbitMQ、Kafka)构建,本质上是一个 AMQP 协议上的广播通道。当某个 Config Client 接收到更新指令后,它会向 Bus 发送一个 RefreshRemoteApplicationEvent 事件,所有订阅该主题的服务实例都会接收到通知并执行本地刷新逻辑。

典型工作流程(Mermaid 图)

sequenceDiagram

participant Admin as 配置管理员

participant CS as Config Server

participant MQ as RabbitMQ

participant C1 as Client 1

participant C2 as Client 2

Admin->>CS: POST /actuator/bus-refresh?destination=users:**

CS->>MQ: 发布 RefreshEvent(目标限定)

MQ->>C1: 接收事件

MQ->>C2: 接收事件

C1->>C1: 执行 @RefreshScope Beans 刷新

C2->>C2: 执行 @RefreshScope Beans 刷新

上述流程体现了事件驱动的异步通信机制,有效降低了同步调用带来的网络阻塞风险。

6.2.2 集成 RabbitMQ 实现配置热更新实战

要启用 Bus 功能,需在 Config Server 和所有 Config Client 中引入相关依赖:

<!-- pom.xml -->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-bus-amqp</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

并在配置文件中启用 RabbitMQ 支持:

# application.yml

spring:

rabbitmq:

host: localhost

port: 5672

username: guest

password: guest

cloud:

bus:

enabled: true

trace:

enabled: true # 开启事件跟踪

management:

endpoints:

web:

exposure:

include: bus-refresh,refresh,env

此时,只需对任意一个客户端或 Config Server 执行:

curl -X POST http://localhost:8080/actuator/bus-refresh

即可触发全局配置刷新。

更精细地,可通过

destination参数指定目标服务和端口:/actuator/bus-refresh?destination=order-service:**

6.2.3 @RefreshScope 注解的作用机制与使用限制

并非所有 Bean 都能自动感知配置变化。只有标注了 @RefreshScope 的 Bean 才会在收到刷新事件后重建实例。典型应用场景包括:

@Component

@RefreshScope

public class DatabaseConfig {

@Value("${db.url}")

private String dbUrl;

@PostConstruct

public void init() {

System.out.println("DB URL is: " + dbUrl);

}

// getter/setter...

}

工作机制分析:

@RefreshScope是一个自定义作用域(Scope),继承自GenericScope;- 当配置刷新时,Spring 将销毁该 Bean 的旧实例;

- 下次调用时重新创建,重新绑定

@Value注入的属性; - 因此能反映最新的配置值。

使用注意事项:

- 不适用于原型(

@Scope("prototype"))以外的作用域; - 避免在

@Component类中直接调用this.method(),可能导致代理失效; - 初始化逻辑应放在

@PostConstruct中而非构造函数,确保值已注入。

6.3 多环境配置管理与安全加固策略

在真实的生产环境中,必须严格区分开发、测试、预发布、正式环境的配置内容,防止敏感信息泄露或误操作引发事故。Spring Cloud Config 提供了完善的 Profile 多维度管理和安全防护机制。

6.3.1 多环境隔离与命名规范设计

推荐采用如下命名结构组织 Git 仓库中的配置文件:

/config-repo/

├── user-service-dev.yml

├── user-service-test.yml

├── user-service-uat.yml

└── user-service-prod.yml

并通过 CI/CD 流水线自动部署对应环境的服务实例,确保 spring.profiles.active=prod 时仅加载生产配置。

还可以利用复合 Profile 实现更细粒度控制:

# user-service.yml

logging:

level:

root: INFO

# user-service-eureka.yml

eureka:

client:

serviceUrl:

defaultZone: http://discovery:8761/eureka/

# user-service-db-mysql.yml

spring:

datasource:

url: jdbc:mysql://mysql:3306/users

启动时指定多个 Profile:

--spring.profiles.active=prod,eureka,db-mysql

系统会依次加载基础配置和各 Profile 片段,形成完整的配置集合。

6.3.2 敏感信息加密与 Vault 集成方案

直接在 Git 中明文存储数据库密码、API 密钥等极为危险。Spring Cloud Config 支持使用对称或非对称加密来保护敏感字段。

启用加密功能步骤:

- 在 Config Server 添加 JCE 支持库;

- 配置加密密钥:

encrypt:

key: my-very-secret-key-1234567890

- 使用

/encrypt和/decrypt端点加解密:

# 加密

curl -X POST --data-urlencode "mysecret" http://localhost:8888/encrypt

# 输出:AeGz...HkLp

然后在配置文件中使用:

db:

password: '{cipher}AeGz...HkLp'

Config Client 会在加载时自动解密。

更高级的做法是集成 Hashicorp Vault,实现集中式密钥管理与动态凭证发放。

6.3.3 权限控制与访问审计日志记录

为防止未授权访问,应在 Config Server 前增加安全层:

security:

basic:

enabled: true

user:

name: configadmin

password: ${CONFIG_PASSWORD:default-pass}

结合 Spring Security OAuth2 可实现 JWT 认证、RBAC 权限分级。

同时开启审计功能:

management:

audit:

enabled: true

可记录每一次配置访问行为,便于事后追溯。

6.4 配置中心高可用部署与容器化实践

在大型系统中,Config Server 本身不能成为单点故障。应通过集群部署 + 负载均衡 + 共享存储的方式保障其高可用性。

6.4.1 多实例集群部署方案

部署多个 Config Server 实例,共享同一个 Git 仓库:

# Kubernetes Deployment 示例

apiVersion: apps/v1

kind: Deployment

metadata:

name: config-server

spec:

replicas: 3

selector:

matchLabels:

app: config-server

template:

metadata:

labels:

app: config-server

spec:

containers:

- name: config-server

image: myregistry/config-server:latest

env:

- name: GIT_URI

value: "https://github.com/myorg/config-repo.git"

ports:

- containerPort: 8888

配合 Service 实现负载均衡:

apiVersion: v1

kind: Service

metadata:

name: config-server-svc

spec:

selector:

app: config-server

ports:

- protocol: TCP

port: 8888

targetPort: 8888

type: LoadBalancer

客户端通过服务名访问: http://config-server-svc:8888

6.4.2 Git 仓库镜像与缓存优化策略

为减少对远程 Git 的依赖,可在 Config Server 内部设置本地缓存目录:

spring:

cloud:

config:

server:

git:

basedir: /tmp/config-repo-cache

force-pull: true # 定期强制拉取远程更新

对于跨国部署场景,建议使用镜像仓库或 CDN 加速访问。

6.4.3 Helm Chart 封装与自动化交付

可将 Config Server 打包为 Helm Chart,实现一键部署:

# values.yaml

replicaCount: 3

image:

repository: myregistry/config-server

tag: latest

env:

GIT_URI: https://github.com/myorg/config-repo.git

resources:

requests:

memory: "512Mi"

cpu: "250m"

通过 CI/CD 流水线自动发布新版本,提升交付效率。

综上所述,Spring Cloud Config 不仅解决了配置分散的问题,还通过与 Bus、Git、RabbitMQ、Vault 等技术的深度融合,构建了一套完整、安全、高效的动态配置管理体系。合理运用这些特性,能够显著提升微服务系统的灵活性与可维护性。

7. 微服务拆分设计原则与服务治理策略

7.1 微服务拆分的核心设计原则

微服务架构的成败,往往在项目初期的服务拆分阶段就已决定。合理的服务边界划分不仅能提升系统的可维护性和扩展性,还能显著降低团队协作成本。以下是微服务拆分过程中应遵循的关键设计原则:

1. 单一职责原则(SRP)

每个微服务应围绕一个明确的业务能力构建,具备独立的领域模型和数据存储。例如,在电商平台中,“订单服务”只负责订单生命周期管理,不掺杂支付或库存逻辑。

2. 领域驱动设计(DDD)指导拆分

通过识别限界上下文(Bounded Context)来定义服务边界。以下为典型电商系统中的限界上下文示例:

| 限界上下文 | 核心职责 | 关联实体 |

|---|---|---|

| 用户中心 | 用户注册、登录、权限管理 | User, Role, Permission |

| 商品中心 | 商品信息管理、分类、品牌 | Product, Category, Brand |

| 订单中心 | 创建订单、状态流转、查询 | Order, OrderItem |

| 支付中心 | 处理支付请求、回调通知 | Payment, Transaction |

| 库存中心 | 扣减库存、预占、释放 | Stock, Warehouse |

该表体现了基于业务语义的自然分割,避免了服务间高耦合。

3. 松耦合与高内聚

服务内部模块高度聚合,对外暴露最小接口集。推荐使用事件驱动模式解耦服务调用。例如订单创建成功后发布 OrderCreatedEvent ,由库存服务监听并扣减库存:

@Component

public class OrderEventListener {

@Autowired

private InventoryClient inventoryClient;

@EventListener

public void handleOrderCreated(OrderCreatedEvent event) {

// 异步调用库存服务进行扣减

inventoryClient.deductStock(event.getProductId(), event.getQuantity());

}

}

说明 :通过Spring事件机制实现服务间通信,降低直接依赖。

4. 数据自治原则

每个微服务拥有独立数据库,禁止跨服务直接访问对方DB。如下图所示,采用数据库私有化架构:

graph TD

A[订单服务] --> B[(订单库)]

C[用户服务] --> D[(用户库)]

E[商品服务] --> F[(商品库)]

G[库存服务] --> H[(库存库)]

style A fill:#4CAF50,stroke:#388E3C

style C fill:#4CAF50,stroke:#388E3C

style E fill:#4CAF50,stroke:#388E3C

style G fill:#4CAF50,stroke:#388E3C

图解:各服务独享数据库实例,确保数据所有权清晰。

7.2 服务治理的关键策略

随着微服务数量增长,治理复杂度呈指数上升。必须建立统一的服务治理体系,涵盖注册发现、配置管理、链路追踪、安全认证等方面。

1. 注册与发现协同治理

所有服务必须强制注册至Eureka或Nacos等注册中心,并启用健康检查机制。建议配置如下心跳参数以快速感知故障:

eureka:

instance:

lease-renewal-interval-in-seconds: 10 # 每10秒发送一次心跳

lease-expiration-duration-in-seconds: 30 # 30秒未收到心跳则剔除

client:

registry-fetch-interval-seconds: 15 # 客户端每15秒拉取服务列表

同时开启区域感知(Zone-awareness),提升跨机房容灾能力。

2. 统一配置中心集成

将敏感配置(如数据库连接、开关规则)集中托管于Spring Cloud Config Server,支持动态刷新:

# 触发指定服务的配置更新

curl -X POST http://config-client-host/actuator/refresh

结合Git仓库版本控制,实现配置变更审计与回滚。

3. 全链路监控与日志聚合

引入Sleuth + Zipkin实现分布式追踪,记录每个请求的完整路径。关键字段包括:

traceId:全局唯一标识spanId:当前操作片段IDparentSpanId:父级操作ID

并通过ELK或Loki收集结构化日志,便于问题定位。

4. 网关层统一治理入口

API网关作为流量入口,承担以下职责:

| 功能 | 实现方式 |

|---|---|

| 路由转发 | Spring Cloud Gateway Route Predicate |

| 认证鉴权 | JWT Token校验Filter |

| 限流降级 | Redis + RateLimiter组件 |

| 日志埋点 | GlobalFilter记录请求响应时间 |

| 跨域处理 | 添加CORS响应头 |

示例限流过滤器配置:

spring:

cloud:

gateway:

routes:

- id: order_route

uri: lb://order-service

predicates:

- Path=/api/orders/**

filters:

- name: RequestRateLimiter

args:

redis-rate-limiter.replenishRate: 10 # 每秒补充10个令牌

redis-rate-limiter.burstCapacity: 20 # 最大突发容量20

5. 服务契约与API版本管理

使用OpenAPI(Swagger)定义RESTful接口契约,并实施版本兼容策略:

@GetMapping(value = "/orders/{id}", produces = "application/vnd.company.order.v1+json")

public ResponseEntity<Order> getOrderV1(@PathVariable String id) {

return ResponseEntity.ok(orderService.findById(id));

}

通过MIME类型区分不同版本,支持灰度升级。

6. 故障隔离与熔断保护

对关键下游依赖启用Hystrix或Resilience4j熔断器,防止雪崩效应。配置示例如下:

@CircuitBreaker(name = "inventoryService", fallbackMethod = "fallbackDeduct")

public boolean deductStock(String productId, int quantity) {

return inventoryClient.deduct(productId, quantity);

}

public boolean fallbackDeduct(String productId, int quantity, Throwable t) {

log.warn("库存服务不可用,触发降级逻辑", t);

return false;

}

配合超时与重试策略,提升整体系统韧性。

简介:SpringCloud是广泛应用于中国开发者的微服务框架,源自Netflix开源技术,旨在简化分布式系统开发。本笔记由知名IT教育专家周阳老师精心整理,系统讲解SpringCloud核心组件与微服务关键理念,内容涵盖服务注册发现、API网关、负载均衡、熔断限流、配置管理、消息驱动、分布式追踪等关键技术。通过本资料学习,开发者可掌握SpringCloud环境搭建、服务通信、容错处理及与Docker、Kubernetes等容器技术的集成,全面提升构建高可用、可扩展微服务系统的能力。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)