C++接入AI大模型SDK--项目简介

大模型接入讲解

目录

总结:底层用的是c++,非常硬核。python和java只是外壳。

项目背景

中国互联网的发展历经了PC时代、移动互联网时代,尤其是在移动互联网时代进行了大量的海量数据、技术积累,以及硬件算力的巨大提升,之前不温不火的人工智能,伴随着ChatGPT的横空出现.

迎来了今天AI的爆火,各种大模型、智能体应用等如雨后春笋版涌现出来,AI在更进⼀步进⼊普通⼈的生活。现在各个厂商也在积极拥抱AI,作为程序员我们决不能停留在简单使用DeepSeek、ChatGPT这 种大模型级别的产品,而应该去学习⼤模型应用背后的相关技术,将模型接入到我们程序中来,让AI 为自己服务,提高生产效率。本项目就带领大家从底层学习如何接入大模型,这也是进行大模型开发的第⼀步。

目标:

- 掌握大模型相关的⼀些基础知识

- 掌握官网提供⼤模型的API接口的学习

- 掌握C++下远程接入大模型思路及技术实现

- 掌握C++下本地接入大模型的思路及技术实现

- 开发一套语言聊天大模型应用

名词解释

刚开始模型只能处理文本的单模态,到后来不仅可以处理文本也可以处理图片,音频等多模态。

模型

此处模型专指AI领域的模型。可以简单理解成⼀个从大量数据中学习规律、用于进行预测的数学函 数,只是该函数参数巨多、无比复杂。

可以简单类比成⼀个正在学说话的小孩。

小孩通过耳朵输入海量的语音数据,比如:家人的口头教学、日常生活对话、读绘画本,通过眼睛去 认识各种物品,比如家庭日用品、交通工具、动物、花花草草等,小孩通过大人的耳传身教不断学习成长,慢慢地就能听懂大人的指令,甚至模仿大人行为等,建立起自己的语言规则。

比如他发现,我们经常将"吃"和"饭饭"、"水果"连在⼀起,"睡觉觉"和"床"连在⼀起,

当给孩子说:宝宝太晚了,我们⼀起上床_____

宝宝就会说:睡觉觉~~~

大模型

⼤模型就是AI里的超级学霸,参数巨多、知识量爆炸的AI模型,像吃了百科全书+全网数据的“六边形战士”。⼀个既能看懂你的照片(视觉),又能听懂你的指令(语音),还能用文字回答你的模型, 就是大模型。

参数海量:GPT-3有1750亿个参数,而早期模型参数不到⼀百万。

训练数据恐怖:吃掉整个互联网文本(书籍、论文、网页、代码...)。

训练⼀次GPT-3≈190万度电(够5000个家庭用1年)。

大语言模型

大语言模型就是AI界的"超级话痨",是⼀个吃掉整个互联网的文本,能读会写、知识渊博的AI大脑,专门处理⼈类语言,比如聊天、协作、翻译、编程等,但可能会胡说八道(并没真正理解)。

将整个互联网的数据喂给大模型后,大模型会通过神经网络分析词语之间的关系,例如将"猫"、"喵喵叫"、"毛茸茸"词归类到⼀起,但是它并不理解,当人类在提问的时候它会推测出最可能得回答.

可能会出现"幻觉" ◦ 没有真正"理解" ◦ 偏见与安全风险(发言危险)。

提示词

给AI的任务说明书,告诉AI要做什么、怎么做的指令。

提示词设计三要素:

角色设定:

"你是⼀个具有十年以上C++后端开发的架构师,请帮我设计类似微信的聊天软件" 问题描述

任务描述:

"用200字总结导致拖延症原因"

格式约束:

请按要点分条列出,每条不超过15字"

上下文

AI在对话或任务中临时记住的信息,像人类聊天时不会突然失忆,能联系前后文理解意思。

用户:推荐一部科幻电影

AI:《星际穿越》

用户:为什么推荐这部?

AI(结合上下文):因为它的硬核科学设定和感人父女情...

模型不会记住所有上下文信息,超出部分会被丢弃,就想内存满了自动覆盖。

比如GPT-4最多能记住128ktokens,大约10万字。

token

token是模型用来表示自然语言文本的基本单位,可直观理解为“字”或“词”;通常1个中文词语、1个英文单词、1个数字或1个符号计为1个token。

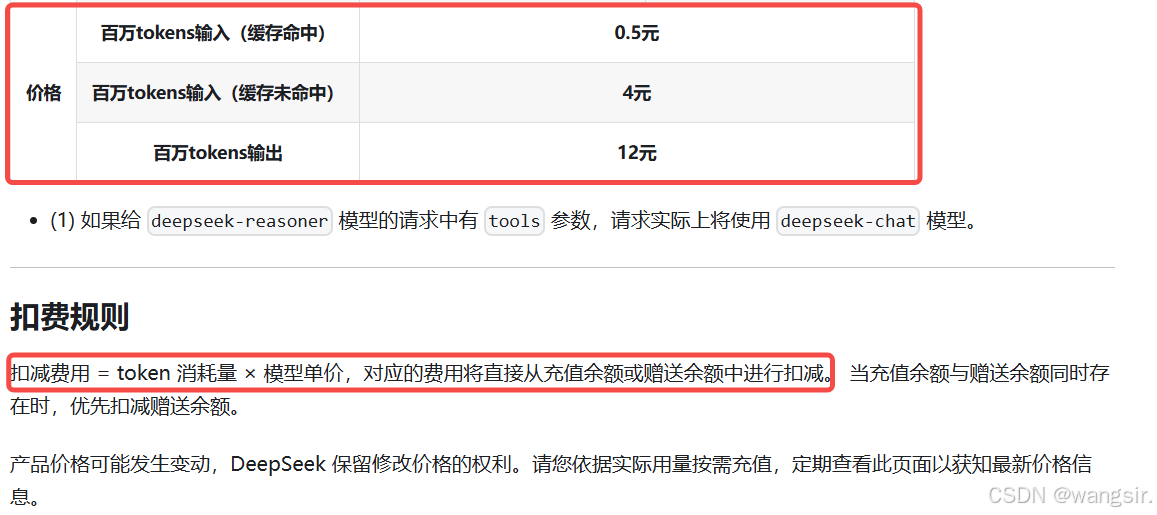

不同模型中关于token的计算方式可能稍有差异。下面是DeepSeek官网中关于公布的token的计算方式以及收费:

DeepSeek、ChatGPT、Gemini使用

产品和模型

DeepSeek、ChatGPT、Gemini并不是大模型,而是基于某个大模型开发出来的大模型应用产品。

大模型具有大量参数(数十亿甚至百亿)的人工智能模型,它学习了海量知识,掌握了理解自然语言、逻辑推理、写作、编程等底层通用能力,是⼀个拥有巨大潜力的"大脑"。

大模型产品是基于具体大模型开发出来的应用或服务,这些产品将大模型的能力封装成用户友好的界面或工具,提供给最终用户进行使用。比如DeepSeek官网提供的能和用户聊天的网页服务,实际就是 DeepSeek-V3.1模型装上了⼀个聊天界面,让用户低成本使用大模型提供的服务,你问大模型问题, 大模型将理解你的问题后将自己回答输出给你。

比如:DeepSeek是深度求索公司开发的,基于DeepSeek-V3.2模型的产品。

deepseek使用

deepseek官网:https://www.deepseek.com/

通过API来调用大模型

⼀句话总结:V3是"快",适合大多数日常任务;R1是"稳",专啃硬骨头,处理复杂问题。

如果需求是日常使用、快速获取信息、内容创作,DeepSeek-V3更适合。如果是需要严密逻辑推理、 解决复杂问题,比如钻研艰难的数学题、进行复杂算法研究,并愿意为更深入的思考付出⼀些等待时间,DeepSeek-R1这个"大学霸"会更适合。

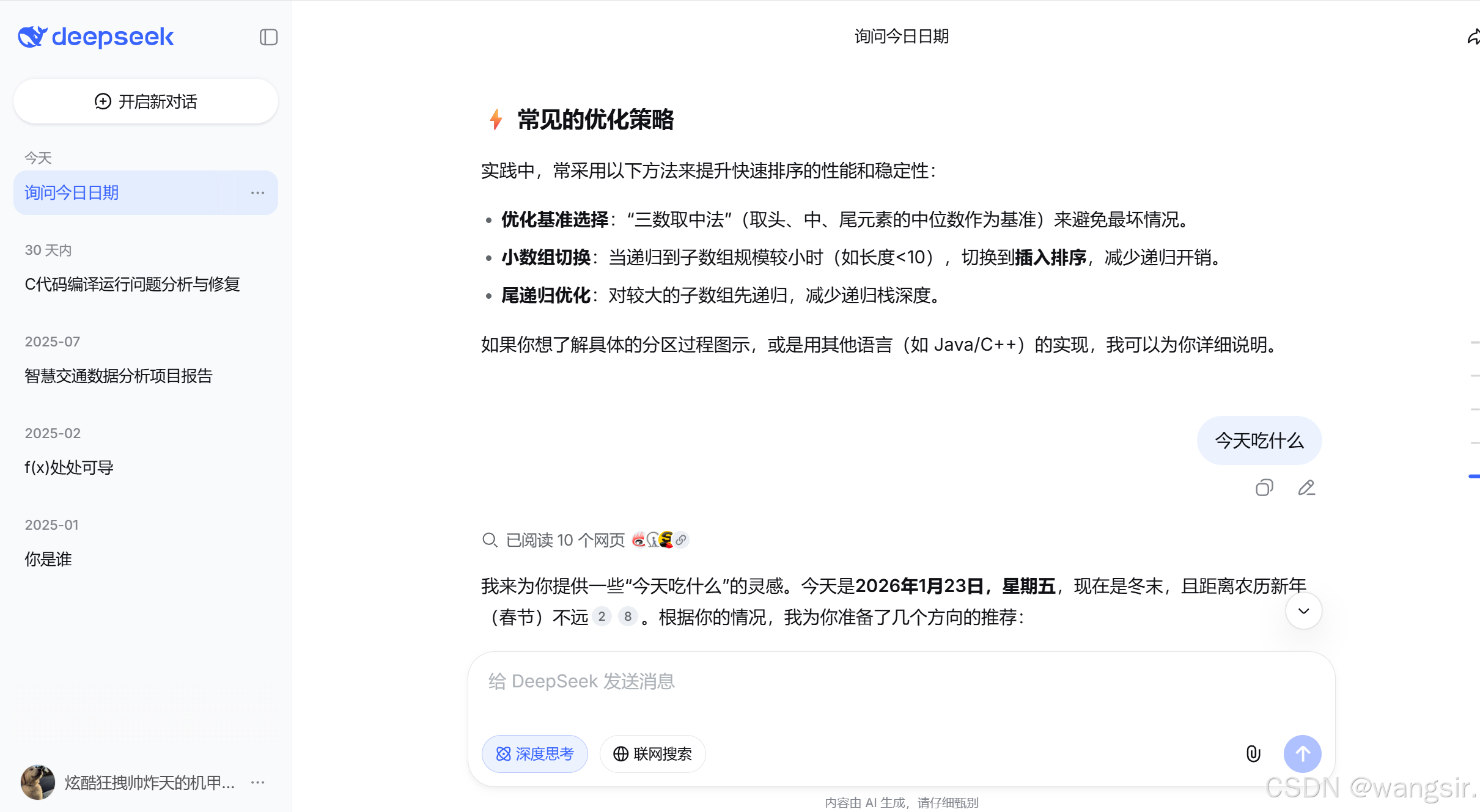

用户可以通过"深度思考"开关来切换快速响应模式(原V3模式)和深度推理模式(原R1 模式)。

- 深度推理模式和快速响应模式开关,默认未选中为快速响应模式,选中之后切换到深度思考模式。

- 未选中时仅使用模型预训练知识,开启后可获取最新信息,注意联网搜索模式下不支持上传文件。(模型训练出来是有截止日期的,当他发布时他的头脑里只有到现在的信息,当发布后的信息在头脑里没有的,那么实时化的数据可能不会那么精确)

- 未选中时无法上传文件,仅通过文本输入和模型交互,开启后支持上传PDF、Word、Excel等文件,模型会读取文件内容并根据内容回答问题

- 输⼊用户提示词之后,发送给模型,让模型思考回答。

- 开新⼀轮对话。比如切换一个新话题、当对话边的混乱,模型开始"胡言乱语"时。(因为模型会参考之前的消息)

- 支持会话管理。可以点击任意⼀条之前的会话记录,快速回到该次会话中,继续之前会话,就想看书时返回之前章节⼀样。会话名称⼀般是第⼀次问题的开头命名。

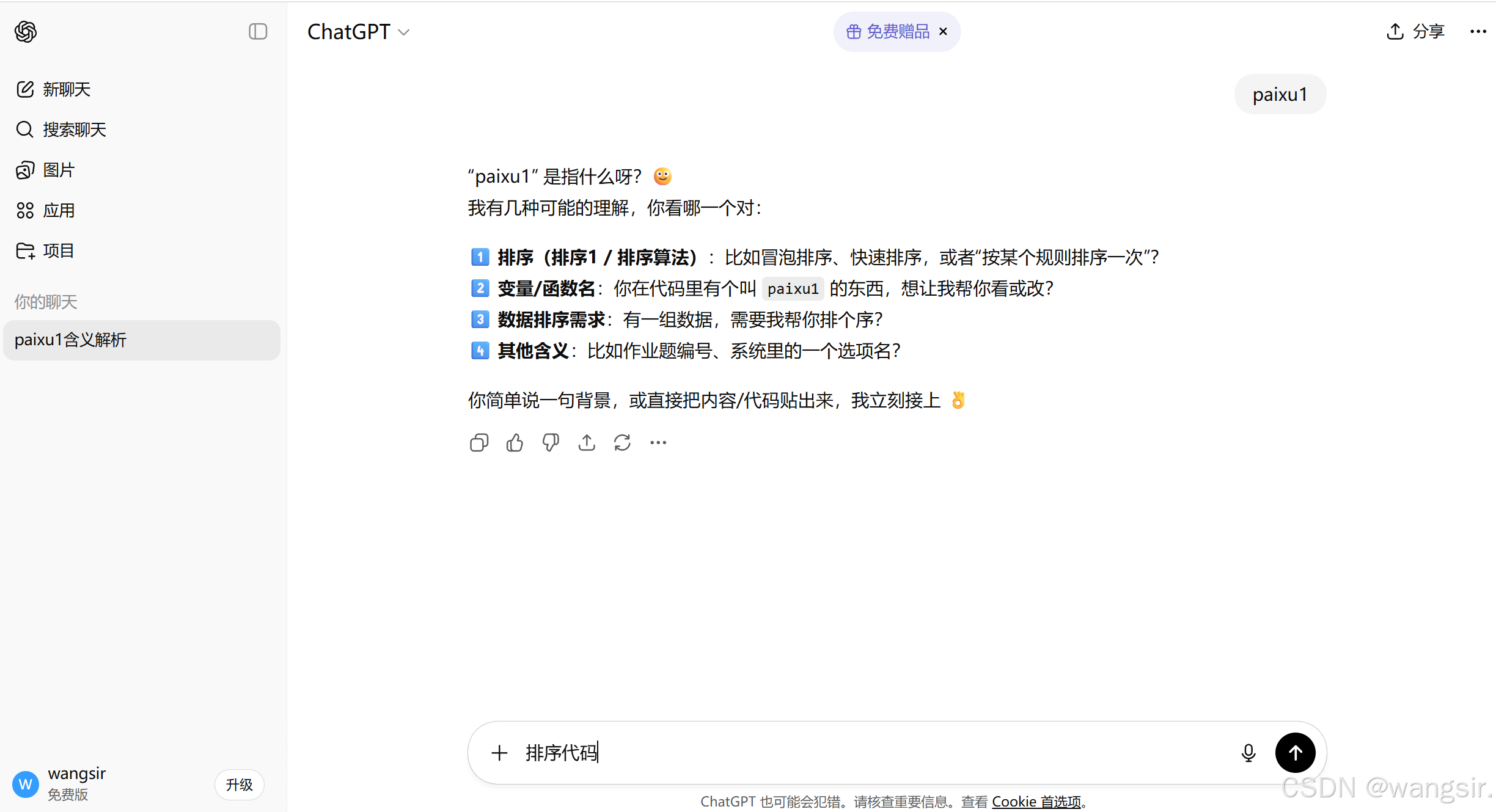

ChatGPT

GPT是Generative Pre-trained Transformer的缩写。

Generative(生成式):它能生成内容(文字、代码图像等),不是简单检索

Pre-trained(预训练):在大模型文本数据上先进行通用训练,再针对具体任务做微调

Transformer:⼀种深度学习框架,是目前大语言模型的核心技术,擅长处理序列数据,比如自然语 言。

GPT就是基于深度学习框架的⼀种大语言模型系列,比如:GPT-4、GPT-5。ChatGPT就是基于GPT模型的聊天式人工智能助手,是⼀个产品。

GPT-4可以处理文字和图片输入,刚开始主要是文字版(GPT-4-turbo),后来逐步开放图像输入,比如识别图片中文字、分析图表等,但输出主要是文字。GPT-5是⼀个完整的多模态模型,输入可以是文字、图片、音频、视频帧等,输出可以是文字、语音、甚至可以配合Sora生成视频。

官网:https://openai.com 访问得有梯子

- 使用ChatGPT搜索:选中之后会先调用"联网搜索"获取网页,再把结果交给ChatGPT进行总结和会 话

- 与ChatGPT交谈:标准聊天模式,主要用来对话、问答、写作、编程等

- 研究:自动查资料并生成结构化且带引用的研究报告

- Sora:Sora是生成视频的模型,输入文字即可生成视频内容,和GPT系列不同

Gemini

官网:https://gemini.google.com/app

需要注册(用邮箱)和chatgpt一样;

gemini翻译过来是双子座,双子座标志是两个并排站力的人物,象征则会二元性、合作以及强大的力 量。

Google在开发Gemini时,将Google DeepMind和Google Research的"Brain"团队合并,这两个团队的合作被视为"双子",共同致力于打造这个野心勃勃的多模态AI模型。

- 上传文件,支持文本、图片、视频等不同格式文件,让大模型进行理解并进行各种操作,比如总结文档关键内容,分析表格数据等

- Deep Research:对问题进行更深入、全面的信息检索和分析,⼀般在处理复杂或专业性强的问题 时非常有用

- 图片生成:根据用户的提示词,Gemini会使用Imagen模型生成⼀幅符合描述的图片

- 创建文档和应用:启用之后Gemini会根据用户输入需求,用Canvas生成文档初稿,用户可以实时调整和优化

- 像⼀个私人导师,能用多种方式来辅助学习,比如总结提炼核心要点、生成学习材料等。

- 支持语音输入

- 发起新⼀轮对话和临时对话,临时对话不会显示在会话记录中,临时会话系统仅保留72小时;发起 新⼀轮对话会开启⼀个全新的聊天会话

- 模型切换,目前支持gemini-2.5-flash和gemini-2.5-pro,或升级其他模型。gemini-2.5-flash擅长处理快速、简单的人物,比如基础问答、生成简短内容等,速度非常快;gemini-2.5-pro擅长处理复 杂、需要深度推理的任务,比如复杂数学题、编程等

- 支持会话管理

为什么学习通过API使用大模型

了解更多大模型知识,提高自己竞争力:

使用官方大模型服务就像开车,会操作就行,目的是到达终点;调用API就像学习汽车原理、保养和改装,能让你造出更适合任务的专用车,甚至将发动机装到飞机、轮船上。前者是大模型产品的使用者,后者已经摇身成为⼤模型应用的创造者。

构建自己的应用:

API允许你将大模型的"大脑"与你自己的程序、网站、数据库等连接起来,实现通用机器人无法完成的任务,解锁无限可能性。比如:开发智能编程助手提高日常开发效率、构建自动化工作流(自动处理邮件、生成报告、分析数据等)、构建垂直领域应用(为法律、医疗、教育等领域开发专业的问答工具)

职业发展:

大模型应用越来越广泛,许多公司都在将大模型能力渐渐接入到自己的产品中,在AI原生应用开发领域,大模型应用开发相关岗位也越来越多,会使用API集成大模型的能力,能让你在求职中更具竞争力,更好的适应行业的发展趋势。

学术研究:

有些考研的学生,研究的课题可能和人工智能相关,掌握API接入大模型技术后,可以为自己量身定制大模型应用以进行实验和数据分析,验证自己的研究假设。

项目演示

支持功能:获取会话列表 • 新建会话 • 获取支持模型 • 发送消息 • 获取指定会话的历史聊天记录 • 删除会话

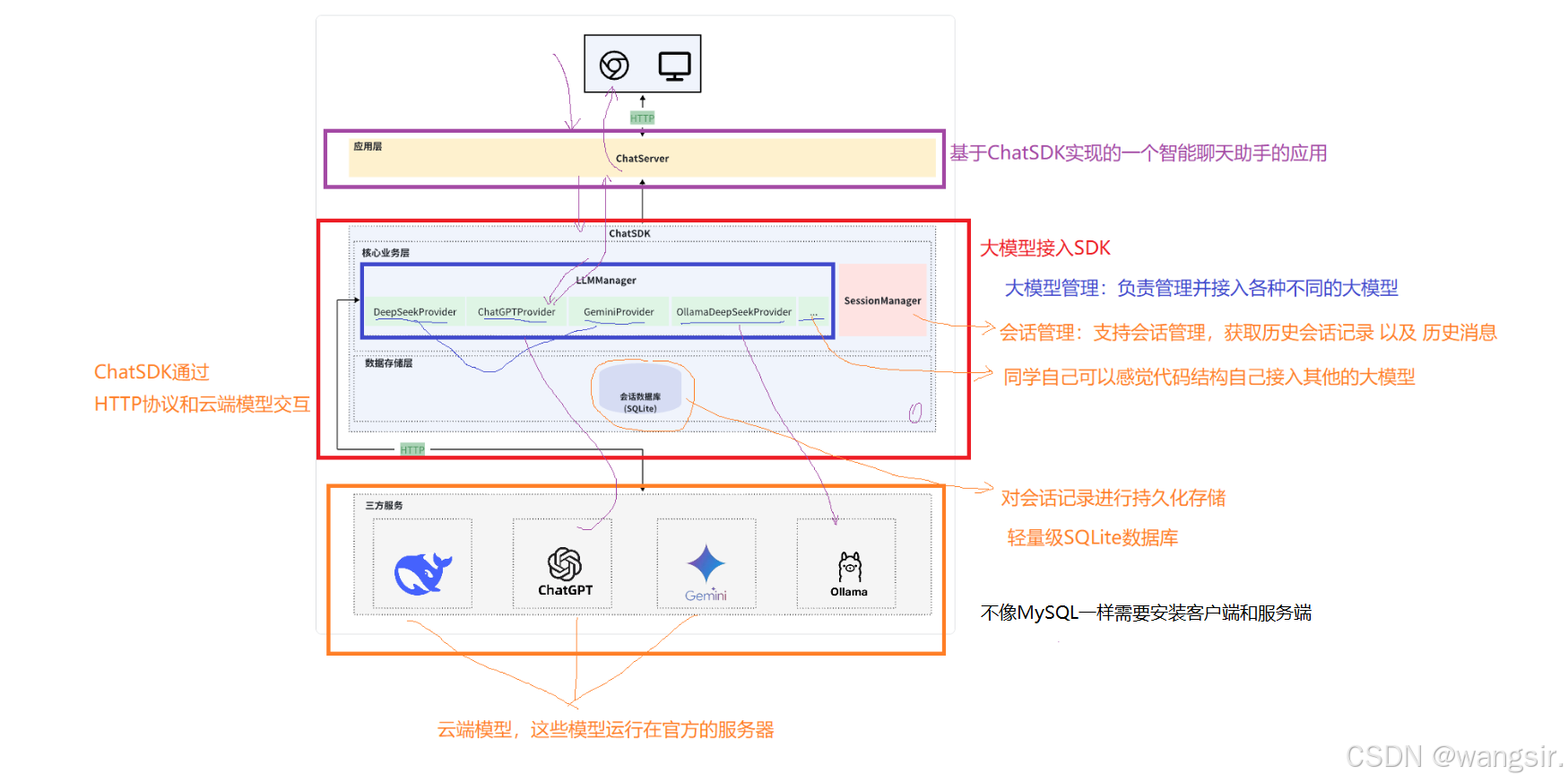

项目架构

用户通过浏览器向chatserve发送消息,chatserve收到消息调用底层的chatsdk,分析调用的是哪个模型,再通过http协议找到大模型,大模型收到用户的问题进行思考并原路返回。

Ollama是将官方的模型下载到本地,然后本地运行,通过Ollama进行管理。

应用层:用户使用ChatSDK库来封装自己的应用层服务,比如实现智能聊天机器人

ChatSDK:封装⼤模型管理库,包括大模型管理、Session管理以及数据存储。

大模型管理:负责管理并接入各种不同大模型,目前已接入deepseek-v3、gpt-4o-mini、 gemini-2.0-flash等云端大模型;支持接入本地大模型,并向外提供统⼀接口,用户可以通过提供的接⼝接入自己需要大模型。

会话管理:支持会话管理,用户可以获取获取会话列表、历史消息等

数据存储层:支持会话记录的持久化存储,方便查看历史会话。

三方服务:对于接入的云端模型,最终由ChatSDK将用户消息转发给三⽅服务器,模型回复后将结果 返回给应用层。对于本地部署⼤模型,ChatSDK会将用户消息发送给本地安装的Ollama服务器,由Ollama服务器和三方模型服务器对接,Ollama将模型的回复返回给ChatSDK,由ChatSDK将结果返 回给应用层。

下⾯是本项目中使用的第三方库和工具:

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)