人工智能基础知识点

考试专用

目录

第一章 深度学习基础

1.什么是人工智能?

人工智能是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术以及应用系统的一门新技术科学。

人工智能是计算机科学的一个分支,该领域包括图像识别、语言识别、机器人等。

2.人工智能、机器学习、深度学习三者之间的关系

人工智能:让机器通过学习、推理等方式模拟人类认知,使其会听说读写。

机器学习:依赖手工特征工程,通常需要专家提取特征,再输入模型进行学习。

深度学习:机器学习子类。通过训练海量数据得到的模型来解决人工智能特定问题。

机器学习和深度学习的区别:深度学习可以自动提取特征,机器学习需要手动提取特征。

3.深度学习三大核心要素

数据、算法、算力

数据->使用对应的算法->给到算力(GPU服务器)

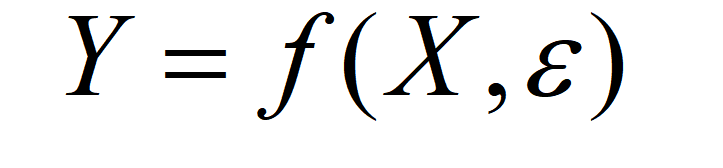

4.回归分析

回归分析是确定两种或者两种以上变量建相互依赖定量关系的一种统计分析方法。可以用以下公式表示:

回归分析实战:

5.人工智能的实际应用

1.人脸识别

2.影像识别

3.语音识别

4.对话机器人

5.自动驾驶

第二章 神经网络基础

1.三种常见神经网络模型-MP神经元模型

首个模拟生物神经元的结构和工作原理构造出的一个数学模型。

MP工作步骤:

(1).接受n个输入

(2).将输入与权值参数加权求和然后经过激活函数激活

(3).将激活结果作为结果输出

参数是人为设定的。

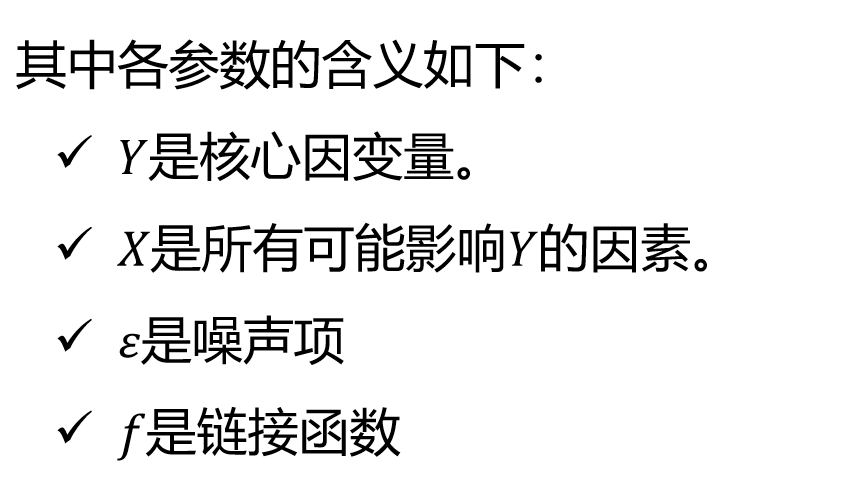

2.三种常见神经网络模型-感知机模型

(1).感知机模型旨在建立一个线性超平面用来解决线性可分问题

(2).局限性:仅对线性问题有分类能力。

(3).感知机运行原理

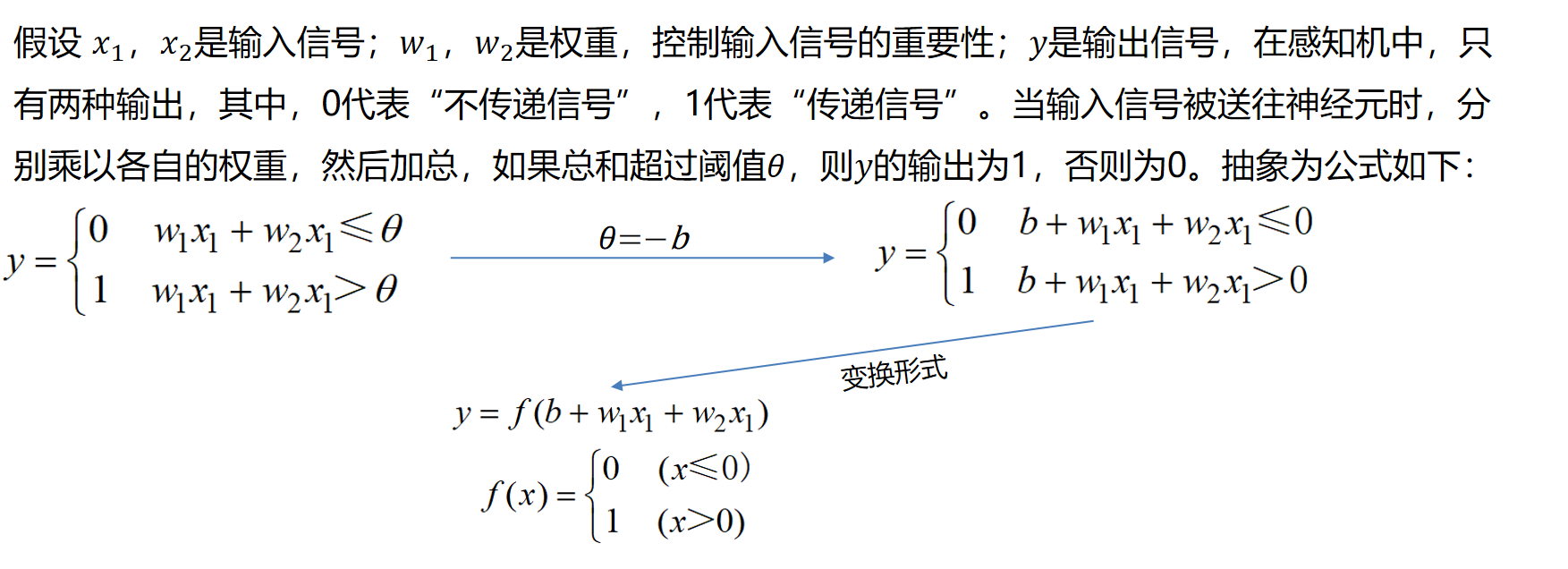

3.三种常见神经网络模型-多层感知机模型

(1).就是在输入层和输出层之间加了若干隐藏层。

(2).图层计算:不计算输入层,从输入层的下一层开始计算,如上图层数为2.

(3).隐藏层的参数:权重参数,偏置参数

(4).全连接的简单理解,就是本层对下一层的每个神经元都有箭头。

4.人工神经网络的考虑点

网络拓扑结构,学习算法,神经元激活规则。

5.激活函数

(1).激活函数就是非线性变换

(2).常用的激活函数

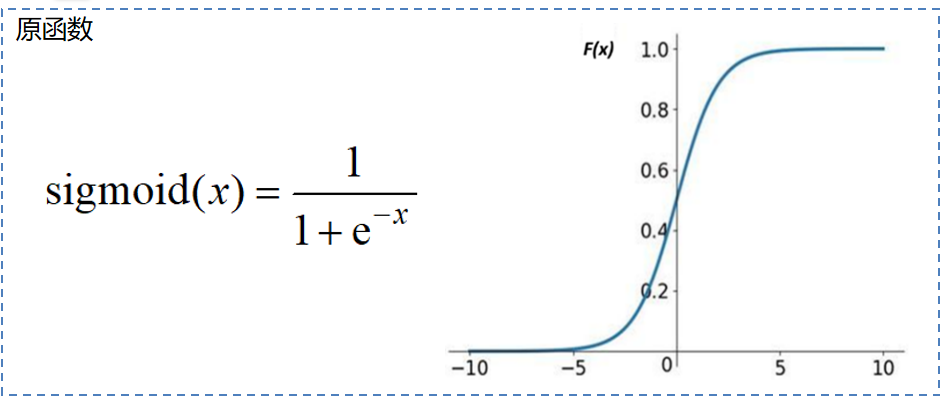

[1].sigmoid激活函数

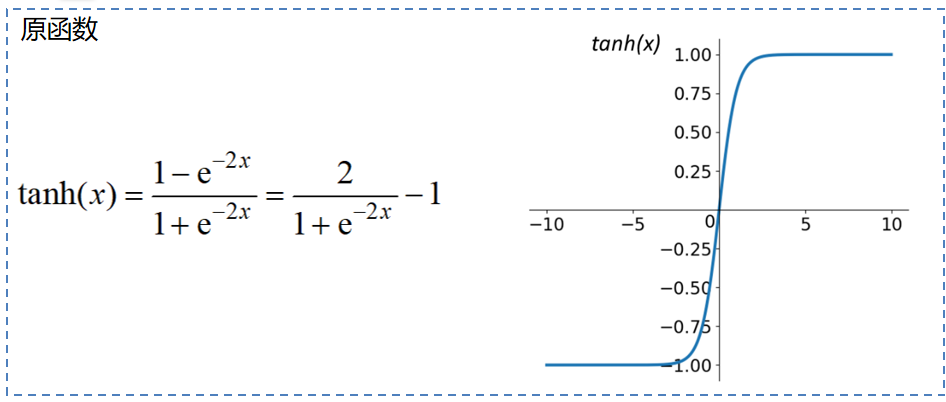

[2].tanh函数

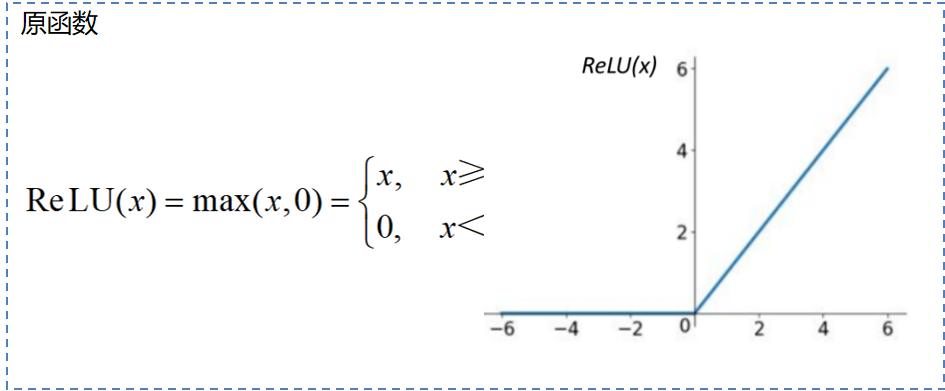

[3].ReLu激活函数

其他激活函数:各种带LU的,不带LU的只有softplus和softsign

6.神经网络的训练流程

(1).初始化

(2).切分batch

(3).前向传播

(4).建立损失函数

(5).反向传播

7.前馈神经网络

简单来说就是

(1).神经元分层,层内无连接,层外全部连接

(2).无反馈,可用有向无环图表示。

8.前向传播与反向传播

前向传播:神经网络向前计算

由于作图比较麻烦,小编就在这里说一下思路和步骤了 如下图所示:

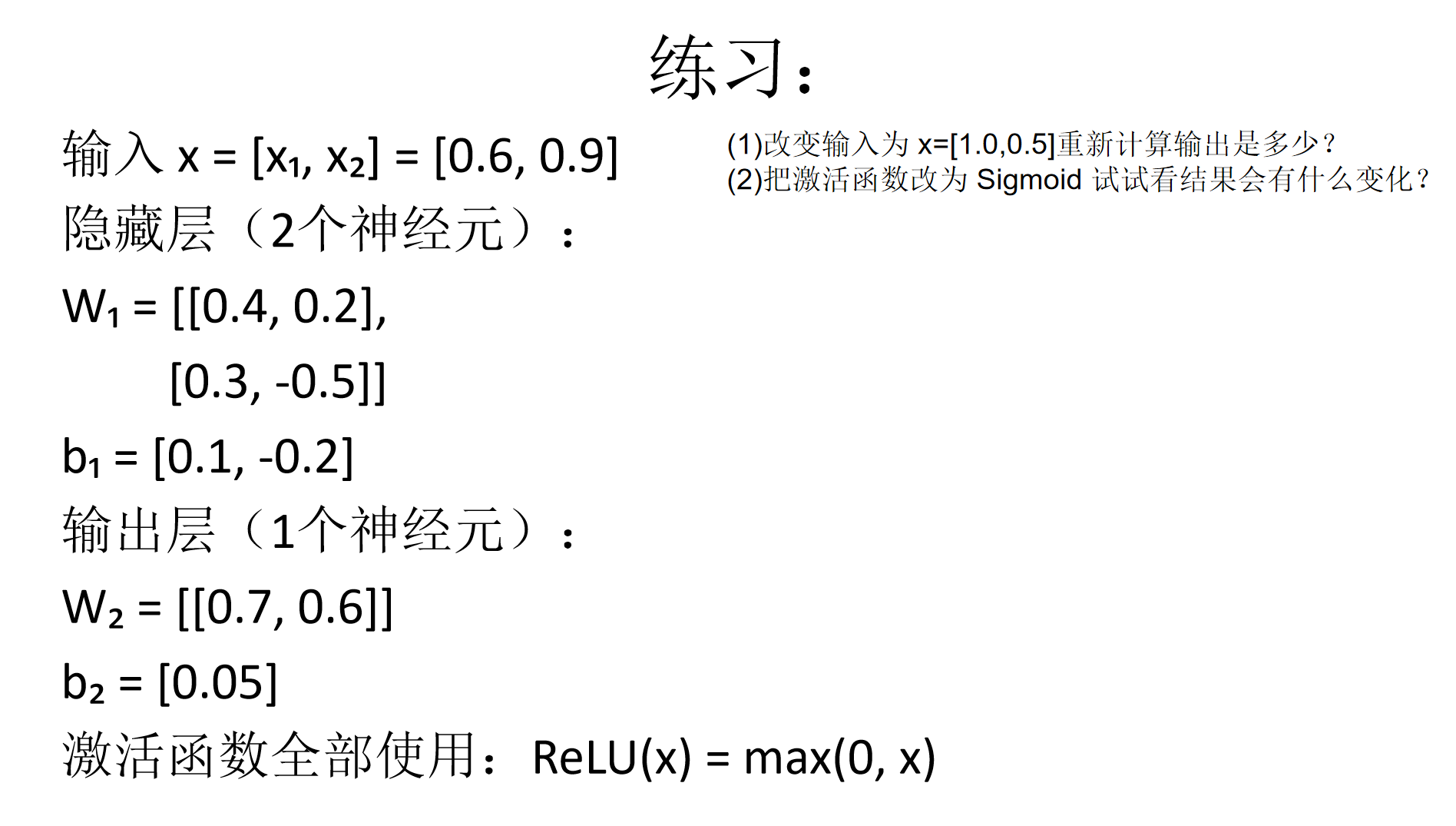

输入层 隐藏层 输出层

x1(0.6) 神经元1(0.4,0.2)(偏置为0.1) res1

w2(0.7,0.6)(偏置为0.05)

x2(0.9) 神经元2(0.3,-0.5)(偏置为-0.2) res2

res1 = 0.6*0.4+0.9*0.2+0.1=

res2 = 0.6*0.3+0.9*-0.5-0.2=

激活函数(res1)

激活函数(res2)

res3 = 0.7*res1+0.6*res2+0.05

最终结果:激活函数(res3)反向传播:神经网络向后计算

9.损失函数和梯度下降

(1).损失函数:真实值和预测值之间的距离

常用损失函数:

均方误差-解决回归问题

交叉熵误差-解决分类问题

(2).梯度下降:

小编速记小诀窍:

Adam:常用首选,什么场景都使用

RMSprop:因为带R,可以记为和RNN有关,适合时序任务

Adagrad:对系数特征处理好

SGD+Momentum:有加号,可以记住加速收敛。

Adam优点:

(1).同情况下,占用内存更少

(2).超参数稳定,适用于大规模数据训练场景。

(3).对梯度噪声有很大容忍度

10.过拟合以及处理方法

(1).过拟合:在模型训练过程中,模型对训练数据学习过度,将数据中包含的噪声和误差也学了。使得模型在数据集上表现良好,在测试集上表现很差。

(2).处理方法:

[1].正则化:在损失函数中加入正则化项惩罚(L1正则化不可导L2可导)

[2].Dropout方法:将某一层数据随机丢失一部分

第三章 卷积神经网络基础

1.全连接前馈神经网络

(1).权重矩阵参数非常多

(2).局部不变性

2.卷积神经网络

(1).是一种前馈神经网络,不是前馈也不能反复提!

(2).基于感受野机制提出的,主要用于图像处理

(3).卷积神经网络三个结构上特性:局部连接、权重共享、空间或者时间上的次采样

(4).基本结构

输入层:输入图像

卷积层:提取特征

池化层:防止过拟合,减少维度

全连接层:汇总卷积层和池化层

输出层:得到概率最大的结果

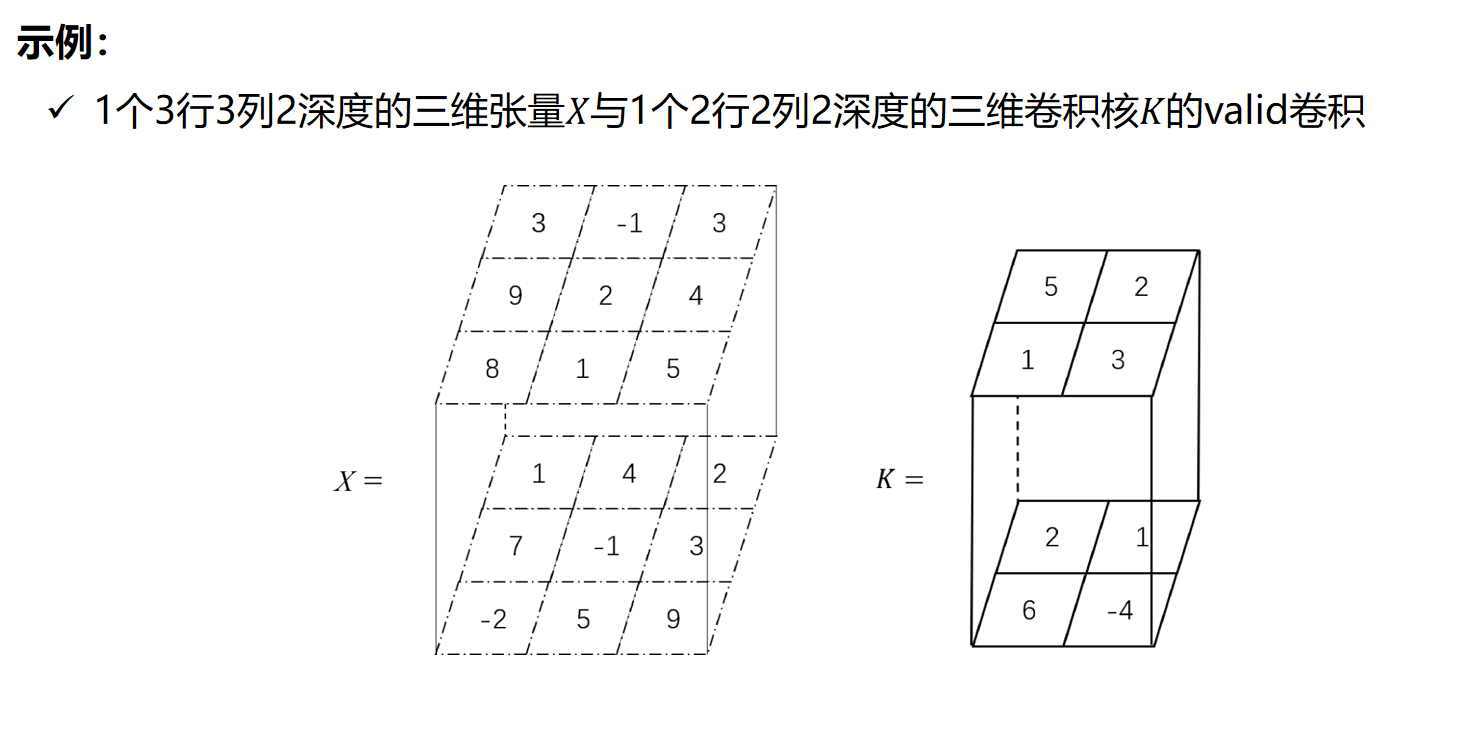

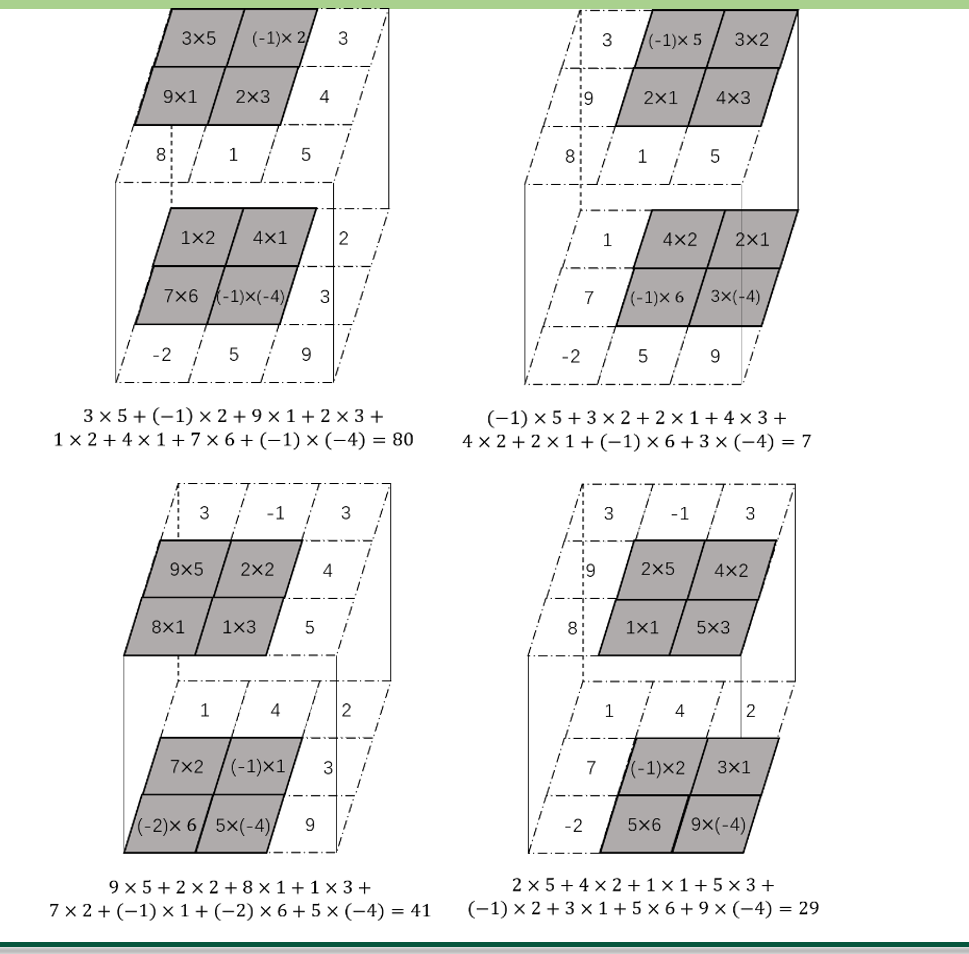

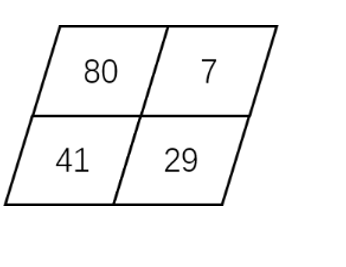

3.卷积计算

(1).full卷积:只要有一个重叠就要计算

(2).same卷积:中心重叠才计算

(3).valid卷积:全在里面才计算

注意:多通道卷积是求和

卷积运算特点:稀疏连接、参数共享、平移不变性

4.如何增加感受野

(1).增加卷积核大小

(2).增加层数

(3).卷积核之前汇聚

感受野计算:前一个感受野+(k-1)*上一个sl

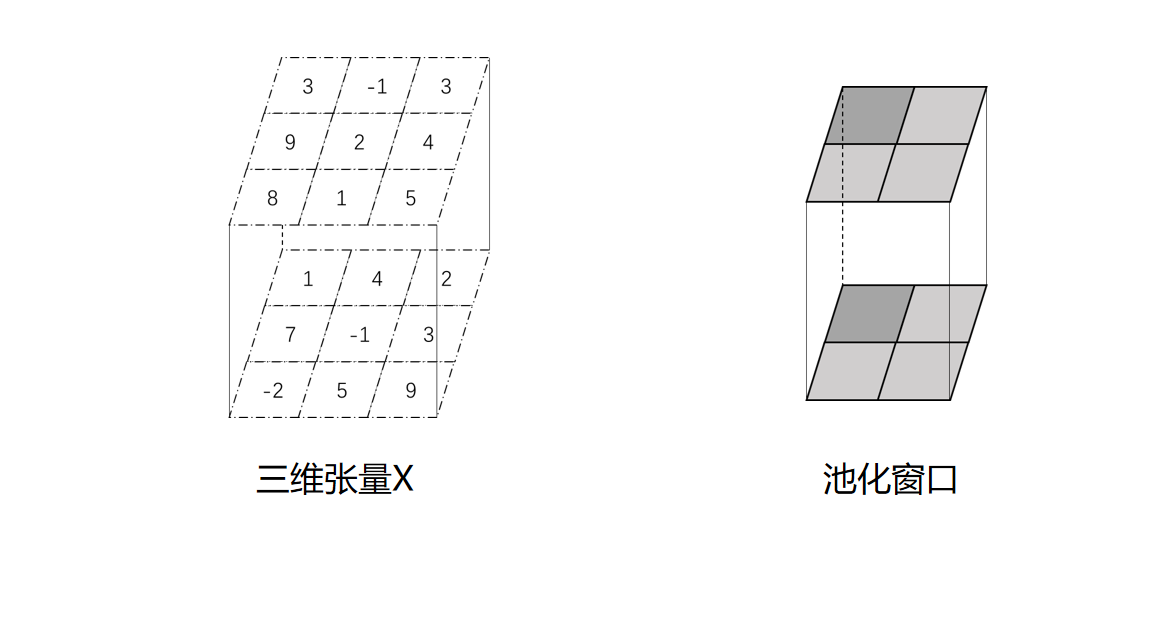

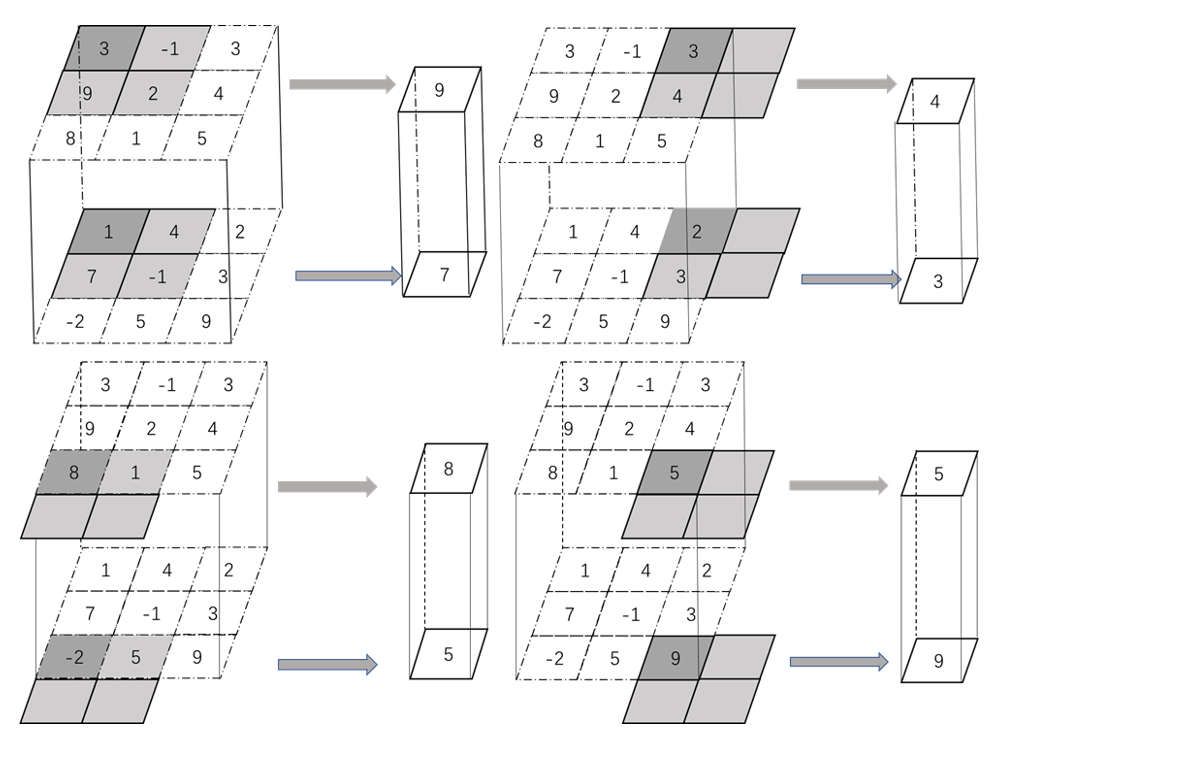

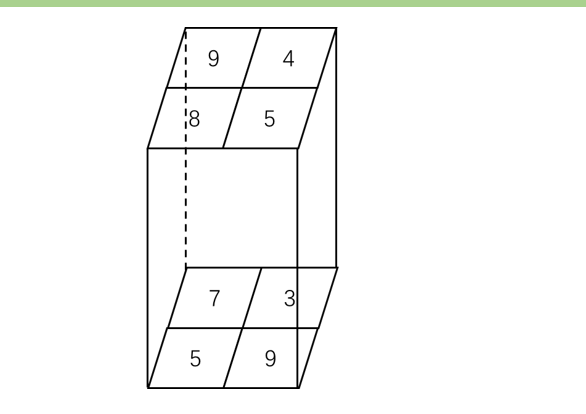

5.池化计算

池化分为最大值池化和平均值池化

卷积有三种,分别为full,same.valid但是池化只有same和valid

(1).same,valid池化

原则和卷积一样

多通道要注意,不是加和了是两个都保留

第四章 循环神经网络基础

1.循环神经网络(RNN)

RNN是一类扩展的人工神经网络。它是为了对序列数据进行建模而产生的。

2.简单循环网络(SRN)

SRN考虑了时序信息,就是和前后时间有关

3.双向循环网络:结合时间分别从起点和点进行训练

4.参数训练方法:BPTT(随时间反向传播算法)

5.长程依赖问题:

长程依赖会导致梯度消失或者梯度爆炸

解决方案:

梯度消失:改进模型

梯度爆炸:梯度截断,权重衰减。

6.LSTM

结构:遗忘门、输入门、输出门

7.门控循环单元网络(GRU)

结构:更新们,重置门

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)