【完整源码+数据集+部署教程】电池柱状态检测系统源码和数据集:改进yolo11-TADDH

【完整源码+数据集+部署教程】电池柱状态检测系统源码和数据集:改进yolo11-TADDH

背景意义

研究背景与意义

随着可再生能源的快速发展,电池储能系统在现代电力系统中扮演着越来越重要的角色。电池柱作为电池储能系统的核心组件,其状态的实时监测与评估对于保障系统的安全性和可靠性至关重要。然而,传统的电池柱状态检测方法往往依赖人工检查,效率低下且容易受到人为因素的影响,难以满足现代工业对高效、准确监测的需求。因此,开发一种基于计算机视觉的自动化检测系统显得尤为重要。

在这一背景下,基于改进YOLOv11的电池柱状态检测系统应运而生。YOLO(You Only Look Once)系列模型以其快速的检测速度和高精度的特点,成为目标检测领域的热门选择。通过对YOLOv11进行改进,结合电池柱的特定特征,可以有效提升检测的准确性和实时性。我们将利用包含3122张图像的In-Line Post Training Data v1数据集,该数据集经过精心标注,涵盖了“Bad Post”和“Good Post”两类状态,为模型的训练提供了丰富的样本。

本研究的意义在于,通过引入先进的深度学习技术,构建一个高效的电池柱状态检测系统,不仅可以提高检测的自动化水平,还能大幅降低人工成本和潜在的安全隐患。此外,系统的成功实施将为电池储能行业的智能化发展提供有力支持,推动相关技术的应用与普及。通过不断优化和迭代模型,我们期望能够在未来实现更高的检测精度和更广泛的应用场景,为电池管理系统的智能化升级贡献力量。

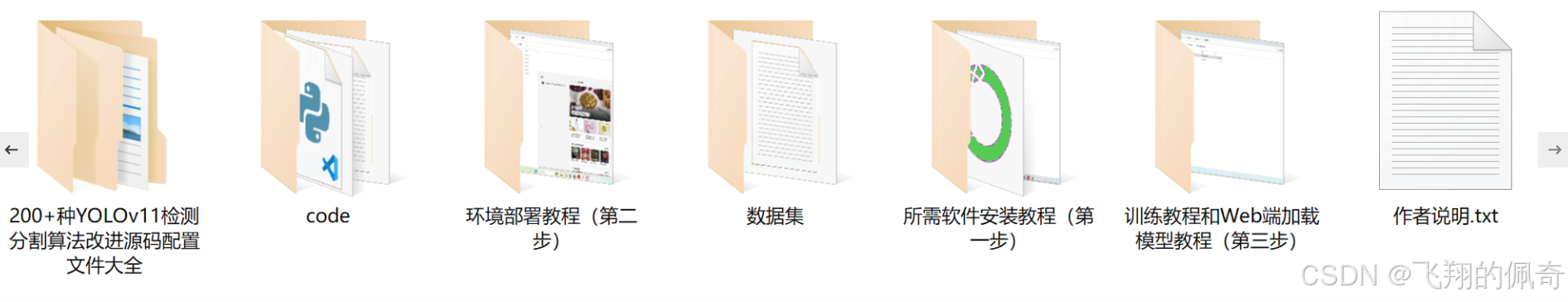

图片效果

数据集信息

本项目数据集信息介绍

本项目所使用的数据集名为“In-Line Post Training Data v1”,旨在为改进YOLOv11的电池柱状态检测系统提供高质量的训练数据。该数据集专注于电池柱的状态识别,涵盖了两种主要类别:‘Bad Post’和’Good Post’。通过对这两类数据的深入分析和学习,模型能够有效地识别电池柱的良好状态与不良状态,从而提升电池管理系统的智能化水平。

数据集的构建过程中,采集了大量的电池柱图像,确保了样本的多样性和代表性。每个类别的图像均经过精心标注,确保模型在训练过程中能够准确学习到每种状态的特征。'Bad Post’类别包含了各种可能导致电池柱失效的情况,例如腐蚀、物理损伤或连接不良等;而’Good Post’类别则展示了电池柱在最佳工作状态下的外观特征。这种明确的分类使得模型在面对实际应用时,能够迅速而准确地做出判断。

此外,为了增强模型的泛化能力,数据集中还包含了不同环境条件下拍摄的图像,如不同的光照、角度和背景。这种多样化的训练数据不仅提高了模型的鲁棒性,也为其在实际应用中的适应性打下了坚实的基础。通过对“In-Line Post Training Data v1”数据集的充分利用,本项目期望能够显著提升YOLOv11在电池柱状态检测中的准确性和效率,为电池管理系统的智能化发展贡献力量。

核心代码

以下是代码中最核心的部分,并附上详细的中文注释:

import torch

import torch.nn.functional as F

def build_selective_scan_fn(selective_scan_cuda: object = None, mode=“mamba_ssm”, tag=None):

“”"

构建选择性扫描函数,返回一个自定义的 PyTorch 函数。

参数:

selective_scan_cuda: CUDA 实现的选择性扫描函数

mode: 模式选择

tag: 标签,用于表示不同的实现

"""

class SelectiveScanFn(torch.autograd.Function):

@staticmethod

def forward(ctx, u, delta, A, B, C, D=None, z=None, delta_bias=None, delta_softplus=False, return_last_state=False, nrows=1, backnrows=-1):

"""

前向传播函数,执行选择性扫描操作。

参数:

ctx: 上下文对象,用于保存信息以便反向传播

u: 输入张量

delta: 变化率张量

A, B, C: 权重张量

D: 可选的额外张量

z: 可选的张量

delta_bias: 可选的偏置

delta_softplus: 是否使用 softplus 激活

return_last_state: 是否返回最后的状态

nrows: 行数

backnrows: 反向传播的行数

返回:

输出张量或输出和最后状态的元组

"""

# 确保输入张量是连续的

if u.stride(-1) != 1:

u = u.contiguous()

if delta.stride(-1) != 1:

delta = delta.contiguous()

if D is not None:

D = D.contiguous()

if B.stride(-1) != 1:

B = B.contiguous()

if C.stride(-1) != 1:

C = C.contiguous()

if z is not None and z.stride(-1) != 1:

z = z.contiguous()

# 处理 B 和 C 的维度

if B.dim() == 3:

B = rearrange(B, "b dstate l -> b 1 dstate l")

ctx.squeeze_B = True

if C.dim() == 3:

C = rearrange(C, "b dstate l -> b 1 dstate l")

ctx.squeeze_C = True

# 确保数据类型为 float

if D is not None and (D.dtype != torch.float):

ctx._d_dtype = D.dtype

D = D.float()

if delta_bias is not None and (delta_bias.dtype != torch.float):

ctx._delta_bias_dtype = delta_bias.dtype

delta_bias = delta_bias.float()

# 进行选择性扫描的核心操作

if mode == "mamba_ssm":

out, x, *rest = selective_scan_cuda.fwd(u, delta, A, B, C, D, z, delta_bias, delta_softplus)

else:

raise NotImplementedError("未实现的模式")

# 保存上下文以便反向传播

ctx.save_for_backward(u, delta, A, B, C, D, delta_bias, x)

last_state = x[:, :, -1, 1::2] # 获取最后状态

return out if not return_last_state else (out, last_state)

@staticmethod

def backward(ctx, dout):

"""

反向传播函数,计算梯度。

参数:

ctx: 上下文对象

dout: 输出的梯度

返回:

输入张量的梯度

"""

u, delta, A, B, C, D, delta_bias, x = ctx.saved_tensors

# 计算梯度

du, ddelta, dA, dB, dC, dD, ddelta_bias = selective_scan_cuda.bwd(u, delta, A, B, C, D, delta_bias, dout, x)

return (du, ddelta, dA, dB, dC, dD if D is not None else None, ddelta_bias if delta_bias is not None else None)

def selective_scan_fn(u, delta, A, B, C, D=None, z=None, delta_bias=None, delta_softplus=False, return_last_state=False, nrows=1, backnrows=-1):

"""

包装选择性扫描函数的调用。

"""

return SelectiveScanFn.apply(u, delta, A, B, C, D, z, delta_bias, delta_softplus, return_last_state, nrows, backnrows)

return selective_scan_fn

代码说明:

导入必要的库:使用 PyTorch 和其功能模块。

build_selective_scan_fn 函数:构建一个选择性扫描函数的工厂函数,返回一个自定义的 PyTorch 函数。

SelectiveScanFn 类:继承自 torch.autograd.Function,实现了前向传播和反向传播的逻辑。

forward 方法:执行选择性扫描的前向计算,处理输入数据的维度和类型,并调用 CUDA 实现的前向函数。

backward 方法:计算梯度,调用 CUDA 实现的反向函数。

selective_scan_fn 函数:包装前向传播的调用,提供简洁的接口。

这个核心部分实现了选择性扫描的前向和反向传播逻辑,是整个代码的关键。

这个程序文件 test_selective_scan_speed.py 是一个用于测试选择性扫描(Selective Scan)操作性能的脚本,主要使用 PyTorch 框架进行深度学习相关的计算。文件中包含了选择性扫描的实现、测试函数以及性能评估的逻辑。

首先,程序导入了必要的库,包括 torch、torch.nn.functional、pytest 和其他一些用于数值计算和性能测试的库。接着,定义了一个 build_selective_scan_fn 函数,这个函数用于构建一个选择性扫描的自定义操作。它使用了 PyTorch 的自动求导功能,通过定义 SelectiveScanFn 类来实现前向和反向传播的逻辑。

在 SelectiveScanFn 类中,forward 方法实现了选择性扫描的前向计算,接受多个输入参数,包括 u、delta、A、B、C、D 等。这个方法会根据不同的模式(如 “mamba_ssm”、“sscore” 等)调用相应的 CUDA 后端实现进行计算。方法中还处理了输入的维度和数据类型,确保输入张量是连续的,并根据需要进行维度调整。

backward 方法则实现了反向传播的逻辑,计算梯度并返回相应的梯度信息。这个方法同样会根据不同的模式调用 CUDA 后端实现。

接下来,定义了 selective_scan_ref 函数,这是一个参考实现,用于计算选择性扫描的结果,主要用于与自定义实现进行性能比较。这个函数使用了张量操作和循环来实现选择性扫描的逻辑,处理了输入的各种情况。

此外,程序还定义了 selective_scan_easy 和 selective_scan_easy_v2 函数,这两个函数是选择性扫描的简化实现,使用了不同的策略来处理输入数据,提供了更易用的接口。

在文件的最后,定义了 test_speed 函数,该函数用于测试不同选择性扫描实现的性能。它设置了一些参数,如批量大小、序列长度、维度等,并生成随机输入数据。然后,它通过多次调用不同的选择性扫描实现来测量其执行时间,并打印出每个实现的性能结果。

总的来说,这个程序文件实现了选择性扫描的多种版本,并通过性能测试来评估不同实现的效率,适用于需要高效计算的深度学习任务。

10.4 utils.py

以下是经过简化和注释的核心代码部分:

import torch

import torch.nn.functional as F

def inverse_sigmoid(x, eps=1e-5):

“”"

计算张量的反sigmoid函数。

参数:

x (torch.Tensor): 输入张量,值应在[0, 1]范围内。

eps (float): 防止除零的极小值,默认为1e-5。

返回:

torch.Tensor: 反sigmoid计算结果。

"""

# 限制x的范围在0到1之间

x = x.clamp(min=0, max=1)

# 对x进行处理,确保不为零

x1 = x.clamp(min=eps) # x的下限为eps

x2 = (1 - x).clamp(min=eps) # 1-x的下限为eps

# 计算反sigmoid值

return torch.log(x1 / x2)

def multi_scale_deformable_attn_pytorch(

value: torch.Tensor,

value_spatial_shapes: torch.Tensor,

sampling_locations: torch.Tensor,

attention_weights: torch.Tensor,

) -> torch.Tensor:

“”"

多尺度可变形注意力机制。

参数:

value (torch.Tensor): 输入特征张量,形状为 (batch_size, num_channels, num_heads, embed_dims)。

value_spatial_shapes (torch.Tensor): 特征图的空间形状。

sampling_locations (torch.Tensor): 采样位置,形状为 (batch_size, num_queries, num_heads, num_levels, num_points, 2)。

attention_weights (torch.Tensor): 注意力权重,形状为 (batch_size, num_heads, num_queries, num_levels, num_points)。

返回:

torch.Tensor: 输出特征张量,形状为 (batch_size, num_queries, num_heads * embed_dims)。

"""

bs, _, num_heads, embed_dims = value.shape # 获取输入张量的维度

_, num_queries, _, num_levels, num_points, _ = sampling_locations.shape # 获取采样位置的维度

# 将输入特征张量按空间形状分割成多个特征图

value_list = value.split([H_ * W_ for H_, W_ in value_spatial_shapes], dim=1)

# 将采样位置转换到[-1, 1]范围

sampling_grids = 2 * sampling_locations - 1

sampling_value_list = []

for level, (H_, W_) in enumerate(value_spatial_shapes):

# 处理每个尺度的特征图

value_l_ = value_list[level].flatten(2).transpose(1, 2).reshape(bs * num_heads, embed_dims, H_, W_)

sampling_grid_l_ = sampling_grids[:, :, :, level].transpose(1, 2).flatten(0, 1)

# 使用grid_sample进行双线性插值采样

sampling_value_l_ = F.grid_sample(

value_l_, sampling_grid_l_, mode="bilinear", padding_mode="zeros", align_corners=False

)

sampling_value_list.append(sampling_value_l_)

# 处理注意力权重

attention_weights = attention_weights.transpose(1, 2).reshape(

bs * num_heads, 1, num_queries, num_levels * num_points

)

# 计算最终输出

output = (

(torch.stack(sampling_value_list, dim=-2).flatten(-2) * attention_weights)

.sum(-1)

.view(bs, num_heads * embed_dims, num_queries)

)

return output.transpose(1, 2).contiguous() # 返回输出,调整维度顺序

代码注释说明:

inverse_sigmoid函数:计算反sigmoid值,确保输入在合理范围内,并避免除零错误。

multi_scale_deformable_attn_pytorch函数:实现多尺度可变形注意力机制,处理输入特征图,采样位置和注意力权重,返回加权后的输出特征。主要步骤包括特征图分割、采样位置转换、双线性插值采样和最终输出计算。

这个程序文件 utils.py 是一个用于实现多种深度学习工具函数的模块,主要与 PyTorch 框架相关,特别是在计算机视觉和目标检测任务中使用的 YOLO(You Only Look Once)模型。以下是对代码的逐行解释。

首先,文件导入了一些必要的库,包括 copy、math、numpy 和 torch 及其子模块。torch.nn 和 torch.nn.functional 提供了神经网络构建和操作的功能。

接下来,定义了一个 all 列表,指定了模块公开的接口,表示该模块将提供 multi_scale_deformable_attn_pytorch 和 inverse_sigmoid 这两个函数。

_get_clones 函数用于克隆给定的模块 module,返回一个包含 n 个克隆模块的 ModuleList。这在构建具有相同结构的多个层时非常有用。

bias_init_with_prob 函数根据给定的先验概率 prior_prob 初始化卷积或全连接层的偏置值。该函数使用了对数几率的计算,返回一个浮点数作为偏置的初始化值。

linear_init 函数用于初始化线性模块的权重和偏置。它根据权重的形状计算一个边界值,并使用均匀分布在该范围内初始化权重和偏置。

inverse_sigmoid 函数计算张量的反 sigmoid 函数。它首先将输入张量 x 限制在 [0, 1] 范围内,然后通过对数运算计算反 sigmoid 值。这个函数在一些特定的模型训练中可能会用到。

multi_scale_deformable_attn_pytorch 函数实现了多尺度可变形注意力机制。该函数的输入包括值张量 value、空间形状 value_spatial_shapes、采样位置 sampling_locations 和注意力权重 attention_weights。函数首先提取输入张量的维度信息,然后将值张量按照空间形状进行分割,得到不同尺度的特征图。

接着,函数计算采样网格,并使用 F.grid_sample 函数从特征图中根据采样位置提取特征。这个过程是通过双线性插值实现的,能够有效地处理不同尺度和位置的特征。

最后,函数将采样得到的特征与注意力权重相乘并求和,得到最终的输出。输出的形状经过调整,以便于后续的处理。

总体来说,这个模块提供了一些基础的工具函数,特别是针对多尺度注意力机制的实现,为 YOLO 模型的训练和推理提供了支持。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式👇🏻

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献145条内容

已为社区贡献145条内容

所有评论(0)