Opik:从调试黑洞到透明可控:这款开源工具让 LLM 应用开发效率提升 300%

做LLM应用就像在黑屋子里修灯,Opik不是直接给你换灯泡,而是先打开手电筒照亮整个房间。它不替代开发者的判断,却能提供前所未有的清晰度。聊聊看:你开发LLM应用时,最头疼的评估难题是什么?

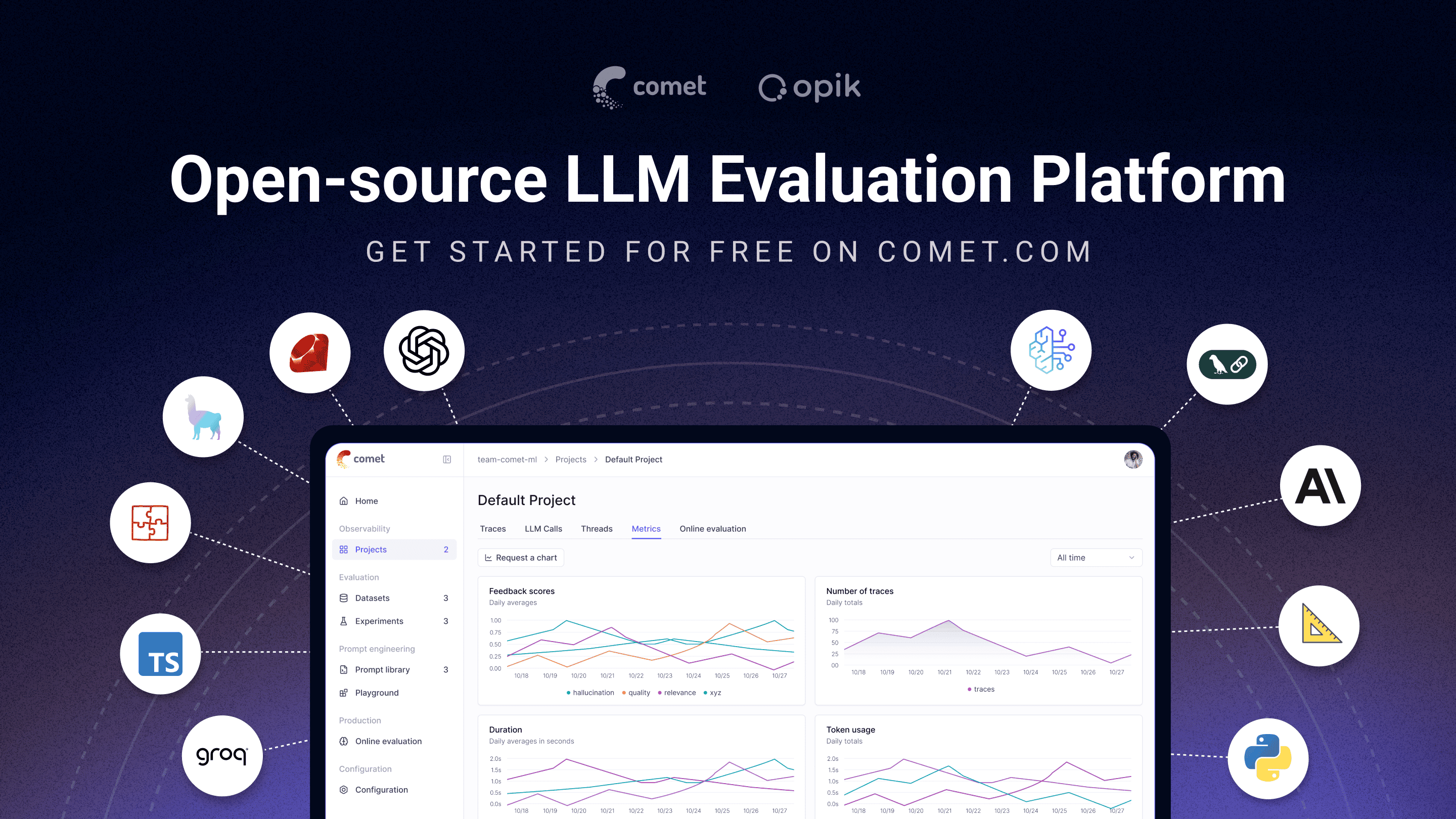

当你还在为LLM应用的评估报告焦头烂额时,有人已经用Opik搭建起了全套监控系统——从对话追踪到幻觉检测,甚至能自动生成优化建议。这个被称为"LLM开发者瑞士军刀"的开源项目,正在悄悄改变大模型应用的开发范式。

项目地址:https://github.com/comet-ml/opik

欢迎大家关注我的公众号:大模型论文研习社

往期回顾:大模型也会 “脑补” 了!Mirage 框架解锁多模态推理新范式,无需生成像素图性能还暴涨

欢迎大家体验我的小程序:王哥儿LLM刷题宝典,里面有大模型相关面经,正在持续更新中

为什么你的LLM应用需要Opik?

想象一下:你花两周开发的RAG聊天机器人上线了,用户反馈"回答总跑偏",但你对着代码日志毫无头绪——这正是Opik要解决的核心问题。作为Comet推出的开源LLM评估平台,它就像给大模型应用装上了"黑匣子",能精准记录每次交互的全链路数据。

其杀手锏在于三大能力:

- 全链路追踪:自动记录LLM调用、工具调用、对话历史,连token消耗都精确到个位数

- 智能评估系统:内置20+评估指标,从相关性到幻觉检测一键生成评分

- 生产级监控:支持每日4000万+追踪数据,异常波动实时告警

更妙的是它兼容主流框架:LangChain、Autogen、Google ADK这些热门工具都能无缝衔接,甚至连Cursor编辑器都有专用插件。

5分钟上手的两种姿势

姿势一:零代码云部署(推荐新手)

- 访问comet.com注册免费账号,一键启用Opik服务

- 安装Python SDK:

pip install opik - 初始化代码只需三行:

from opik import Opik

opik = Opik(project_name="我的LLM项目")

opik.start() # 从此刻开始自动追踪所有LLM交互

姿势二:本地部署(适合隐私敏感场景)

用官方脚本一键启动Docker集群:

curl -sSL https://raw.githubusercontent.com/comet-ml/opik/main/opik.sh | bash

部署完成后,访问localhost:3000就能看到监控面板,所有数据都跑在你的服务器上。

三个让老板惊艳的功能

1. 幻觉自动检测

上传知识库后,Opik会用大模型当"裁判",自动标记那些"一本正经胡说八道"的回答。某电商团队用它把客服机器人的错误率从17%降到了3%。

2. 智能优化建议

系统会分析高频失败案例,给出具体改进方案。比如检测到"用户问退款政策时回答混乱",会建议优化提示词结构,甚至生成参考模板。

3. CI/CD无缝集成

把评估指标接入GitHub Actions,每次提交代码自动运行测试。某AI创业公司借此实现"代码提交即评估报告生成",上线周期缩短60%。

谁在用Opik?

目前已有超过2000个团队接入,涵盖电商客服、医疗咨询、代码助手等场景。值得注意的是,它完全开源可商用,企业级功能也无需付费——这也是为什么国内多家大厂在内部镜像部署。

社区还在快速迭代,最近刚发布的v1.2版本新增了多模态支持,能评估图像生成效果;接下来计划加入RAG检索优化模块,自动调整向量数据库参数。

最后说句掏心窝的话

做LLM应用就像在黑屋子里修灯,Opik不是直接给你换灯泡,而是先打开手电筒照亮整个房间。它不替代开发者的判断,却能提供前所未有的清晰度。

聊聊看:你开发LLM应用时,最头疼的评估难题是什么?

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)