DeepSeek Engram:当暴力美学撞上“作弊小抄”,大模型的记忆手术

DeepSeek 再次抛出重磅炸弹:Engram 架构。这不只是一个新的模型参数(27B),而是一种对 Transformer 底层逻辑的“外科手术”。它指出大模型 70% 的参数都在“死记硬背”事实,极其浪费。Engram 的核心是“条件记忆(Conditional Memory)”,复活了古老的 N-gram 技术,把死知识从昂贵的 GPU 计算中剥离,扔进廉价的内存(RAM)里查表。这不仅是

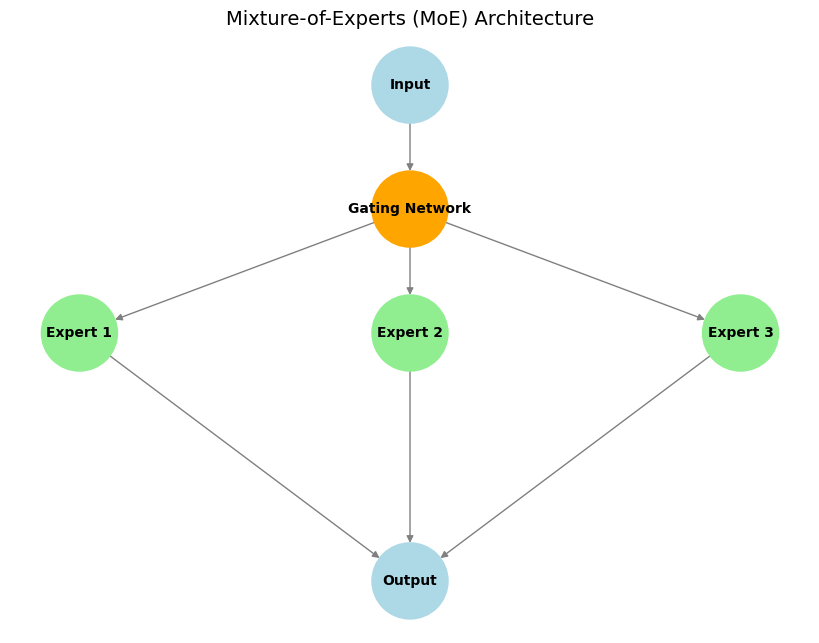

这张MoE架构图展示了当前的主流方案,而Engram则是在此基础上,把原本属于专家的“死知识”直接抽离成了字典。

DeepSeek 的 Github 页面在 2026 年初的某个清晨悄然更新了一个 repo:deepseek-ai/Engram。

没有发布会,没有 CEO 的高谈阔论,只有一行代码冷冷地躺在 README 里:pip install torch ...。

我翻看了这份技术报告,第一反应是:这帮工程师是把 Transformer 的脑壳撬开,把里面的海马体(负责记忆的区域)给切了,然后塞进去了一本牛津大字典。

这听起来很疯狂?不,这可能是过去两年里,AI 架构领域最“反直觉”也最“性感”的一次降维打击。

1. 深度洞察:大模型一直在“假装思考”

如果要用一句话概括 Engram 的核心,那就是:别用爱因斯坦的大脑去背九九乘法表。

现在的 Transformer 架构(包括 GPT-4、Claude 3、DeepSeek V3)其实很笨重。它们把“推理能力”(Reasoning,比如逻辑推导、代码生成)和“知识记忆”(Knowledge,比如谁是美国总统、Python 的语法糖)全部混在了一起,都存在神经网络的权重(Weights)里。

这就导致了一个巨大的浪费:当你问 AI “1+1 等于几”时,它不是在“算”,而是在巨大的参数海洋里“检索”这个模式。为了记住这一堆琐碎的事实,我们不得不把模型越做越大,显卡越买越多。

DeepSeek 的 Engram 做了什么?

它复活了上个世纪自然语言处理(NLP)的老古董——N-gram。

你在报告里看到的“Conditional Memory via Scalable Lookup”(通过可扩展查找实现的条件记忆),翻译成人话就是:

把那些不需要逻辑推理的“死知识”,从昂贵的神经元网络里剥离出来,存成一个巨大的、静态的 N-gram 查找表。

当模型需要知道“巴黎的首都是哪里”时,它不再需要动用昂贵的 GPU 算力去跑几百层神经网络,而是直接去查那个挂在内存(RAM)里的“小抄本”。

这事儿其实挺讽刺的。 我们花了几千亿美元搞深度学习,试图模拟人脑的模糊计算,结果回头一看,最高效的记忆方式,居然还是那个最原始的“字典”。

2. 独立视角:显存霸权的终结者?

大家可能没注意到报告里最不起眼、但最致命的一句话:

“The module employs deterministic addressing, enabling the offloading of massive embedding tables to host memory with minimal inference overhead.”

(该模块采用确定性寻址,允许将海量嵌入表卸载到主机内存,推理开销极小。)

这句简直是“掀桌子”的宣言。

在这个“显存即正义”的时代,英伟达之所以能卡住全世界的脖子,就是因为大模型太吃显存(VRAM)了。你的模型参数多,显存就要大,H100 就得买。

但 Engram 说:不,你不需要那么大的显存。

因为它把占据大量空间的“记忆部分”扔到了**主机内存(Host Memory / RAM)**里。

- 显存(HBM)多少钱 1GB?几百美金。

- 内存(DDR5)多少钱 1GB?几美金。

- 价差是 100 倍。

这意味着,原本需要 8 张 H100 才能跑起来的超大知识库模型,现在可能只需要一张卡做推理核心,剩下的知识全扔在廉价的 1TB 内存条里。

这也是为什么 DeepSeek 搞出了一个 Engram-27B。在传统的 scaling law 里,27B 的模型通常是“高不成低不就”的尴尬尺寸——要逻辑没逻辑,要知识没知识。但如果这 27B 纯粹是“推理引擎”,而背后挂着一个 500GB 的 N-gram 知识库呢?

那就是一个带着整个图书馆的数学天才。

3. 行业对比:MoE 是“分工”,Engram 是“外包”

为了看懂 DeepSeek 的棋局,我们得把 Engram 和现在的当红炸子鸡 MoE(混合专家模型,如 DeepSeek-V3/Mixtral)做个对比。

- MoE (Compute Sparsity): 就像一家大公司,养了 100 个专家。遇到法律问题叫律师,遇到代码问题叫程序员。大家都在公司里(显存里),随叫随到。虽然干活快,但人头费(参数量)还是得付。

- RAG (Retrieval): 就像是开卷考试。遇到不会的题,临时去翻书(搜索外部数据库)。优点是知识无限,缺点是慢,而且翻书的过程本身也消耗脑力(Context Window)。

- Engram (Memory Sparsity): 这是把基础知识外包。它在模型内部建了一个“直连通道”。它不像 RAG 那样需要重新编码外部文本,而是直接在底层就把 N-gram 向量融合进来了。

硬逻辑评价:

Engram 实际上是在 MoE 的“计算稀疏性”之外,开辟了第二条战线——“记忆稀疏性”。

报告中提到的“U-shaped scaling law”(U型扩展定律)非常关键。它证明了在同样的算力预算(FLOPs)下,把一部分参数换成静态的 N-gram 表,效果反而更好。

这说明,过去的模型真的“太胖了”,虚胖在那些无用的记忆上。

4. 未尽之想:关于未来的几个“鬼故事”

看着 Engram 的架构,我有几个不成熟的设想,甚至可以说是隐忧:

-

“知识幻觉”的硬着陆?

如果记忆变成了查表,那修正 AI 的幻觉(Hallucination)会不会变得异常简单?以前要修正大模型说错的一句话,可能需要重新微调(Fine-tune)整个模型。现在?是不是直接改一下 N-gram 表里的那个词条就行了?这是不是意味着,AI 的记忆可以被更精准地“篡改”和“植入”? -

长文本(Long Context)的伪命题?

现在各家大厂都在卷 100万、1000万 token 的上下文窗口,为了就是让 AI 能“记住”整本书。但如果 Engram 能把书直接变成模型的一部分(即插即用的 N-gram 表),我们还需要那么长的 Context 吗?也许,超长上下文本身就是一种因为记忆机制低效而产生的“过渡性需求”。 -

消费级硬件的复活?

如果 Engram 普及,家里那台 64GB 内存的旧电脑,配上一张普通的 4090,是不是就能运行企业级的知识库模型了?这对于开源社区来说,简直是久旱逢甘霖。

5. 写在最后

DeepSeek 这一波操作,表面上是发布了一个新模型,实际上是在给整个行业“去魅”。

它告诉我们,那个被神话的“神经网络”,其实并不完美,甚至在记忆这件事上,笨拙得像个两百斤的胖子。而解决问题的钥匙,往往不藏在更复杂的算法里,而藏在那些被我们遗忘的故纸堆中——比如几十年前的 N-gram。

科技的螺旋总是这样,当算力撞上墙壁,我们就会回头,在旧日的尘埃里捡起被遗弃的武器,擦亮它,然后轰开新世界的大门。

至于 2026 年的 DeepSeek 还会带来什么?也许,这只是“人造大脑”走向“人造心灵”前的,最后一次硬件减负。

References:

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)