docker一个容器。同时运行多个镜像。compose yml介绍。wsl穿透调用主机docker。

docker一个容器。同时运行多个镜像。compose yml介绍。wsl穿透调用主机docker。

·

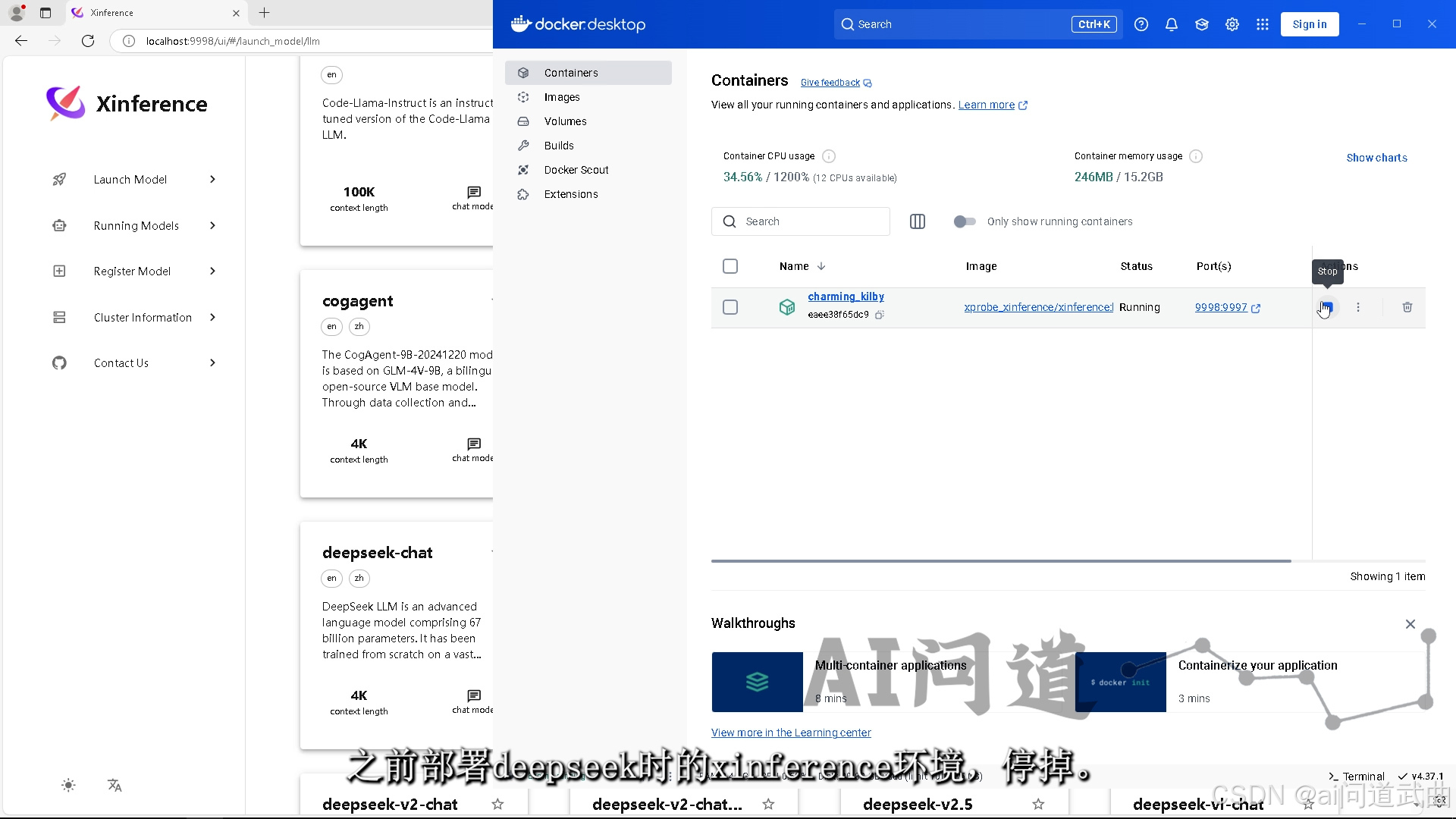

之前部署deepseek时的xinference环境,停掉。 把之前一条命令部署deepseek的命令,

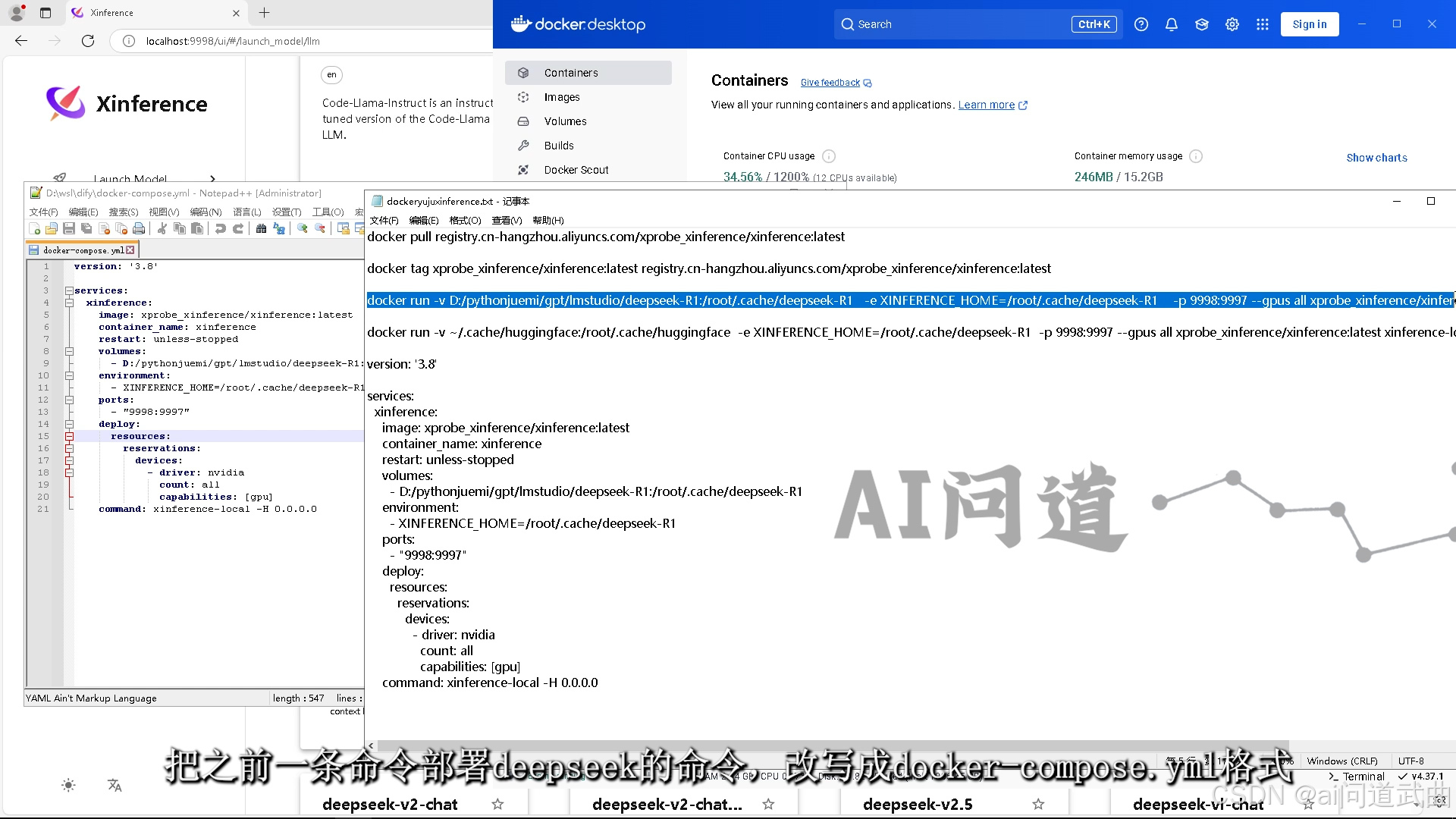

把之前一条命令部署deepseek的命令,

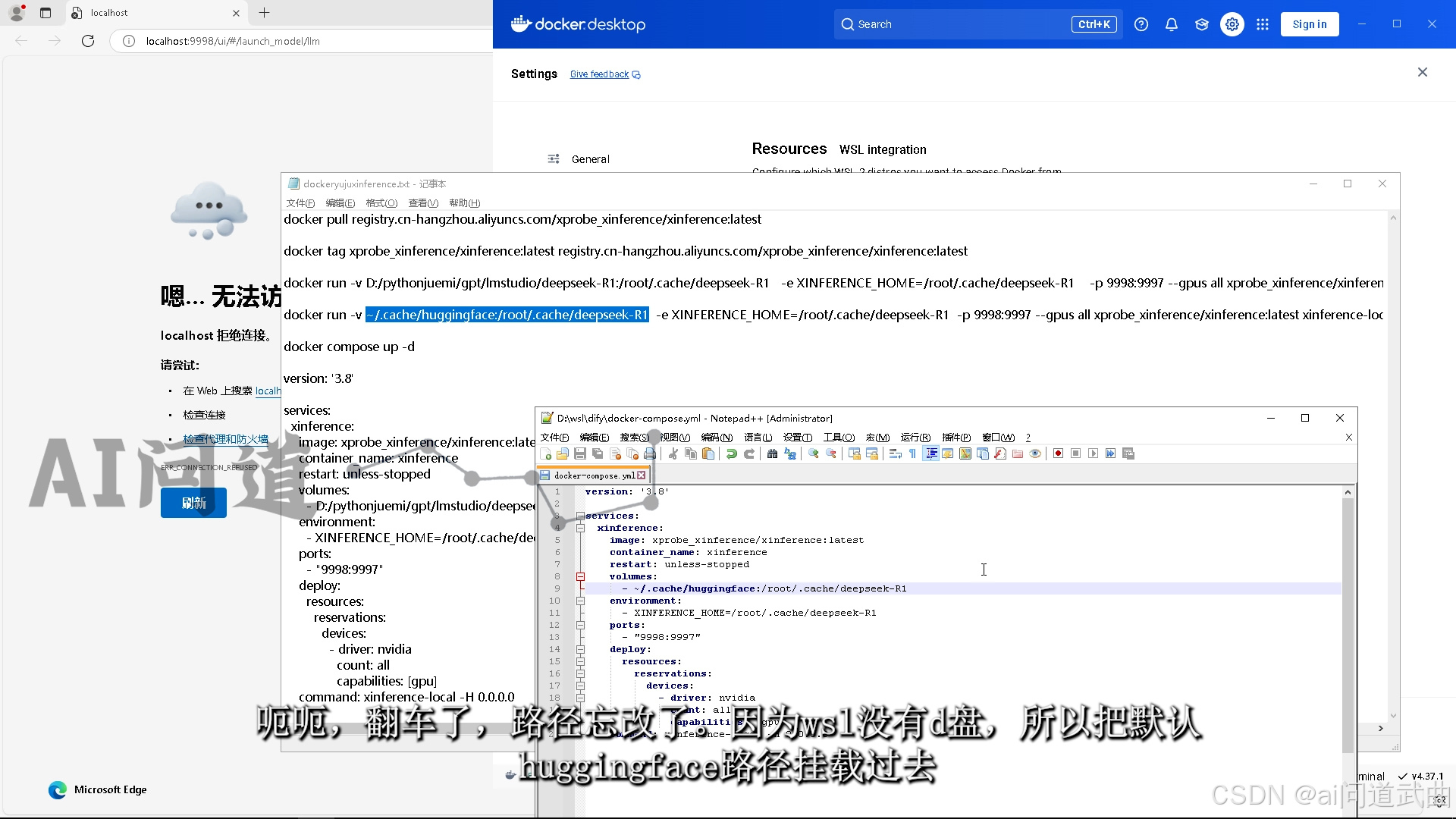

docker run -v D:/pythonjuemi/gpt/lmstudio/deepseek-R1:/root/.cache/deepseek-R1 -e XINFERENCE_HOME=/root/.cache/deepseek-R1 -p 9998:9997 --gpus all xprobe_xinference/xinference:latest xinference-local -H 0.0.0.0改写成docker-compose.yml格式。

version: '3.8'

services:

xinference:

image: xprobe_xinference/xinference:latest

container_name: xinference

restart: unless-stopped

volumes:

- D:/pythonjuemi/gpt/lmstudio/deepseek-R1:/root/.cache/deepseek-R1

environment:

- XINFERENCE_HOME=/root/.cache/deepseek-R1

ports:

- "9998:9997"

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: all

capabilities: [gpu]

command: xinference-local -H 0.0.0.0

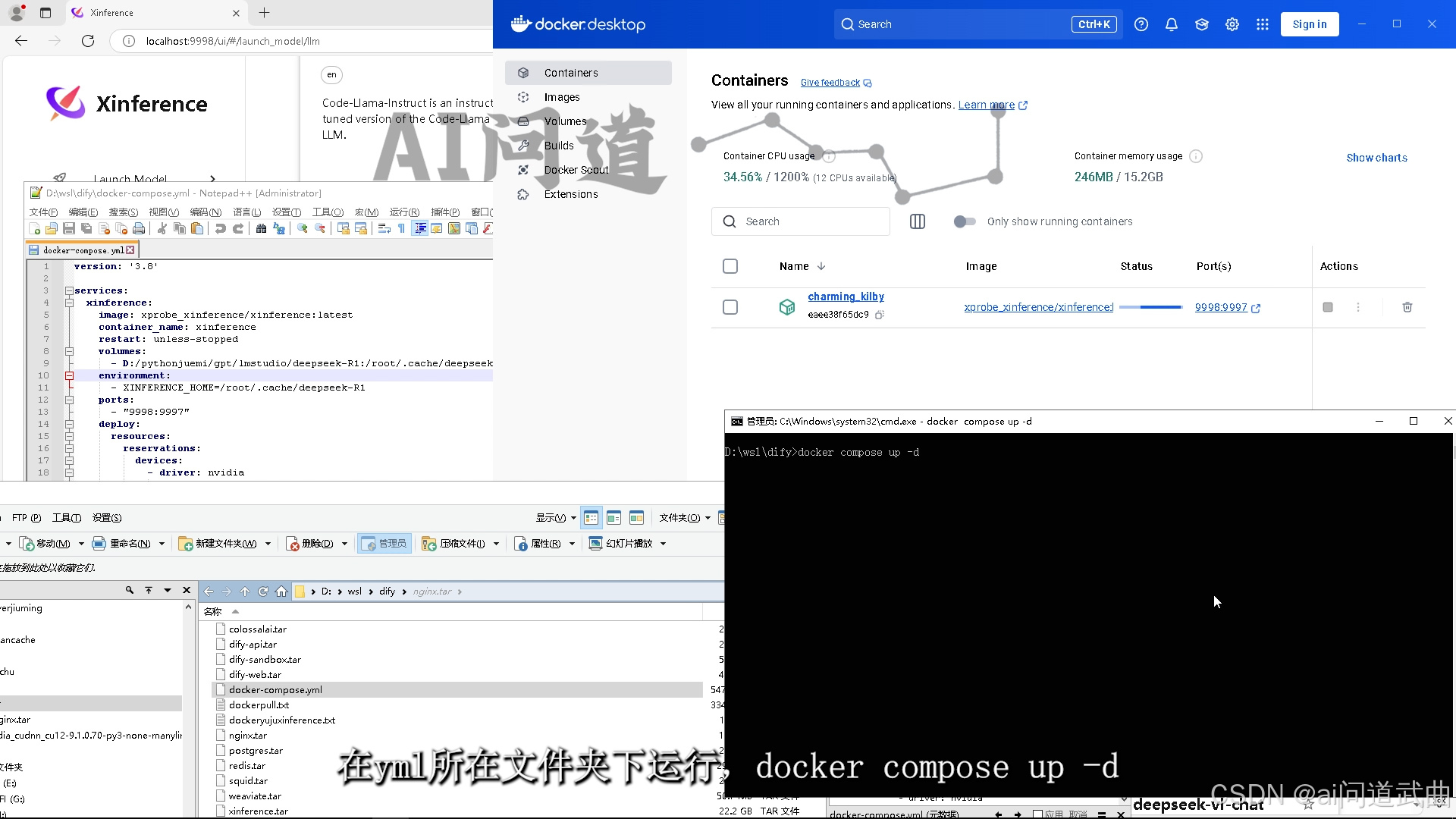

在yml所在文件夹下运行,

在yml所在文件夹下运行,

docker compose up -d

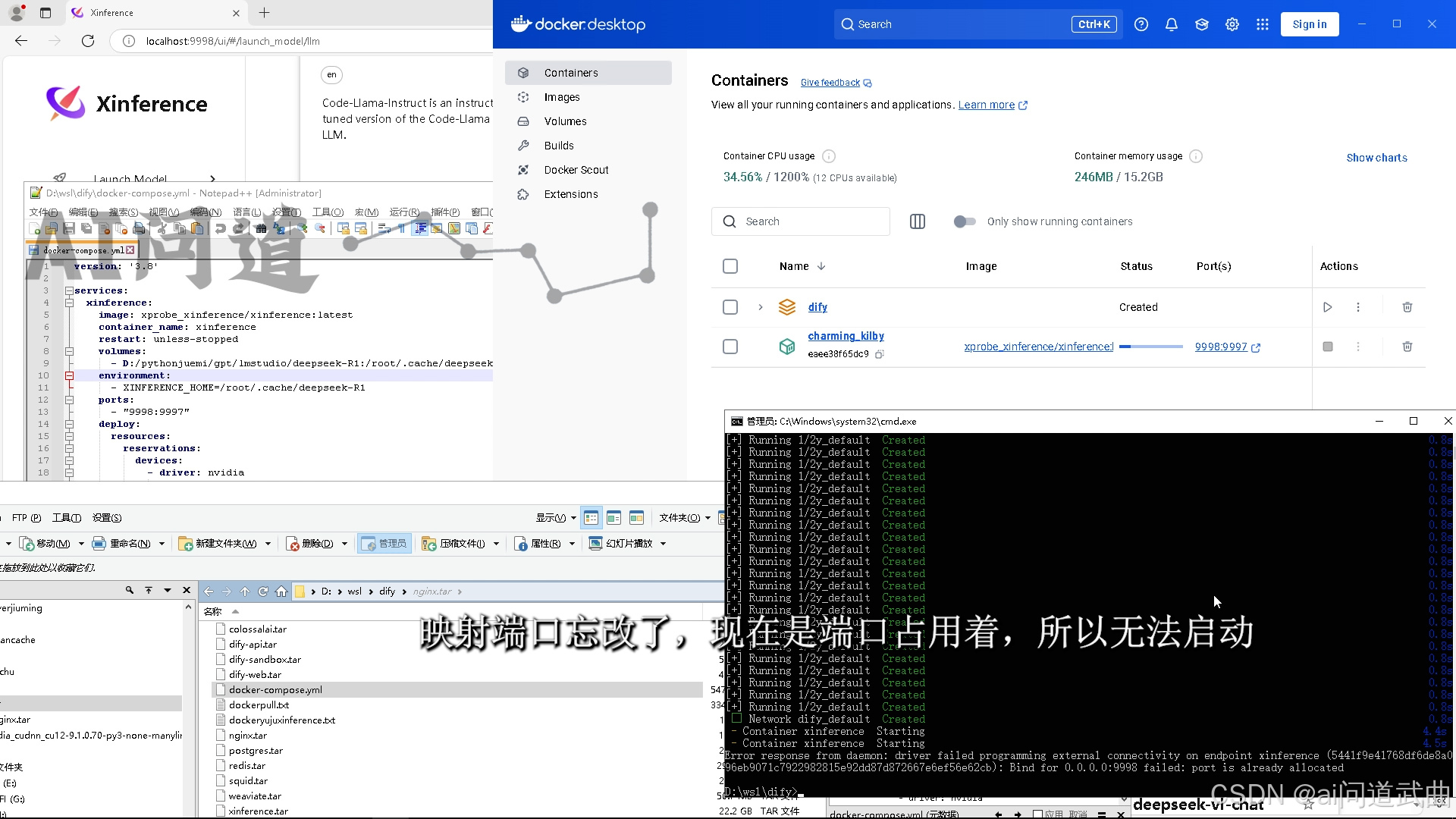

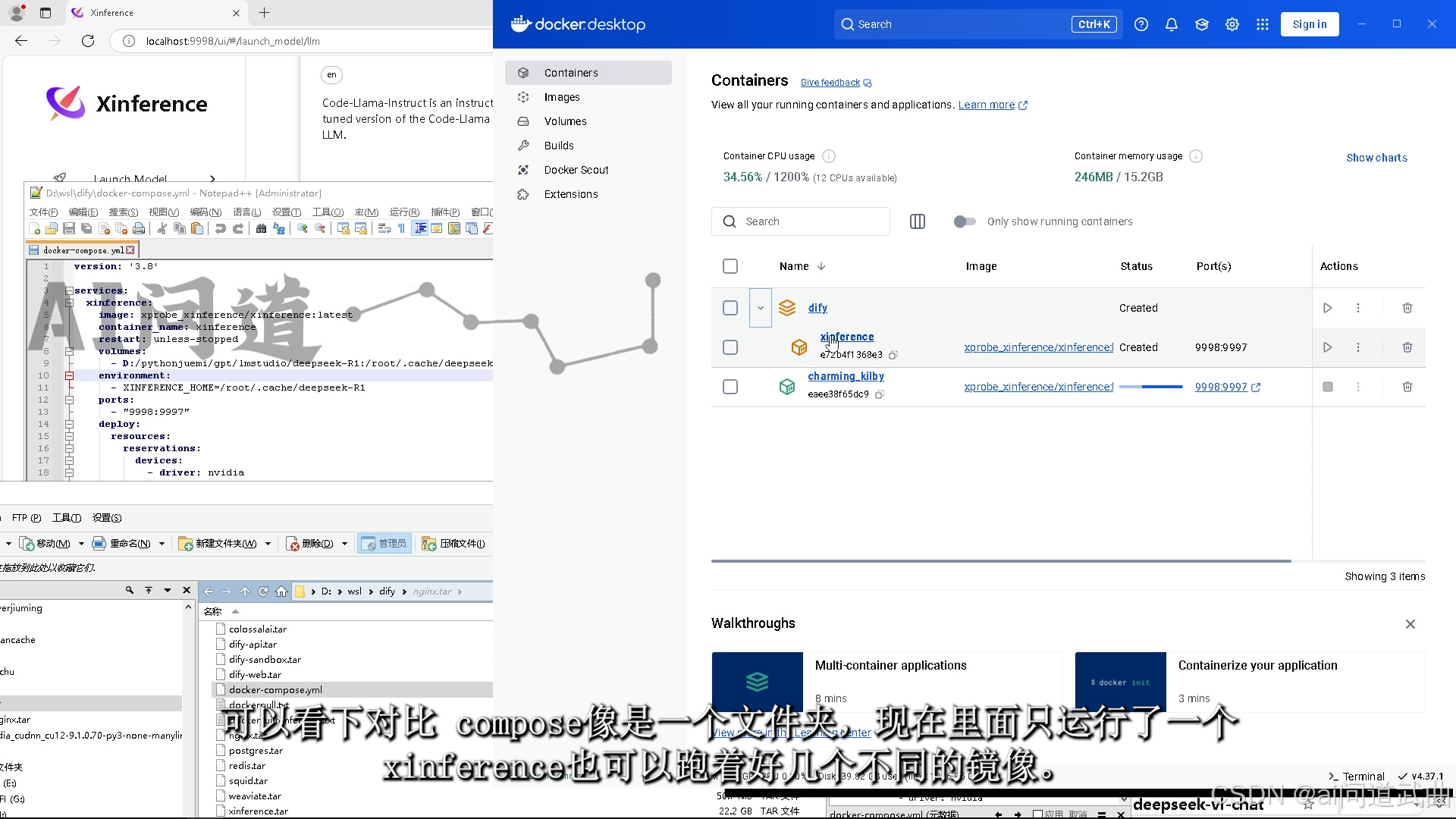

映射端口忘改了,现在是端口占用着,所以无法启动。 可以看下对比,compose像是一个文件夹,现在里面只运行了一个xinference,也可以跑着好几个不同的镜像。

可以看下对比,compose像是一个文件夹,现在里面只运行了一个xinference,也可以跑着好几个不同的镜像。 好,停掉之后,删掉这个原来的容器。

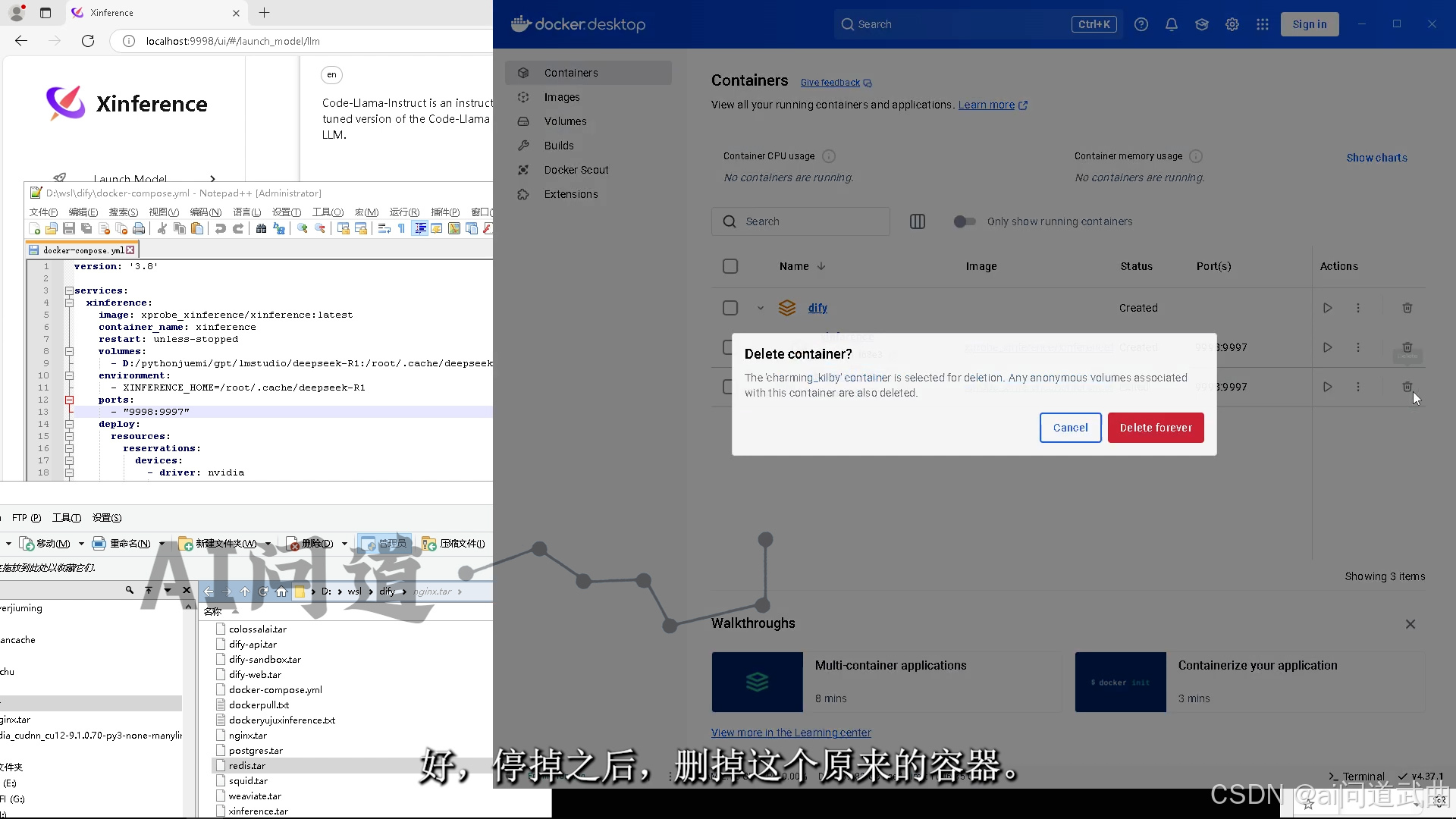

好,停掉之后,删掉这个原来的容器。

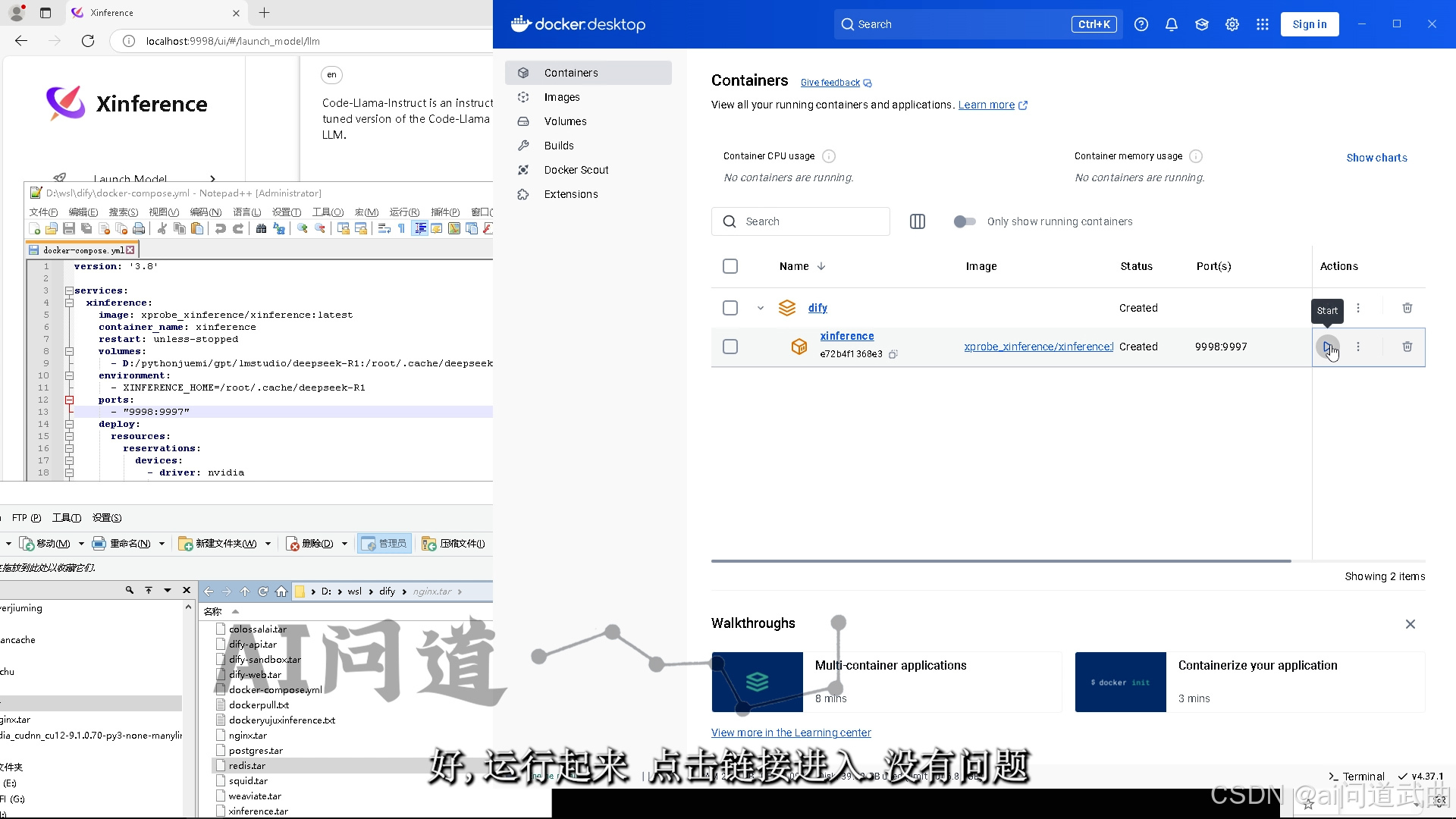

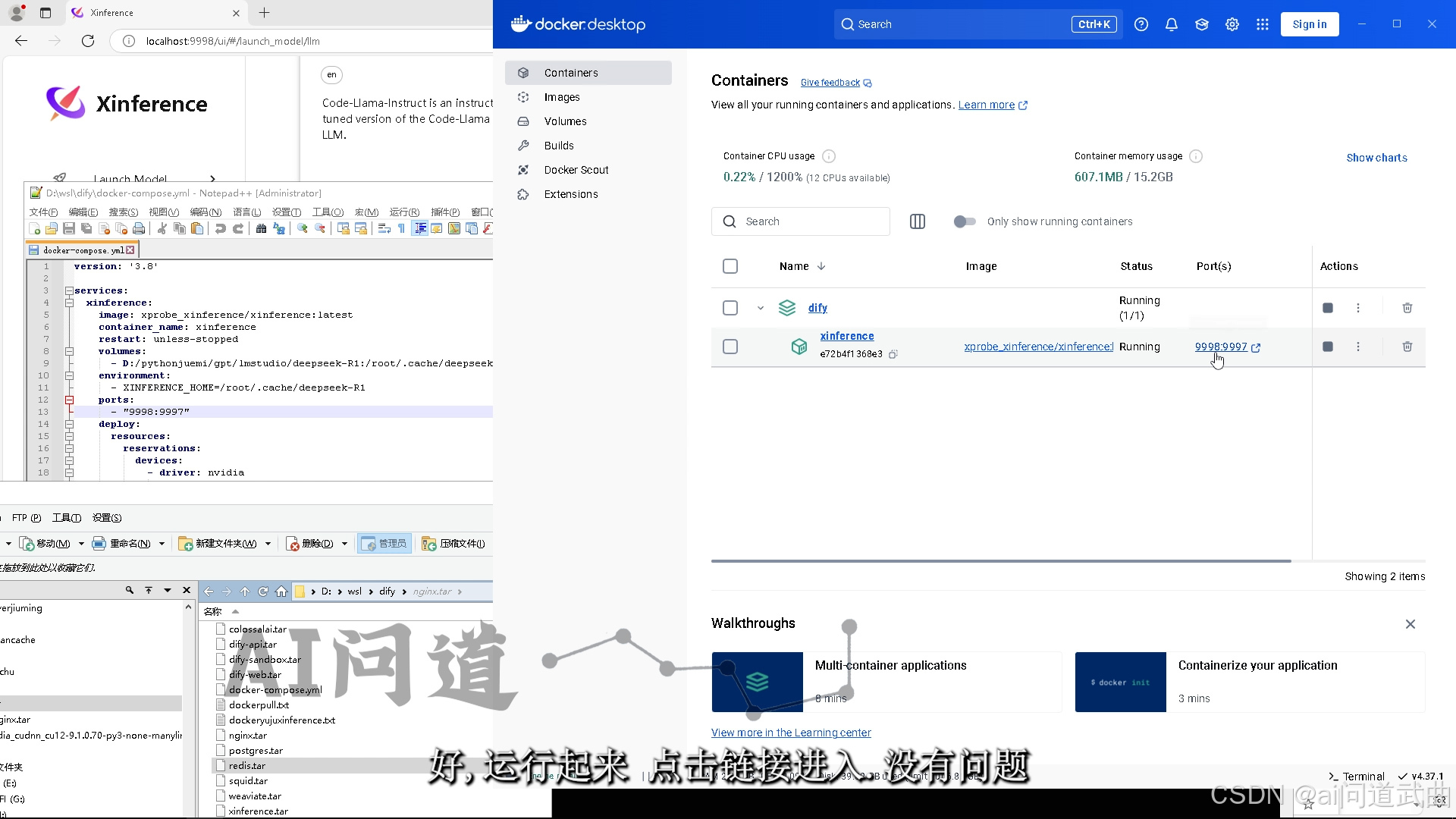

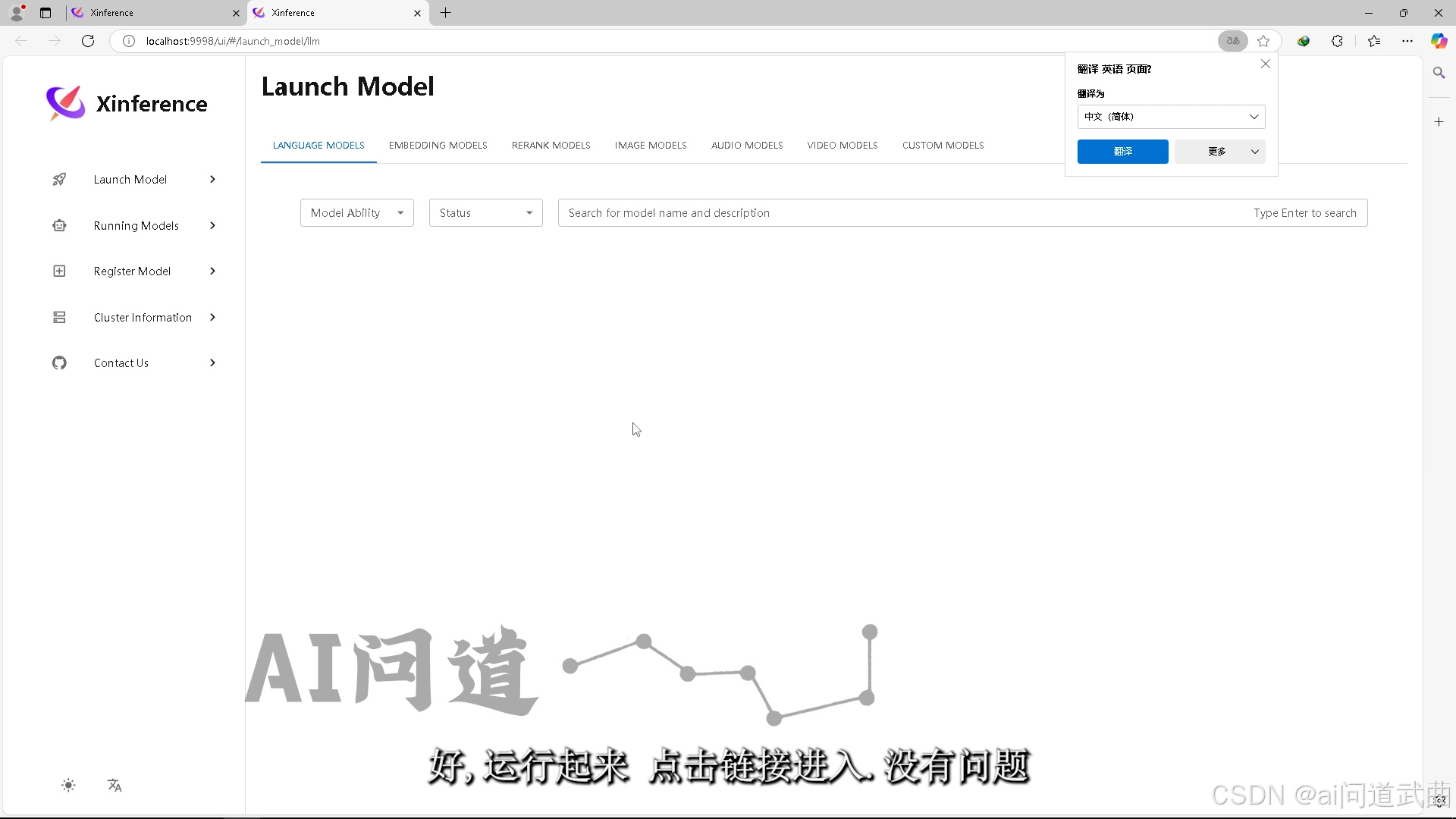

好,运行起来点链接进入,没有问题。

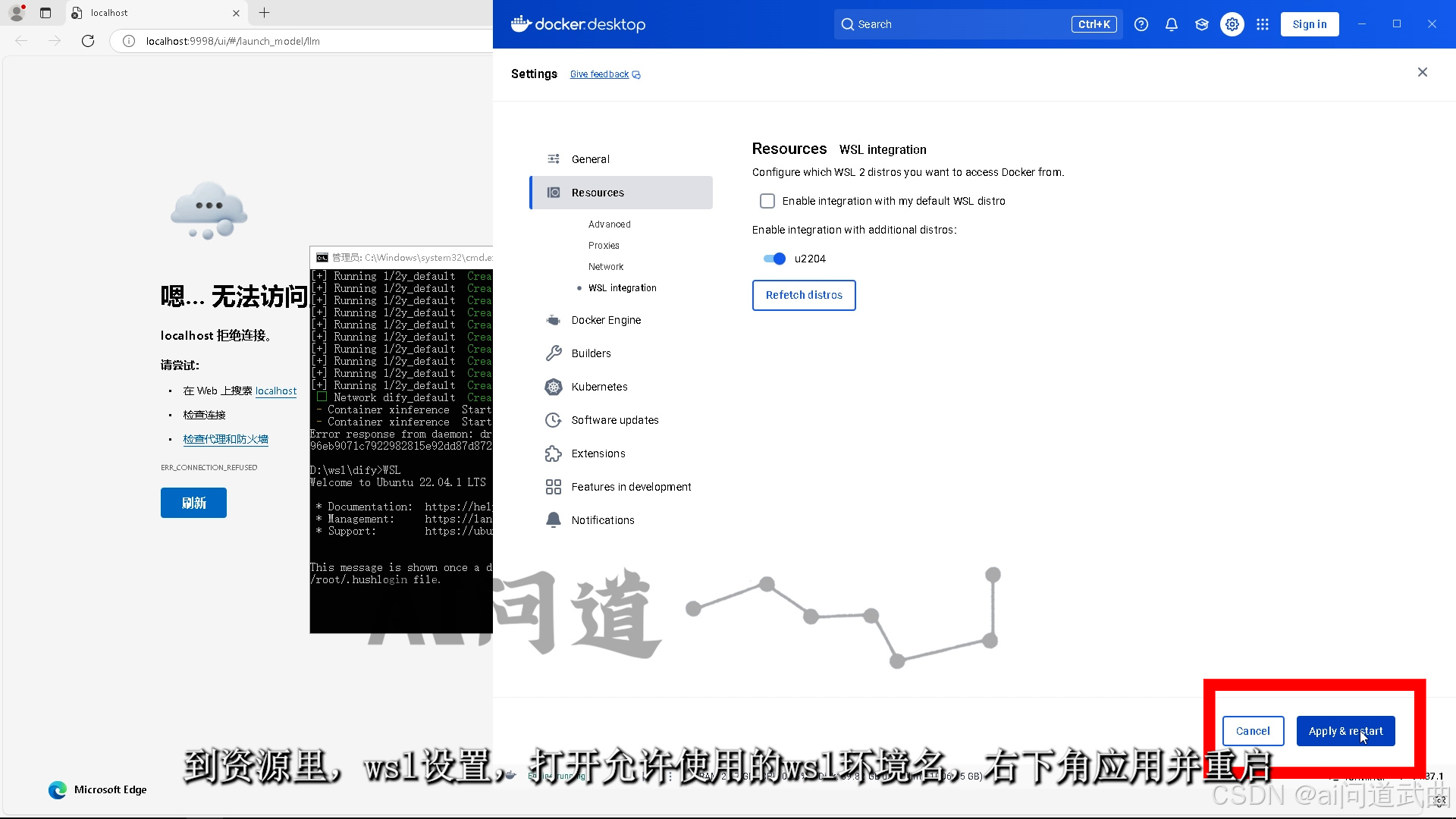

好,下面讲wsl,这次直接删了这个容器包。命令行进入wsl。docker里点这个小齿轮,到资源里,wsl设置,打开允许使用的wsl环境名,右下角应用并重启。

好,下面讲wsl,这次直接删了这个容器包。命令行进入wsl。docker里点这个小齿轮,到资源里,wsl设置,打开允许使用的wsl环境名,右下角应用并重启。

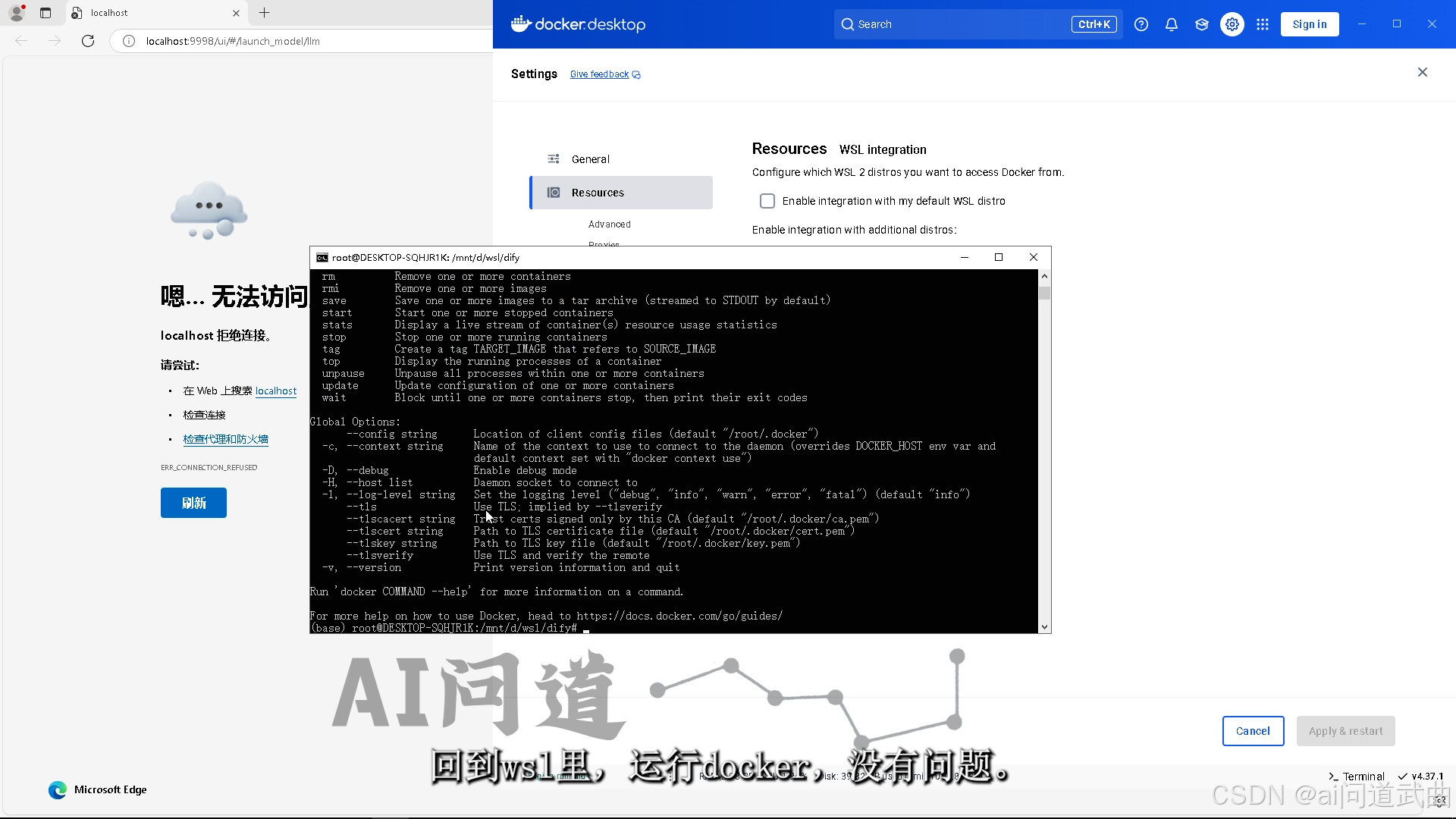

回到wsl里,运行docker,没有问题。 跟win一样,在yml文件夹下运行,docker compose up -d。呃呃,翻车了,路径忘改了。因为wsl没有d盘,所以把默认huggingface路径挂载过去。

跟win一样,在yml文件夹下运行,docker compose up -d。呃呃,翻车了,路径忘改了。因为wsl没有d盘,所以把默认huggingface路径挂载过去。

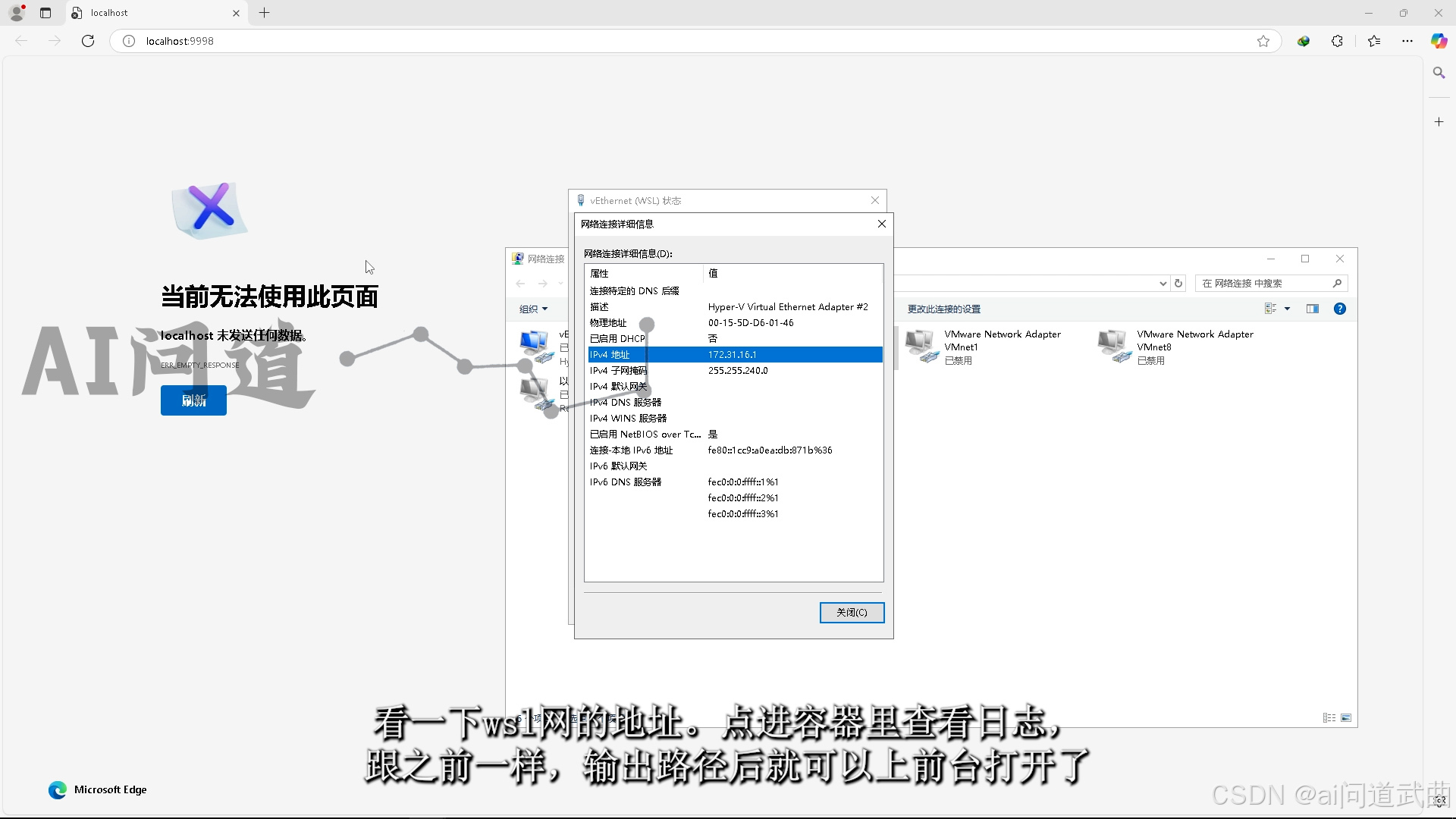

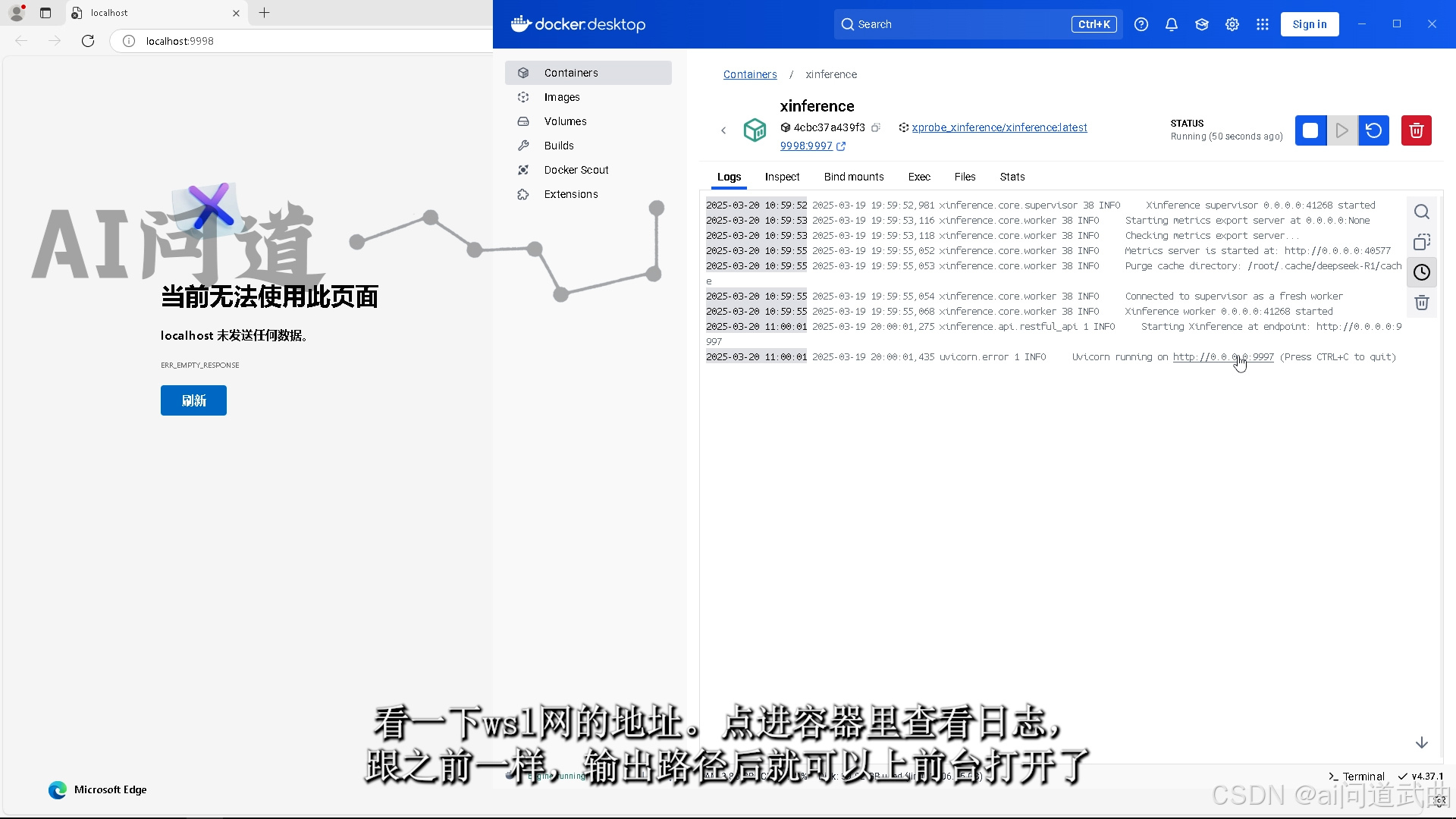

再次运行,没有问题。好,起来了。看一下wsl网的地址。 点进容器里查看日志,跟之前一样,输出路径后就可以上前台打开了。

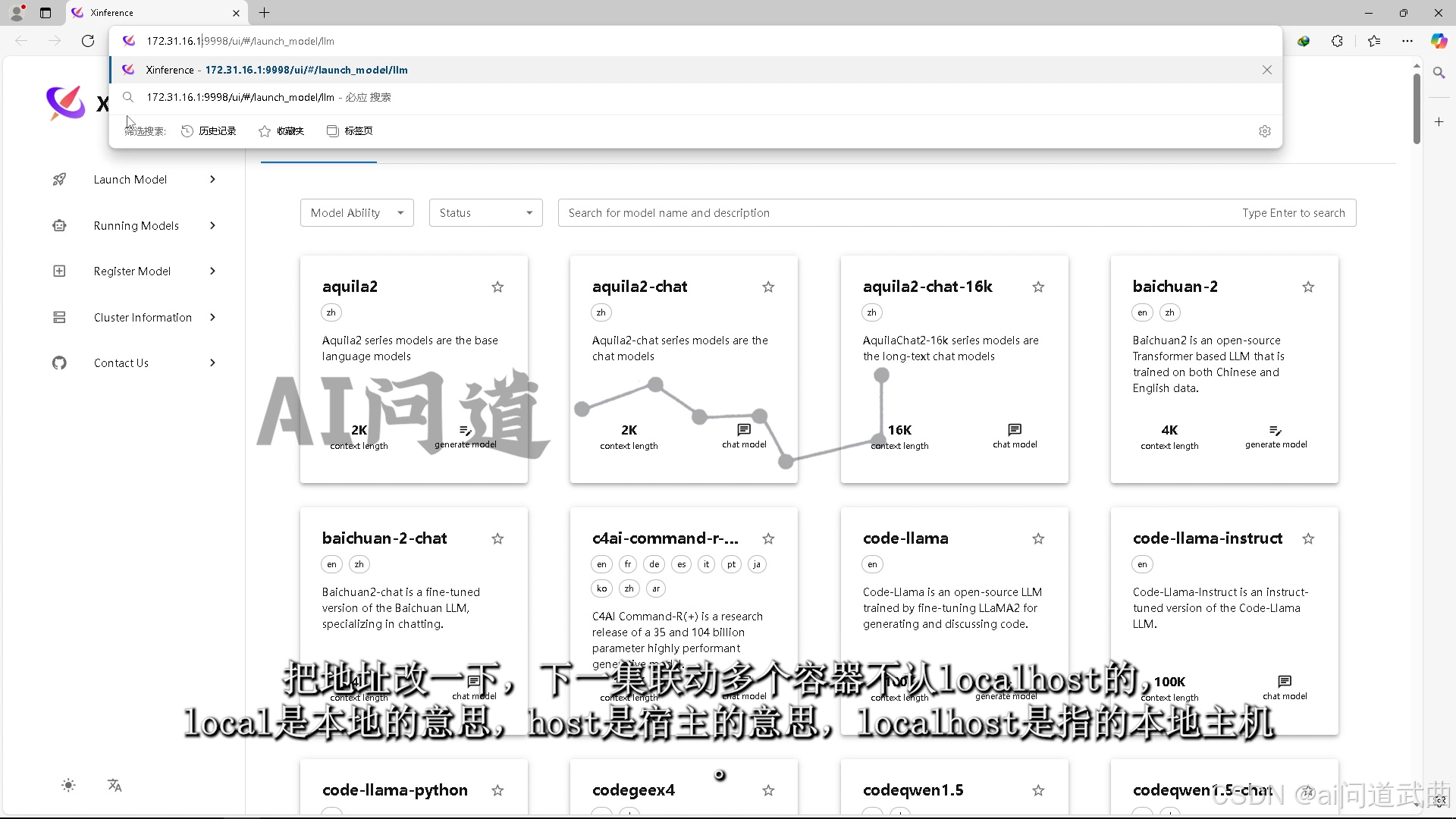

点进容器里查看日志,跟之前一样,输出路径后就可以上前台打开了。 把地址改一下,下一集联动多个容器不认localhost的,local是本地的意思,host是宿主的意思,localhost是指的本地主机。

把地址改一下,下一集联动多个容器不认localhost的,local是本地的意思,host是宿主的意思,localhost是指的本地主机。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)