【完整源码+数据集+部署教程】水面场景物体图像分割系统: yolov8-seg-C2f-EMSC

【完整源码+数据集+部署教程】水面场景物体图像分割系统: yolov8-seg-C2f-EMSC

背景意义

研究背景与意义

随着水面场景物体识别和分割技术的不断发展,基于深度学习的图像处理方法在海洋监测、环境保护、航运安全等领域中得到了广泛应用。水面场景的复杂性和多样性使得物体识别和分割任务面临诸多挑战,例如光照变化、波浪干扰以及水面反射等因素都可能影响到图像的质量和物体的可识别性。因此,开发一种高效、准确的水面场景物体图像分割系统显得尤为重要。

本研究旨在基于改进的YOLOv8模型,构建一个针对水面场景的物体图像分割系统。YOLO(You Only Look Once)系列模型因其实时性和高效性而受到广泛关注,尤其是在物体检测和分割任务中表现出色。通过对YOLOv8模型的改进,我们希望能够提高其在水面场景中对多种物体的分割精度,进而提升系统在实际应用中的有效性。

本研究所使用的数据集“combined-demo-segs”包含1600幅图像,涵盖了13个类别的物体,包括浮标、商船、死鲸、渔船、乘客船、动力艇、帆船等。这些类别的多样性为模型的训练提供了丰富的样本,有助于提高模型对不同物体的识别能力。同时,数据集中还包含了水面、天空和其他障碍物等背景信息,这将为模型的学习提供更为全面的上下文信息,从而增强其在复杂场景中的表现。

在水面场景中,物体的形态、颜色和运动状态各异,传统的图像处理方法往往难以应对这种复杂性。通过引入深度学习技术,尤其是基于YOLOv8的改进模型,我们可以利用其强大的特征提取能力和实时处理能力,显著提升物体分割的准确性和效率。此外,改进后的模型还将通过数据增强、迁移学习等技术,进一步提升其在特定场景下的泛化能力,使其能够适应不同的水面环境。

本研究的意义不仅在于提升水面场景物体图像分割的技术水平,更在于为海洋监测、生态保护和航运安全等实际应用提供有效的技术支持。通过准确识别和分割水面上的各类物体,相关部门可以更好地进行环境监测、船舶管理和事故预警,从而为保护海洋生态环境和提高航运安全提供科学依据。

综上所述,基于改进YOLOv8的水面场景物体图像分割系统的研究,不仅具有重要的学术价值,还有助于推动相关领域的技术进步和应用发展。通过本研究,我们期望能够为水面场景的智能化处理提供新的思路和方法,促进深度学习技术在实际应用中的落地与发展。

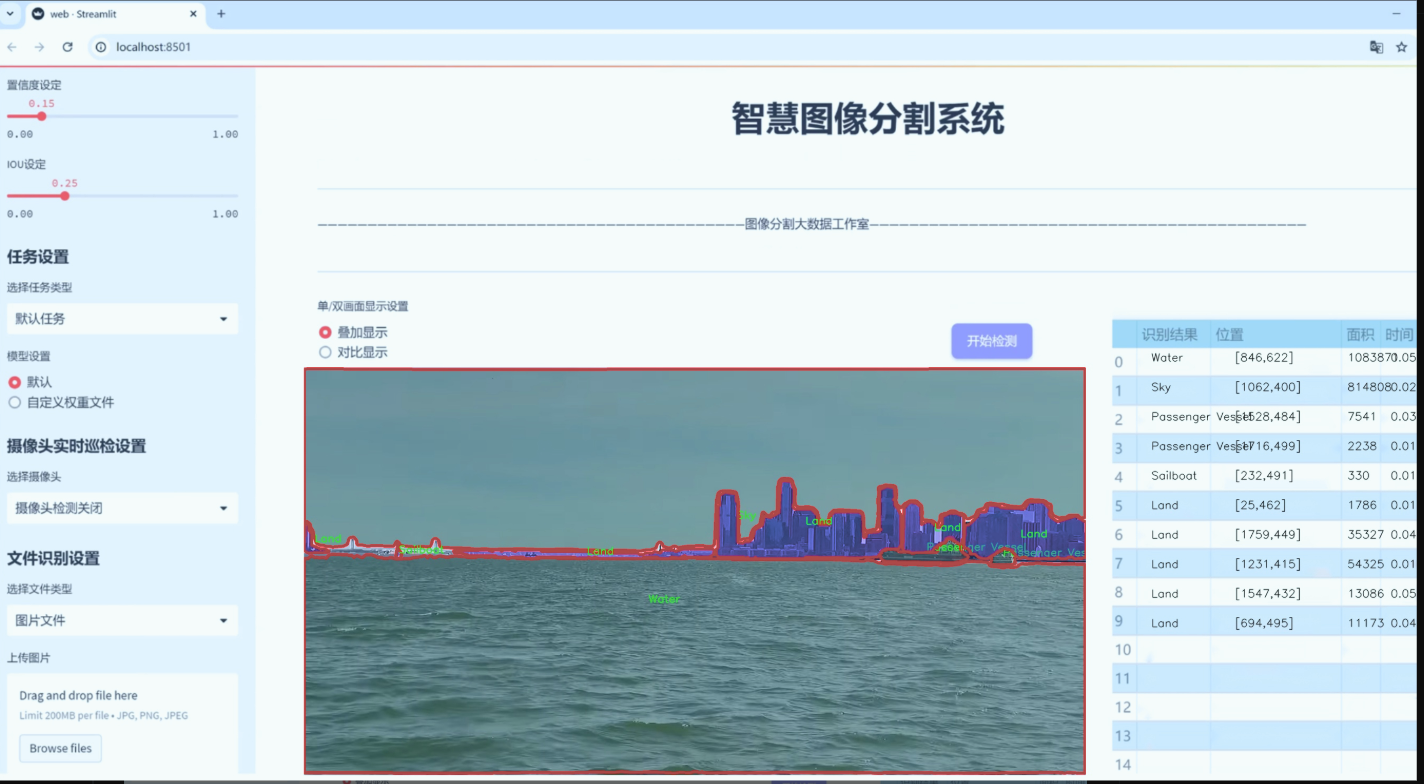

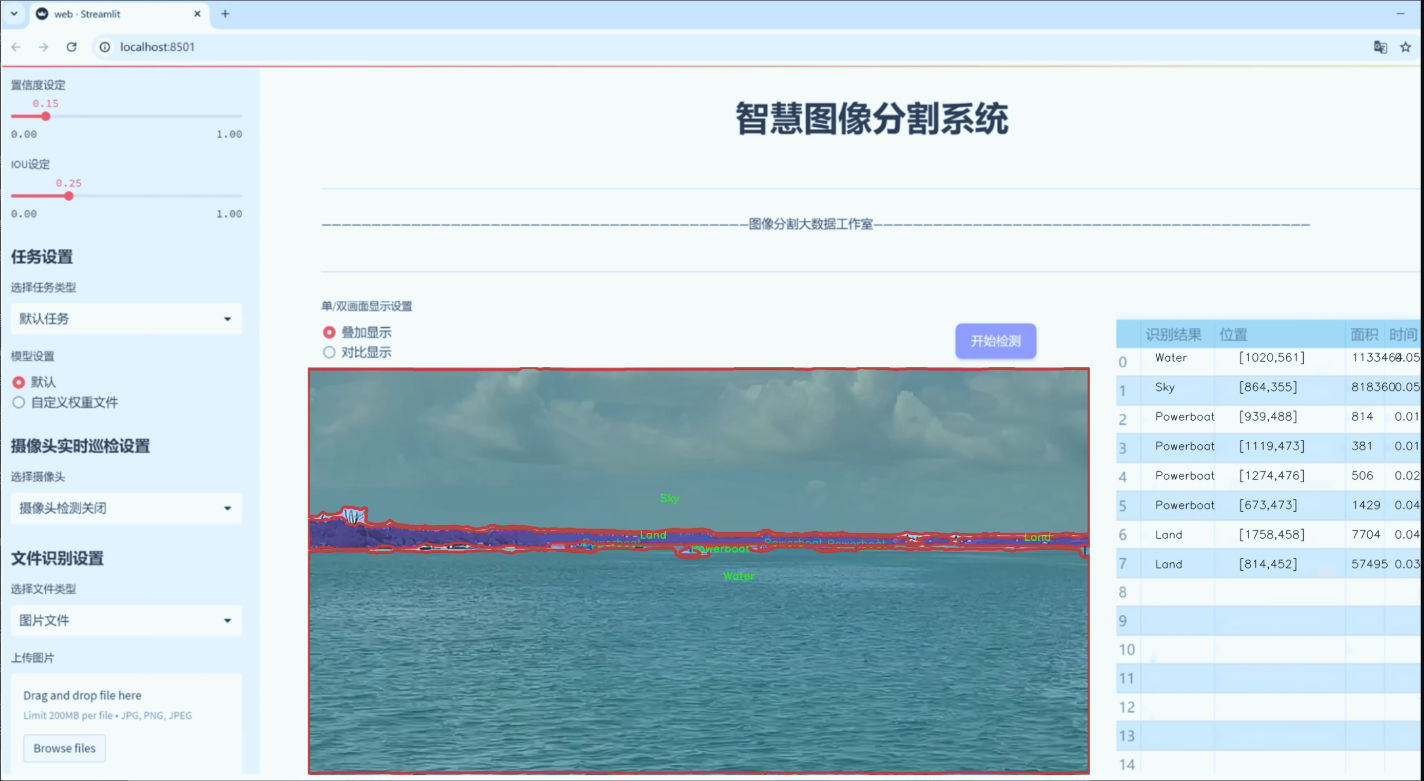

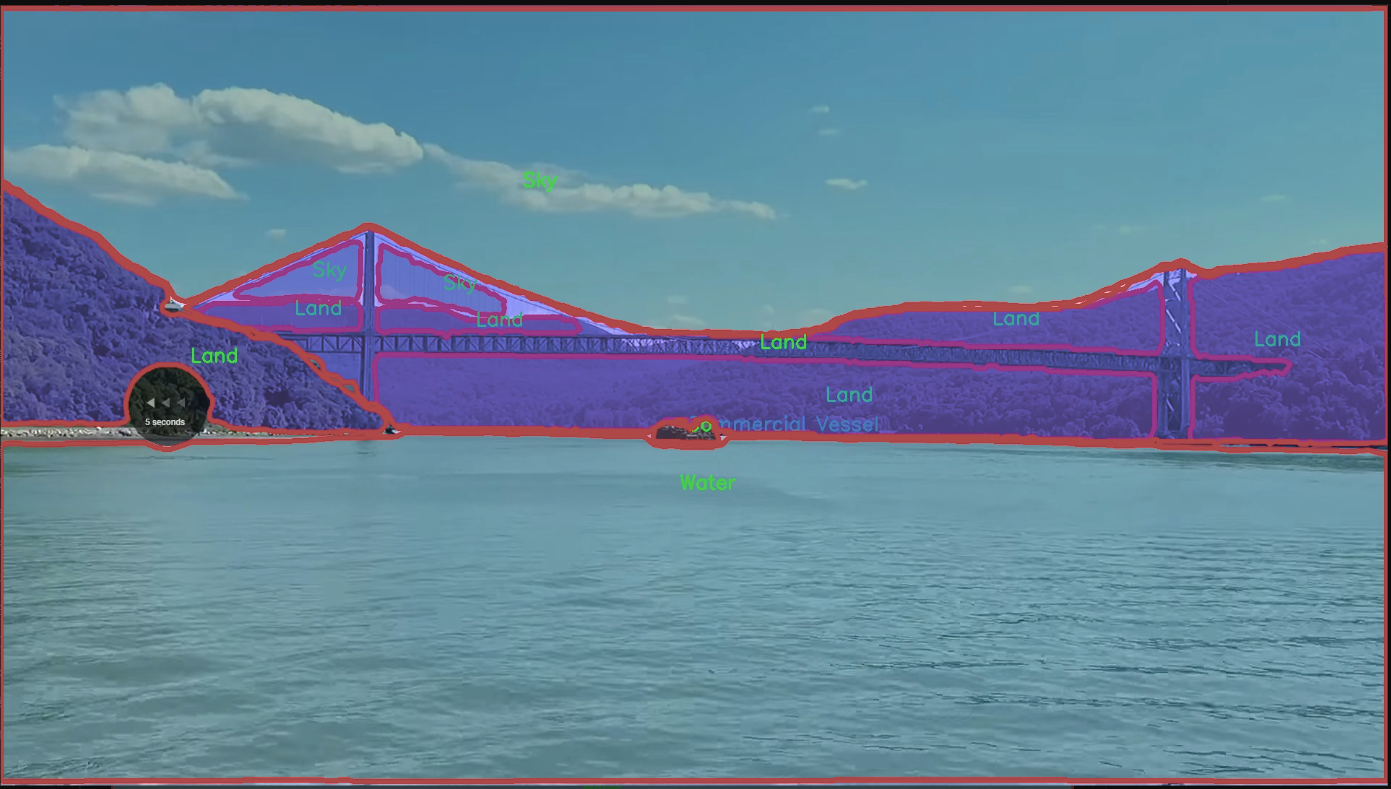

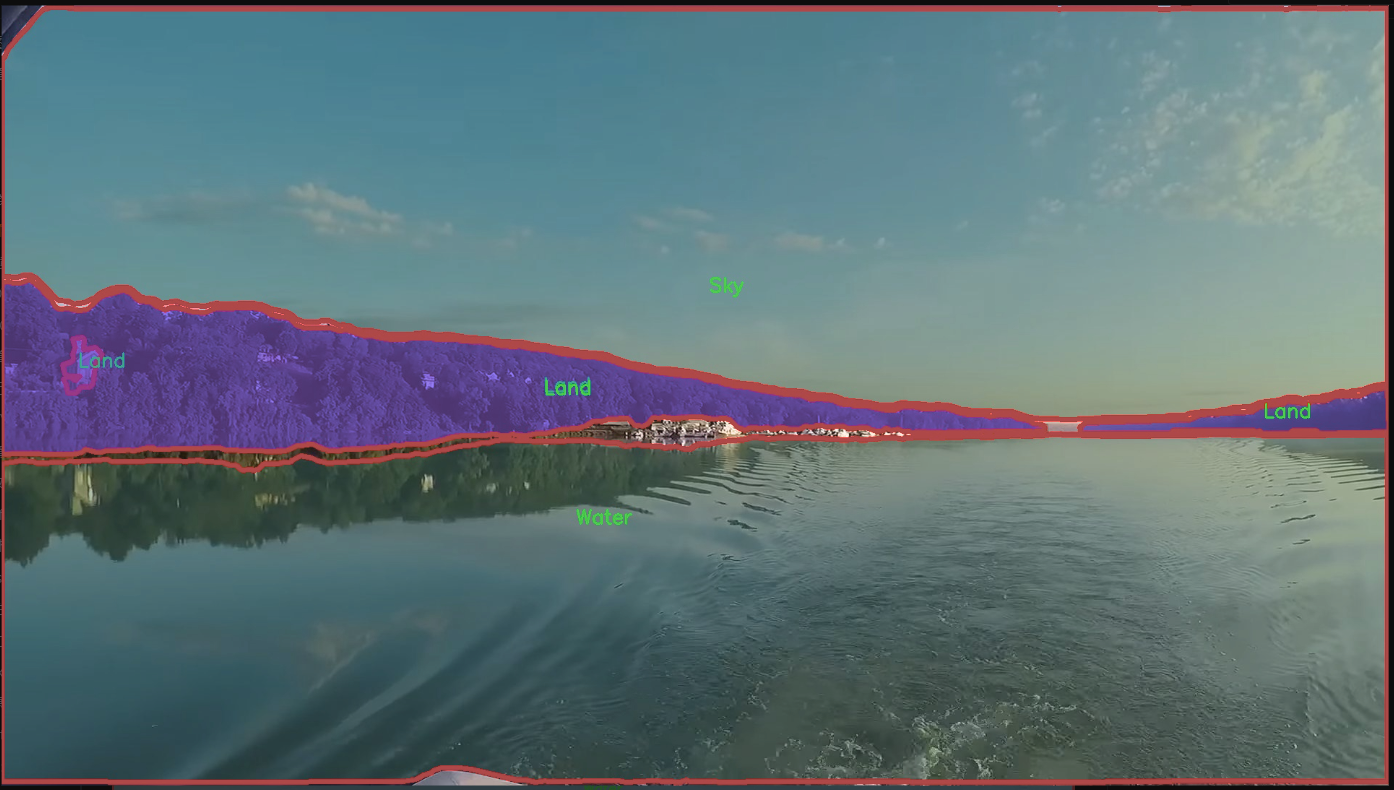

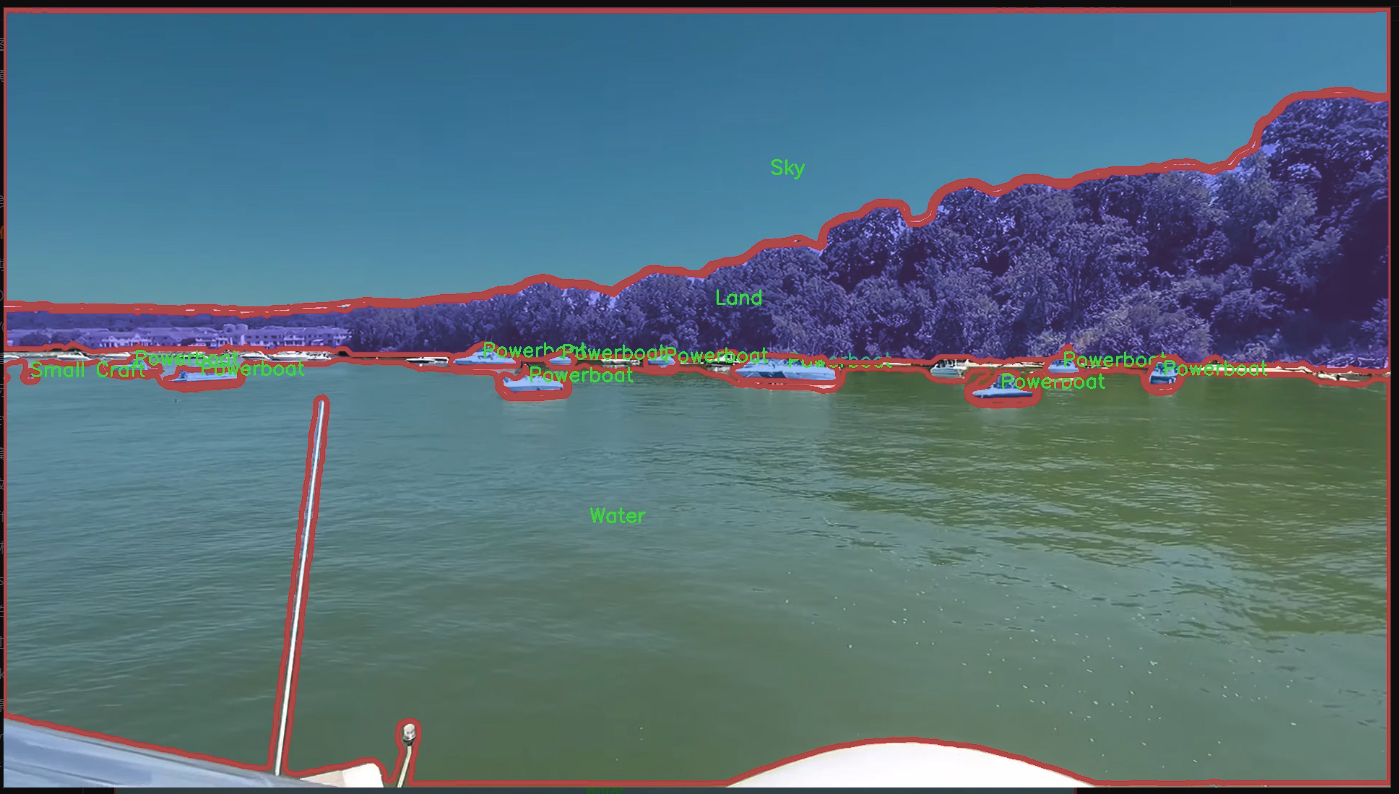

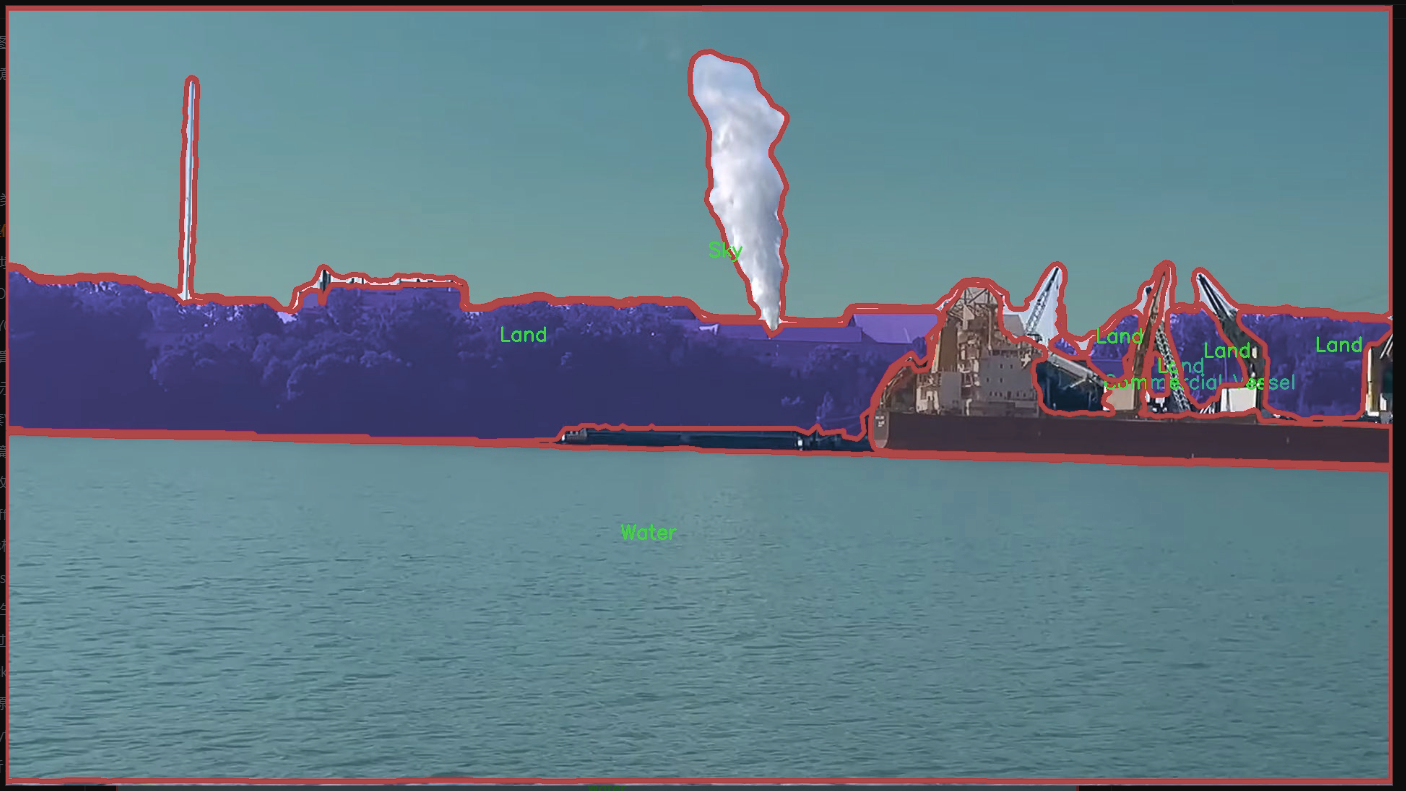

图片效果

数据集信息

数据集信息展示

在现代计算机视觉领域,图像分割技术的应用日益广泛,尤其是在水面场景的物体识别与分割中,具有重要的实际意义。本研究旨在通过改进YOLOv8-seg模型,提升水面场景物体的图像分割精度与效率。为此,我们采用了名为“combined-demo-segs”的数据集,该数据集专门针对水面环境中的多种物体进行标注,涵盖了丰富的类别信息,极大地支持了我们的研究目标。

“combined-demo-segs”数据集包含13个不同的类别,具体包括:Buoy-Marker(浮标标记)、Commercial Vessel(商业船舶)、Fishing Boat(渔船)、Land(陆地)、Other Obstacle(其他障碍物)、POV Vessel(视角船舶)、Passenger Vessel(客船)、Person(人)、Powerboat(动力艇)、Sailboat(帆船)、Sky(天空)、Small Craft(小型船舶)以及Water(水面)。这些类别的设置不仅考虑到了水面场景的多样性,还反映了实际应用中可能遇到的各种物体类型,确保了数据集的全面性和代表性。

在数据集的构建过程中,所有类别的图像均经过精细的标注,以确保每个物体的边界清晰可辨。这种高质量的标注对于训练深度学习模型至关重要,因为模型的性能往往依赖于训练数据的质量和多样性。通过使用“combined-demo-segs”数据集,我们能够为YOLOv8-seg模型提供丰富的训练样本,使其在面对复杂的水面场景时,能够更准确地识别和分割不同的物体。

在水面场景中,物体的外观和背景往往会受到光照、波浪、天气等因素的影响,因此,数据集中的图像涵盖了多种不同的环境条件。这种多样性不仅增强了模型的鲁棒性,还使其能够适应不同的实际应用场景。例如,在晴天和阴天、平静水面和波涛汹涌的水面上,模型都能够保持较高的分割精度。此外,数据集中包含的人物、船舶等类别的多样性,使得模型在处理复杂场景时,能够更好地进行物体分离与识别。

通过对“combined-demo-segs”数据集的深入分析,我们发现该数据集在训练过程中表现出了良好的泛化能力。模型在不同类别之间的分割效果均衡,能够有效地区分相似物体,如不同类型的船舶和水面障碍物。这一特性使得我们的改进YOLOv8-seg模型在实际应用中,能够提供更为精准的物体识别与分割结果,满足水面监测、海洋安全等领域的需求。

综上所述,“combined-demo-segs”数据集为改进YOLOv8-seg的水面场景物体图像分割系统提供了坚实的基础。其丰富的类别信息和高质量的标注数据,确保了模型在训练过程中的有效性和准确性。未来,我们将继续探索数据集的潜力,结合更先进的算法与技术,推动水面物体图像分割的研究与应用。

核心代码

以下是经过简化和注释的核心代码部分:

导入必要的库

import os

import glob

import torch

from torch.utils.cpp_extension import CUDA_HOME, CppExtension, CUDAExtension

from setuptools import find_packages, setup

定义所需的依赖包

requirements = [“torch”, “torchvision”]

def get_extensions():

# 获取当前文件的目录

this_dir = os.path.dirname(os.path.abspath(file))

# 定义扩展源代码的目录

extensions_dir = os.path.join(this_dir, “src”)

# 查找主文件和CPU、CUDA源文件

main_file = glob.glob(os.path.join(extensions_dir, "*.cpp"))

source_cpu = glob.glob(os.path.join(extensions_dir, "cpu", "*.cpp"))

source_cuda = glob.glob(os.path.join(extensions_dir, "cuda", "*.cu"))

# 合并主文件和CPU源文件

sources = main_file + source_cpu

extension = CppExtension # 默认使用 CppExtension

extra_compile_args = {"cxx": []} # 编译参数

define_macros = [] # 宏定义

# 检查CUDA是否可用

if torch.cuda.is_available() and CUDA_HOME is not None:

extension = CUDAExtension # 使用CUDA扩展

sources += source_cuda # 添加CUDA源文件

define_macros += [("WITH_CUDA", None)] # 定义宏

extra_compile_args["nvcc"] = [] # CUDA编译参数

else:

raise NotImplementedError('Cuda is not available') # 抛出异常

# 将源文件路径进行处理

sources = [os.path.join(extensions_dir, s) for s in sources]

include_dirs = [extensions_dir] # 包含目录

# 创建扩展模块

ext_modules = [

extension(

"DCNv3", # 模块名称

sources, # 源文件

include_dirs=include_dirs, # 包含目录

define_macros=define_macros, # 宏定义

extra_compile_args=extra_compile_args, # 编译参数

)

]

return ext_modules # 返回扩展模块列表

设置包信息和扩展模块

setup(

name=“DCNv3”, # 包名称

version=“1.1”, # 版本号

author=“InternImage”, # 作者

url=“https://github.com/OpenGVLab/InternImage”, # 项目链接

description=“PyTorch Wrapper for CUDA Functions of DCNv3”, # 描述

packages=find_packages(exclude=(“configs”, “tests”)), # 查找包

ext_modules=get_extensions(), # 获取扩展模块

cmdclass={“build_ext”: torch.utils.cpp_extension.BuildExtension}, # 构建扩展的命令类

)

代码说明:

导入库:导入必要的库以支持CUDA扩展和包管理。

获取扩展函数:get_extensions函数用于查找和配置C++/CUDA源文件,并创建相应的扩展模块。

CUDA支持检查:代码检查CUDA是否可用,并根据可用性选择合适的扩展类型。

设置包信息:使用setuptools的setup函数定义包的基本信息,包括名称、版本、作者、描述等,并指定扩展模块。

这个程序文件是一个用于设置和编译DCNv3(Deformable Convolutional Networks v3)扩展模块的Python脚本,主要依赖于PyTorch的C++扩展功能。首先,文件开头包含了一些版权信息和许可证声明,表明该代码的版权归OpenGVLab所有,并且遵循MIT许可证。

接下来,程序导入了一些必要的库,包括操作系统相关的库(os和glob),以及PyTorch相关的库(torch和torch.utils.cpp_extension)。这些库提供了构建和编译C++扩展所需的功能。

在requirements列表中,指定了该模块的依赖项,包括torch和torchvision,这意味着在安装该模块之前,用户需要确保这两个库已经安装。

get_extensions函数是该文件的核心部分。它的作用是收集所有需要编译的源文件,并根据系统是否支持CUDA来选择合适的扩展类型。首先,它获取当前文件的目录,并构建源文件的路径。通过glob模块,程序查找主文件(.cpp)以及CPU和CUDA相关的源文件(分别位于cpu和cuda子目录中)。

如果系统支持CUDA,程序将使用CUDAExtension来编译CUDA源文件,并添加相应的宏定义和编译参数。如果CUDA不可用,程序将抛出一个NotImplementedError,提示用户CUDA不可用。

所有找到的源文件路径将被加入到sources列表中,并指定了包含目录。然后,创建一个扩展模块的列表,其中包含了模块的名称、源文件、包含目录、宏定义和编译参数。

最后,setup函数被调用来配置模块的安装信息,包括模块名称、版本、作者、项目网址、描述、需要排除的包(如configs和tests),以及通过get_extensions函数获取的扩展模块列表。cmdclass参数指定了构建扩展时使用的类,这里使用了PyTorch提供的BuildExtension类。

总的来说,这个setup.py文件的主要功能是为DCNv3模块的C++和CUDA扩展提供构建和安装的配置,确保用户可以在支持CUDA的环境中顺利编译和使用该模块。

11.5 demo_test_camera.py

以下是代码中最核心的部分,并附上详细的中文注释:

import cv2

import numpy as np

from PIL import ImageFont, ImageDraw, Image

from hashlib import md5

from model import Web_Detector

from chinese_name_list import Label_list

def generate_color_based_on_name(name):

# 使用哈希函数生成稳定的颜色

hash_object = md5(name.encode()) # 对名字进行MD5哈希

hex_color = hash_object.hexdigest()[:6] # 取前6位16进制数作为颜色

r, g, b = int(hex_color[0:2], 16), int(hex_color[2:4], 16), int(hex_color[4:6], 16) # 转换为RGB

return (b, g, r) # OpenCV 使用BGR格式

def draw_with_chinese(image, text, position, font_size=20, color=(255, 0, 0)):

# 在图像上绘制中文文本

image_pil = Image.fromarray(cv2.cvtColor(image, cv2.COLOR_BGR2RGB)) # 转换为PIL格式

draw = ImageDraw.Draw(image_pil) # 创建绘图对象

font = ImageFont.truetype(“simsun.ttc”, font_size, encoding=“unic”) # 加载中文字体

draw.text(position, text, font=font, fill=color) # 绘制文本

return cv2.cvtColor(np.array(image_pil), cv2.COLOR_RGB2BGR) # 转换回OpenCV格式

def draw_detections(image, info):

# 在图像上绘制检测结果

name, bbox = info[‘class_name’], info[‘bbox’] # 获取类别名称和边界框

x1, y1, x2, y2 = bbox # 解包边界框坐标

cv2.rectangle(image, (x1, y1), (x2, y2), color=(0, 0, 255), thickness=3) # 绘制边界框

image = draw_with_chinese(image, name, (x1, y1 - 10), font_size=20) # 绘制类别名称

return image

def process_frame(model, image):

# 处理每一帧图像

pre_img = model.preprocess(image) # 预处理图像

pred = model.predict(pre_img) # 进行预测

det = pred[0] # 获取检测结果

if det is not None and len(det):

det_info = model.postprocess(pred) # 后处理获取检测信息

for info in det_info:

image = draw_detections(image, info) # 绘制检测结果

return image

if name == “main”:

model = Web_Detector() # 初始化检测模型

model.load_model(“./weights/yolov8s-seg.pt”) # 加载模型权重

# 摄像头实时处理

cap = cv2.VideoCapture(0) # 打开摄像头

while cap.isOpened():

ret, frame = cap.read() # 读取帧

if not ret:

break

processed_frame = process_frame(model, frame) # 处理帧

cv2.imshow('Camera Feed', processed_frame) # 显示处理后的帧

if cv2.waitKey(1) & 0xFF == ord('q'): # 按'q'退出

break

cap.release() # 释放摄像头

cv2.destroyAllWindows() # 关闭所有窗口

代码核心部分说明:

生成颜色:通过哈希函数生成与名称相关的颜色,以确保每个名称对应一个稳定的颜色。

绘制中文文本:使用PIL库在图像上绘制中文文本,支持中文字体。

绘制检测结果:在图像上绘制边界框和类别名称,展示检测结果。

处理每一帧:对每一帧图像进行预处理、预测和后处理,最终绘制检测结果。

实时摄像头处理:通过摄像头获取实时视频流,并对每一帧进行处理和显示。

这个程序文件 demo_test_camera.py 是一个基于计算机视觉的实时目标检测和分割的示例,使用了 OpenCV 和一个自定义的模型 Web_Detector。程序的主要功能是通过摄像头捕捉视频流,并对每一帧进行目标检测和绘制相关信息。

首先,程序导入了必要的库,包括 random、cv2(OpenCV)、numpy、PIL(用于处理图像字体和绘制)以及 hashlib(用于生成颜色的哈希值)。同时,它还导入了自定义的模型和标签列表。

程序中定义了几个辅助函数。generate_color_based_on_name 函数根据给定的名称生成一个稳定的颜色,使用 MD5 哈希算法将名称转换为颜色值。calculate_polygon_area 函数计算多边形的面积,draw_with_chinese 函数用于在图像上绘制中文文本。adjust_parameter 函数根据图像的大小调整绘制参数,以确保在不同分辨率下绘制效果一致。

draw_detections 函数是程序的核心部分,它负责在图像上绘制检测到的目标信息。如果检测到的目标有掩膜(mask),则使用多边形绘制该目标的区域,并计算面积、周长和圆度等特征。同时,它还计算该区域的平均颜色,并将这些信息以中文文本的形式绘制在图像上。如果没有掩膜,则简单地绘制边界框和类别名称。

process_frame 函数处理每一帧图像,首先对图像进行预处理,然后通过模型进行预测,最后将检测到的目标信息绘制到图像上。

在 main 部分,程序加载标签列表和模型权重,接着打开摄像头进行实时视频捕捉。在一个循环中,程序不断读取摄像头帧并调用 process_frame 进行处理,最后通过 OpenCV 显示处理后的图像。如果用户按下 ‘q’ 键,程序将退出循环并释放摄像头资源,关闭所有窗口。

总体来说,这个程序展示了如何使用深度学习模型进行实时目标检测,并将检测结果以可视化的方式呈现。

12.系统整体结构(节选)

程序整体功能和构架概括

该程序集成了多个模块,主要用于计算机视觉任务,包括目标检测、姿态估计和分割。整体架构由多个功能模块组成,每个模块负责特定的任务,如模型训练、验证、扩展模块的构建和实时视频处理。以下是各个模块的功能概述:

姿态估计训练:通过 train.py 文件实现姿态估计模型的训练,支持模型的初始化、训练过程中的可视化和性能验证。

工具函数:init.py 文件提供了跟踪器相关的工具函数和初始化,简化了模块的使用。

分割验证:val.py 文件专门用于快速SAM分割模型的验证,定制了验证过程以适应特定需求。

扩展模块构建:setup.py 文件用于设置和编译DCNv3扩展模块,确保在支持CUDA的环境中能够顺利编译和使用。

实时目标检测演示:demo_test_camera.py 文件展示了如何使用自定义模型进行实时目标检测和分割,通过摄像头捕捉视频流并对每一帧进行处理。

文件功能整理表

文件路径 功能描述

ultralytics/models/yolo/pose/train.py 定义姿态估计模型的训练过程,包括模型初始化、训练可视化和性能验证。

ultralytics/trackers/utils/init.py 提供跟踪器相关的工具函数和初始化,简化模块的使用。

ultralytics/models/fastsam/val.py 实现快速SAM分割模型的验证,定制验证过程以适应特定需求。

ultralytics/nn/extra_modules/ops_dcnv3/setup.py 设置和编译DCNv3扩展模块,支持CUDA环境下的编译和使用。

demo_test_camera.py 实现实时目标检测和分割,通过摄像头捕捉视频流并处理每一帧。

这个表格清晰地展示了每个文件的功能,使得用户能够快速了解各个模块的作用和整体架构。

13.图片、视频、摄像头图像分割Demo(去除WebUI)代码

在这个博客小节中,我们将讨论如何在不使用WebUI的情况下,实现图像分割模型的使用。本项目代码已经优化整合,方便用户将分割功能嵌入自己的项目中。 核心功能包括图片、视频、摄像头图像的分割,ROI区域的轮廓提取、类别分类、周长计算、面积计算、圆度计算以及颜色提取等。 这些功能提供了良好的二次开发基础。

核心代码解读

以下是主要代码片段,我们会为每一块代码进行详细的批注解释:

import random

import cv2

import numpy as np

from PIL import ImageFont, ImageDraw, Image

from hashlib import md5

from model import Web_Detector

from chinese_name_list import Label_list

根据名称生成颜色

def generate_color_based_on_name(name):

…

计算多边形面积

def calculate_polygon_area(points):

return cv2.contourArea(points.astype(np.float32))

…

绘制中文标签

def draw_with_chinese(image, text, position, font_size=20, color=(255, 0, 0)):

image_pil = Image.fromarray(cv2.cvtColor(image, cv2.COLOR_BGR2RGB))

draw = ImageDraw.Draw(image_pil)

font = ImageFont.truetype(“simsun.ttc”, font_size, encoding=“unic”)

draw.text(position, text, font=font, fill=color)

return cv2.cvtColor(np.array(image_pil), cv2.COLOR_RGB2BGR)

动态调整参数

def adjust_parameter(image_size, base_size=1000):

max_size = max(image_size)

return max_size / base_size

绘制检测结果

def draw_detections(image, info, alpha=0.2):

name, bbox, conf, cls_id, mask = info[‘class_name’], info[‘bbox’], info[‘score’], info[‘class_id’], info[‘mask’]

adjust_param = adjust_parameter(image.shape[:2])

spacing = int(20 * adjust_param)

if mask is None:

x1, y1, x2, y2 = bbox

aim_frame_area = (x2 - x1) * (y2 - y1)

cv2.rectangle(image, (x1, y1), (x2, y2), color=(0, 0, 255), thickness=int(3 * adjust_param))

image = draw_with_chinese(image, name, (x1, y1 - int(30 * adjust_param)), font_size=int(35 * adjust_param))

y_offset = int(50 * adjust_param) # 类别名称上方绘制,其下方留出空间

else:

mask_points = np.concatenate(mask)

aim_frame_area = calculate_polygon_area(mask_points)

mask_color = generate_color_based_on_name(name)

try:

overlay = image.copy()

cv2.fillPoly(overlay, [mask_points.astype(np.int32)], mask_color)

image = cv2.addWeighted(overlay, 0.3, image, 0.7, 0)

cv2.drawContours(image, [mask_points.astype(np.int32)], -1, (0, 0, 255), thickness=int(8 * adjust_param))

# 计算面积、周长、圆度

area = cv2.contourArea(mask_points.astype(np.int32))

perimeter = cv2.arcLength(mask_points.astype(np.int32), True)

......

# 计算色彩

mask = np.zeros(image.shape[:2], dtype=np.uint8)

cv2.drawContours(mask, [mask_points.astype(np.int32)], -1, 255, -1)

color_points = cv2.findNonZero(mask)

......

# 绘制类别名称

x, y = np.min(mask_points, axis=0).astype(int)

image = draw_with_chinese(image, name, (x, y - int(30 * adjust_param)), font_size=int(35 * adjust_param))

y_offset = int(50 * adjust_param)

# 绘制面积、周长、圆度和色彩值

metrics = [("Area", area), ("Perimeter", perimeter), ("Circularity", circularity), ("Color", color_str)]

for idx, (metric_name, metric_value) in enumerate(metrics):

......

return image, aim_frame_area

处理每帧图像

def process_frame(model, image):

pre_img = model.preprocess(image)

pred = model.predict(pre_img)

det = pred[0] if det is not None and len(det)

if det:

det_info = model.postprocess(pred)

for info in det_info:

image, _ = draw_detections(image, info)

return image

if name == “main”:

cls_name = Label_list

model = Web_Detector()

model.load_model(“./weights/yolov8s-seg.pt”)

# 摄像头实时处理

cap = cv2.VideoCapture(0)

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

......

# 图片处理

image_path = './icon/OIP.jpg'

image = cv2.imread(image_path)

if image is not None:

processed_image = process_frame(model, image)

......

# 视频处理

video_path = '' # 输入视频的路径

cap = cv2.VideoCapture(video_path)

while cap.isOpened():

ret, frame = cap.read()

......

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式👇🏻

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献70条内容

已为社区贡献70条内容

所有评论(0)