5分钟搞定 Claude Code 接入本地大模型

Claude Code 对接本地大模型

·

背景

使用 Claude Code 需要解决科学上网、账号的问题,同时消耗 Tokens 也是非常恐怖的,基于 GB10 小盒子运行 Coding 模型试一下效果。

由于 Claude Code 已经和 OpenAI 分道扬镳,所以 Claude Code 请求模型的时候会有一些 OpenAI 风格不支持的接口,选用 LiteLLM 作为网关,串联 Claude Code 和 TensorRT-LLM ,总体路线如下:

1、部署运行大模型

此过程不再赘述,简单验证场景下给 max_num_tokens 66912,若上下文不足,将发生截断现象,实际上下文应该需要更多。

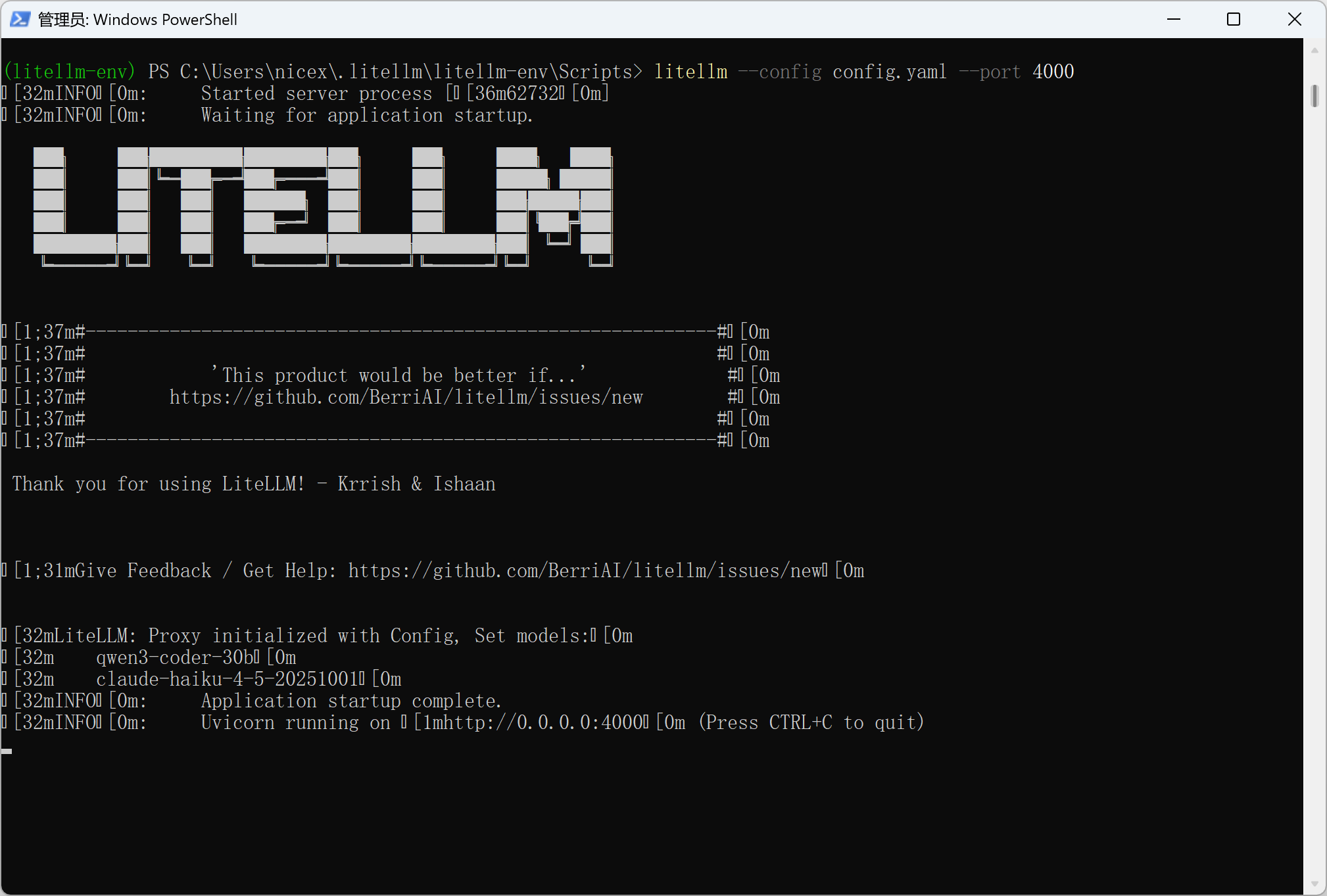

2、LiteLLM 网关

在本地办公 Windows 电脑激活虚拟环境

C:\Users\nicex\.litellm\litellm-env\Scripts\Activate.ps1

安装LiteLLM

pip install 'litellm[proxy]'

配置代理

model_list:

- model_name: qwen3-coder-30b

litellm_params:

model: openai/Qwen3-Coder-30B-A3B-Instruct

api_base: http://192.168.8.20:8100/v1

api_key: internal

drop_params: true #丢弃不支持的请求

max_tokens: 66912

- model_name: claude-haiku-4-5-20251001

litellm_params:

model: openai/Qwen3-Coder-30B-A3B-Instruct

api_base: http://192.168.8.20:8100/v1

api_key: internal

drop_params: true

max_tokens: 66912

litellm_settings:

drop_params: true

truncate_prompt_tokens: 66912

suppress_error_logs: true

strict_param_validation: false

启动LiteLLM

litellm --config C:\Users\nicex\.litellm\config.yaml --port 4000

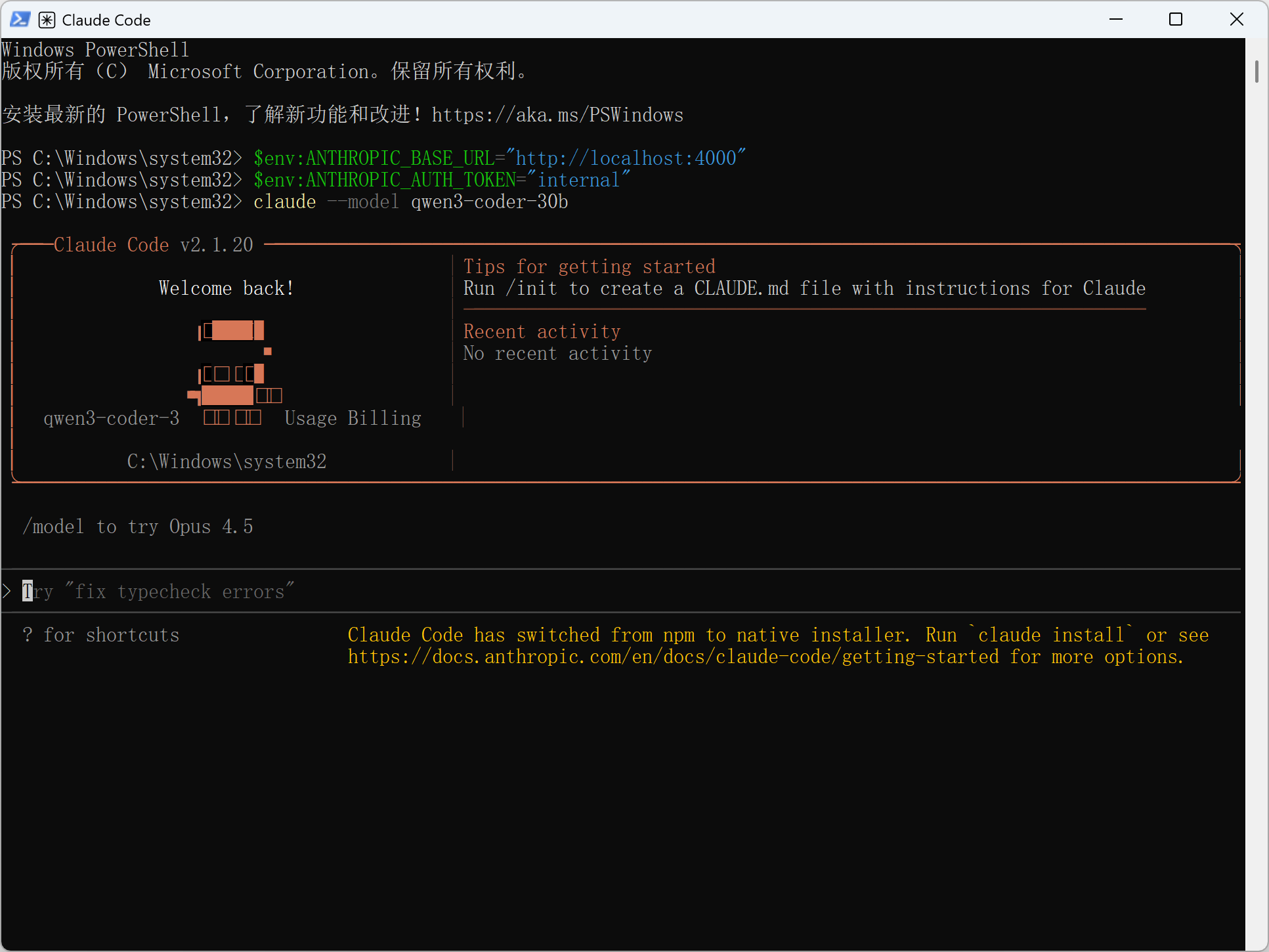

3、使用 Claude Code

安装方式这里不做赘述,参考官方文档

配置环境变量,使用本地 LiteLLM 代理的 大模型

$env:ANTHROPIC_BASE_URL="http://localhost:4000"

$env:ANTHROPIC_AUTH_TOKEN="internal"

启动 Claude Code

claude --model qwen3-coder-30b

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)