警告!99%的人都在用的PyTorch格式,存在致命缺陷!Safetensors才是大模型的“安全标准”!

在深度学习的世界里,一个模型往往包含成千上万个张量(tensor),它们共同记录了神经网络学习到的“知识”。这些张量需要被保存、传输和加载,这就离不开模型文件格式的支持。然而,传统的模型保存方式(如 Python 的 `pickle`)虽然方便,却隐藏着严重的安全风险。为了解决这一痛点,**Hugging Face** 团队设计了全新的存储格式——**safetensors**。

在深度学习的世界里,一个模型往往包含成千上万个张量(tensor),它们共同记录了神经网络学习到的“知识”。这些张量需要被保存、传输和加载,这就离不开模型文件格式的支持。

然而,传统的模型保存方式(如 Python 的 pickle)虽然方便,却隐藏着严重的安全风险。为了解决这一痛点,Hugging Face 团队设计了全新的存储格式——safetensors。

一、为什么要有 safetensors?

传统的 pickle 文件不仅会保存数据,还能执行任意 Python 对象的反序列化逻辑。

这意味着如果有人提供了一个“被动了手脚”的 .pkl 文件,一旦你加载它,可能会直接在你的机器上执行恶意代码。

这种“远程代码执行(RCE)”风险在开源模型生态中尤为危险。

safetensors 从设计之初就杜绝了代码执行的可能性,只允许保存和读取“纯张量数据”。换句话说,它只是一种安全、透明的张量容器。

二、safetensors 的核心结构

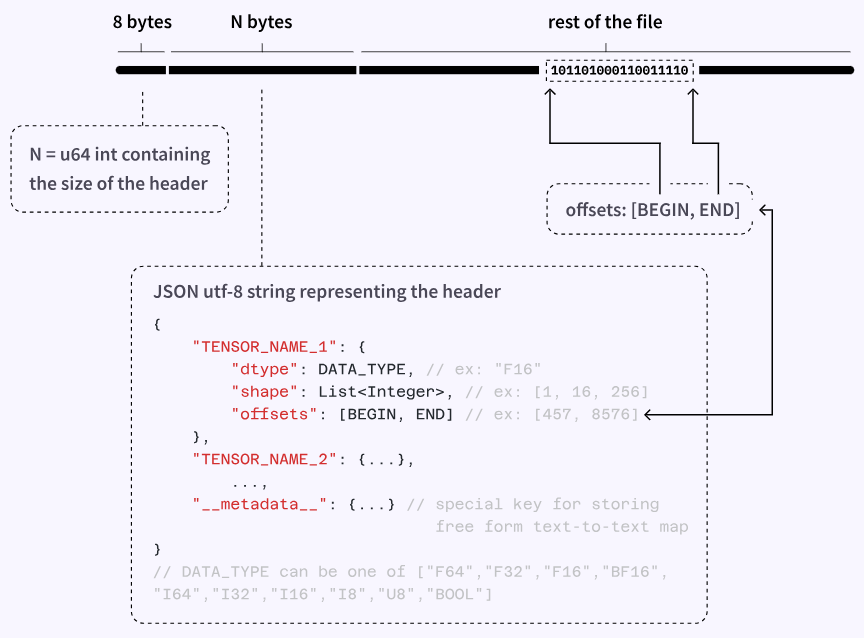

我们先看一眼 safetensors 文件的结构示意图 :

这张图展示了 safetensors 文件内部的逻辑布局。整个文件由三部分组成:

1️⃣ 文件头部(Header Size)

- 文件的前 8 个字节 用于存储一个无符号 64 位整数(

u64),表示接下来 Header 的大小。 - 它就像一本“目录”,告诉系统后面有多少字节是用于描述张量信息的。

2️⃣ Header(JSON 元信息)

- Header 部分是一段 UTF-8 编码的 JSON 字符串,包含了所有张量的元数据信息:

{

"TENSOR_NAME_1": {

"dtype": "F16",

"shape": [1, 16, 256],

"offsets": [457, 8576]

},

"TENSOR_NAME_2": { ... },

"__metadata__": { ... } // 可选的自定义信息

}

- 每个张量的定义包括:

- dtype:数据类型(如

F32、BF16、I8、BOOL等) - shape:张量的维度信息

- offsets:该张量在文件中实际数据的起始与结束位置(以字节为单位)

这使得 safetensors 文件能被解析得非常快,因为只需读取这段 JSON,就能立刻知道所有张量的布局。

3️⃣ 数据区(Tensor Data)

- 数据区保存了真正的二进制张量数据。

- 每个张量在文件中都是连续存储的,并通过 offsets 精确定位。

- 这种设计让程序在加载时可以直接使用内存映射(memory-mapping)技术,实现零拷贝加载(zero-copy) —— 也就是在无需额外复制的情况下直接访问文件内容。

三、设计理念与技术优势

🛡️ 安全性至上

safetensors 文件中不包含可执行代码。加载过程完全不依赖 Python 对象的反序列化逻辑,因此从根本上杜绝了 RCE 漏洞。

即使模型文件来源不明,也可以安全地使用。

⚡ 高速加载

safetensors 的“偏移定位 + 零拷贝”机制让模型加载速度极快。

在文件被操作系统缓存的情况下,加载一个大模型几乎是瞬间完成。

对需要频繁启动模型的生产系统而言,这意味着显著的性能收益。

🔄 跨框架兼容

safetensors 原生支持多个深度学习框架,包括:

- PyTorch

- TensorFlow

- JAX

因此,研究者可以在不同框架之间共享权重文件,而不必担心格式转换或兼容性问题。

🪶 轻量与高效

文件结构简单明晰,不包含冗余信息。

虽然 safetensors 本身不进行压缩,但它可轻松与 LZ4、Zstandard 等压缩算法配合使用,在保证加载速度的同时进一步减小体积。

✅ 类型安全

通过严格的 dtype、shape 校验,safetensors 能在加载阶段就检测潜在错误,避免因类型不匹配导致的运行时崩溃。

四、应用场景

- Hugging Face 模型分发标准

目前 Hugging Face Hub 上发布的多数模型都默认使用 safetensors 格式。

用户下载模型时不再需要担心安全问题,加载速度也显著提升。 - 跨框架协作与迁移

safetensors 让研究者可以在 PyTorch 中训练模型,然后在 JAX 或 TensorFlow 中直接加载权重。 - 生产环境与边缘部署

对于要求高并发、低延迟的模型服务场景,safetensors 的零拷贝特性可显著降低启动开销。

那么,如何系统的去学习大模型LLM?

作为一名深耕行业的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献174条内容

已为社区贡献174条内容

所有评论(0)