【完整源码+数据集+部署教程】钢铁缺陷图像分割系统: yolov8-seg-rtdetr

【完整源码+数据集+部署教程】钢铁缺陷图像分割系统: yolov8-seg-rtdetr

背景意义

随着工业自动化和智能制造的快速发展,钢铁行业面临着日益严峻的质量控制挑战。钢铁产品的质量直接影响到下游产业的安全性和可靠性,因此,及时、准确地检测和识别钢铁缺陷显得尤为重要。传统的人工检测方法不仅耗时耗力,而且容易受到人为因素的影响,导致检测结果的不稳定性和不准确性。为了解决这一问题,基于计算机视觉和深度学习的自动化缺陷检测技术逐渐成为研究的热点。

在众多深度学习模型中,YOLO(You Only Look Once)系列因其高效的实时目标检测能力而受到广泛关注。YOLOv8作为该系列的最新版本,结合了更先进的网络结构和算法优化,能够在保持高精度的同时实现更快的推理速度。然而,针对钢铁缺陷的具体应用场景,YOLOv8仍存在一些不足之处,例如对复杂背景的适应性不足、对小目标的检测能力有限等。因此,改进YOLOv8以适应钢铁缺陷图像分割的需求,具有重要的研究价值和实际意义。

本研究以“severstal-steel-defect-instance-segmentation”数据集为基础,包含6700幅钢铁缺陷图像,涵盖四类缺陷(class-1、class-2、class-3、class-4)。该数据集不仅提供了丰富的样本数据,还涵盖了多种类型的钢铁缺陷,为模型的训练和评估提供了良好的基础。通过对该数据集的深入分析,可以发现不同类型的缺陷在形态、颜色和纹理等方面存在显著差异,这为改进YOLOv8提供了有力的支持。

本研究的意义主要体现在以下几个方面:首先,通过改进YOLOv8的网络结构和训练策略,可以提高模型对钢铁缺陷的检测精度和分割能力,从而实现对钢铁产品质量的自动化监测。这不仅可以提高生产效率,降低人工成本,还能减少因缺陷产品造成的经济损失。其次,研究过程中所采用的图像分割技术,将为钢铁缺陷的定量分析提供新的思路和方法,有助于深入理解缺陷形成的机制,从而为后续的工艺改进提供科学依据。最后,本研究还将为相关领域的研究者提供一个可参考的模型和方法,推动钢铁缺陷检测技术的进一步发展。

综上所述,基于改进YOLOv8的钢铁缺陷图像分割系统的研究,不仅具有重要的理论意义,也具备广泛的应用前景。通过该研究,期望能够为钢铁行业的智能化转型提供有力的技术支持,推动行业的可持续发展。

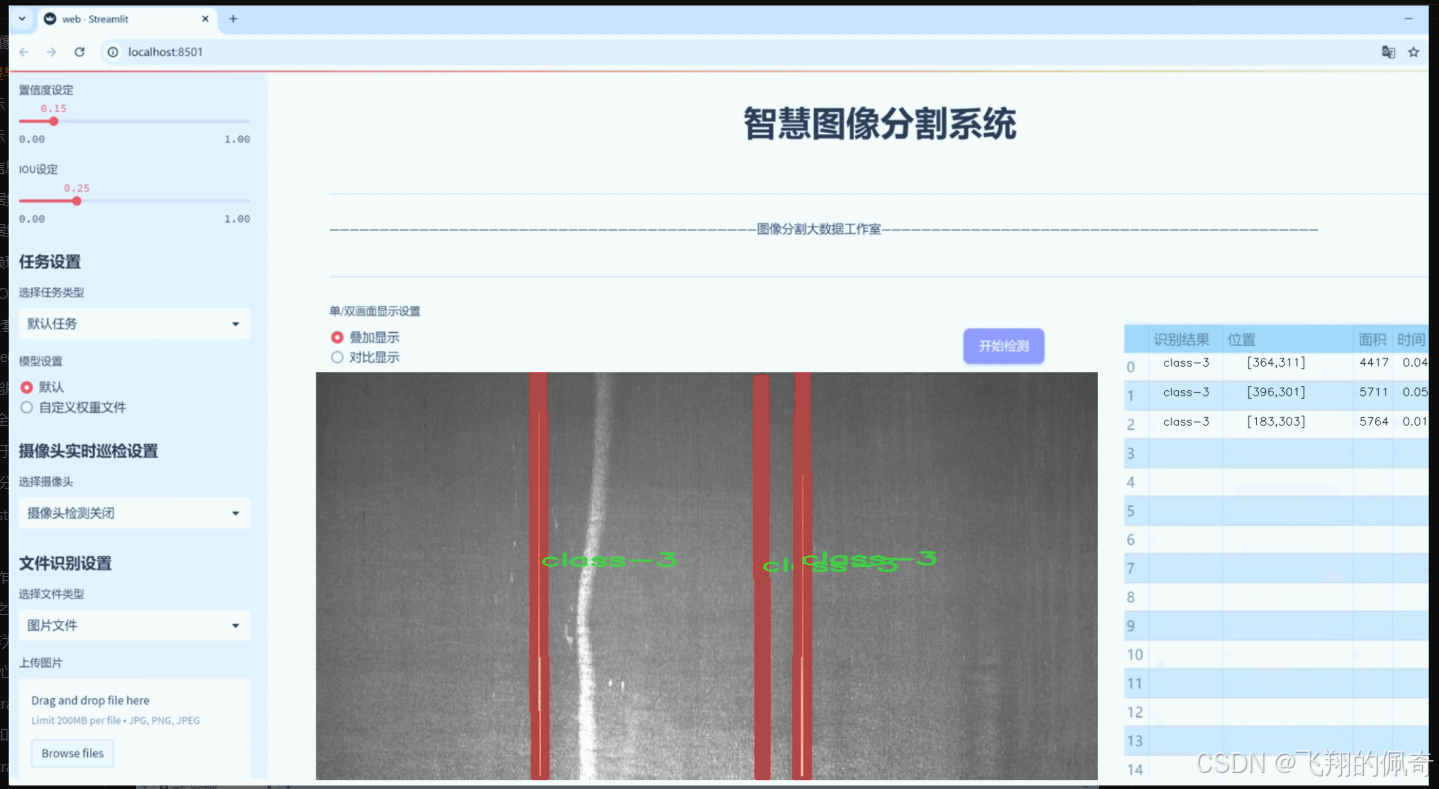

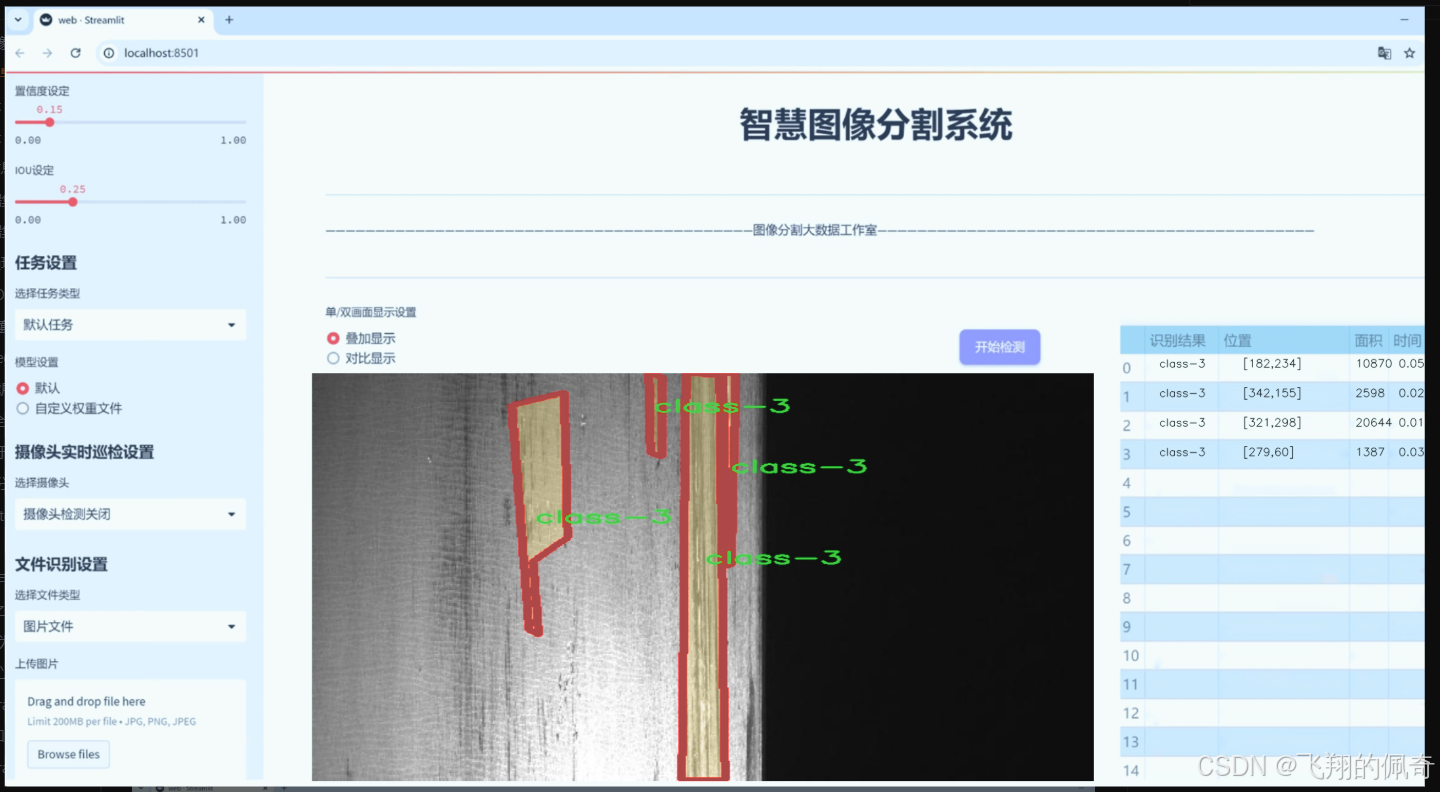

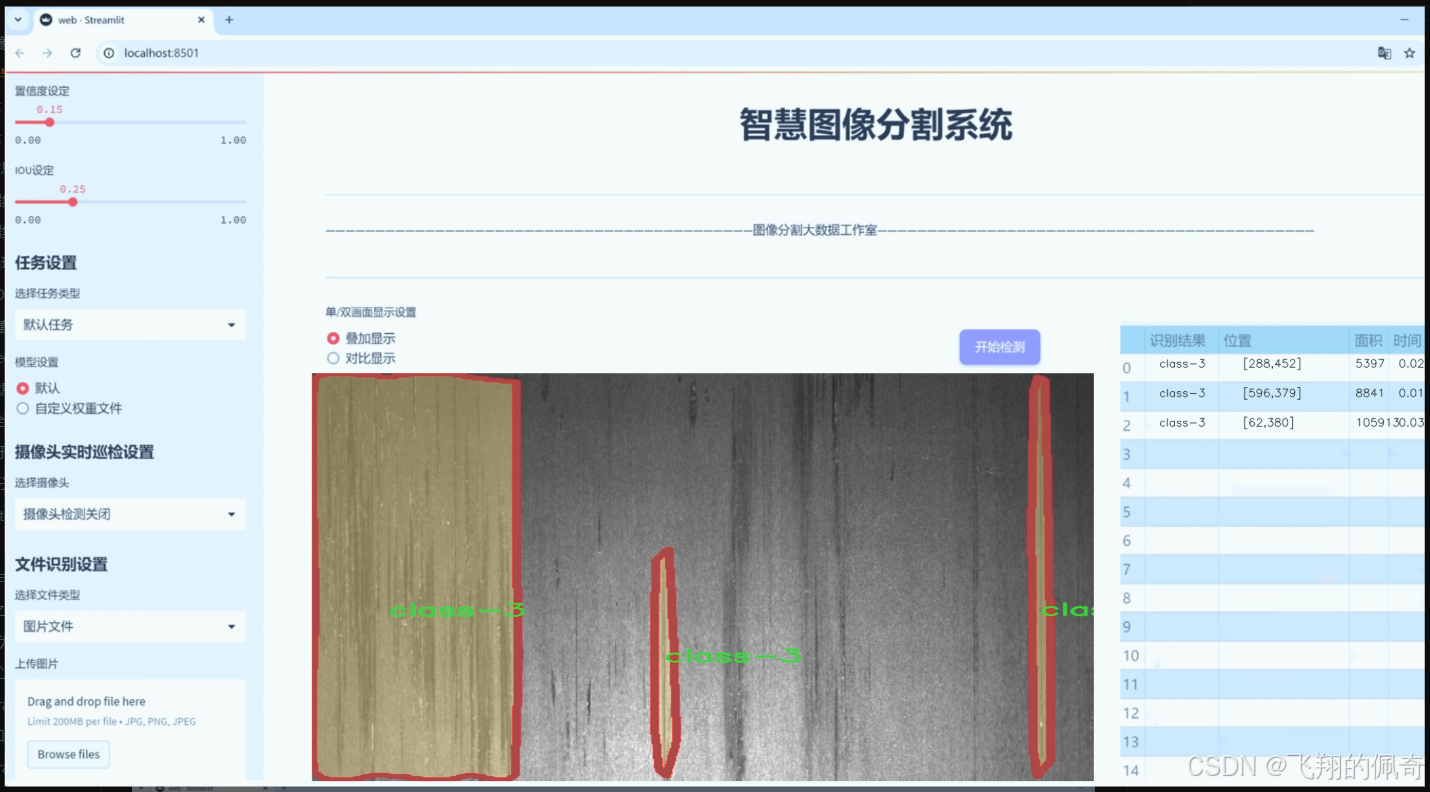

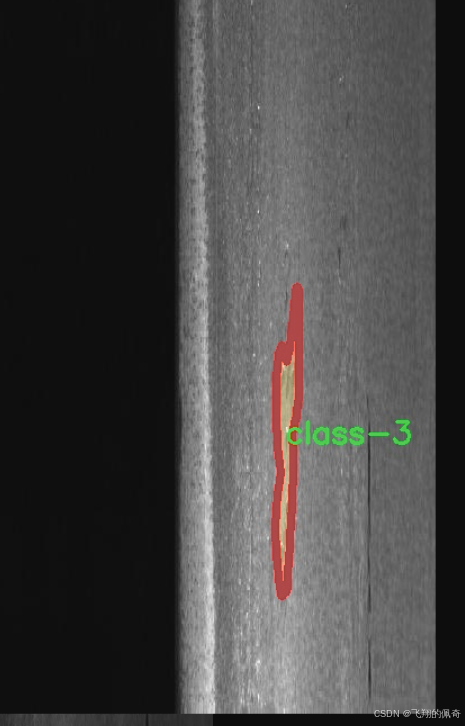

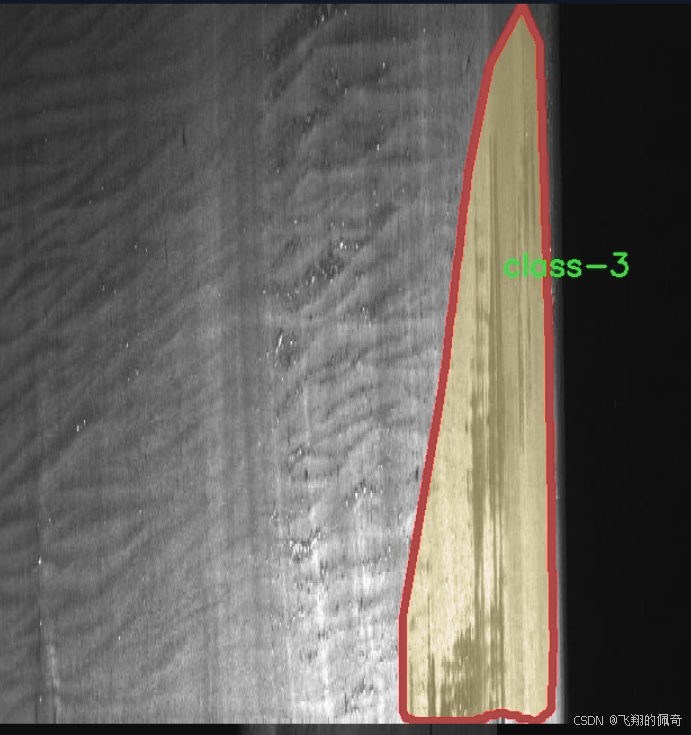

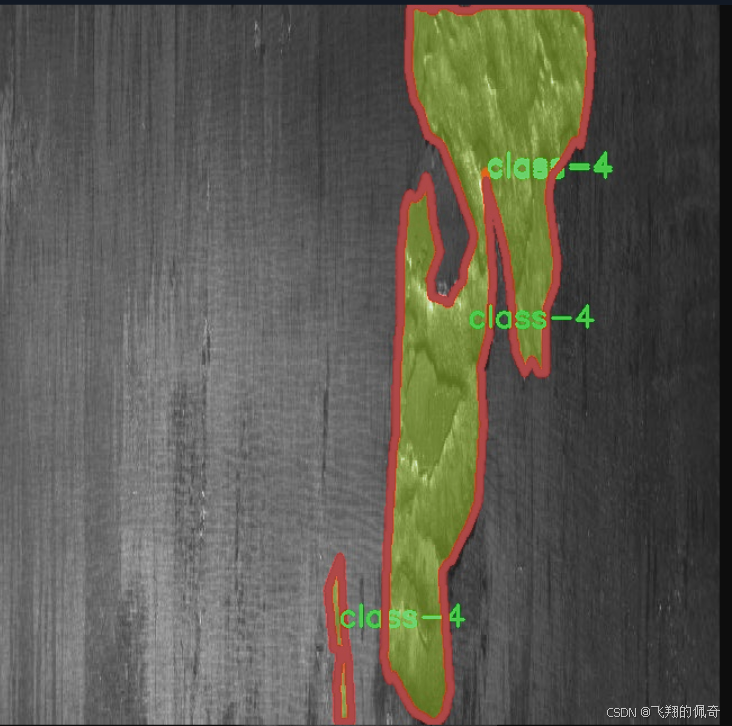

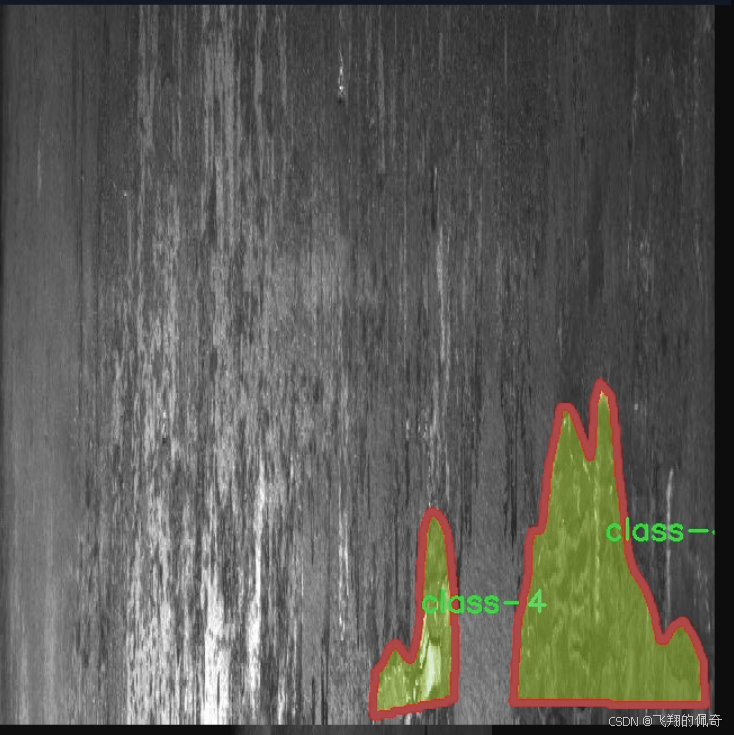

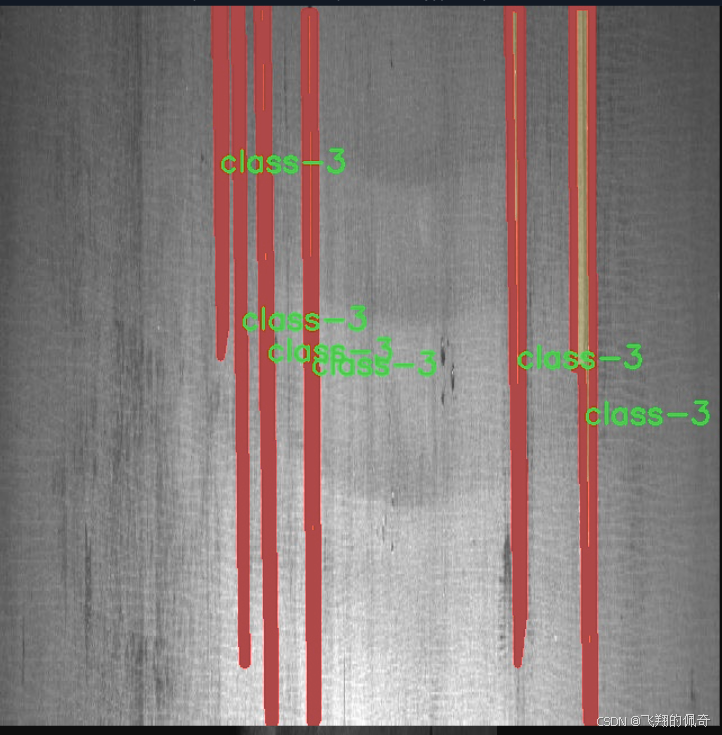

图片效果

数据集信息

数据集信息展示

在现代工业生产中,钢铁的质量直接影响到产品的性能和安全性。因此,及时发现和处理钢铁缺陷显得尤为重要。为此,我们使用了名为“severstal-steel-defect-instance-segmentation”的数据集,以训练和改进YOLOv8-seg的钢铁缺陷图像分割系统。该数据集专门针对钢铁表面缺陷进行了精心标注,旨在为机器学习模型提供高质量的训练数据,从而提高缺陷检测的准确性和效率。

该数据集包含四个主要类别,分别为“class-1”、“class-2”、“class-3”和“class-4”。每个类别代表一种特定类型的钢铁缺陷,这些缺陷可能会影响钢铁的使用性能和外观。具体而言,“class-1”可能代表了较为常见的表面划痕,而“class-2”则可能对应于更为复杂的缺陷,如气泡或夹杂物。“class-3”可能涉及到更严重的缺陷,例如裂纹,而“class-4”则可能包括其他类型的表面缺陷,如锈蚀或变色。通过对这些缺陷进行分类,我们能够为后续的图像分割和缺陷检测提供更为细致的指导。

数据集的构建过程非常严谨,确保了每个图像都经过专业人员的标注和审核。这不仅提高了数据的可靠性,也为模型的训练提供了坚实的基础。每个图像都包含了对应的缺陷区域标注,这些标注信息为YOLOv8-seg模型的训练提供了丰富的实例,使其能够在实际应用中更好地识别和分割钢铁表面的缺陷。

在训练过程中,YOLOv8-seg模型将利用这些标注数据进行学习,通过不断优化参数和调整网络结构,以提高其在钢铁缺陷检测中的表现。该模型不仅能够识别出缺陷的存在,还能够精确地分割出缺陷区域,从而为后续的自动化处理提供依据。这一过程的成功与否,直接依赖于数据集的质量和多样性。

此外,数据集的多样性也为模型的泛化能力提供了保障。通过包含不同类型和程度的缺陷图像,模型能够学习到更为丰富的特征,从而在面对新数据时,依然能够保持较高的检测准确率。这对于实际生产环境中的钢铁缺陷检测尤为重要,因为在真实场景中,缺陷的种类和表现形式可能会有所不同。

总之,“severstal-steel-defect-instance-segmentation”数据集为改进YOLOv8-seg的钢铁缺陷图像分割系统提供了坚实的基础。通过对四个类别的缺陷进行细致的标注和分类,该数据集不仅提高了模型的训练效果,也为钢铁行业的质量控制提供了强有力的技术支持。随着深度学习技术的不断发展,我们有理由相信,基于这一数据集训练出的模型将在钢铁缺陷检测领域发挥越来越重要的作用。

核心代码

以下是代码中最核心的部分,并附上详细的中文注释:

导入必要的库

from copy import copy

import torch

from ultralytics.models.yolo.detect import DetectionTrainer

from ultralytics.nn.tasks import RTDETRDetectionModel

from ultralytics.utils import RANK, colorstr

from .val import RTDETRDataset, RTDETRValidator

class RTDETRTrainer(DetectionTrainer):

“”"

RT-DETR模型的训练类,继承自YOLO的DetectionTrainer类,适应RT-DETR的特性和架构。

RT-DETR模型使用视觉变换器,并具有IoU感知查询选择和可适应的推理速度等能力。

“”"

def get_model(self, cfg=None, weights=None, verbose=True):

"""

初始化并返回一个用于目标检测任务的RT-DETR模型。

参数:

cfg (dict, optional): 模型配置,默认为None。

weights (str, optional): 预训练模型权重的路径,默认为None。

verbose (bool): 如果为True,则启用详细日志,默认为True。

返回:

(RTDETRDetectionModel): 初始化后的模型。

"""

# 创建RT-DETR检测模型实例

model = RTDETRDetectionModel(cfg, nc=self.data['nc'], verbose=verbose and RANK == -1)

# 如果提供了权重,则加载权重

if weights:

model.load(weights)

return model

def build_dataset(self, img_path, mode='val', batch=None):

"""

构建并返回用于训练或验证的RT-DETR数据集。

参数:

img_path (str): 包含图像的文件夹路径。

mode (str): 数据集模式,可以是'train'或'val'。

batch (int, optional): 矩形训练的批量大小,默认为None。

返回:

(RTDETRDataset): 特定模式的数据集对象。

"""

# 创建RT-DETR数据集实例

return RTDETRDataset(img_path=img_path,

imgsz=self.args.imgsz,

batch_size=batch,

augment=mode == 'train', # 训练模式下进行数据增强

hyp=self.args,

rect=False,

cache=self.args.cache or None,

prefix=colorstr(f'{mode}: '), # 添加模式前缀

data=self.data)

def get_validator(self):

"""

返回适合RT-DETR模型验证的DetectionValidator。

返回:

(RTDETRValidator): 用于模型验证的验证器对象。

"""

self.loss_names = 'giou_loss', 'cls_loss', 'l1_loss' # 定义损失名称

return RTDETRValidator(self.test_loader, save_dir=self.save_dir, args=copy(self.args))

def preprocess_batch(self, batch):

"""

预处理一批图像。缩放并将图像转换为浮点格式。

参数:

batch (dict): 包含一批图像、边界框和标签的字典。

返回:

(dict): 预处理后的批次。

"""

# 调用父类的预处理方法

batch = super().preprocess_batch(batch)

bs = len(batch['img']) # 批次大小

batch_idx = batch['batch_idx'] # 批次索引

gt_bbox, gt_class = [], [] # 初始化真实边界框和类别列表

for i in range(bs):

# 根据批次索引提取每个图像的真实边界框和类别

gt_bbox.append(batch['bboxes'][batch_idx == i].to(batch_idx.device))

gt_class.append(batch['cls'][batch_idx == i].to(device=batch_idx.device, dtype=torch.long))

return batch # 返回预处理后的批次

代码说明:

导入部分:导入了必要的库和模块,包括模型训练类、数据集类和验证器类。

RTDETRTrainer类:该类用于训练RT-DETR模型,继承自YOLO的DetectionTrainer类,包含了模型初始化、数据集构建、验证器获取和批次预处理等方法。

get_model方法:负责初始化RT-DETR模型并加载预训练权重。

build_dataset方法:构建训练或验证数据集,支持数据增强。

get_validator方法:返回适合RT-DETR模型的验证器。

preprocess_batch方法:对输入的图像批次进行预处理,包括缩放和格式转换,提取真实的边界框和类别信息。

这个程序文件是用于训练RT-DETR模型的,RT-DETR是百度开发的一种实时目标检测模型。该文件继承自YOLO的DetectionTrainer类,并对其进行了适应,以满足RT-DETR特有的功能和架构需求。RT-DETR模型结合了视觉变换器(Vision Transformers),具备IoU感知查询选择和可调推理速度等能力。

文件中首先导入了一些必要的库和模块,包括PyTorch和Ultralytics库中的相关组件。接着定义了RTDETRTrainer类,这个类主要负责模型的训练过程。

在RTDETRTrainer类中,get_model方法用于初始化并返回一个RT-DETR模型。该方法接受模型配置、预训练权重路径和是否启用详细日志的参数。如果提供了权重路径,模型会加载相应的权重。

build_dataset方法用于构建和返回一个RT-DETR数据集,适用于训练或验证。该方法接受图像路径、数据集模式(训练或验证)和批量大小作为参数,并返回一个RTDETRDataset对象。

get_validator方法返回一个适合RT-DETR模型验证的检测验证器(DetectionValidator)。在这个方法中,还定义了损失名称,包括giou_loss、cls_loss和l1_loss。

preprocess_batch方法用于预处理一批图像。它会对图像进行缩放并转换为浮点格式。该方法从父类中调用了预处理功能,并对每个图像的边界框和类别进行处理,确保它们与当前批次的索引相匹配。

总的来说,这个文件为RT-DETR模型的训练提供了必要的框架和功能,方便用户进行目标检测任务的训练和验证。

12.系统整体结构(节选)

整体功能和构架概括

Ultralytics项目是一个专注于目标检测和图像处理的深度学习框架,主要实现了YOLO(You Only Look Once)系列模型及其变种。该项目的架构模块化,包含多个子模块和工具,便于用户进行模型训练、验证和推理。每个模块都有其特定的功能,支持不同的任务,如目标检测、分类、跟踪等。

回调机制:通过ultralytics/utils/callbacks/base.py文件,提供了一个灵活的回调系统,允许用户在训练和验证过程中插入自定义逻辑。

模型接口:ultralytics/models/yolo/init.py文件定义了YOLO模型的公共接口,方便用户使用不同的功能(如分类、检测、姿态估计和分割)。

跟踪工具:ultralytics/trackers/utils/kalman_filter.py实现了卡尔曼滤波器,用于在图像空间中跟踪目标,适用于动态场景中的目标跟踪。

分类验证:ultralytics/models/yolo/classify/val.py文件提供了分类模型的验证框架,计算并输出模型的评估指标,支持可视化和结果分析。

RT-DETR训练:ultralytics/models/rtdetr/train.py文件实现了RT-DETR模型的训练流程,适应了实时目标检测的需求,支持模型的构建、数据集的创建和训练过程的管理。

文件功能整理表

文件路径 功能描述

ultralytics/utils/callbacks/base.py 定义训练、验证、预测和导出过程中的回调机制,允许用户自定义逻辑。

ultralytics/models/yolo/init.py 定义YOLO模型的公共接口,导入分类、检测、姿态估计和分割功能。

ultralytics/trackers/utils/kalman_filter.py 实现卡尔曼滤波器,用于动态目标的跟踪,支持不同的边界框表示。

ultralytics/models/yolo/classify/val.py 提供分类模型的验证框架,计算评估指标并支持结果可视化。

ultralytics/models/rtdetr/train.py 实现RT-DETR模型的训练流程,支持模型构建、数据集创建和训练管理。

这个表格总结了每个文件的主要功能,展示了Ultralytics项目的模块化设计和各个组件之间的协作关系。

13.图片、视频、摄像头图像分割Demo(去除WebUI)代码

在这个博客小节中,我们将讨论如何在不使用WebUI的情况下,实现图像分割模型的使用。本项目代码已经优化整合,方便用户将分割功能嵌入自己的项目中。 核心功能包括图片、视频、摄像头图像的分割,ROI区域的轮廓提取、类别分类、周长计算、面积计算、圆度计算以及颜色提取等。 这些功能提供了良好的二次开发基础。

核心代码解读

以下是主要代码片段,我们会为每一块代码进行详细的批注解释:

import random

import cv2

import numpy as np

from PIL import ImageFont, ImageDraw, Image

from hashlib import md5

from model import Web_Detector

from chinese_name_list import Label_list

根据名称生成颜色

def generate_color_based_on_name(name):

…

计算多边形面积

def calculate_polygon_area(points):

return cv2.contourArea(points.astype(np.float32))

…

绘制中文标签

def draw_with_chinese(image, text, position, font_size=20, color=(255, 0, 0)):

image_pil = Image.fromarray(cv2.cvtColor(image, cv2.COLOR_BGR2RGB))

draw = ImageDraw.Draw(image_pil)

font = ImageFont.truetype(“simsun.ttc”, font_size, encoding=“unic”)

draw.text(position, text, font=font, fill=color)

return cv2.cvtColor(np.array(image_pil), cv2.COLOR_RGB2BGR)

动态调整参数

def adjust_parameter(image_size, base_size=1000):

max_size = max(image_size)

return max_size / base_size

绘制检测结果

def draw_detections(image, info, alpha=0.2):

name, bbox, conf, cls_id, mask = info[‘class_name’], info[‘bbox’], info[‘score’], info[‘class_id’], info[‘mask’]

adjust_param = adjust_parameter(image.shape[:2])

spacing = int(20 * adjust_param)

if mask is None:

x1, y1, x2, y2 = bbox

aim_frame_area = (x2 - x1) * (y2 - y1)

cv2.rectangle(image, (x1, y1), (x2, y2), color=(0, 0, 255), thickness=int(3 * adjust_param))

image = draw_with_chinese(image, name, (x1, y1 - int(30 * adjust_param)), font_size=int(35 * adjust_param))

y_offset = int(50 * adjust_param) # 类别名称上方绘制,其下方留出空间

else:

mask_points = np.concatenate(mask)

aim_frame_area = calculate_polygon_area(mask_points)

mask_color = generate_color_based_on_name(name)

try:

overlay = image.copy()

cv2.fillPoly(overlay, [mask_points.astype(np.int32)], mask_color)

image = cv2.addWeighted(overlay, 0.3, image, 0.7, 0)

cv2.drawContours(image, [mask_points.astype(np.int32)], -1, (0, 0, 255), thickness=int(8 * adjust_param))

# 计算面积、周长、圆度

area = cv2.contourArea(mask_points.astype(np.int32))

perimeter = cv2.arcLength(mask_points.astype(np.int32), True)

......

# 计算色彩

mask = np.zeros(image.shape[:2], dtype=np.uint8)

cv2.drawContours(mask, [mask_points.astype(np.int32)], -1, 255, -1)

color_points = cv2.findNonZero(mask)

......

# 绘制类别名称

x, y = np.min(mask_points, axis=0).astype(int)

image = draw_with_chinese(image, name, (x, y - int(30 * adjust_param)), font_size=int(35 * adjust_param))

y_offset = int(50 * adjust_param)

# 绘制面积、周长、圆度和色彩值

metrics = [("Area", area), ("Perimeter", perimeter), ("Circularity", circularity), ("Color", color_str)]

for idx, (metric_name, metric_value) in enumerate(metrics):

......

return image, aim_frame_area

处理每帧图像

def process_frame(model, image):

pre_img = model.preprocess(image)

pred = model.predict(pre_img)

det = pred[0] if det is not None and len(det)

if det:

det_info = model.postprocess(pred)

for info in det_info:

image, _ = draw_detections(image, info)

return image

if name == “main”:

cls_name = Label_list

model = Web_Detector()

model.load_model(“./weights/yolov8s-seg.pt”)

# 摄像头实时处理

cap = cv2.VideoCapture(0)

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

......

# 图片处理

image_path = './icon/OIP.jpg'

image = cv2.imread(image_path)

if image is not None:

processed_image = process_frame(model, image)

......

# 视频处理

video_path = '' # 输入视频的路径

cap = cv2.VideoCapture(video_path)

while cap.isOpened():

ret, frame = cap.read()

......

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式👇🏻

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献145条内容

已为社区贡献145条内容

所有评论(0)