YOLOv5安全帽检测数据集及训练指南

随着工业4.0和智能制造理念的深入人心,确保现场工人的安全已经成为企业的重要职责。作为工业安全领域的一项重要应用,安全帽佩戴检测系统可以帮助实时监控工人是否佩戴了安全帽,从而预防潜在的安全事故。YOLOv5作为一种快速、准确的目标检测模型,在安全帽检测领域发挥着重要作用。本章节将详细阐述YOLOv5安全帽数据集的组成、重要性及相关的数据标注知识,为后续模型训练和应用落地奠定基础。安全帽数据集是训练

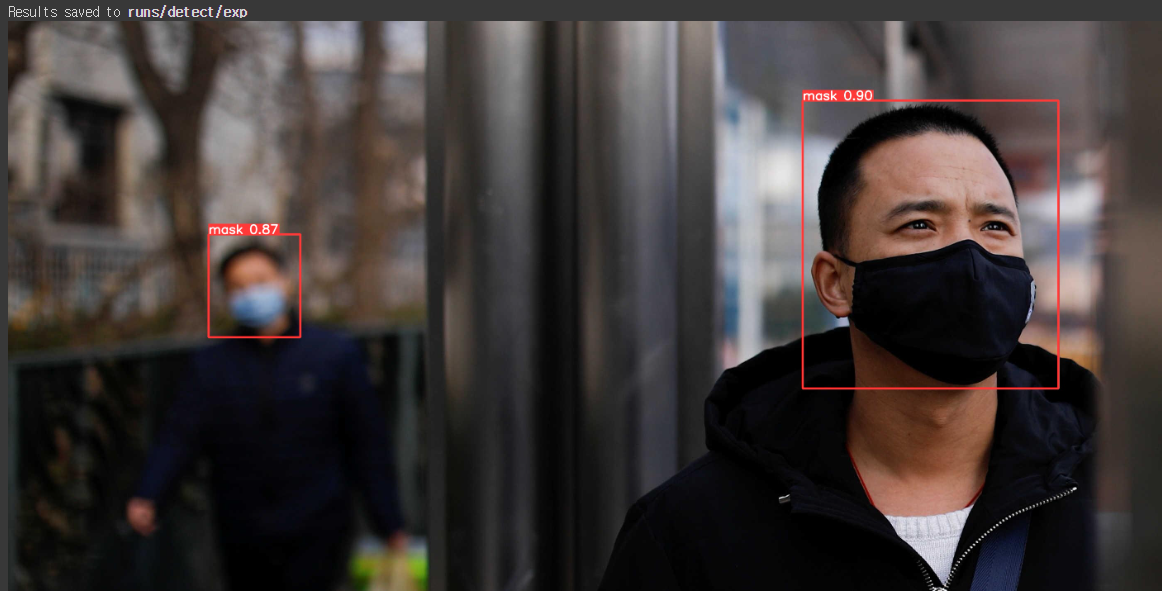

简介:在机器学习和计算机视觉中,一个高质量的数据集是训练目标检测模型不可或缺的基础。文章主要分析了“YOLOv5安全帽数据集带标签”的资源及其在训练模型中的关键作用。该数据集包含了约200张带有YOLO格式标签的图像,用于训练能够识别工地安全帽佩戴情况的模型。数据集的标签格式包括边界框坐标和类别信息,是模型学习识别安全帽位置和形状的重要依据。通过使用数据集进行训练,可以构建出在实际场景中具有重要安全价值的检测模型,并提供了详细的训练步骤和参数调整方法。

1. YOLOv5安全帽数据集概述

随着工业4.0和智能制造理念的深入人心,确保现场工人的安全已经成为企业的重要职责。作为工业安全领域的一项重要应用,安全帽佩戴检测系统可以帮助实时监控工人是否佩戴了安全帽,从而预防潜在的安全事故。YOLOv5作为一种快速、准确的目标检测模型,在安全帽检测领域发挥着重要作用。本章节将详细阐述YOLOv5安全帽数据集的组成、重要性及相关的数据标注知识,为后续模型训练和应用落地奠定基础。

安全帽数据集是训练和优化YOLOv5模型的关键资源。这个数据集包含了不同环境下、不同光照条件下、不同佩戴角度和遮挡情况下的安全帽图像,并配以准确的标签信息。通过这些数据,YOLOv5可以学习到如何在复杂场景中准确地识别和定位佩戴安全帽的人员。因此,数据集的质量和标注的准确性直接影响模型训练的效果和实际应用的准确性。

在此基础上,我们还将探究数据集构建的基本原理,包括数据标注的重要性和标注的标准流程。此外,本章将介绍安全帽检测数据集的具体内容和格式要求,为后续的数据预处理和模型训练工作提供必要的准备知识。下一章,我们将深入探讨目标检测模型训练的重要性,并分析其在实际场景中的应用挑战。

2. 目标检测模型训练重要性

2.1 目标检测技术的发展趋势

2.1.1 从传统算法到深度学习

在过去的十年中,目标检测领域经历了从传统算法到深度学习技术的转变。传统算法依赖于手工设计的特征提取器,如SIFT、HOG等,这些方法在特定的检测任务上表现良好,但缺乏通用性和对复杂场景的适应能力。随着计算机硬件性能的提升和大数据集的出现,卷积神经网络(CNN)成为了解决目标检测问题的主流方法。

深度学习方法能够自动学习到从低层到高层的丰富特征表示,极大地提升了目标检测的准确性和鲁棒性。特别是以YOLO(You Only Look Once)、Faster R-CNN、SSD(Single Shot MultiBox Detector)等为代表的一系列深度学习模型的提出,使得目标检测在速度和准确率上都取得了革命性的进步。

2.1.2 模型训练对于目标检测的意义

深度学习模型的性能高度依赖于高质量的训练数据和良好的训练策略。一个精心设计并训练的目标检测模型能够理解图像内容,并在各种复杂场景下准确地定位和识别目标。模型训练的目的是要最小化预测结果与真实标签之间的差异,即最小化损失函数。

在目标检测模型训练中,需要充分考虑模型的结构、数据预处理、训练参数等多方面因素。例如,通过数据增强技术来模拟数据的多样性,防止模型过拟合;通过适当的优化算法和学习率调度策略来加快模型收敛速度;通过对正负样本比例、批次大小和训练轮数的控制来提高模型的泛化能力。

2.2 安全帽检测在实际场景中的挑战

2.2.1 环境因素对检测准确性的影响

安全帽检测在实际应用中面临着诸多挑战,环境因素是其中之一。不同的工作环境光照条件变化多端,如强烈的阳光直射、阴影遮挡、雨雪天气等,这些都会影响到图像的质量。此外,安全帽本身的颜色和形状可能会与环境背景产生相似,进一步加大检测的难度。

为了解决这些问题,研究者们采取了多种手段,如引入图像增强技术来改善训练数据的多样性,采用不同的损失函数和正则化技术来提高模型的泛化能力。在模型设计方面,也有研究探索使用更鲁棒的特征提取器,如SENet(Squeeze-and-Excitation Networks)等,来增强模型对不同环境的适应性。

2.2.2 如何提高安全帽检测的鲁棒性

为了提高安全帽检测的鲁棒性,需要从多个角度考虑,包括但不限于数据集的质量、模型结构的设计、训练策略的优化。例如,可以通过构建一个多样化的数据集来模拟各种实际场景,确保模型能够学习到在不同条件下的检测能力。

在模型结构设计方面,可以考虑使用注意力机制来引导模型更加关注重要特征,同时抑制不重要的背景信息。在训练策略上,可以采用更复杂的优化算法和更细致的学习率调度策略,以提升模型的收敛速度和稳定性。这些优化手段的共同目标是提高模型在真实世界场景中的应用性能和准确性。

通过这些方法的综合应用,我们可以显著提升安全帽检测模型在实际工作环境中的表现,为安全生产提供强有力的技术支撑。

3. 安全帽检测数据集内容与格式

3.1 数据集的构建原理

3.1.1 数据标注的重要性

在目标检测任务中,数据标注是构建数据集不可或缺的一步。数据标注涉及到图像中每一个感兴趣的目标,并为其提供准确的边界框(bounding box)和类别标签。标注的准确性直接影响模型训练的效果。良好的标注可以确保模型在学习过程中正确地理解每个目标的形状和位置,以及与周围环境的关系。

为了保证标注质量,通常需要由经验丰富的标注员来完成,或者采用半自动化工具辅助标注,以提高效率和准确性。数据标注的流程包括选择合适的标注工具、定义标注类别、进行多次审核以及确保标注的一致性。

3.1.2 数据集标注标准和流程

数据集的标注标准和流程应遵循一致性原则,以确保所有标注图像之间具有可比性和一致性。制定标准时,需考虑目标物体的特征、环境因素以及标注工具体现的粒度。一个标准的标注流程大致可以分为以下几个步骤:

- 图像收集:确保图像质量满足模型训练的需求。

- 标注工具选择:选择适合当前任务的标注工具,例如LabelImg、CVAT等。

- 类别定义:明确每个类别的边界和定义,特别是相似类别之间的区分。

- 边界框标注:为图像中的每个目标对象绘制边界框。

- 标注审核:对标注结果进行多次审核,确保准确无误。

- 标注数据存储:将标注数据与原始图像配对,并以统一格式存储。

3.2 数据集的具体内容

3.2.1 图像来源和质量控制

在构建数据集时,图像来源的选择对最终模型的性能有着显著影响。数据集应包含多来源的图像,以覆盖尽可能多的场景和变化。高质量的图像应该是清晰、分辨率适中且具有良好的对比度。同时,为防止过拟合,图像也需要包含各种光照条件、天气状况、角度和距离。

质量控制措施主要包括:

- 图像筛选:根据清晰度、目标可见度等标准筛选图像。

- 图像增强:通过调整对比度、亮度、饱和度等方式增强图像。

- 数据清洗:删除噪声图像和不符合要求的样本。

3.2.2 标签信息及其编码方式

标签信息是模型训练中不可或缺的一部分。在安全帽检测数据集中,每个安全帽实例的边界框和标签(安全帽/非安全帽)要与图像同步记录。编码标签时,常用的编码方式包括整数编码、独热编码(One-Hot Encoding)和二进制编码等。

标签信息的编码应保证与模型训练框架兼容,并且容易读取和解析。例如,在使用TensorFlow或PyTorch框架时,标签信息通常存储为CSV或JSON格式的文件。

3.3 数据集的格式要求

3.3.1 常见数据格式的解析

数据集通常采用常见格式存储,如Pascal VOC、COCO、TFRecord等。每种格式都有其特定的文件结构和用途。

- Pascal VOC格式:通常包含XML文件存储标注信息,主要由目标的类别、边界框坐标、图像元数据等组成。

- COCO格式:一种更现代的格式,集成了图像、标注和目录信息,支持更复杂的标注类型。

- TFRecord格式:是TensorFlow官方推荐的一种格式,可以提供更高效的数据读取性能。

解析这些格式时,可以编写相应的读取函数,根据不同的格式解析出图像数据和标注数据,以便模型训练时使用。

import xml.etree.ElementTree as ET

import os

def parse_voc_annotation(xml_file):

tree = ET.parse(xml_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

boxes = []

labels = []

for obj in root.iter('object'):

difficult = obj.find('difficult').text

cls = obj.find('name').text

if int(difficult) == 1:

continue

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text),

float(xmlbox.find('ymin').text), float(xmlbox.find('ymax').text))

boxes.append(b)

labels.append(LABELS.index(cls))

return np.array(boxes), np.array(labels)

3.3.2 数据集格式对模型训练的影响

数据集的格式直接影响到模型训练的效率和效果。一个合理设计的数据集格式可以提高数据加载速度,从而减少模型训练的等待时间。同时,格式统一的数据集也便于进行数据增强,提高模型对不同场景的泛化能力。

在实际操作中,开发者通常根据所选深度学习框架提供的数据读取API来决定数据集的存储格式。例如,如果使用PyTorch进行训练,则会倾向于使用COCO格式或自定义的数据集类,因为它们可以利用PyTorch的DataLoader功能,实现多线程数据加载和批量处理,显著提升训练速度。

import torch

from torchvision import transforms, datasets

class CustomDataset(torch.utils.data.Dataset):

def __init__(self, annotation_file, img_dir, transform=None, target_transform=None):

self.img_labels = pd.read_csv(annotation_file)

self.img_dir = img_dir

self.transform = transform

self.target_transform = target_transform

def __len__(self):

return len(self.img_labels)

def __getitem__(self, idx):

img_path = os.path.join(self.img_dir, self.img_labels.iloc[idx, 0])

image = io.imread(img_path)

y_label = self.img_labels.iloc[idx, 1]

if self.transform:

image = self.transform(image)

if self.target_transform:

y_label = self.target_transform(y_label)

return image, y_label

数据集格式的选择和设计是数据准备过程中的关键步骤,合理的格式可以确保数据在后续模型训练、验证和测试阶段的高效利用。通过合适的格式,数据集可以更好地服务于目标检测任务,使模型训练更加精准和高效。

4. 安全帽检测模型的实际应用价值

4.1 安全帽检测模型在工业领域的应用

4.1.1 提升工业安全管理的智能化水平

随着工业4.0的推进,传统的安全管理方式逐渐向智能化、自动化方向转变。安全帽检测模型作为其中一个重要的组成部分,能够显著提升工业安全管理的智能化水平。模型通过实时监控视频流,能够在第一时间发现未佩戴安全帽的工作人员,从而触发警报并提醒相关人员。这样不仅提高了安全管理的效率,还减少了因违规操作造成的安全事故。

4.1.2 降低人工监管成本和潜在风险

在传统的安全监管体系中,需要大量的人员进行现场巡查,不仅耗时耗力,而且监管效果受人为因素影响较大。引入安全帽检测模型后,可以大幅减少人工监管的需求,降低人力成本。同时,由于模型的自动化监控特性,可以24小时不间断地对作业区域进行监控,进一步减少了因监管人员疏忽而导致的安全隐患。

4.2 模型技术推广的潜在市场和效益分析

4.2.1 市场需求调研与分析

安全帽检测模型的市场需求主要来自于工业生产和建筑行业,这些领域对安全管理有着严格的要求。据市场调研显示,随着安全法规的日益严格和人们安全意识的提升,安全帽检测模型的潜在市场规模正在不断扩大。同时,政府对于安全生产的补贴政策也促进了该技术的推广和应用。

4.2.2 模型应用的经济效益预测

安全帽检测模型的经济效益主要体现在两方面:一方面是直接经济效益,即通过减少安全事故带来的直接经济损失;另一方面是间接经济效益,如提升工作效率、减少人员监管成本等。通过对不同规模企业应用该模型前后的经济效益进行预测,可以发现,随着模型的普及,其对企业的长期经济效益具有显著的正面影响。

4.3 安全帽检测模型的推广面临的挑战

虽然安全帽检测模型的市场需求巨大,但其推广过程也面临着诸多挑战。首先,模型需要在不同的工业环境中进行适配和调整,以满足不同场景的使用需求。其次,对于一些规模较小的企业来说,前期投入的成本可能成为推广的障碍。此外,安全帽检测模型的准确性和鲁棒性仍然是用户最关心的问题,模型开发者需要不断提升技术,以获得市场和用户的信任。

4.4 安全帽检测模型的技术发展趋势

随着计算机视觉和机器学习技术的不断进步,安全帽检测模型的技术也在不断发展。未来的技术发展趋势可能包括更高的检测精度、更快的处理速度、更强的环境适应能力以及更灵活的部署方式。深度学习算法的不断优化和新算法的涌现,将进一步推动安全帽检测模型在工业领域的应用和普及。

4.5 安全帽检测模型的行业标准和法规

为了确保安全帽检测模型的有效性和可靠性,行业标准和相关法规的制定显得尤为重要。这不仅能够指导模型的开发和应用,还能保障用户的合法权益。例如,模型的准确率、响应时间、系统稳定性等方面都需要有明确的指标要求。政府和行业组织应协同工作,共同推动安全帽检测模型相关标准的建立和完善。

4.6 安全帽检测模型与人工智能伦理

在安全帽检测模型的应用过程中,不可忽视的还有与之相关的伦理问题。例如,监控数据的隐私保护、人工监管与机器监控的界限、数据偏差等问题。模型开发者在设计和实施过程中,应当充分考虑到这些伦理问题,并采取相应的措施来避免可能的伦理风险。只有在确保技术伦理的前提下,安全帽检测模型才能得到广泛的社会接受和应用。

在此,为了更形象地展示安全帽检测模型在工业领域的应用,让我们看一个具体的案例分析。

4.7 案例分析:某建筑工地的安全帽检测实施

应用背景

某建筑公司为了提高施工现场的管理效率和安全性,引入了基于YOLOv5的安全帽检测模型。该模型被部署在工地的多个关键入口和作业区域,对进出人员进行实时监控。

应用实施

在实施过程中,首先进行了数据集的采集和模型训练。为了保证模型的适应性,从不同角度、光照条件和遮挡情况收集了大量安全帽佩戴图像,并对模型进行了有针对性的训练。随后,模型被部署到现场,与现场的监控系统对接,开始实时检测工作。

应用效果

引入安全帽检测模型后,工地的未佩戴安全帽的违规行为明显减少,安全事故的发生率也有所下降。通过与传统人工监管方式的对比,数据显示模型在准确率和响应速度上均优于人工监管,大大提升了现场的安全管理水平。

持续优化

虽然模型初见成效,但应用过程中也发现了一些问题,比如在恶劣天气条件下的检测准确度下降、模型在动态复杂场景的适应性等问题。因此,公司定期对模型进行优化和更新,并结合工地反馈进行针对性调整,以确保模型的持续有效运行。

通过以上案例分析,我们可以看到安全帽检测模型在实际应用中的潜力和价值,同时也认识到持续优化和调整的重要性。随着技术的进步和市场的进一步开拓,安全帽检测模型将会在更多领域发挥其重要作用。

5. 数据集的预处理与训练步骤

在深度学习模型的训练过程中,数据集的预处理与训练步骤是影响最终模型性能的关键环节。本章将详细介绍数据集预处理的必要性和方法,以及训练步骤的详细流程。

5.1 数据集预处理的必要性和方法

数据集预处理是机器学习和深度学习任务的重要组成部分。良好的数据预处理能够提升模型的训练效率和预测准确性。

5.1.1 数据增强和清洗的技巧

数据增强技术通过人工增加样本的方式,增加模型的泛化能力。常用的数据增强方法有:旋转、缩放、裁剪、颜色变换、随机擦除等。

from imgaug import augmenters as iaa

# 定义数据增强序列

seq = iaa.Sequential([

iaa.Fliplr(0.5), # 随机水平翻转,概率为0.5

iaa.Affine(

scale={"x": (0.8, 1.2), "y": (0.8, 1.2)}, # 缩放变换

translate_percent={"x": (-0.2, 0.2), "y": (-0.2, 0.2)}, # 平移变换

rotate=(-10, 10) # 旋转变换

),

iaa.GaussianBlur(sigma=(0, 0.5)) # 高斯模糊

])

# 对单个图片进行增强的示例代码

image = cv2.imread('path_to_image')

image增强后的 = seq.augment_image(image)

5.1.2 数据标准化与归一化的原理

数据标准化和归一化是将数据转换到统一的尺度,消除不同特征之间的量纲影响。常用的方法有:Z-score标准化、最大-最小值归一化等。

import numpy as np

from sklearn.preprocessing import StandardScaler, MinMaxScaler

# 假设数据存储在numpy数组中

data = np.random.rand(100, 10) # 100个样本,10个特征

# 使用Z-score标准化

scaler_zscore = StandardScaler()

data_zscore = scaler_zscore.fit_transform(data)

# 使用最大-最小值归一化

scaler_minmax = MinMaxScaler()

data_minmax = scaler_minmax.fit_transform(data)

5.2 训练步骤详解

5.2.1 训练环境的搭建和配置

搭建适合深度学习模型训练的环境,通常包括选择合适的深度学习框架(如PyTorch、TensorFlow)、安装GPU驱动和CUDA、配置深度学习框架的后端等。

5.2.2 数据加载与批处理的实现

数据加载器是深度学习训练中的重要组件,负责从数据集中加载数据并形成批次。使用框架内置的数据加载器可以提高训练的效率。

import torch

from torch.utils.data import DataLoader

from torchvision import transforms, datasets

# 定义转换操作

transform = transforms.Compose([

transforms.Resize((224, 224)),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

# 加载数据集

train_dataset = datasets.ImageFolder(root='path_to_train_dataset', transform=transform)

train_loader = DataLoader(train_dataset, batch_size=32, shuffle=True)

# 使用for循环遍历加载的数据

for images, labels in train_loader:

# 此处可以添加模型训练的代码

pass

5.3 模型训练过程监控与调整

5.3.1 训练过程中的日志记录和分析

记录训练过程中的损失值和准确率等信息,可以使用TensorBoard等工具进行可视化,以便更好地监控和分析模型的训练状态。

5.3.2 模型权重保存与回调机制

保存模型权重是为了防止训练过程中出现意外导致模型丢失。回调机制允许在训练过程中的特定时刻触发某些操作,例如每轮训练结束时保存模型。

from torch.utils.tensorboard import SummaryWriter

from torch.optim.lr_scheduler import StepLR

# 实例化TensorBoard的Writer对象

writer = SummaryWriter(log_dir='path_to_log_directory')

# 训练过程中记录损失值

for epoch in range(num_epochs):

# 训练模型

train_loss = train_one_epoch(model, train_loader)

# 记录损失值

writer.add_scalar('Loss/train', train_loss, epoch)

# 关闭TensorBoard的Writer对象

writer.close()

# 定义学习率调整策略

scheduler = StepLR(optimizer, step_size=10, gamma=0.1)

for epoch in range(num_epochs):

# 训练和验证模型

train_one_epoch(model, train_loader, optimizer)

val_loss = validate_one_epoch(model, val_loader)

# 更新学习率

scheduler.step()

在本章节中,我们首先讨论了数据集预处理的必要性和方法,包括数据增强和清洗的技巧以及数据标准化与归一化的原理。接着,详细介绍了训练步骤的搭建和配置,数据加载与批处理的实现。最后,我们探讨了模型训练过程中监控与调整的方法,包括训练过程中的日志记录和分析,模型权重保存与回调机制。通过本章的学习,读者应能掌握从数据预处理到模型训练的全流程操作。

6. 训练参数设置(学习率、批次大小、训练轮数)

在进行深度学习模型的训练时,正确设置训练参数至关重要。本章节将深入探讨学习率、批次大小以及训练轮数这三个核心参数的设置方法和理论基础。

6.1 学习率的调整策略

学习率是神经网络训练中调整权重的重要参数,直接影响模型收敛的速度和质量。

6.1.1 学习率对模型训练的影响

学习率决定了模型在梯度下降过程中的步长大小。太高的学习率可能导致模型无法收敛,而太低的学习率则会使训练过程缓慢,甚至陷入局部最优解。

6.1.2 动态学习率调整方法

动态调整学习率可以解决固定学习率可能带来的问题。比较流行的动态学习率调整方法包括学习率预热(warmup)、学习率衰减(decay)和周期性调整等。例如,使用学习率预热可以让模型在训练开始时采取较小的学习率,随着训练的进行逐步增加,这有助于模型稳定地达到较好的收敛状态。

# 示例代码:使用PyTorch实现学习率预热和衰减策略

from torch.optim.lr_scheduler import LambdaLR

# 设置优化器

optimizer = torch.optim.SGD(model.parameters(), lr=0.01, momentum=0.9)

# 学习率预热函数

def lr_lambda(current_step):

return min(current_step / warmup_steps, 1.0)

# 学习率衰减函数

def lr_decay(current_step):

return 1 / (1 + decay_rate * current_step)

# 创建学习率调整策略

scheduler = LambdaLR(optimizer, lr_lambda=lambda current_step: lr_decay(current_step))

for epoch in range(num_epochs):

for batch in dataloader:

# 训练模型

pass

# 更新学习率

scheduler.step()

在上述代码中,我们定义了学习率预热和衰减函数,并使用 LambdaLR 作为学习率调整策略。通过调用 scheduler.step() ,在每个训练epoch结束时更新学习率。

6.2 批次大小的选取依据

批次大小(batch size)是每次迭代模型训练时用于计算梯度的数据点数量。

6.2.1 批次大小对内存和速度的影响

较小的批次大小会减少内存使用,但可能由于梯度估计的方差较大导致模型训练不稳定。相反,较大的批次大小可以提高内存利用率和训练速度,但可能导致模型收敛到局部最优解。

6.2.2 不同问题下的批次大小选取原则

在实际应用中,通常会根据模型和硬件资源来选取批次大小。一个常用的实践是首先尝试一个较小的批次大小,然后逐渐增加,直到找到模型性能不再提升的阈值。此外,由于GPU并行处理能力,适当的增加批次大小有助于充分利用GPU的计算资源。

6.3 训练轮数的确定

训练轮数(epochs)表示整个数据集通过模型的次数。

6.3.1 过拟合与欠拟合的识别

过拟合是指模型对训练数据学得过多,导致在新的数据上表现不佳。欠拟合则是模型未能捕捉到训练数据中的本质特征。通过观察训练和验证集上的性能差异,可以判断模型是否出现过拟合或欠拟合。

6.3.2 训练轮数与模型泛化能力的关系

合理的训练轮数可以帮助模型更好地泛化。通常,开始阶段模型的性能提升较快,但随着训练轮数的增加,性能提升会逐渐减缓甚至出现性能下降。因此,可以设定一个阈值或者使用提前停止(early stopping)策略来确定最佳的训练轮数。

通过上述详尽的分析和代码实现,我们可以看到,学习率、批次大小以及训练轮数的设置对模型的最终性能有直接的影响。一个细心调整的训练过程可以显著提升模型的准确性和泛化能力。在实际操作中,我们应根据具体问题和数据集特点,结合实验和经验来不断调整这些参数,以达到最佳效果。

7. 模型性能评估与优化策略

在深度学习领域,一个模型的性能好坏直接影响其实际应用的效果。因此,在模型训练完成后,必须进行严格的性能评估与优化。本章节将对性能评估指标、优化手段以及模型部署与实时监控进行详细讲解。

7.1 性能评估指标与方法

性能评估是验证模型准确性与鲁棒性的关键步骤。在目标检测任务中,常用的评估指标包括精确度(Precision)、召回率(Recall)以及平均精度均值(mean Average Precision,mAP)。

7.1.1 精确度、召回率和mAP的计算

精确度是衡量模型预测正例中实际正例占比的指标,召回率是衡量模型正确识别的正例占所有实际正例的比例。具体计算公式如下:

- 精确度 = 真正例(TP) / (真正例(TP) + 假正例(FP))

- 召回率 = 真正例(TP) / (真正例(TP) + 假负例(FN))

- mAP是根据不同的置信度阈值,计算对应精确度与召回率的平均值。

为了计算这些指标,我们通常会构建一个混淆矩阵,它是一个表格,用于显示实际类别与预测类别的对应关系。

7.1.2 混淆矩阵和ROC曲线的使用

混淆矩阵是评估分类模型性能的一个重要工具,它展示了实际类别与预测类别的组合情况。下面是一个混淆矩阵的例子:

| | 预测正例 | 预测负例 |

|------|---------|---------|

| 实际正例 | TP | FN |

| 实际负例 | FP | TN |

接收者操作特征曲线(ROC Curve)和其下的面积(AUC)也是评估模型性能的重要工具。ROC曲线展示了在不同阈值下的真正例率(TPR)与假正例率(FPR)的关系。

7.2 常见模型优化手段

为了提升模型的性能,通常会采取一系列的优化手段,以下是最常用的两种方法。

7.2.1 模型剪枝与量化

模型剪枝可以减少模型参数的数量,提高运算效率,同时减少过拟合的风险。而量化则是将模型中的浮点数参数转化为低精度的数据表示,以减少模型的存储和计算需求。

7.2.2 超参数优化与模型集成

超参数优化是调整模型训练中可手动设置的参数(如学习率、批次大小等),以找到最佳的性能。模型集成则是将多个模型的预测结果合并,以获得比单个模型更稳定和准确的预测。

7.3 模型部署与实时监控

模型训练完成后,如何部署和监控模型的实际运行,也是保证其长期稳定运行的关键步骤。

7.3.1 模型压缩与加速技术

模型压缩是减少模型大小和推理时间的技术,这对于在边缘设备上部署模型尤为重要。技术手段包括知识蒸馏、权重量化、剪枝等。

7.3.2 在线监控与反馈机制的建立

为了确保模型的可靠性,部署后的模型需要有一个在线监控系统。这个系统可以实时监控模型性能,包括延迟、吞吐量、预测准确率等。若发现问题,系统应能及时发出警报并触发人工干预。

graph LR

A[模型部署] --> B[在线监控系统]

B --> C[性能检测]

C -->|性能下降| D[反馈与报警]

D --> E[人工干预]

E --> F[问题解决]

F --> G[自动调整参数]

G --> B[在线监控系统]

C -->|性能稳定| H[继续监控]

通过上述章节的详细介绍,我们可以看出,模型性能评估与优化不仅是一个理论问题,更是一个实践问题。通过不断优化和调整,我们可以提高模型的实际应用效果,从而在安全帽检测等实际应用中发挥出更大的价值。

简介:在机器学习和计算机视觉中,一个高质量的数据集是训练目标检测模型不可或缺的基础。文章主要分析了“YOLOv5安全帽数据集带标签”的资源及其在训练模型中的关键作用。该数据集包含了约200张带有YOLO格式标签的图像,用于训练能够识别工地安全帽佩戴情况的模型。数据集的标签格式包括边界框坐标和类别信息,是模型学习识别安全帽位置和形状的重要依据。通过使用数据集进行训练,可以构建出在实际场景中具有重要安全价值的检测模型,并提供了详细的训练步骤和参数调整方法。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)