DEIM-DEIMv2: 一种高效的训练框架,用于加速DETR实时目标检测的收敛性

DEIMv2使用DINOv3带来的全新特征提取可部署在大中小终端上

DEIM: DETR with Improved Matching for Fast Convergence 发表在CVPR2025上。

🧨针对的问题

关于O2M和O2O可以参考:

https://blog.csdn.net/Jacknbv/article/details/149110080?spm=1001.2014.3001.5501

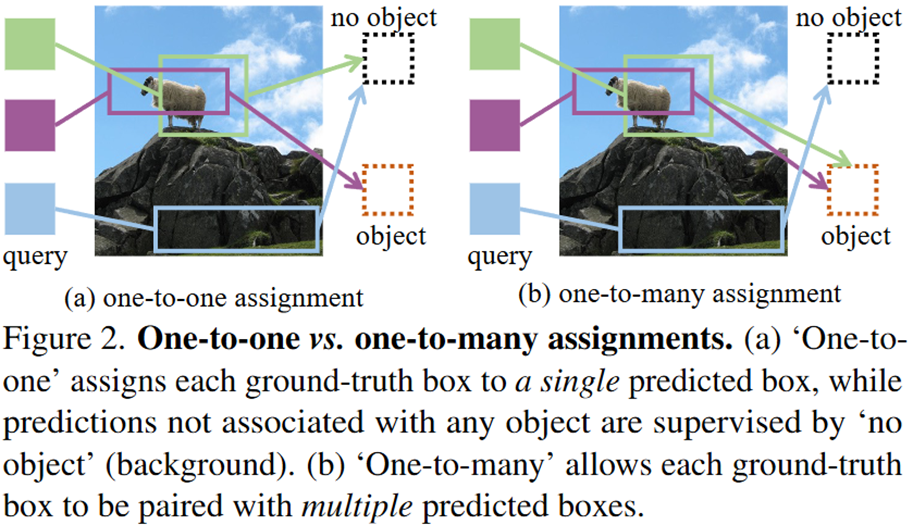

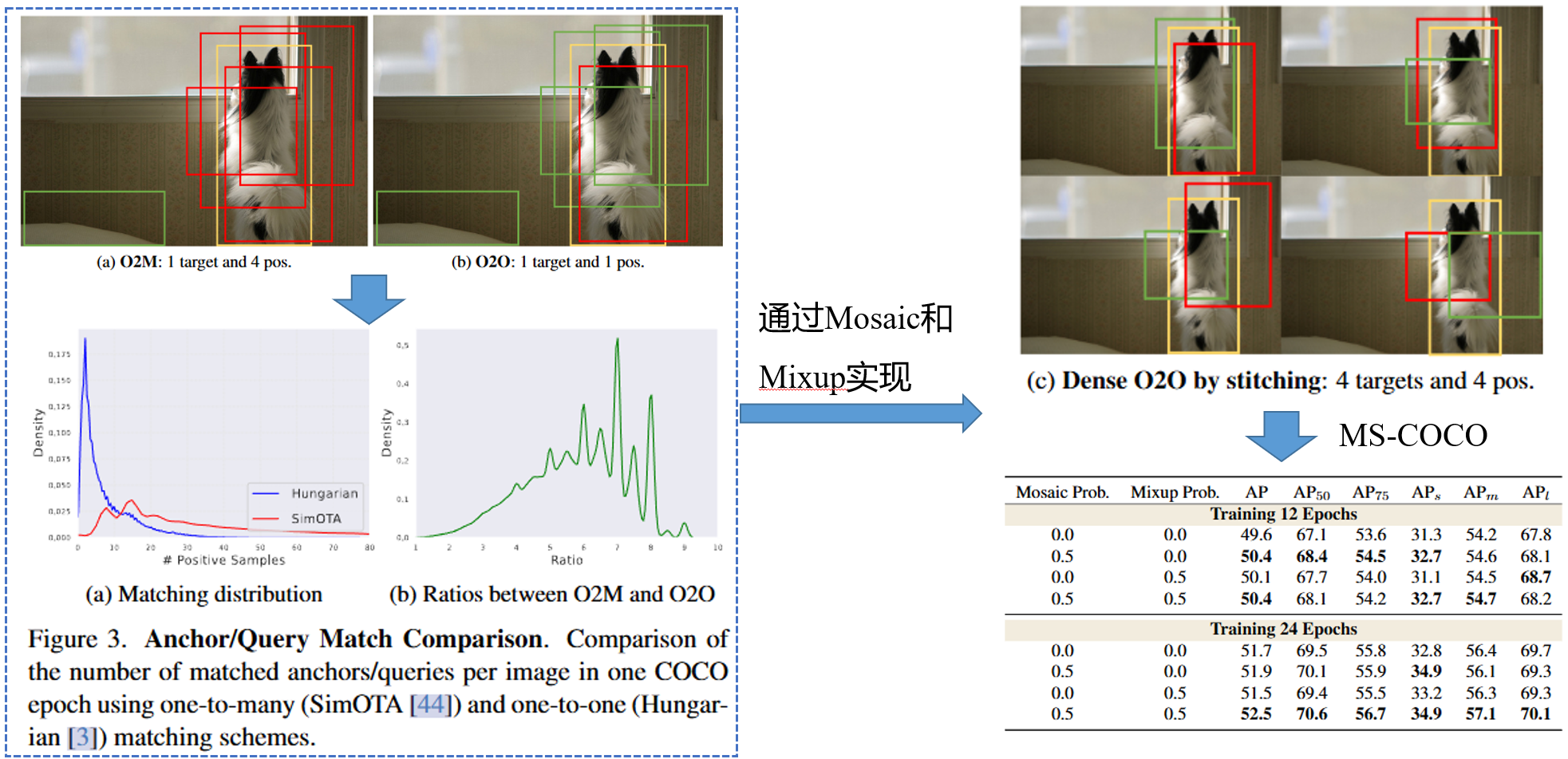

- One-to-many (O2M) 的策略提供了密集的监督信号,加速了模型收敛也增强了性能,但是使用NMS去除冗余框时会带来延迟和不稳定性。

- DETR使用了one-to-one(O2O)匹配策略,但是存在两个问题,分别是稀疏监督和低质量匹配(DETR使用少量anchors随机初始化queries,缺乏了空间对齐)。

🎉DEIM: DETR with Improved Matching for Fast Convergence

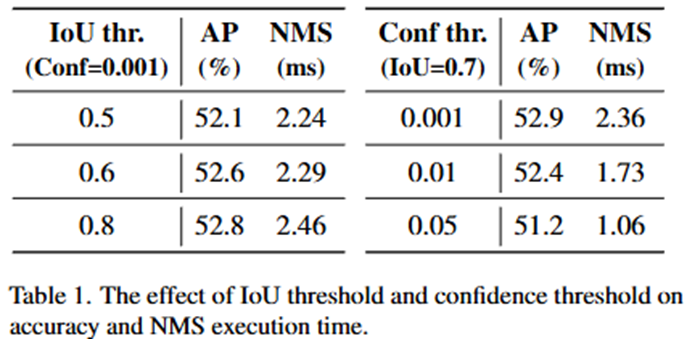

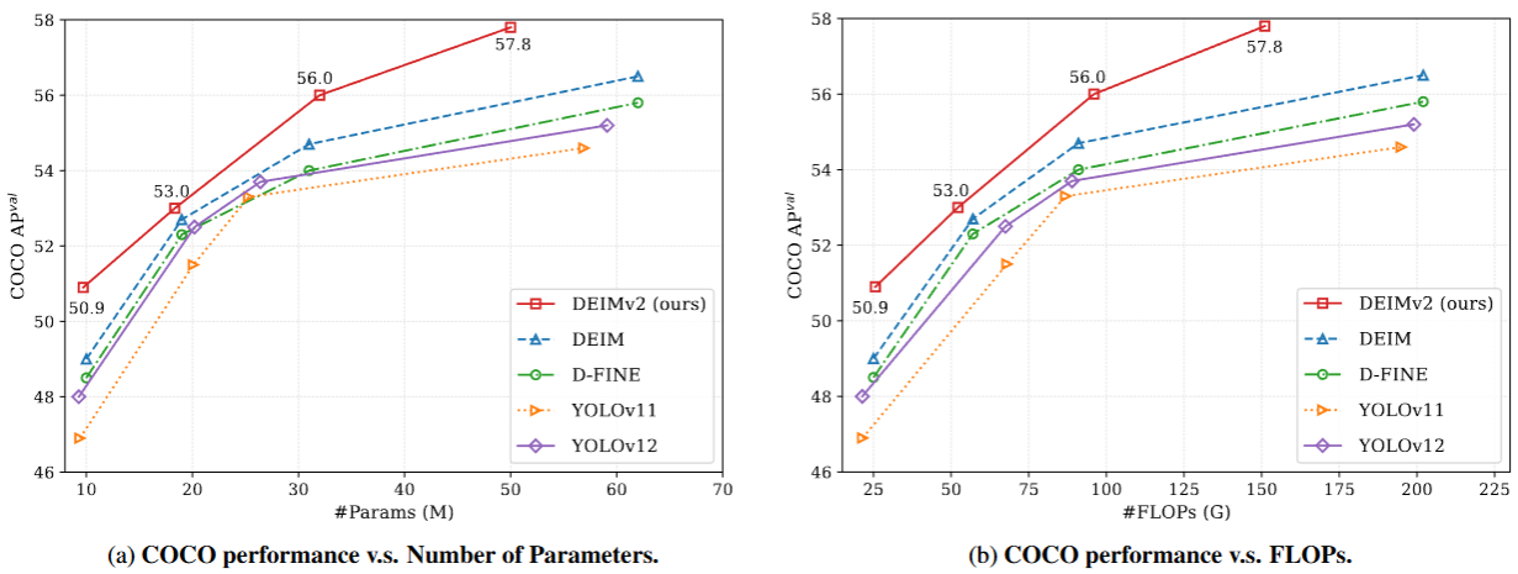

从结果上来看,DEIM的速度和实时检测性能超过了现在好的模型。

🥇方法

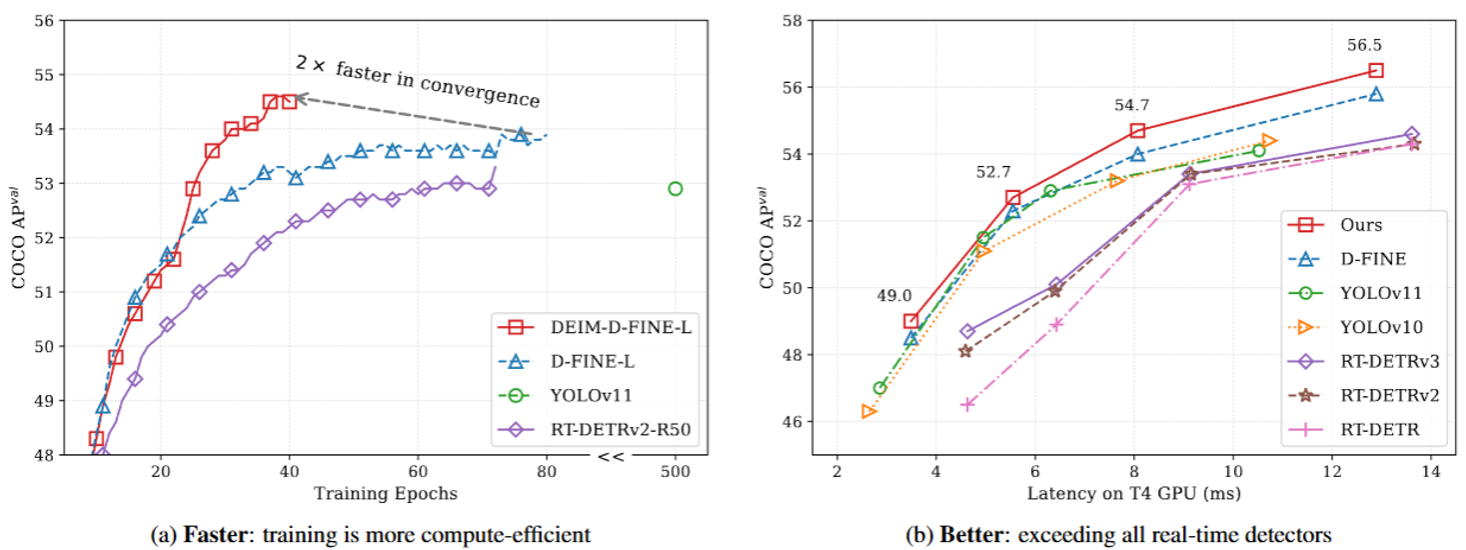

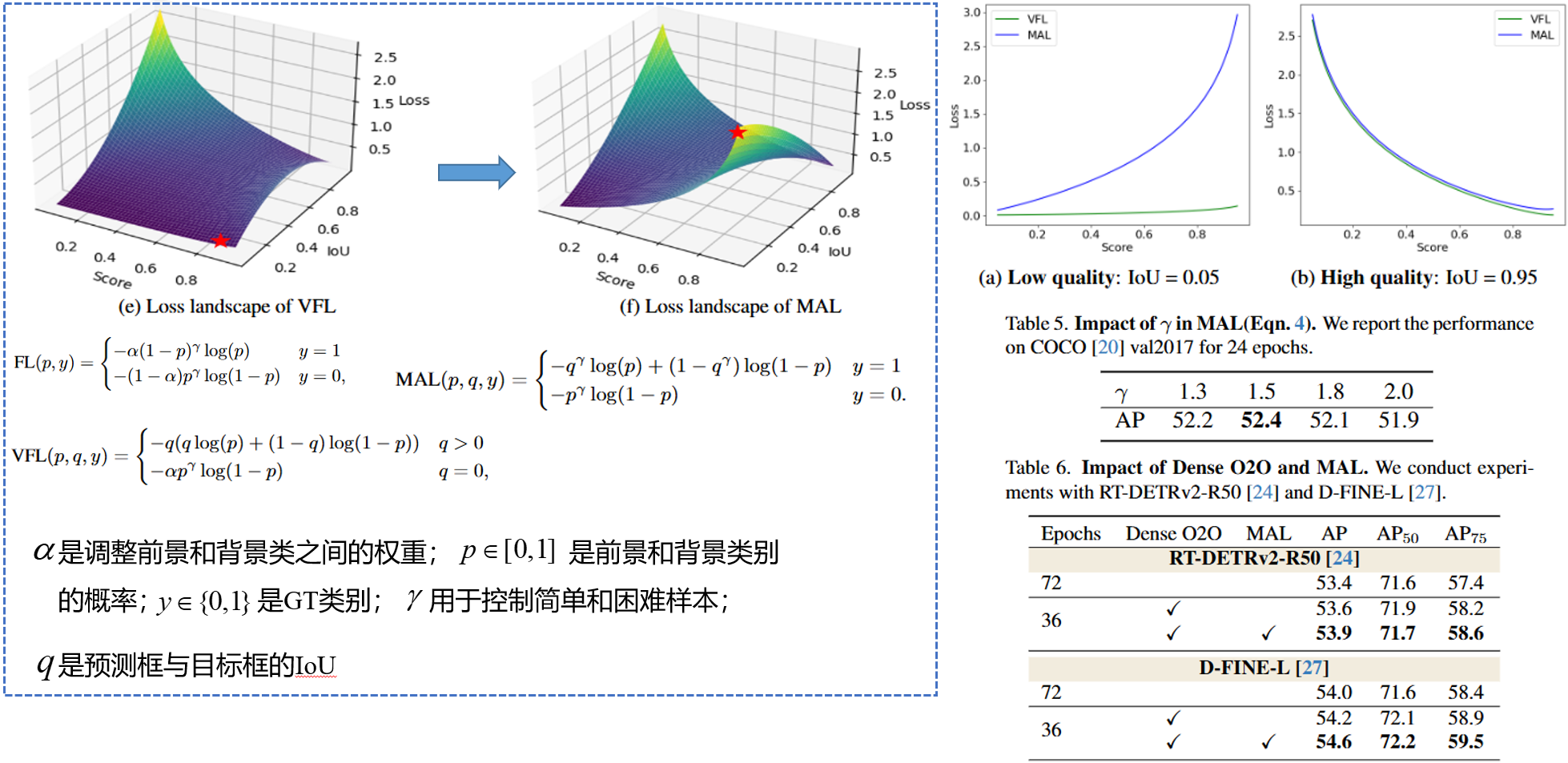

DEIM 分别通过提高与 Dense O2O 和 MAL 匹配的数量和质量来加速收敛。所谓的Dense O2O就是通过Mosaic和Mixup对数据进行了增强,让O2O可以达到O2M的效果而不占用任何资源。

MAL就是对VFL Loss进行了小的修改,将VFL的最小值给提升,让低质量的框也进去匹配。

🎊DEIMv2

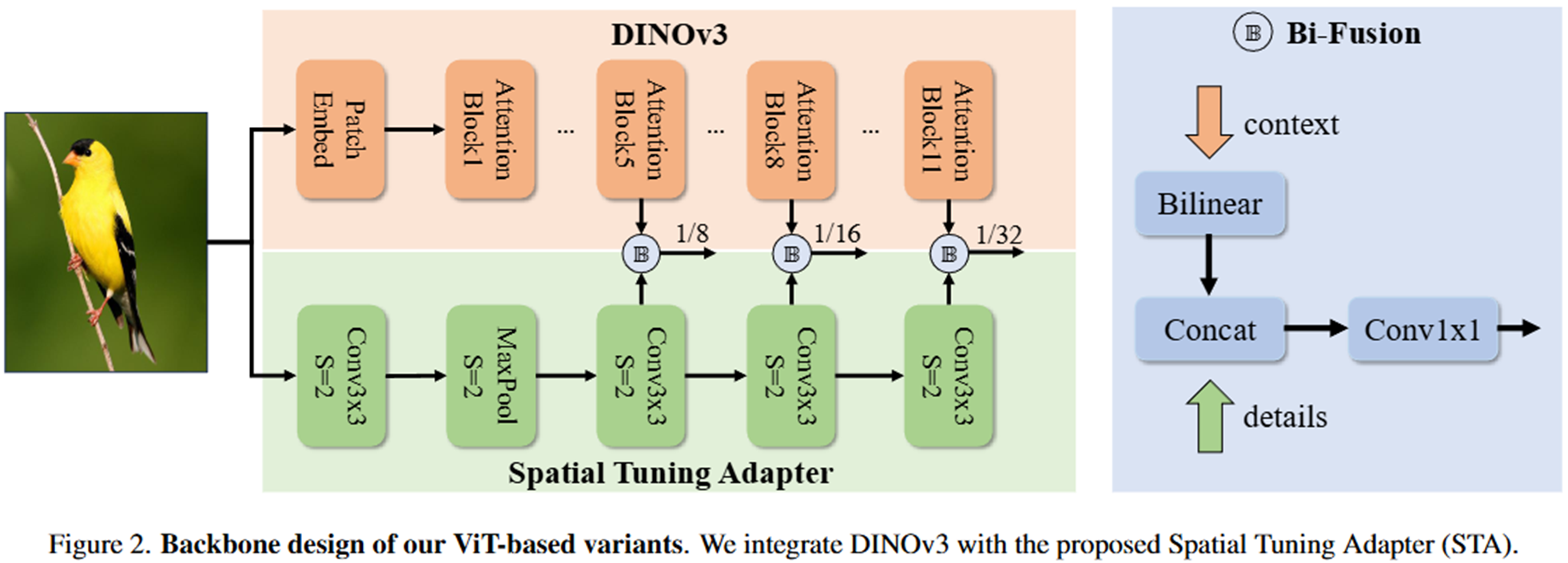

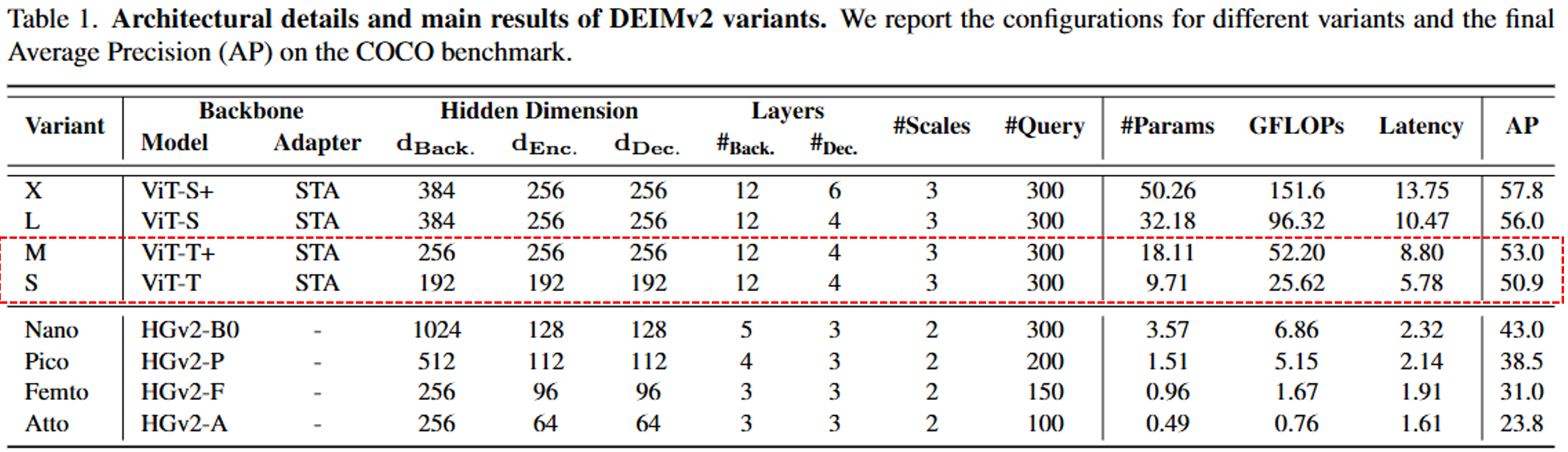

DEIMv2对X/L/M/S采用DINOv3预训练ViT Backbone,对Nano/Pico/Femto/Atto采用剪枝后的HGNetv2和STA。

DEIMv2对X/L/M/S采用DINOv3预训练ViT Backbone,对Nano/Pico/Femto/Atto采用剪枝后的HGNetv2和STA。

深度剪枝:移除HGNetv2-B0的第4阶段,仅保留到1/16尺度输出(Pico变体)

宽度剪枝:减少最后一层的通道数(Atto变体将通道从512压缩到256)

阶段简化:减少每个阶段的Block数量(Femto变体将Pico的最后阶段Block数从2减至1)

在Decoder部分:

SwiGLUFFN替代传统FFN

RMSNorm替代LayerNorm

共享Query位置嵌入:所有Decoder层复用同一组位置嵌入,直接减少了(层数-1)倍的位置嵌入计算量

增强Dense O2O:DEIMv2进一步引入Copy-Blend将新目标与原图背景融合,避免了背景信息丢失;仅添加目标区域,不引入冗余背景

以上就是DEIM两个版本的方法,实验部分就不在此赘述了!

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)