计算机视觉(opencv)实战二十三——图像拼接

找特征点—— 让不同图像有可比较的“锚点”。找匹配对—— 确定哪些锚点在两张图中是同一个物理点。算变换矩阵—— 求出两张图的几何关系,让它们坐标对齐。透视变换 + 融合—— 把图像映射到同一平面并拼合。本文通过SIFT 特征提取 → 特征匹配 → RANSAC 单应性矩阵 → 透视变换与拼接,完成了图像拼接任务。该方法对光照、旋转、尺度具有较强鲁棒性,但在大视差、非平面场景下可能出现拼接误差,实际

下面是一篇基于你提供代码的图像拼接文章,我按照原理 → 代码 → 结果的顺序来组织,帮助读者理解从特征提取到透视变换、最后拼接的完整流程。

图像拼接原理与实现

图像拼接(Image Stitching)是计算机视觉中的经典应用,通过对多幅有重叠区域的图像进行配准和融合,生成一幅视野更宽广的全景图。本文将从原理入手,再给出完整代码实现,并解释关键函数的作用。

一、图像拼接的原理

图像拼接的核心问题是:找到两幅图像之间的几何变换关系,并将它们拼接到同一个坐标系下。具体步骤如下:

1. 特征点检测与描述

首先,需要在两幅图像中找到具有区分度的特征点。常用方法有 SIFT(尺度不变特征变换)、SURF、ORB 等。

SIFT 能够检测图像中的局部关键点,并计算每个关键点的描述符(128维特征向量),描述符具有旋转、尺度不变性,因此非常适合用于图像拼接。

2. 特征匹配

通过计算两幅图像中描述符的欧式距离,找到每个特征点的最佳匹配点。为了提高匹配的可靠性,常用 比值测试(Lowe’s ratio test) 进行筛选:当最近邻距离与次近邻距离的比值小于阈值(一般取 0.6~0.75),保留该匹配。

3. 计算单应性矩阵(Homography)

当两幅图像的关系为平面透视变换时,可以用 单应性矩阵 H 表示其对应关系。我们通过匹配点对计算 H,使得一幅图像可以通过透视变换映射到另一幅图像的坐标系。

常用方法:

-

最小二乘法:对所有匹配点求解,容易受异常点干扰。

-

RANSAC:随机采样一致性算法,能够鲁棒地剔除错误匹配点,是拼接任务的常用方法。

4. 图像透视变换与融合

利用计算得到的 H,将一幅图像透视变换到另一幅图像的坐标系,并进行拼接。为了视觉效果更自然,实际应用中还会进行多频段融合(如羽化、渐变混合),本文示例使用最简单的直接覆盖。

原理

图像拼接的原理

图像拼接(Image Stitching)是一种将多幅存在重叠区域的图像无缝地拼合为一幅大图的技术。它的核心目标是找到图像之间的几何关系,把它们映射到同一个坐标系并进行融合。拼接的基本流程通常包括以下几个关键步骤:

1. 特征检测与描述

首先,需要在每张图像中找到一些稳定且具有区分度的点,这些点在不同图像中都能被可靠地检测到。常用的算法有:

SIFT(尺度不变特征变换)

SURF、ORB、Harris、FAST 等

以 SIFT 为例,它的核心思想是:

在图像的不同尺度上寻找极值点(关键点),保证尺度不变性。

为每个关键点分配方向,使得特征描述符具有旋转不变性。

生成 128 维特征向量描述关键点周围的局部梯度分布,用于匹配。

这样,即使图像发生缩放、旋转、亮度变化,仍然能匹配到相同的物体区域。

2. 特征匹配

对两幅图像的特征描述符进行匹配,寻找最相似的点对。常用的匹配方法:

暴力匹配(Brute-Force Matcher):计算所有描述符的欧氏距离,选出最近的匹配。

FLANN(快速近似最近邻):适合大规模特征匹配,速度更快。

为了去除错误匹配点,通常使用 比值测试(Lowe's Ratio Test):

若最近邻距离 < 次近邻距离 × 阈值(如 0.7),则保留该匹配点,否则舍弃。

3. 计算单应性矩阵(Homography)

当两幅图像的拍摄场景可以近似认为是平面(或者摄像机只发生旋转),两幅图像的坐标变换关系可以用单应性矩阵 H 表示:

[x′y′1]=H[xy1]\begin{bmatrix} x' \\ y' \\ 1 \end{bmatrix} = H \begin{bmatrix} x \\ y \\ 1 \end{bmatrix}其中,

(x,y)(x, y) 是图像 B 的坐标点,

(x′,y′)(x', y') 是映射到图像 A 的坐标点,

HH 是 3×33 \times 3 的单应性矩阵,只有 8 个自由度(最后一个元素通常归一化为 1)。

通过匹配点对,可以建立方程求解 H。

为了剔除错误匹配,常用 RANSAC(随机采样一致性算法):

随机选择四对匹配点,计算临时 H。

计算其他匹配点在该 H 下的重投影误差,统计内点数。

迭代多次,选出内点数最多的 H 作为最终结果。

4. 图像配准与透视变换

有了 H,就可以将图像 B 通过 透视变换(Perspective Transform) 映射到图像 A 的坐标系,实现几何对齐。

数学上,通过 (x′,y′,w′)=H⋅(x,y,1)T(x',y',w') = H \cdot (x,y,1)^T 计算映射后的齐次坐标,再除以 w′w' 得到真实坐标。

5. 图像融合

最后,将对齐后的图像进行融合,生成一幅无缝的拼接图。常见方法:

直接覆盖:简单粗暴,但可能有明显接缝。

加权融合:对重叠区域做加权平均,减少突兀。

多频段融合(Laplacian Pyramid Blending):多尺度平滑拼接,效果最佳。

核心思想总结

图像拼接的原理可以概括为四步:

找特征点 —— 让不同图像有可比较的“锚点”。

找匹配对 —— 确定哪些锚点在两张图中是同一个物理点。

算变换矩阵 —— 求出两张图的几何关系,让它们坐标对齐。

透视变换 + 融合 —— 把图像映射到同一平面并拼合。

二、完整代码实现

图片准备:

运行结果:

import cv2

import numpy as np

import sys

def cv_show(name, img):

cv2.imshow(name, img)

cv2.waitKey(0)

# 1. 特征提取与描述

def detectAndDescribe(image):

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) # 转灰度图

sift = cv2.SIFT_create() # 建立SIFT特征提取器

(kps, des) = sift.detectAndCompute(gray, None) # 关键点和描述符

kps_float = np.float32([kp.pt for kp in kps]) # 提取关键点坐标

return (kps, kps_float, des)

# 2. 读取图像

imageA = cv2.imread("1.jpg")

cv_show('imageA', imageA)

imageB = cv2.imread("2.jpg")

cv_show('imageB', imageB)

# 3. 计算特征点及描述符

(kpsA, kps_floatA, desA) = detectAndDescribe(imageA)

(kpsB, kps_floatB, desB) = detectAndDescribe(imageB)

# 4. 建立匹配器并进行KNN匹配

matcher = cv2.BFMatcher()

rawMatches = matcher.knnMatch(desB, desA, k=2)

good, matches = [], []

for m in rawMatches:

if len(m) == 2 and m[0].distance < 0.65 * m[1].distance: # Lowe比值测试

good.append(m)

matches.append((m[0].queryIdx, m[0].trainIdx))

print(f"匹配对数量:{len(good)}")

# 可视化匹配结果

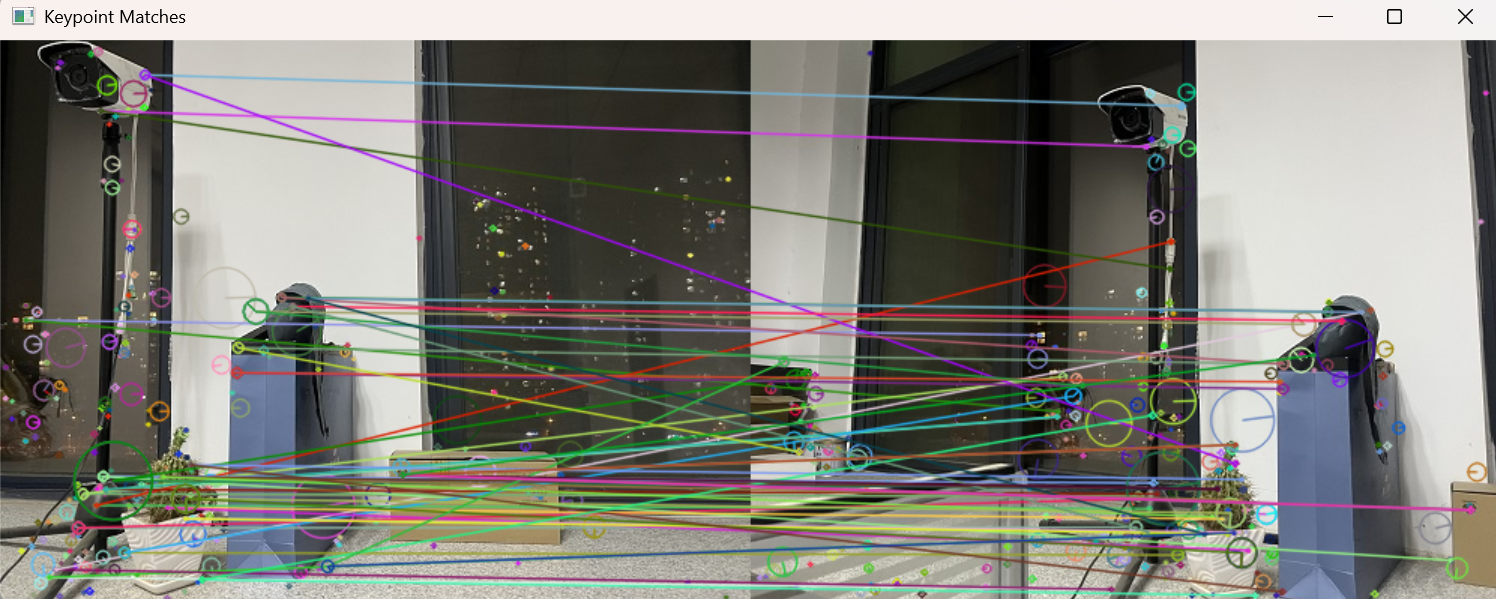

vis = cv2.drawMatchesKnn(imageB, kpsB, imageA, kpsA, good, None,

flags=cv2.DRAW_MATCHES_FLAGS_DRAW_RICH_KEYPOINTS)

cv_show("Keypoint Matches", vis)

# 5. 计算单应性矩阵并拼接

if len(matches) > 4:

ptsB = np.float32([kps_floatB[i] for (i, _) in matches])

ptsA = np.float32([kps_floatA[i] for (_, i) in matches])

(H, mask) = cv2.findHomography(ptsB, ptsA, cv2.RANSAC, ransacReprojThreshold=10)

else:

print('匹配点过少,无法计算单应性矩阵')

sys.exit()

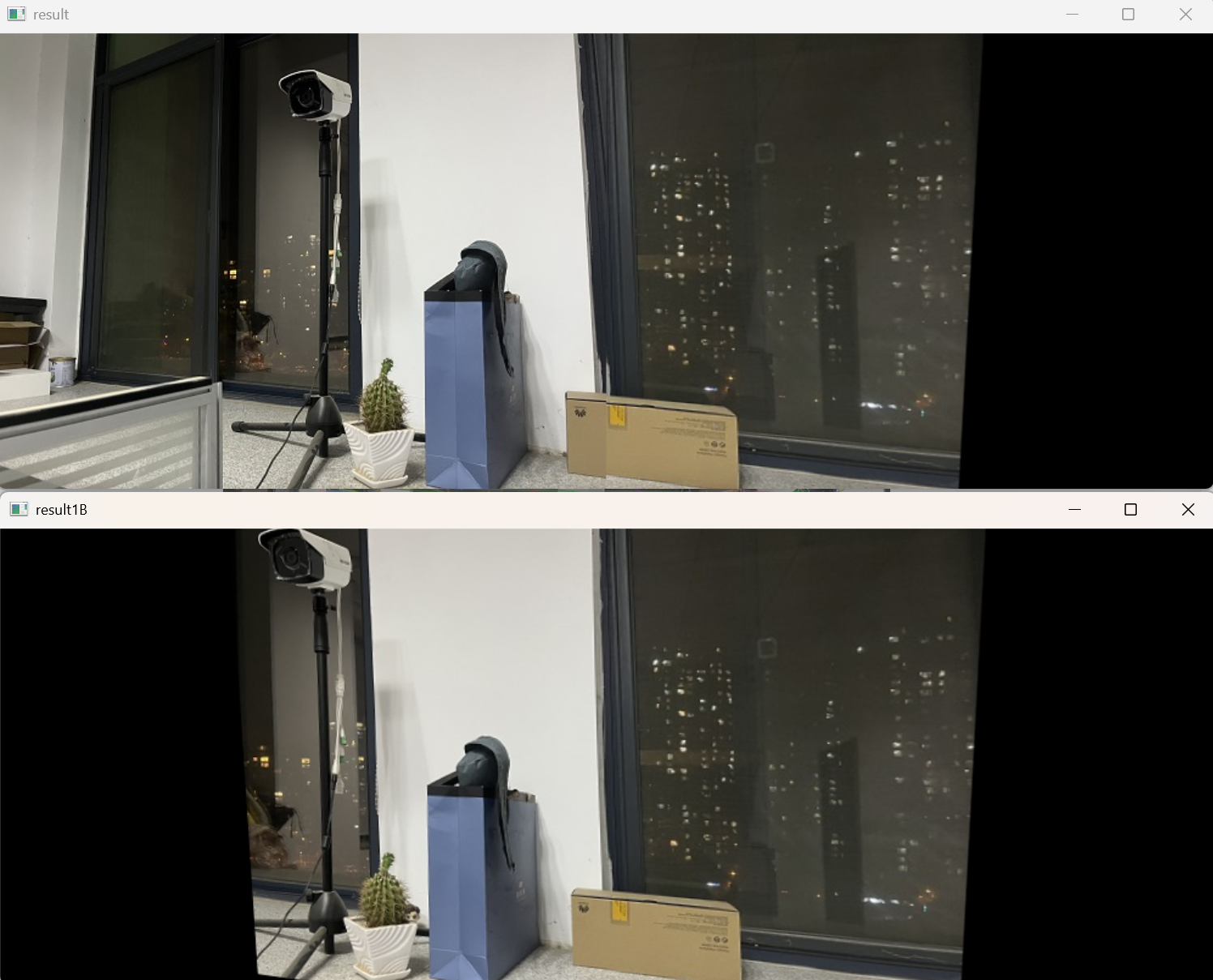

# 6. 透视变换 + 拼接

result = cv2.warpPerspective(imageB, H, (imageB.shape[1] + imageA.shape[1], imageB.shape[0]))

cv_show("result1B", result)

result[0:imageA.shape[0], 0:imageA.shape[1]] = imageA

cv_show("result", result)

cv2.imwrite("pingjie.jpg", img=result)

三、运行结果与分析

运行上述代码后,可以依次看到:

-

两张原始图像。

-

匹配点可视化效果,越多匹配点说明拼接越稳健。

-

拼接后的大图,图像B透视变换后与图像A对齐。

若匹配点不足,说明图像重叠区域太少或纹理不明显,可尝试:

-

换用更鲁棒的特征提取器(如 ORB、SuperPoint)。

-

调整比值测试阈值(如 0.7)。

-

提高图像质量(降噪、增强对比度)。

四、总结

本文通过 SIFT 特征提取 → 特征匹配 → RANSAC 单应性矩阵 → 透视变换与拼接,完成了图像拼接任务。该方法对光照、旋转、尺度具有较强鲁棒性,但在大视差、非平面场景下可能出现拼接误差,实际应用中可以结合多图优化和多频段融合进一步提升效果。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)