苹果悄悄扔出“王炸”:一张照片秒变3D世界,这次开源真狠!

不需要专业设备,不依赖海量数据,用你手机里的任何一张照片,一秒钟内生成可任意漫游的3D场景——这不是科幻,而是苹果刚刚开源的新模型。深夜,科技圈被一条GitHub动态惊醒。苹果研究院悄无声息地开源了一个名为的项目,全称“Sharp Monocular View Synthesis in Less Than a Second”——。更关键的是,它完全开源。

苹果悄悄扔出“王炸”:一张照片秒变3D世界,这次开源真狠!

不需要专业设备,不依赖海量数据,用你手机里的任何一张照片,一秒钟内生成可任意漫游的3D场景——这不是科幻,而是苹果刚刚开源的新模型。

深夜,科技圈被一条GitHub动态惊醒。

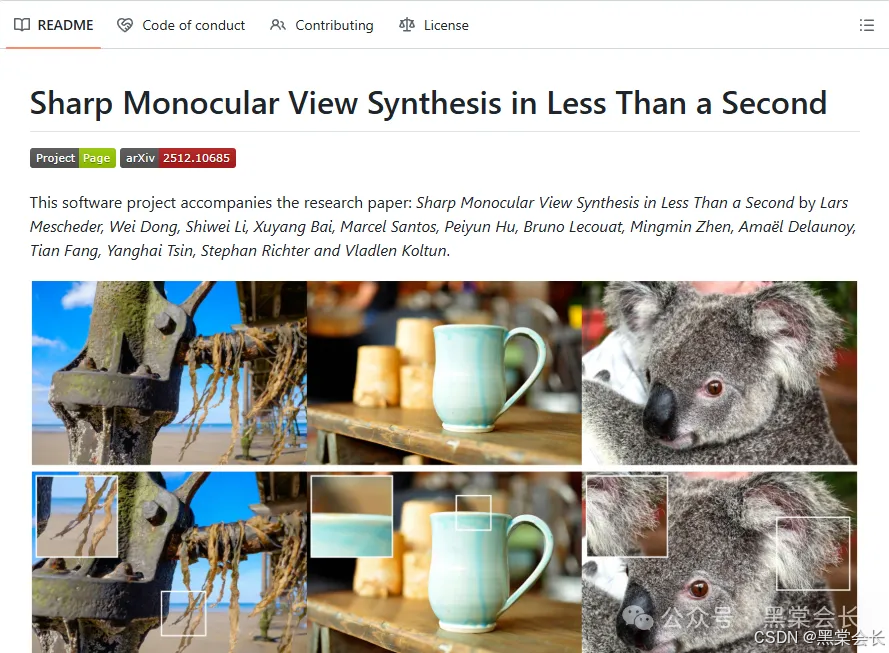

苹果研究院悄无声息地开源了一个名为 SHARP 的项目,全称“Sharp Monocular View Synthesis in Less Than a Second”——“一秒钟内的锐利单目视图合成”。

名字很技术,但能力堪称“魔法”:它能把任意一张普通2D照片,在一秒钟内转换成高保真、可实时渲染的3D场景。

更关键的是,它完全开源。

一、这到底是个什么“黑科技”?

想象一下这个场景:

你拍了一张客厅的照片,上传给SHARP。不到一秒,它就能生成这个客厅的完整3D视图。

然后,你可以在电脑或手机上“走进”这个3D客厅——左右环顾,前后走动,从任意角度观察沙发、茶几和窗外的风景。所有画面都是照片级真实感,渲染速度达到实时。

技术层面,SHARP的核心突破在于:

- 极速推理:仅需单次神经网络前向传播,在普通GPU上不到1秒就能完成从2D到3D的转换

- 零样本泛化:无需针对特定场景训练,对各类数据集都有强大适应能力

- 度量精度:生成的3D场景具有绝对尺度,支持精确的相机运动控制

用论文数据说话:相比之前最好的模型,SHARP将图像质量指标LPIPS降低了25-34%,DISTS降低了21-43%,同时将合成时间缩短了三个数量级。

二、为什么这次开源如此特别?

苹果向来以“封闭生态”著称,此次主动开源一个具有颠覆性潜力的3D生成模型,信号强烈。

1. 技术路径的自信展示

SHARP采用的是当前热门的** 3D 视图(3D Gaussian Splatting)** 技术路线,但苹果团队通过创新的网络架构和训练方法,将其效率和效果推向了新高度。

开源代码库结构清晰,从环境配置到预测渲染,只需几行命令即可上手:

# 安装环境

conda create -n sharp python=3.13

pip install -r requirements.txt

# 运行预测(自动下载模型)

sharp predict -i /path/to/input/images -o /path/to/output/gaussians

# 渲染视频(需CUDA GPU)

sharp predict -i /path/to/input/images -o /path/to/output/gaussians --render

2. 生态建设的明确信号

苹果选择在GitHub而非仅通过学术论文发布,并采用友好的开源许可证,明显是在吸引开发者社区。

项目负责人Vladlen Koltun在论文中强调:“我们相信开源能够加速研究社区在这一重要方向上的进步。”

三、这技术能用来做什么?

对普通用户:

- 沉浸式回忆:将老照片变成可漫步的3D场景

- 房产看房:一张照片就能“云参观”房间的每个角落

- 电商购物:商品展示从平面图升级为3D审视

对开发者:

- 游戏开发:快速将现实场景转换为游戏地图

- 影视制作:低成本创建虚拟拍摄环境

- AR/VR应用:轻松构建混合现实内容

对行业:

- 文化遗产:用单张历史照片重建已消失的建筑

- 事故重建:从现场照片还原三维场景

- 教育培训:将教材插图变为可交互3D模型

四、开源背后的“阳谋”

苹果此举绝非单纯的学术分享,背后有清晰的战略考量:

1. 抢占3D生成生态高地

在OpenAI的Sora引领视频生成、谷歌Meta在3D生成领域激烈竞争的当下,苹果需要展示自己在该领域的实力。通过开源一个性能顶尖的模型,苹果正在建立技术领导力。

2. 为Vision Pro铺路

苹果的Vision Pro头显最缺的就是高质量的3D内容。SHARP能够让用户轻松将现有的2D照片、视频转化为3D内容,极大丰富了Vision Pro的生态。

3. 吸引AI人才

在AI人才争夺白热化的今天,开源优秀项目是最好的“招聘广告”。它向全球AI研究者展示:苹果不仅能用AI,还能做最前沿的AI研究。

4. 标准制定的前奏

通过开源一个效果出众的实现,苹果有机会定义单图3D生成的技术标准和工作流程,为未来可能的硬件集成做准备。

五、技术细节中的“魔鬼”

虽然SHARP效果惊艳,但仔细研究代码和论文,仍能发现一些限制:

当前局限:

- 渲染视频功能仅支持CUDA GPU,M系列芯片的Mac用户暂时无法使用完整的渲染管线

- 对于极度复杂或遮挡严重的场景,生成效果可能不稳定

- 生成的3D场景遵循OpenCV坐标系(x向右,y向下,z向前),与某些第三方渲染器可能需要坐标转换

潜在风险:

- 任何人都能用一张照片生成他人的3D空间,隐私和安全问题亟待解决

- 可能被滥用于伪造证据、侵犯肖像权等场景

- 技术门槛降低后,内容真实性验证将面临更大挑战

六、如何快速上手体验?

对于想要尝鲜的开发者,以下是极简步骤:

- 克隆仓库

https://github.com/apple/ml-sharp.git

-

下载测试图片

任何一张清晰、透视明显的照片都可以,建议从论文示例开始 -

运行生成

cd ml-sharp

sharp predict -i your_photo.jpg -o ./output

- 查看结果

输出目录中会包含.ply格式的3D视图,可用兼容的3DGS查看器打开

七、开源不是终点,而是开始

SHARP的开源,标志着单图3D生成正式进入“秒级”时代。

但更值得关注的是,苹果选择在这个时间点开源——距离Vision Pro全球发售不到一年,距离苹果年度开发者大会仅剩数月。

这让人不禁猜测:SHARP是否只是更大拼图中的一块?

或许在不久的WWDC上,我们会看到这项技术被深度集成到iOS的相机应用中,让每位iPhone用户都能一键生成3D场景;或许它会成为Vision Pro的“杀手级”功能,让空间计算真正触手可及。

苹果用代码写下了自己的宣言:在AI+3D的赛道上,它不只是参与者,更要成为规则的制定者。

而今天,这份宣言的源代码,已经向全世界开放。

代码仓库:https://github.com/apple/ml-sharp

论文地址:https://arxiv.org/abs/2512.10685

这场由一张照片引发的3D革命,才刚刚开始。而苹果,已经按下了快进键。

个人观点,仅供参考。原创文章,未经授权禁止转载。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)