超图YOLO(Hyper-YOLO):当视觉目标检测邂逅超图计算

我们提出了一种名为Hyper-YOLO的新型目标检测方法,该方法通过整合超图计算来捕捉视觉特征间复杂的高阶关联性。传统YOLO模型虽然功能强大,但其颈部设计存在局限性,限制了跨层级特征的融合以及对高阶特征间相互关系的利用。为应对这些挑战,我们提出了基于超图计算的语义聚合与分散框架(Hypergraph Computation Empowered Semantic Collecting and Sc

摘要

https://arxiv.org/pdf/2408.04804

我们提出了一种名为Hyper-YOLO的新型目标检测方法,该方法通过整合超图计算来捕捉视觉特征间复杂的高阶关联性。传统YOLO模型虽然功能强大,但其颈部设计存在局限性,限制了跨层级特征的融合以及对高阶特征间相互关系的利用。为应对这些挑战,我们提出了基于超图计算的语义聚合与分散框架(Hypergraph Computation Empowered Semantic Collecting and Scattering,HGC-SCS),该框架将视觉特征图转换到语义空间,并构建超图以实现高阶消息传播。这使得模型能够同时获取语义信息和结构信息,超越了传统的以特征为中心的学习方式。Hyper-YOLO在其主干网络中融入了所提出的混合聚合网络(Mixed Aggregation Network,MANet)以增强特征提取能力,并在其颈部引入了基于超图的跨层级与跨位置表示网络(Hypergraph-Based Cross-Level and Cross-Position Representation Network,HyperC2Net)。HyperC2Net在五个尺度上运行,并突破了传统网格结构的限制,实现了跨层级与跨位置的复杂高阶交互。这些组件的协同作用使Hyper-YOLO成为各种尺度模型中的先进架构,其在COCO数据集上的卓越性能便是证明。具体而言,Hyper-YOLO-N相较于先进的YOLOv8-N和YOLOv9-T,在APvalˉ\bar{\mathbf{A}\mathbf{P}^{v a l}}APvalˉ指标上实现了12%的提升,在APval\mathrm{AP}^{val}APval指标上实现了9%的提升。源代码可在https://github.com/iMoonLab/Hyper-YOLO获取。

索引术语——目标检测,超图,超图神经网络,超图计算

一、引言

YOLO系列[1]-[11]是目标检测领域的主流方法,具有多种优势,可满足各种不同的应用需求。YOLO的架构主要由两个部分组成:主干网络(backbone)[7],[12]-[14]和颈部网络(neck)[10],[15],[16]。主干网络用于特征提取,已得到广泛研究;而颈部网络则负责多尺度特征的融合,为检测不同大小的目标提供了坚实的基础。本文特别强调颈部网络的重要性,因为颈部网络对于增强模型检测不同尺度目标的能力至关重要。

当代YOLO模型在颈部网络部分采用了路径聚合网络(PANet)[16],该网络通过自上而下和自下而上的路径,促进各尺度信息的全面融合。然而,PANet的能力主要局限于相邻层之间的特征融合,未能充分解决跨层级特征集成的问题。相比之下,以Gold-YOLO[1O]为代表的聚合-分发颈部网络设计促进了层间信息交换,但仍未能充分实现特征图内的跨位置交互。此外,该设计也未充分挖掘特征间相互关系的潜力,尤其是高阶相关性。高阶相关性指的是不同尺度、位置和语义层次特征之间存在的复杂且通常是非线性的关系,这对于理解视觉数据中的深层上下文和交互至关重要。研究发现,低层视觉特征及其相关性的协同表示在目标检测任务中起着关键作用。将这些基本特征与高层语义信息相结合,对于在给定场景中准确识别和定位目标至关重要。在许多计算机视觉任务中,探索低层特征背后的高阶相关性以进行语义分析仍然是一个具有挑战性但至关重要的课题。这种高阶关系挖掘常被忽视的现象,可能会限制视觉任务的性能。

在实际应用中,超图[17],[18]因其比简单图更强的表达能力,常被用于表示复杂的高阶相关性。简单图中的边仅限于连接两个顶点,从而极大地限制了其表达能力;而超图中的超边可以连接两个或多个顶点,能够建模更复杂的高阶关系。与简单图相比,超图能够捕捉多个实体之间更丰富的交互,这对于需要理解复杂多向关系的任务至关重要,例如计算机视觉中的目标检测,其中特征图之间的跨层级和跨位置相关性至关重要。

与以往大多数专注于增强特征提取主干网络的研究不同,本文提出了基于超图计算的语义收集与散射(Hypergraph Computation Empowered Semantic Collecting and Scattering,HGC-SCS)框架。该框架巧妙构思,通过将视觉主干网络提取的特征图转换到抽象语义空间,并构建复杂的超图结构来增强这些特征图。超图作为语义空间内特征之间高阶消息传播的通道。这种方法使视觉主干网络具备了融合语义和复杂结构信息的双重能力,从而克服了传统语义特征聚焦学习的局限性,并将性能提升到传统范围之外。

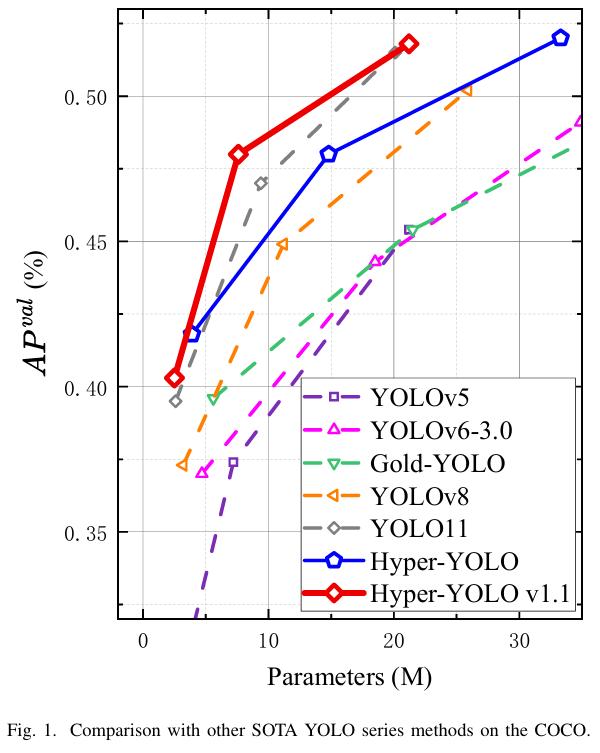

基于上述HGC-SCS框架,本文提出了Hyper-YOLO,这是一种基于超图计算的新型YOLO方法。Hyper-YOLO首次将超图计算集成到视觉目标检测网络的颈部组件中。通过建模主干网络提取的特征图中固有的复杂高阶关联,Hyper-YOLO显著提高了目标检测性能。在主干网络架构方面,Hyper-YOLO采用了混合聚合网络(Mixed Aggregation Network,MANet),该网络融合了三种不同的基础结构,以丰富信息流并增强特征提取能力,在YOLOv8的基础上进行构建。在颈部网络方面,利用所提出的HGC-SCS框架,我们实现了一种多尺度特征融合颈部网络,即基于超图的跨层级和跨位置表示网络(Hypergraph-Based Cross-Level and Cross- Position Representation Network,HyperC2Net)。与传统的颈部网络设计不同,HyperC2Net融合了五个不同尺度的特征,同时打破了视觉特征图的网格结构,以促进跨层级和跨位置的高阶消息传播。主干网络和颈部网络的综合改进使Hyper-YOLO成为一种开创性的架构。在COCO数据集上的实证结果(图1)证明了其在性能上的显著优势,证实了这种复杂方法在推动目标检测领域发展方面的有效性。我们的贡献可总结如下:

- 1)提出了基于超图计算的语义收集与散射(HGC-SCS)框架,通过高阶信息建模和学习增强了视觉主干网络。

- 2)利用所提出的HGC-SCS框架,开发了HyperC2Net,这是一种目标检测颈部网络,可促进整个语义层和位置的高阶消息传递。HyperC2Net显著提高了颈部网络提取高阶特征的能力。

- 3)提出了混合聚合网络(MANet),该网络融合了三种类型的模块以丰富信息流,从而增强了主干网络的特征提取能力。

- 4)提出了Hyper-YOLO,该模型融入了超图计算,增强了模型的高阶信息感知能力,从而提高了目标检测性能。具体而言,我们的Hyper-YOLO在COCO数据集上与YOLOv8-N相比提高了12%12\%12%,与YOLOv9-T相比提高了9%9\%9%。

二、相关工作

A. YOLO系列目标检测器

YOLO系列是实时目标检测领域的基石,从YOLOv1[1]的单阶段检测发展到YOLOv8[8]的性能优化模型。从YOLOv4[3]的结构优化到YOLOv7[7]的E - ELAN主干网络,每一次迭代都带来了显著进步。YOLOX[9]引入了无锚点检测,Gold - YOLO[10]通过其聚合 - 分发机制增强了特征融合。尽管出现了RT - DETR[19]等检测器,YOLO系列依然盛行,部分原因在于它有效利用了CSPNet、ELAN[14]以及改进的路径聚合网络(PANet)[16]或特征金字塔网络(FPN)[15]进行特征集成,还结合了YOLOv3[2]和FCOS[20]中先进的预测头。YOLOv9[21]引入了可编程梯度信息和广义高效层聚合网络,以减少深度网络传输过程中的信息损失。基于这些YOLO方法,本文提出了Hyper - YOLO,这是一种利用超图计算增强YOLO框架复杂关联学习能力的先进方法。Hyper - YOLO旨在改进层次特征的学习和集成,突破目标检测性能的界限。

B. 超图学习方法

超图[17],[18]可用于捕捉这些复杂的高阶关联。超图通过超边连接多个节点,在建模复杂关系方面表现出色,这在其应用于社交网络分析[22],[23]、药物 - 靶点相互作用建模[24],[25]和脑网络分析[26],[27]等多个领域得到了证明。超图学习方法已成为捕捉数据中复杂高阶关联的强大工具,而传统的基于图的技术可能无法充分表示这些关联。正如Gao等人[17]所讨论的,超边的概念通过允许多个节点同时交互,促进了这些复杂关系的建模。超图神经网络(HGNN)[28]利用这些关系,通过谱方法实现从超图结构的直接学习。在此基础上,通用超图神经网络(HGNN+)[18]引入了顶点间高阶消息传播的空间方法,进一步扩展了超图学习的能力。尽管取得了这些进展,但超图学习在计算机视觉任务中的应用仍相对未被充分探索,特别是在建模和学习高阶关联方面。在本文中,我们将深入探讨如何利用超图计算进行目标检测任务,旨在通过整合超图建模的细微关系信息,提高分类和定位的准确性。

三、基于超图计算的语义收集与散射框架

与计算机视觉中的表示学习仅处理视觉特征不同,超图计算方法[18],[28]可同时处理特征和高阶结构。大多数超图计算方法依赖于固有的超图结构,而在大多数计算机视觉场景中无法直接获得这种结构。在此,我们介绍了计算机视觉中超图计算的一般范式,包括超图构建和超图卷积。给定从神经网络中提取的特征图XXX,采用超图构建函数f : X → Gf\ :\ X\ \to\ \mathcal{G}f : X → G来估计语义空间中特征点之间潜在的高阶关联。然后,利用谱或空间超图卷积方法,通过超图结构在特征点之间传播高阶消息。生成的高阶特征记为XhyperX_{hyper}Xhyper。通过将高阶关系信息整合到Xhyper\mathbf{X}_{hyper}Xhyper中,这种超图计算策略解决了原始特征图XXX中高阶关联不足的问题。由此产生的混合特征图,记为sss,是XXX和Xhyper\mathbf{X}_{hyper}Xhyper融合的结果。这一综合过程最终形成了语义增强的视觉表示nnn,从语义和高阶结构两个角度提供了更全面的视觉特征表示。

在此,我们设计了一个计算机视觉中超图计算的一般框架,名为基于超图计算的语义收集与散射(HGC - SCS)框架。给定从卷积神经网络(CNN)[29] - [34]或其他主干网络中提取的特征图,我们的框架首先收集这些特征并将它们融合,在语义空间中构建混合特征包XmixedX_{mixed}Xmixed。第二步,我们估计这些潜在的高阶关联,在语义空间中构建超图结构。为了充分利用这些高阶结构信息,可以采用一些相关的超图计算方法[18],[28]。这样,就可以生成包含高阶结构和语义信息的高阶感知特征XhyperX_{hyper}Xhyper。最后一步,我们将高阶结构信息散射到每个输入特征图。HGC - SCS框架可表示为:

KaTeX parse error: Expected & or \\ or \cr or \end at end of input: …uad\mathit{//}}

其中{X1,X2,⋯ }\{\pmb{X}_{1},\pmb{X}_{2},\cdots\}{X1,X2,⋯}表示由视觉主干网络生成的基本特征图。“HyperComputation”表示第二步,包括超图构建和超图卷积,用于捕捉语义空间中潜在的高阶结构信息并生成高阶感知特征XhyperX_{hyper}Xhyper。在最后一行,ϕ(⋅)\phi(\cdot)ϕ(⋅)表示特征融合函数。“{X1′,X2′,⋯ }\{\mathbf{\boldsymbol{X}}_{1}^{\prime},\mathbf{\boldsymbol{X}}_{2}^{\prime},\cdots\}{X1′,X2′,⋯}”表示增强的视觉特征图。接下来,我们将介绍HGC - SCS框架在目标检测中的一个实例,名为HyperC2Net\mathrm{HyperC2Net}HyperC2Net。

四. 方法

在本节中,我们首先介绍YOLO相关符号的预备知识以及所提出的Hyper-YOLO框架。接下来,详细阐述所提出的两个核心模块,包括Hyper-YOLO的基础模块(MANet)和颈部模块(HyperC2Net)。最后,分析Hyper-YOLO与其他YOLO方法之间的关系。

A. 预备知识

YOLO系列方法[1]-[5],[7], [8],[21], [35]-[39]通常由两个主要部分组成:主干网络(backbone)和颈部网络(neck)。主干网络[40][13]负责提取基本的视觉特征,而颈部网络[15][16][19]则促进多尺度特征的融合,以实现最终的目标检测。本文针对这两个组件提出了增强策略。为便于本文描述,我们将颈部网络的三个尺度输出表示为{N3,N4,N5}\{N_{3},N_{4},N_{5}\}{N3,N4,N5},分别对应小尺度、中尺度和大尺度检测。在主干网络的特征提取阶段,我们进一步将其分为五个阶段:{B1,B2,B3,B4,B5}\{B_{1},B_{2},B_{3},B_{4},B_{5}\}{B1,B2,B3,B4,B5},代表不同语义层次的特征。数字越大,表示该特征是由网络更深层提取的更高层次的语义特征。更多细节见A节。

B. Hyper-YOLO概述

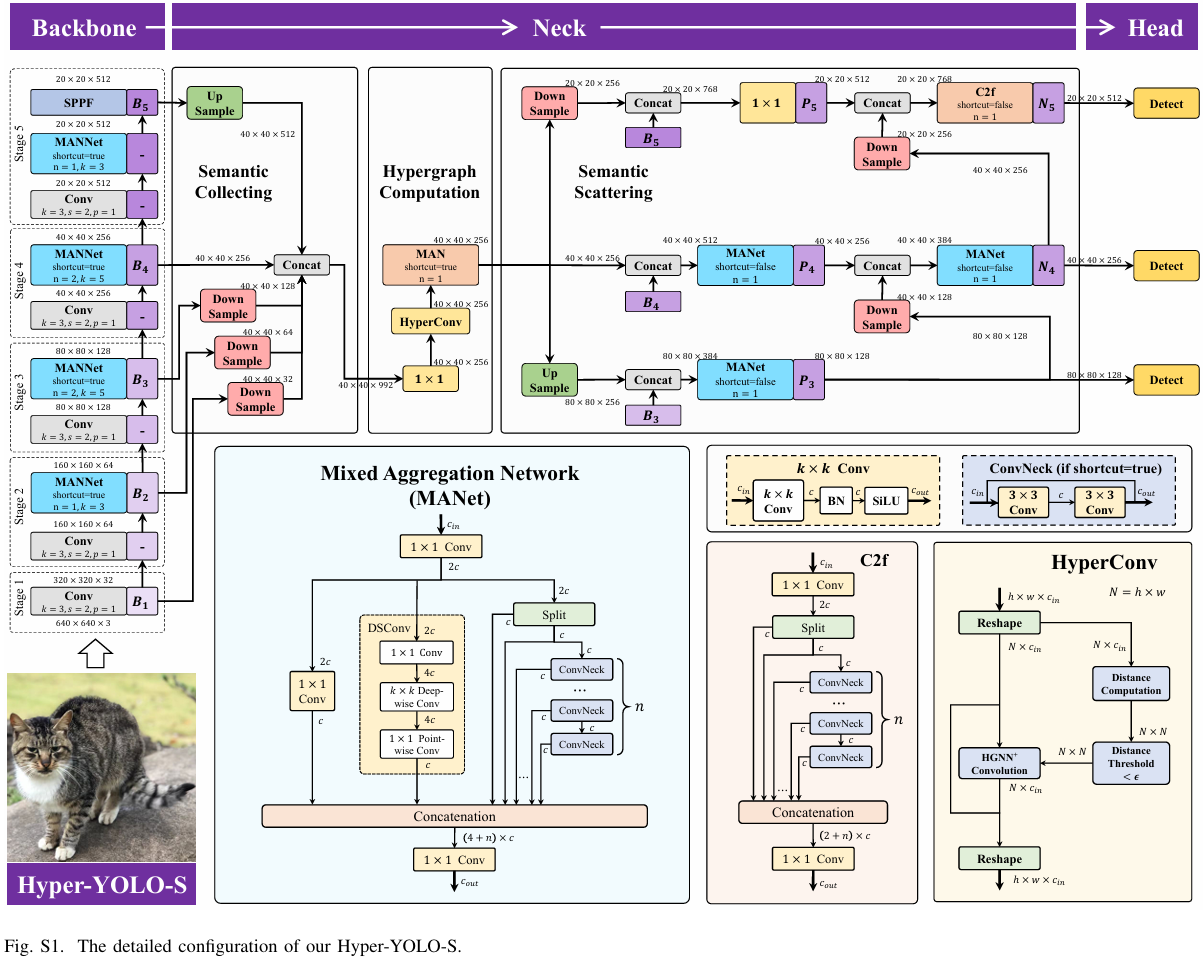

我们的Hyper-YOLO框架保持了典型YOLO方法的整体架构,包括主干网络和颈部网络,如图S1所示。给定一张图像,Hyper-YOLO的主干网络利用所提出的MANet作为其核心计算模块,从而增强了YOLOv8[8]中传统C2f模块的特征辨别能力。与传统YOLO架构不同,Hyper-YOLO采用了一组五个主要特征集{∇B1,B2,B3,B4,B5}\{\nabla B_{1},B_{2},B_{3},B_{4},B_{5}\}{∇B1,B2,B3,B4,B5}。在创新的一步中,Hyper-YOLO的颈部网络(HyperC2Net)基于超图计算理论,整合了这五个特征集的跨层次和跨位置信息,最终生成三个不同尺度的最终语义特征{N3,N4,N5}\{N_{3},N_{4},N_{5}\}{N3,N4,N5}。这些层次结构化的语义特征随后被用于最终的目标检测任务。

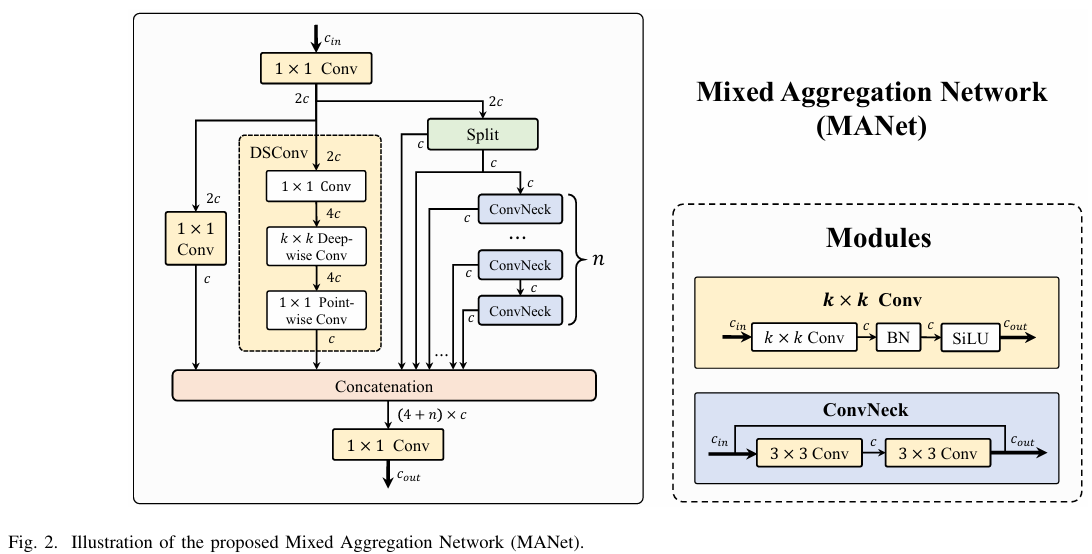

C. 混合聚合网络

对于Hyper-YOLO的主干网络,为了增强基础网络的特征提取能力,我们设计了混合聚合网络(MANet),如图2所示。该架构协同融合了三种典型的卷积变体:用于通道特征重新校准的1×11\times11×1旁路卷积、用于高效空间特征处理的深度可分离卷积(DSConv)以及用于增强特征层次集成的C2f模块。这种融合在训练阶段产生了更加多样化和丰富的梯度流,显著增强了五个关键阶段基础特征中蕴含的语义深度。我们的MANet可以表示为:

{Xmid=Conv1(Xin)X1=Conv2(Xmid)X2=DSConv(Conv3(Xmid))X3,X4=Split(Xmid)X5=ConvNeck1(X4)+X4X6=ConvNeck2(X5)+X5⋯X4+n=ConvNeckn(X3+n)+X3+n}n,\left\{\begin{aligned}{}&{{}{\bf X}_{m i d}=\mathrm{Conv}_{1}({\bf X}_{i n})}\\ {}&{{}{\bf X}_{1}=\mathrm{Conv}_{2}({\bf X}_{m i d})}\\ {}&{{}{\bf X}_{2}=\mathrm{DSConv}(\mathrm{Conv}_{3}({\bf X}_{m i d}))}\\ {}&{{}{\bf X}_{3},{\bf X}_{4}=\mathrm{Split}({\bf X}_{m i d})}\\ {}&{{}\left.\begin{array}{l l}{{\bf X}_{5}=\mathrm{ConvNeck}_{1}({\bf X}_{4})+{\bf X}_{4}}\\ {{\bf X}_{6}=\mathrm{ConvNeck}_{2}({\bf X}_{5})+{\bf X}_{5}}\\ {\cdots}\\ {{\bf X}_{4+n}=\mathrm{ConvNeck}_{n}({\bf X}_{3+n})+{\bf X}_{3+n}}\end{array}\right\}n}\end{aligned}\right.,⎩

⎨

⎧Xmid=Conv1(Xin)X1=Conv2(Xmid)X2=DSConv(Conv3(Xmid))X3,X4=Split(Xmid)X5=ConvNeck1(X4)+X4X6=ConvNeck2(X5)+X5⋯X4+n=ConvNeckn(X3+n)+X3+n⎭

⎬

⎫n,

其中,XmidX_{m i d}Xmid的通道数为2c2c2c,而X1,X2,…,X4+n\mathbf{X}_{1},\mathbf{X}_{2},\ldots,\mathbf{X}_{4+n}X1,X2,…,X4+n的通道数均为ccc。最后,我们通过拼接操作和1×11\times11×1卷积,融合并压缩三种特征的语义信息,生成通道数为2c2c2c的Xout\mathbf{\boldsymbol{X}}_{o u t}Xout,如下所示:

Xout=Convo(X1∣∣X2∣∣⋯∣∣X4+n).\mathbf{\boldsymbol{X}}_{o u t}=\operatorname{Conv}_{o}(\mathbf{\boldsymbol{X}}_{1}||\mathbf{\boldsymbol{X}}_{2}||\cdots||\mathbf{\boldsymbol{X}}_{4+n}).Xout=Convo(X1∣∣X2∣∣⋯∣∣X4+n).

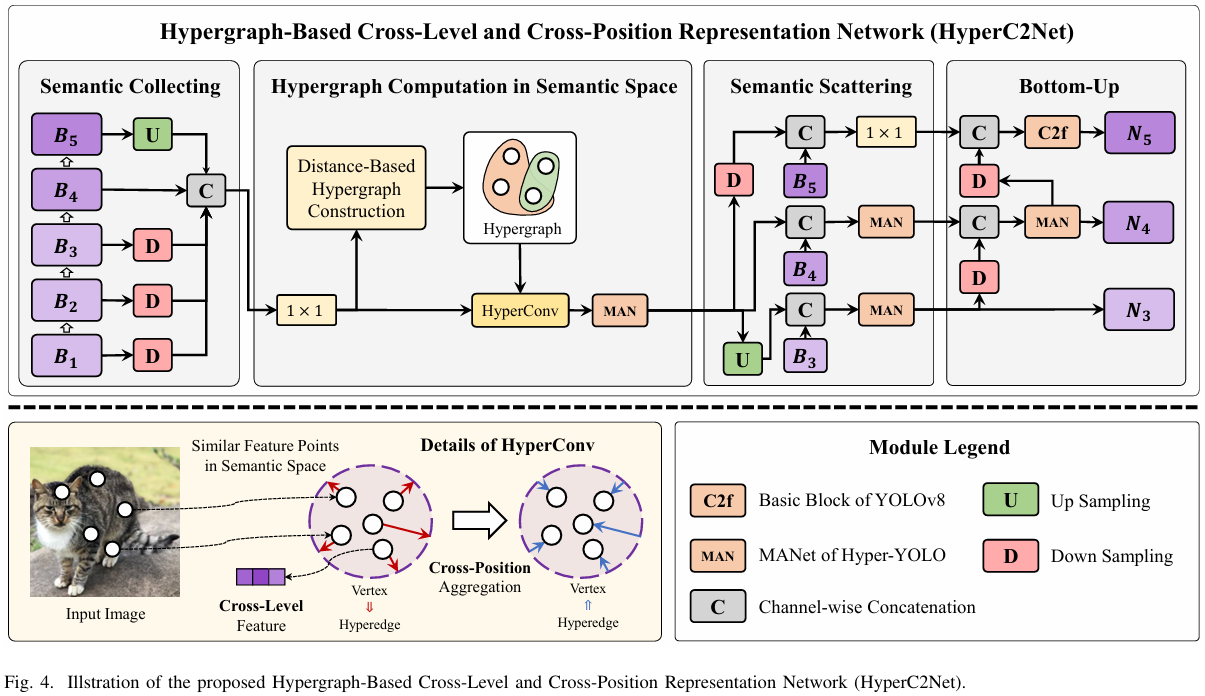

D. 基于超图的跨层次和跨位置表示网络

对于Hyper-YOLO的颈部网络,在本小节中,为了全面融合主干网络中的跨层次和跨位置信息,我们进一步提出了基于超图的跨层次和跨位置表示网络(HyperC2Net),如图4所示。HyperC2Net是所提出的HGC-SCS框架的一种实现,能够捕捉语义空间中潜在的高阶相关性。

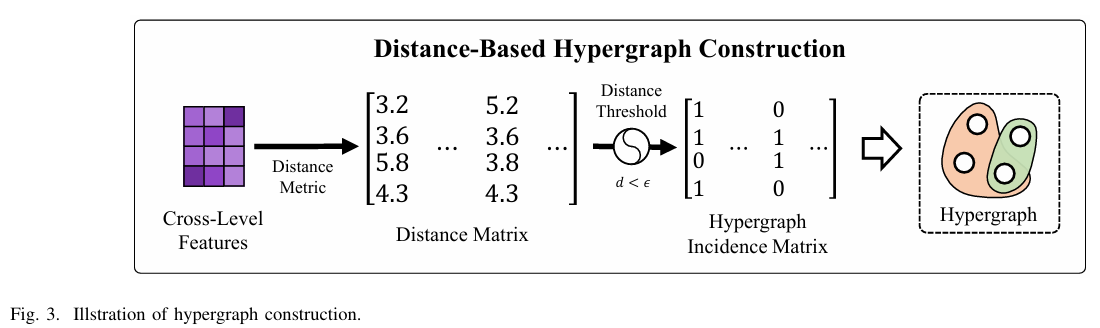

- 1)超图构建:如图S1所示,我们的主干网络被分为五个离散阶段。这些阶段的特征图表示为{B1,B2,B3,B4,B5}\{B_{1},B_{2},B_{3},B_{4},B_{5}\}{B1,B2,B3,B4,B5}。为了利用超图计算来阐明基础特征之间的复杂高阶关系,我们首先对五个基础特征进行通道拼接,从而合成跨层次的视觉特征。超图G={V,E}\mathcal{G}=\{\mathcal{V},\mathcal{E}\}G={V,E}通常由顶点集V\mathcal{V}V和超边集E\mathcal{E}E定义。在我们的方法中,我们将基于网格的视觉特征解构为超图的顶点集V\mathcal{V}V。为了在语义空间中建模邻域关系,我们使用距离阈值从每个特征点构建一个ϵ\epsilonϵ-球,该球将作为超边,如图3所示。ϵ\epsilonϵ-球是一个超边,它包含了距离中心特征点一定阈值内的所有特征点。整体超边集的构建可以定义为E = {ball(v,ϵ) ∣ v ∈ V}\mathcal{E}~=~\{b a l l(v,\epsilon)~\mid~v~\in~\mathcal{V}\}E = {ball(v,ϵ) ∣ v ∈ V},其中ball(v,ϵ) = {u ∣ ∣∣xu − xv∣∣d < ϵ,u ∈ V}b a l l(v,\epsilon)\;=\;\{u\;\mid\;||\boldsymbol{x}_{u}\,-\,\boldsymbol{x}_{v}||_{d}\;<\;\epsilon,u\;\in\;\mathcal{V}\}ball(v,ϵ)={u∣∣∣xu−xv∣∣d<ϵ,u∈V}表示指定顶点vvv的邻域顶点集。∣∣x−y∣∣d||{\pmb x}-{\pmb y}||_{d}∣∣x−y∣∣d是距离函数。在计算中,超图g\mathcal{g}g通常由其关联矩阵H\mathcal{H}H表示。

- 2)超图卷积:为了在超图结构上实现高阶消息传递,我们采用了一种典型的空间域超图卷积[18],并添加了残差连接,对顶点特征进行高阶学习,如下所示:

{xe=1∣Nv(e)∣∑v∈Nv(e)xvΘxv′=xv+1∣Ne(v)∣∑e∈Ne(v)xe,\left\{\begin{aligned}{}&{{}\pmb{x}_{e}=\frac{1}{|\mathcal{N}_{v}(e)|}\sum_{v\in\mathcal{N}_{v}(e)}\pmb{x}_{v}\pmb{\Theta}}\\ {}&{{}\pmb{x}_{v}^{\prime}=\pmb{x}_{v}+\frac{1}{|\mathcal{N}_{e}(v)|}\sum_{e\in\mathcal{N}_{e}(v)}\pmb{x}_{e}}\end{aligned}\right.,⎩ ⎨ ⎧xe=∣Nv(e)∣1v∈Nv(e)∑xvΘxv′=xv+∣Ne(v)∣1e∈Ne(v)∑xe,

其中,Nv(e) and Ne(v){\mathcal{N}}_{v}(e){\mathrm{~and~}}{\mathcal{N}}_{e}(v)Nv(e) and Ne(v)是两个邻域指示函数,定义见[18]:Nv(e) = {v ∣ v ∈ e,v ∈ V}\mathcal{N}_{v}(e)\ =\ \{v\ \mid\ v\ \in\ e,v\ \in\ \mathcal{V}\}Nv(e) = {v ∣ v ∈ e,v ∈ V}和Ne(v) = {e ∣ v ∈ e,e ∈ E}\mathcal{N}_{e}(v)\:=\:\{e\:\mid\:v\:\in\:e,e\:\in\:\mathcal{E}\}Ne(v)={e∣v∈e,e∈E},Θ\ThetaΘ是一个可训练参数。为了计算方便,两阶段超图消息传递的矩阵形式可以定义为:

HyperConv(X,H)=X+Dm−1HDe−1H⊤XΘ,\begin{array}{r}{\mathrm{HyperConv}(X,\pmb{H})=X+\pmb{D}_{\scriptscriptstyle\mathrm{m}}^{-1}\pmb{H}\pmb{D}_{\scriptscriptstyle\mathrm{e}}^{-1}\pmb{H}^{\top}X\pmb{\Theta},}\end{array}HyperConv(X,H)=X+Dm−1HDe−1H⊤XΘ,

其中,Dm\pmb{D_{m}}Dm和De\pmb{D_{e}}De分别表示顶点和超边的对角度矩阵。 - 3)HGC-SCS框架的一个实例:通过结合前面定义的超图构建和卷积策略,我们引入了HGC-SCS框架的一个简化实例,即基于超图的跨层次和跨位置表示网络(HyperC2Net),其总体定义如下:

{Xmixed=B1∣∣B2∣∣B3∣∣B4∣∣B5Xhyper=HyperConv(Xmixed,H)N3,N4,N5=ϕ(Xhyper,B3),ϕ(Xhyper,B4),ϕ(Xhyper,B4)\small\left\{\begin{aligned}{}&{{}X_{m i x e d}=\mathbf{\mathit{B}}_{1}||\mathbf{\mathit{B}}_{2}||\mathbf{\mathit{B}}_{3}||\mathbf{\mathit{B}}_{4}||\mathbf{\mathit{B}}_{5}}\\ {}&{{}X_{h y p e r}=\operatorname{HyperConv}(X_{m i x e d},\mathbf{\mathit{H}})}\\ {}&{{}N_{3},N_{4},N_{5}=\phi(X_{h y p e r},\mathbf{\mathit{B}}_{3}),\phi(X_{h y p e r},\mathbf{\mathit{B}}_{4}),\phi(X_{h y p e r},\mathbf{\mathit{B}}_{4})}\\ \end{aligned}\right.⎩ ⎨ ⎧Xmixed=B1∣∣B2∣∣B3∣∣B4∣∣B5Xhyper=HyperConv(Xmixed,H)N3,N4,N5=ϕ(Xhyper,B3),ϕ(Xhyper,B4),ϕ(Xhyper,B4)

其中,∣∣||∣∣表示矩阵拼接操作。ϕ\phiϕ是融合函数,如图4所示(语义散射模块和自下而上模块)。在我们的HyperC2Net中,XmixedX_{m i x e d}Xmixed本质上包含了跨层次信息,因为它是主干网络多层次特征的融合。此外,通过将网格特征解构为语义空间中的一组特征点,并根据距离构建超边,我们的方法允许在点集中不同位置的顶点之间进行高阶消息传递。这种能力有助于捕捉跨位置信息,丰富模型对语义空间的理解。

E. 比较与分析

YOLO系列的进展主要集中在主干网络和颈部网络的改进上,特别是将主干网络作为每次迭代演进的关键元素。例如,最初的YOLO[1]框架引入了DarkNet主干网络,随后经过了一系列增强,如YOLOv7[7]中引入的ELAN(高效层聚合网络)模块和YOLOv8[8]中推出的C2f(带反馈的跨阶段部分连接)模块。这些创新极大地提升了主干网络的视觉特征提取能力。

相比之下,我们的Hyper-YOLO模型将创新重点转向了颈部网络的设计。在颈部网络架构方面,YOLOv6[5]、YOLOv7[7]和YOLOv8[8]等前沿迭代一致采用了PANet[16](路径聚合网络)结构。同时,Gold-YOLO[10]采用了创新的聚集-分发颈部范式。接下来,我们将比较HyperYOLO的HyperC2Net与这两种经典的颈部网络架构。

PANet架构虽然通过自上而下和自下而上的路径有效地融合了多尺度特征,但仍局限于相邻层之间的信息融合。这种邻域融合模式限制了网络内信息整合的广度。相比之下,HyperC2Net超越了这一限制,实现了主干网络五个层次特征之间的直接融合。这种方法产生了更强大和多样化的信息流,缩小了不同深度特征之间的连接差距。值得注意的是,虽然Gold-YOLO引入的聚集-分发颈部机制具有整合多层次信息的能力,但它并未考虑特征图内的跨位置交互。HyperC2Net的独创性在于它利用超图计算来捕捉特征图中潜在的高阶关联。语义域中的超图卷积促进了非网格约束的信息流,实现了跨层次和跨位置的高阶信息传播。这种机制打破了传统网格结构的限制,实现了更精细和集成的特征表示。

HyperC2Net生成的特征表示综合考虑了原始数据主干网络提供的语义特征和潜在的高阶结构特征。这种丰富的特征表示对于实现卓越的目标检测性能至关重要。HyperC2Net利用这些复杂高阶关系的能力,使其相对于传统的颈部网络架构(如PANet)甚至最近的创新(如聚集-分发颈部)具有显著优势,凸显了高阶特征处理在推动计算机视觉领域前沿发展中的价值。

五、实验

A. 实验设置

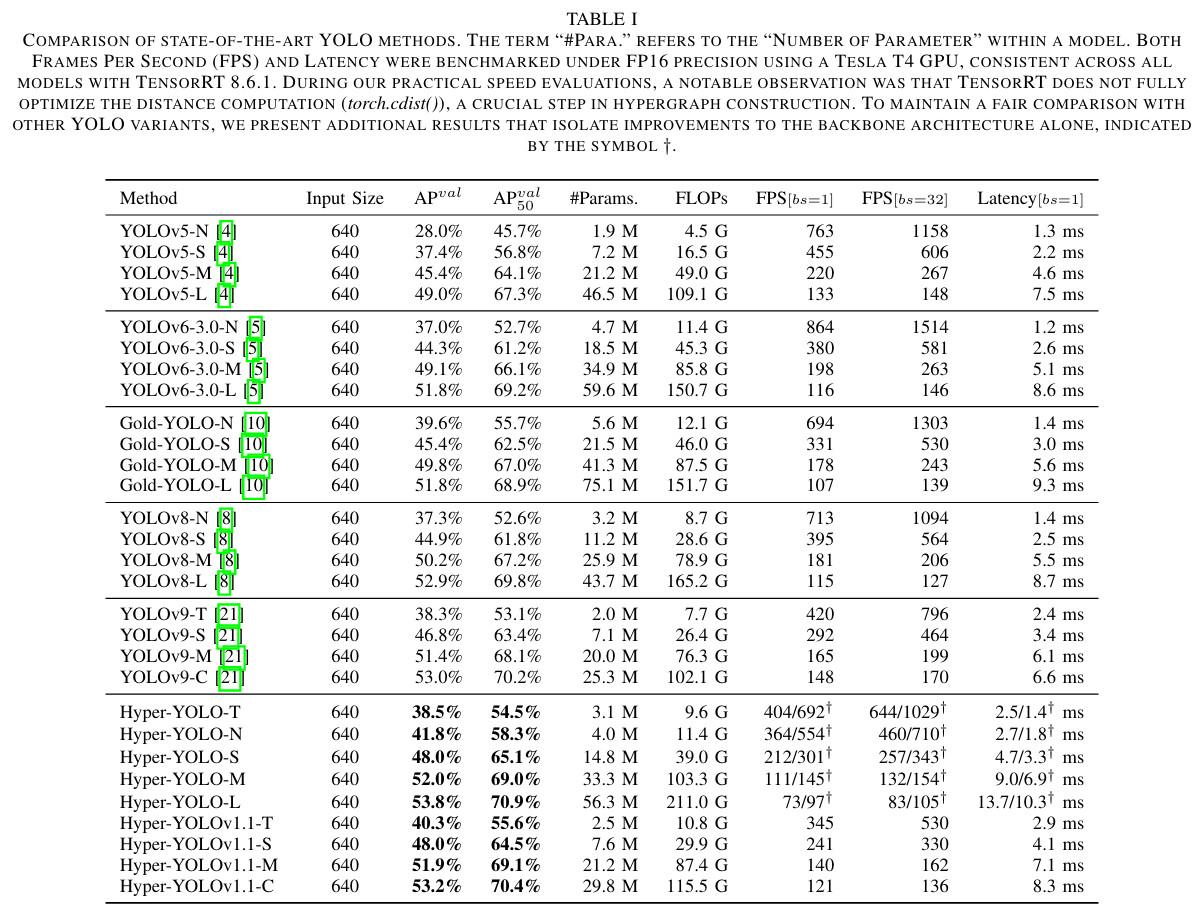

- 1)数据集:采用目标检测基准数据集微软COCO数据集[41]来评估所提Hyper-YOLO模型的有效性。具体而言,使用Train2017子集进行训练,Val2017子集作为验证集。在Val2017子集上对Hyper-YOLO进行性能评估,结果详见表I。

- 2)对比方法:选取先进的YOLO系列方法进行对比,包括YOLOv5[4]、YOLOv6-3.0[5]、YOLOv7[7]、YOLOv8[8]、Gold-YOLO[10]和YOLOv9[21]。实验采用这些方法默认的参数配置。

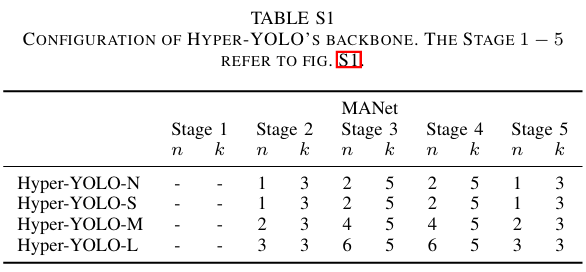

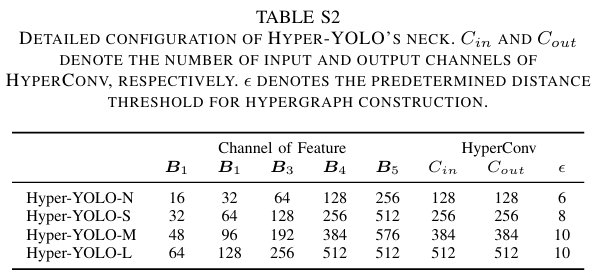

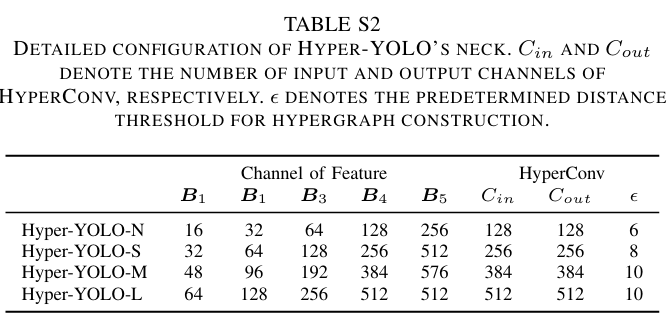

- 3)我们的Hyper-YOLO方法:我们的Hyper-YOLO基于YOLOv8的四个尺度(−N-N−N、−S-S−S、−M-M−M、−L-L−L)开发。因此,我们修改了Hyper-YOLO架构各阶段的超参数(卷积层数、特征维度),如表S2所示,得到Hyper-YOLO-N、Hyper-YOLO-S、Hyper-YOLO-M和Hyper-YOLO-L。考虑到我们的Hyper-YOLO在颈部引入了高阶学习,增加了参数数量,我们在Hyper-YOLO-N的基础上进一步减少参数,形成Hyper-YOLO-T。具体而言,在Hyper-YOLO-T的HyperC2Net中,自底向上阶段的最后一个C2f被替换为1×11\times11×1卷积。此外,我们注意到最新的YOLOv9采用了一种新的可编程梯度信息传输方式,并在推理过程中对路径进行剪枝,以在保持精度的同时减少参数数量。基于YOLOv9,我们开发了Hyper-YOLOv1.1。具体而言,我们将YOLOv9的颈部替换为Hyper-YOLO的HyperC2Net,从而使YOLOv9具备高阶学习能力。

- 4)其他细节:为确保公平比较,我们排除了所有考虑方法中的预训练和自蒸馏策略,如[5]和[10]所述。此外,考虑到输入图像大小可能对评估结果产生影响,我们将所有实验的输入分辨率统一为640×640640\times640640×640像素,这是该领域的常见选择。评估基于标准的COCO平均精度(APAPAP)指标。更多实现细节见A节和C节。

B. 结果与讨论

在COCO Val2017验证集上的目标检测结果如表I所示,可得出四个主要观察结果。首先,所提Hyper-YOLO方法在四个尺度上均优于其他模型。例如,在−N-N−N尺度上达到41.8%41.8\%41.8%,−S-S−S尺度上达到48.0%48.0\%48.0%,−M-M−M尺度上达到52.0%52.0\%52.0%,−L-L−L尺度上达到53.8%53.8\%53.8%。与

与Gold-YOLO相比,Hyper-YOLO分别提升了2.22.22.2、2.62.62.6、2.22.22.2和2.02.02.0。与YOLOv8相比,提升幅度分别为4.54.54.5、3.13.13.1、1.81.81.8和0.90.90.9。与YOLOv9相比,Hyper-YOLO分别提升了3.53.53.5、1.21.21.2、0.60.60.6和0.80.80.8。这些结果验证了Hyper-YOLO方法的有效性。

其次,值得注意的是,我们的方法不仅在性能上优于Gold-YOLO,而且显著减少了参数数量。具体而言,在−N-N−N尺度上减少了28%28\%28%,−S-S−S尺度上减少了31%31\%31%,−M-M−M尺度上减少了19%19\%19%,−L-L−L尺度上减少了25%25\%25%。主要原因是我们的HGC-SCS框架在语义空间中引入了高阶学习,与Gold-YOLO的收集-分发机制相比,能够更高效地利用主干提取的多样化信息,包括跨层级和跨位置信息,且参数更少。

第三,考虑到Hyper-YOLO与YOLOv8具有相似的底层架构,我们发现所提Hyper-YOLO-T与YOLOv8-N相比,在参数更少(3.2M→3.1M3.2M\rightarrow3.1M3.2M→3.1M)的情况下,目标检测性能更高(APvalAP^{val}APval从37.337.337.3提升至38.538.538.5)。这表明所提HyperC2Net能够通过高阶学习实现更好的特征表示学习,从而提升检测性能。同样,我们比较了Hyper-YOLOv1.1和YOLOv9,因为两者采用相同的主干架构,唯一区别在于Hyper-YOLOv1.1采用基于超图的HyperC2Net作为颈部。结果表明,我们的Hyper-YOLOv1.1性能显著提升:Hyper-YOLOv1.1-T在APvalAP^{val}APval上优于YOLOv9-T2.02.02.0,Hyper-YOLOv1.1-S在APvalAP^{val}APval上优于YOLOv9-S1.21.21.2。这种在相同尺度下采用相同架构的公平比较验证了所提高阶学习方法在目标检测任务中的有效性。

最后,我们观察到,与YOLOv8相比,随着模型尺度减小(从−L-L−L到−N-N−N),我们的Hyper-YOLO带来的提升更为显著(从0.90.90.9到4.54.54.5)。这是因为较小的模型尺度削弱了特征提取能力以及从视觉数据中获取有效信息的能力。此时,高阶学习对于捕捉特征图语义空间中的潜在高阶相关性变得必要,从而丰富了最终用于检测头的特征。此外,基于语义空间超图的高阶消息传播允许不同位置和层级之间的直接信息流动,增强了基础网络在有限参数下的特征提取能力。

C. 主干网络的消融研究

在本节和下一节中,考虑到模型尺度,我们选择Hyper-YOLO-S对主干和颈部进行消融研究。

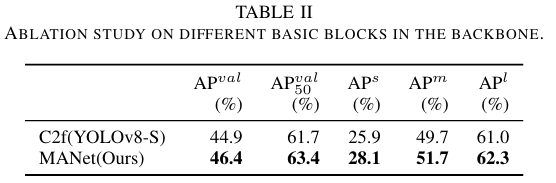

- 1)主干基本块:我们对所提MANet进行消融实验,以验证基本块中提出的混合聚合机制的有效性,如表II所示。为确保公平比较,我们采用与YOLOv8[8]中相同的PANet[16]作为颈部,使两种方法的唯一区别在于基本块。实验结果清楚地表明,在相同颈部下,所提MANet在所有指标上均优于C2f模块。这种优越性能归因于混合聚合机制,它整合了三种经典结构,实现了更丰富的信息流动,从而表现出更优的性能。

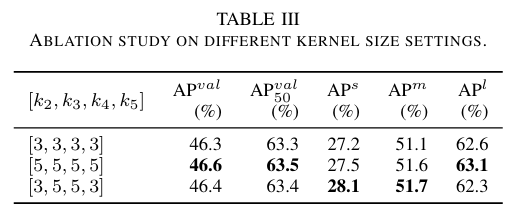

- 2)不同阶段的卷积核大小:我们进一步对卷积核大小进行了消融实验,卷积核大小是决定感受野和网络捕获数据空间层次能力的重要因素。在我们的实验中,kik_{i}ki表示第iii阶段使用的MANet的卷积核大小。由于我们的MANet从第二阶段开始采用混合聚合,因此我们实验中的kkk配置表示为[k2,k3,k4,k5][k_{2},k_{3},k_{4},k_{5}][k2,k3,k4,k5]。实验结果见表III。结果表明,将卷积核大小从333增加到555确实可以提高模型的准确率。然而,对于小目标和中等目标检测,与混合不同大小的卷积核相比,准确率并不一定提高,而且还会导致参数数量增加。因此,综合考虑性能和参数数量的平衡,我们的Hyper-YOLO最终选择[3,5,5,3][3, 5, 5, 3][3,5,5,3]作为MANet中卷积核大小的最优配置。

D. 颈部消融研究

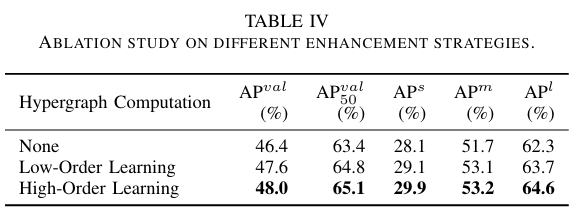

- 1)HGC-SCS框架中的高阶与低阶学习:HGC-SCS框架的核心在于语义空间的超图计算,该计算支持特征点集间的高阶信息传播。我们通过将超图简化为图以进行低阶学习,开展了消融研究以评估其有效性,结果如表IV所示。在此情况下,图是通过将中心节点与其在eee球内的邻居连接构建的。所使用的图卷积操作[42]为经典的A^ = D^v−1/2ADv−1/2 + I\hat{\boldsymbol{A}}\,\mathrm{~=~}\,\hat{\boldsymbol{D}}_{v}^{-1/2}\boldsymbol{A}\boldsymbol{D}_{v}^{-1/2}\mathrm{~+~}\boldsymbol{I}A^ = D^v−1/2ADv−1/2 + I,其中Dv\boldsymbol{D}_{v}Dv是图邻接矩阵A\boldsymbol{A}A的对角度矩阵。此外,我们还纳入了一种完全不进行相关性学习的配置:“无”。实验结果如表IV所示,揭示了与另外两种方法相比,高阶学习表现出更优的性能。从理论上讲,低阶学习可被视为高阶学习的一个子集[43],但缺乏建模复杂相关性的能力。而高阶学习则具备更强的相关性建模能力,对应着更高的性能上限。因此,高阶学习往往更容易取得更好的性能。

- 2)语义收集阶段:HGC-SCS框架的第一阶段是语义收集,该阶段决定了输入到语义空间进行超图计算的信息总量。我们对此阶段进行了消融研究,结果如表V所示,使用了三种不同的配置,分别选择3、4或5层特征图作为输入。实验结果表明,更多的特征图可以带来更丰富的语义空间信息。这种增强的信息丰富度使超图能够充分发挥其建模复杂相关性的能力。因此,采用5层特征图输入的配置取得了最佳性能。这一结果表明,当集成更多层特征图时,模型可以从更全面的输入数据表示中受益。纳入更多的特征图可能会从视觉输入中引入更广泛的语义意义和细节,使超图能够建立反映对场景更完整理解的高阶连接。因此,采用5层特征图的配置更有利于充分发挥基于超图的复杂相关性建模的潜力。

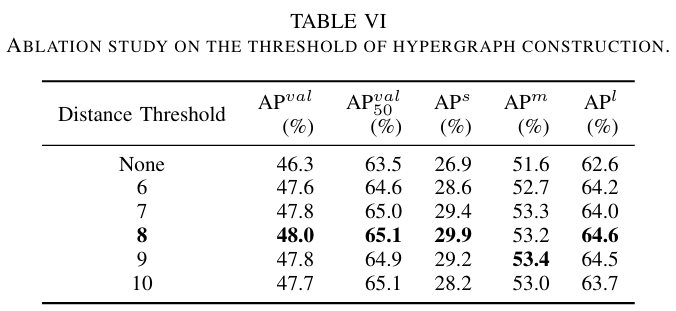

- 3)超图计算阶段的超图构建:进一步开展了消融实验,以检验超图构建中所使用的距离阈值的影响,结果如表VI所示。与未引入超图计算的“无”配置相比,引入超图计算显著提升了整体性能。同时观察到,在7到9的阈值范围内,目标检测网络的性能相对稳定,仅有微小变化。然而,在阈值为6和10时,性能出现了下降。这可以归因于连接节点的数量直接影响语义空间中特征的平滑度。较高的阈值可能导致超图连接更紧密,节点间更易共享信息,从而可能导致特征过度平滑。相反,较低的阈值可能导致超图连接不足,无法充分利用特征间的高阶关系。因此,我们的Hyper-YOLO采用距离阈值8进行构建。该精确值将根据经验结果确定,平衡超图丰富连接的需求与特征表示过度平滑或连接不足的风险。

E. 更多消融研究

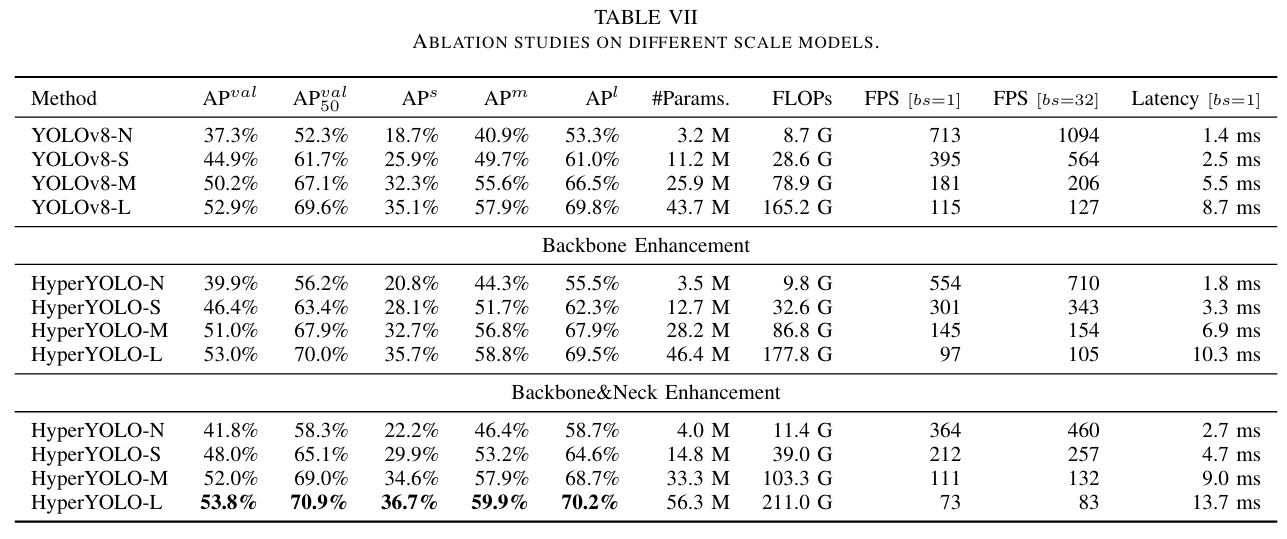

在本小节中,我们进行了全面的消融研究,以评估Hyper-YOLO中主干和颈部增强在四种不同模型尺度下的影响,详细结果如表VII所示。YOLOv8的基线性能列于表格顶部。表格中部介绍了仅融入主干增强的HyperYOLO模型。底部则展示了同时受益于主干和颈部增强的完全增强型HyperYOLO模型。基于表VII中的实验结果,我们得出以下三点观察。

首先,无论是单独还是组合采用增强措施,均显著提升了−N-N−N、−S-S−S和−M-M−M模型的性能,验证了我们所提修改的有效性。其次,每种增强措施的影响似乎与模型尺度相关。从−N-N−N到−S-S−S、−M-M−M和−L-L−L模型,主干改进带来的增量性能增益逐渐从2.6降至1.5、0.8,最终降至0.1。相比之下,颈部增强在这些尺度上持续贡献更显著的改进,增益分别为1.9、1.6、1.0和0.8。

这表明,虽然主干中扩展的感受野和宽度缩放对较小模型的益处更为明显,但先进的HyperC2Net颈部通过丰富语义内容和全面提升目标检测性能,提供了更均匀的增强。第三,当聚焦于小目标检测(APs\mathrm{AP}^{s}APs)时,同时采用主干和颈部增强的Hyper-YOLO-L模型实现了1.6的显著提升,而仅采用主干增强则带来了0.6的提升。这凸显了超图建模(特别是颈部增强中的超图建模)在捕捉小目标间复杂关系并显著提升这些具有挑战性场景下检测性能的潜力。

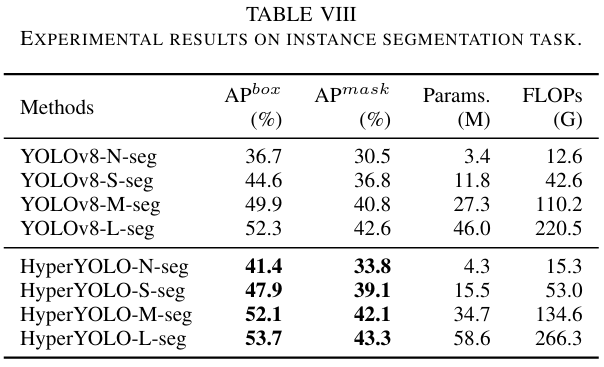

F. 实例分割任务的更多评估

我们将Hyper-YOLO的应用扩展至COCO数据集上的实例分割任务,通过采用一致的网络修改方法(即用分割头替换检测头),确保与前身YOLOv8进行直接比较。实验结果如表VIII所示。

实证结果清晰表明,Hyper-YOLO实现了显著的性能提升。对于APbox\mathrm{AP}^{box}APbox,Hyper-YOLO的−N-N−N变体提升了4.7 AP,−S-S−S变体提升了3.3 AP,−M-M−M变体提升了2.2 AP,−L-L−L变体提升了1.4 AP。同样,对于APmask\mathrm{AP}^{mask}APmask,Hyper-YOLO也表现出显著改进,−N-N−N变体提升了3.3 AP,−S-S−S变体提升了2.3 AP,−M-M−M变体提升了1.3 AP,−L-L−L变体提升了0.7 AP。这些结果凸显了Hyper-YOLO中集成改进的有效性。

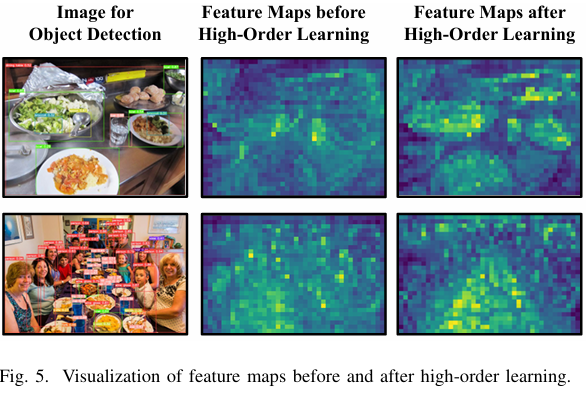

G. 目标检测中高阶学习的可视化

在本论文中,我们提供了数学理论依据,解释了基于超图的颈部如何超越传统颈部设计的局限性,传统设计通常依赖网格状邻域结构在特征图内进行消息传播。这种设计使得能够在特征的语义空间中进行先进的高阶消息传播。为进一步证实我们基于超图的颈部的有效性,我们在修订后的稿件中加入了可视化内容,如图5所示。这些可视化对比了应用HyperConv层前后的特征图。从这些图像中可以明显看出,对语义相似背景(如天空和地面)的关注度持续降低,同时在各种场景中保持对前景对象的关注。这表明,HyperConv通过超图计算,帮助颈部更好地识别图像中语义相似的对象,从而支持检测头做出更一致的决策。

六. 结论

在本文中,我们提出了Hyper-YOLO,这是一种开创性的目标检测模型,它将超图计算与YOLO架构相集成,以利用视觉数据中高阶相关性的潜力。通过解决传统YOLO模型的固有局限性,特别是颈部设计无法有效整合不同层级的特征并利用高阶关系的问题,我们显著推动了目标检测领域的最新技术发展。我们的贡献为未来目标检测框架的研究与开发树立了新的标杆,并基于我们的HGC-CSC框架,为在视觉架构中进一步探索超图计算的集成铺平了道路。

附录A

Hyper-YOLO的实现细节

本节详细介绍了我们提出的模型:Hyper-YOLO-N、Hyper-YOLO-S、Hyper-YOLO-M和Hyper-YOLO-L的实现。这些模型基于PyTorch开发。与YOLOv8[8]的配置一致,我们的模型具有相似的架构和损失函数,但显著的区别在于集成了MANet和HyperC2Net。我们集成了一个高效的解耦头,用于精确的目标检测。Hyper-YOLO-S的具体配置如图S1所示。

A. 主干

HyperYOLO的主干在表S1中有详细说明,它是在前代模型的基础上进行了更新,将C2f模块替换为MANet模块,同时保持了与YOLOv8[8]相同的层数结构,即[3,6,6,3]。每个阶段的通道数与YOLOv8保持一致,唯一的变化是模块的替换。MANet采用深度可分离卷积,并增加了通道数,其中2c2c2c的输入扩展为4c4c4c的输出(2c2c2c相当于CoutC_{out}Cout)。

除了这些调整外,四个阶段的超参数KKK和nnn分别设置为[3,5,5,3]和[3, 6,6, 6] × 深度。深度乘数在不同尺度的模型中有所不同,Hyper-YOLO-N、Hyper-YOLO-S、Hyper-YOLO-M和Hyper-YOLO-L分别设置为1/3、1/3、2/3和1。这意味着模型在每个阶段的实际nnn计数为[3,6,6, 6]

乘以相应尺度的深度因子。这些规格确保HyperYOLO模型的每个尺度都配备了针对其大小和复杂度进行精细调整的主干,从而在多个尺度上实现高效的特征提取。

B. 颈部

与YOLOv8的颈部设计相比,Hyper-YOLO模型引入了HyperC2Net(基于超图的跨层级和跨位置表示网络)作为其颈部组件,具体结构如图4所示。这一创新结构是所提出的HGC-SCS框架的体现,专门用于捕捉语义空间中潜在的高阶相关性。

HyperC2Net旨在全面融合来自主干网络的跨层级和跨位置信息。通过利用超图架构,它有效地捕捉了不同层级和位置的特征点之间的复杂相互依赖关系。这使得模型能够构建输入数据的更复杂和丰富的表示,尤其有助于识别和处理图像中的细微差异。在Hyper-YOLO模型的不同尺度下,颈部在保持高阶相关表示的一致性方面起着关键作用。由于特征点的空间分布在Hyper-YOLO-N和Hyper-YOLO-L等模型之间可能存在显著差异(后者通常具有更分散的分布),HyperC2Net根据每个模型尺度的不同采用不同的距离阈值进行调整,如表S2所示,以确保网络能够在不过度平滑的情况下捕捉到适当水平的高阶相关性。HyperC2Net能够根据模型尺度和特征点分布动态调整其阈值,体现了其设计的复杂性。它在深度语境理解与保持特征空间清晰度和粒度需求之间取得了精细平衡,从而提高了模型在各种复杂视觉环境中检测和分类对象的整体性能。

附录B 结果可视化

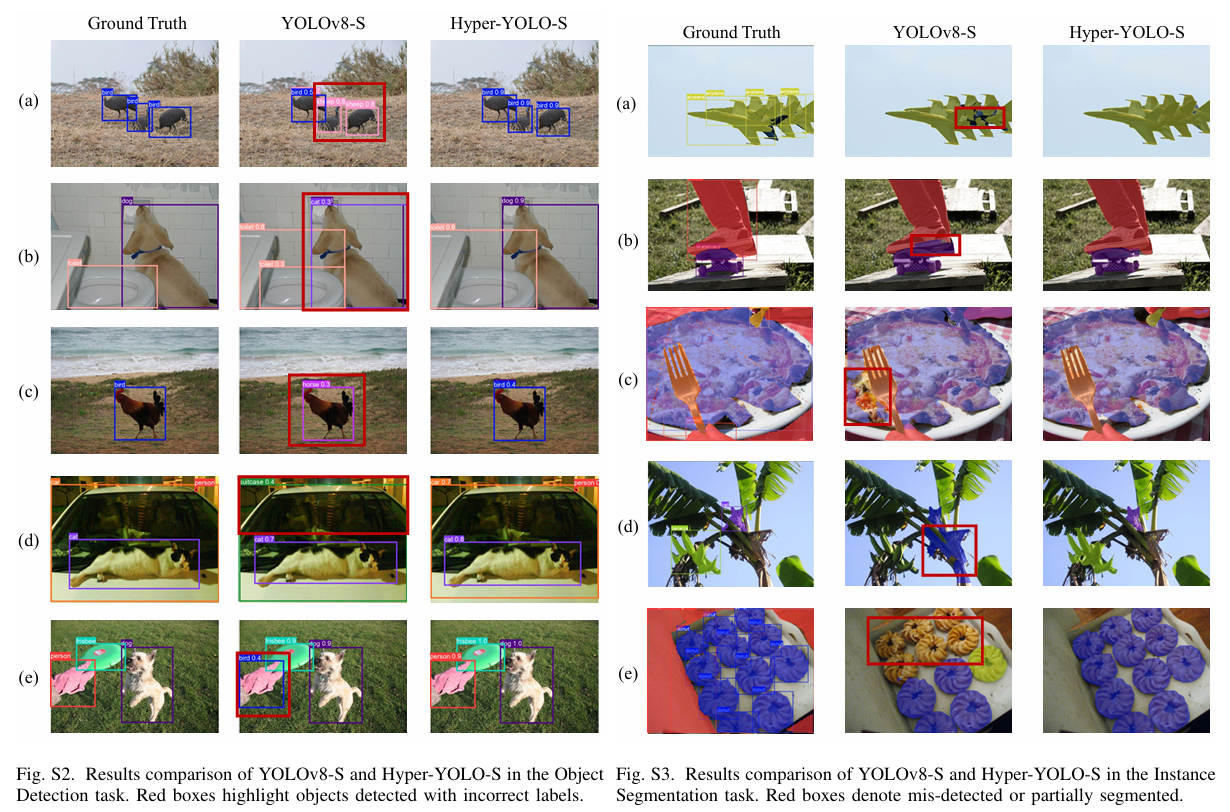

本节进一步提供了Hyper-YOLO在目标检测和实例分割两个任务上的可视化结果,分别如图S2和图S3所示。

A. 物体检测

图S2中的结果表明,我们的Hyper-YOLO模型在目标识别方面表现出色,如图(b)和©所示。此外,由于其架构中采用了基于超图的颈部,Hyper-YOLO具有一定的类别推理能力。这在图(a)中最为明显,Hyper-YOLO能够高置信度地推断出,如果检测到一只鸟,其他两个实体也是鸟。此外,如图(e)所示,人类通常使用飞盘与狗玩耍。尽管图像中仅可见手套,但我们的Hyper-YOLO仍能将其识别人类的一部分。

B. 实例分割

图S3的结果表明,与YOLOv8相比,Hyper-YOLO在分割任务的分类和边界划分方面均有显著改进。尽管图(a)中的真实标注并不完全准确,但我们的Hyper-YOLO仍能提供精确的边界分割。图©、(d)和(e)展示了更复杂的场景,但我们的Hyper-YOLO继续提供准确的实例分割结果,确保不遗漏任何一块饼干。

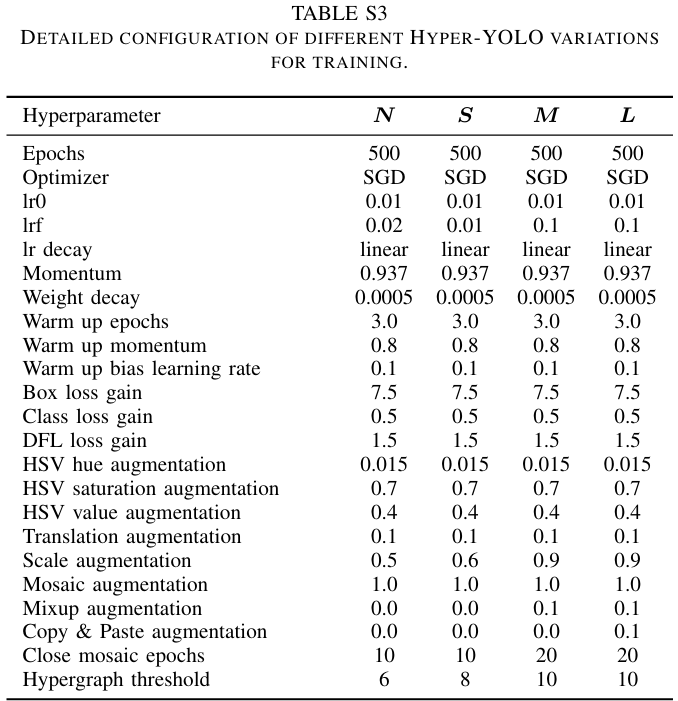

附录C Hyper-YOLO的训练细节

Hyper-YOLO的训练方案经过精心设计,以确保在不同实验中保持一致性和鲁棒性。每块GPU分配统一的批大小为20,以保持计算环境的一致性,总共使用8块NVIDIA GeForce RTX 4090 GPU。为了评估学习效果和泛化能力,所有Hyper-YOLO的变体,包括-N、-S、-M和-L,均从头开始训练。模型进行了500轮训练,不依赖ImageNet等大规模数据集的预训练,从而避免潜在偏差。训练超参数根据模型的不同尺寸进行了微调。表S3总结了每个模型尺度的关键超参数。

核心参数(如初始学习率和权重衰减)在所有尺度上统一设置,以标准化学习过程。然而,超图阈值根据模型尺度和批大小进行了调整。该阈值是在每块GPU批大小为20的前提下配置的,这意味着如果批大小发生变化,阈值也需要相应调整。一般来说,单块GPU上较大的批大小需要较低的阈值,而较大的模型尺度则需要较高的阈值。

大多数超参数在不同模型尺度上保持一致:然而,学习率、缩放增强、混合增强、复制粘贴增强和超图阈值等参数根据模型的具体尺度进行了调整。数据增强超参数根据YOLOv5的配置进行设置,并对Hyper-YOLO进行了一些修改。例如,N和S模型采用较低水平的数据增强,并对N模型的最终学习率(lrflr_flrf=0.02)和S模型的缩放增强(缩放=0.6)进行了特定调整。

另一方面,M和T模型分别采用了中等和高等水平的数据增强,两个尺度的关闭马赛克轮数相同(20)。

需要强调的是,超图阈值是在每块GPU批大小为20的前提下设置的。批大小的改变应伴随阈值的相应调整,趋势是单块GPU上较大的批大小应导致较小的相对阈值。类似地,较大的模型尺度需要较高的阈值。大多数超参数在不同模型尺度上保持一致,但lrflr_flrf、缩放增强、混合增强、复制粘贴增强和超图阈值等少数参数根据模型的具体尺度进行了调整。数据增强参数主要基于YOLOv5的设置,部分值根据Hyper-YOLO模型的不同需求进行了调整。

附录D 速度测试细节

我们对Hyper-YOLO模型的速度基准测试采用两组方法。第一组包括需要重新参数化的模型,如YOLOv6-3.0和Gold-YOLO。第二组包括YOLOv5、YOLOv8和HyperYOLO。值得注意的是,在转换为ONNX格式的过程中,HyperYOLO模型的“torch.cdist”函数出现问题,导致批大小为32时张量过大而出现错误。为了解决这一问题并确保准确的速度测量,我们在测试期间用自定义特征距离函数替换了“torch.cdist”函数。此外,我们还测试了仅增强主干的变体的速度。

基准测试过程包括将模型转换为ONNX格式,然后转换为TensorRT引擎。测试分两次进行,批大小分别为1和32,以评估不同操作环境下的性能。我们的测试环境受控,包括Python 3.8.16、Pytorch 2.0.1、CUDA 11.7、cuDNN 8.0.5、TensorRT 8.6.1和ONNX 1.15.0。所有测试均在固定输入尺寸为640×640像素的条件下进行。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献154条内容

已为社区贡献154条内容

所有评论(0)