趣味解析——机器学习和深度学习的关系及深度学习的意义

在人工智能领域,机器学习和深度学习各有其适用场景和特点。传统机器学习模型结构简单,适合处理数据量小、特征明确且需要高可解释性的任务,如金融风控或相亲决策。这些场景中,模型需要明确解释其决策依据,如信用卡逾期或相亲对象的行为特征。而深度学习则通过复杂的神经网络自动学习特征,适合处理非结构化数据,如图像、文本和语音。深度学习的模型结构复杂,参数众多,计算量大,且对数据需求高,但其在处理大规模数据和复杂

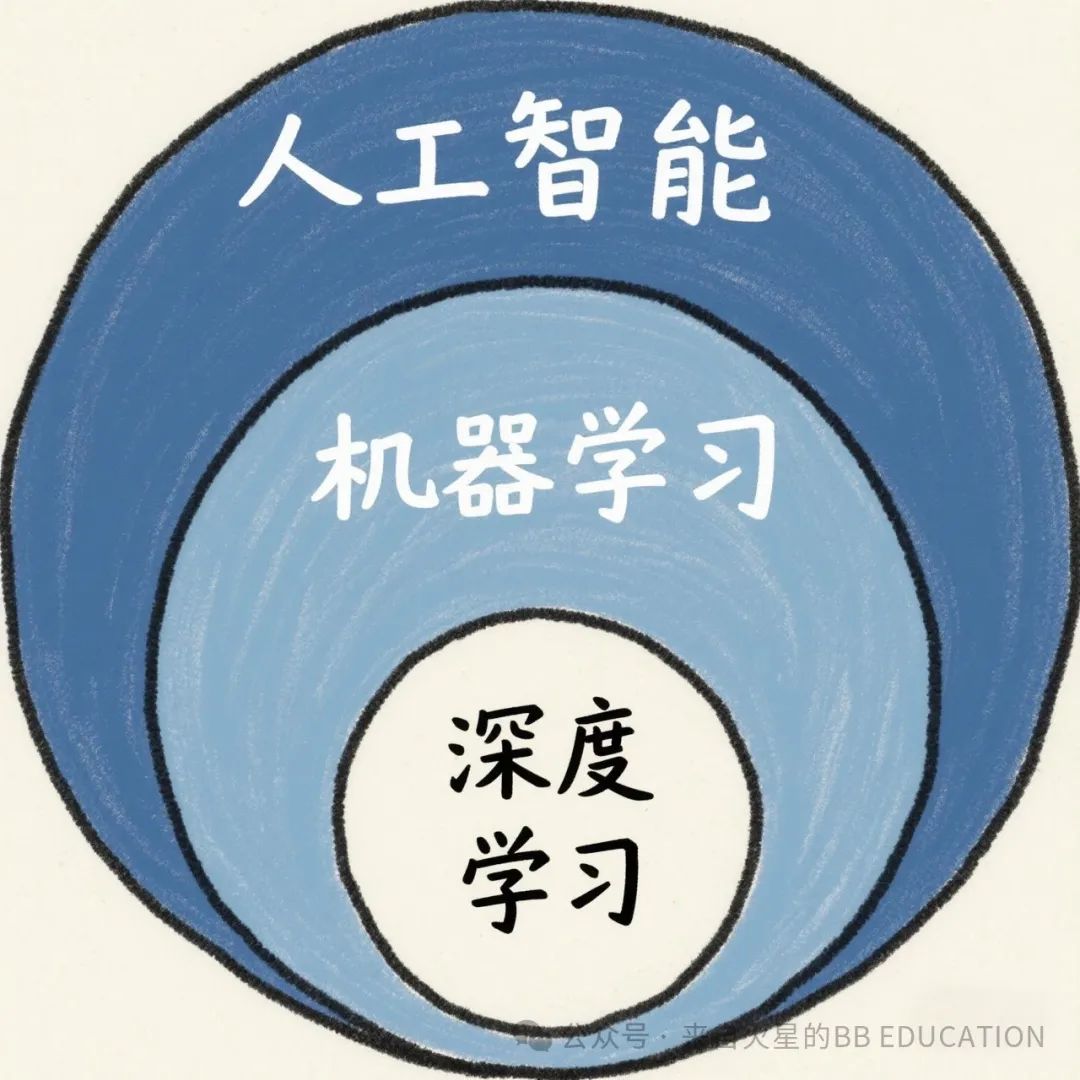

在人工智能领域,机器学习和深度学习大概是下面这个关系。

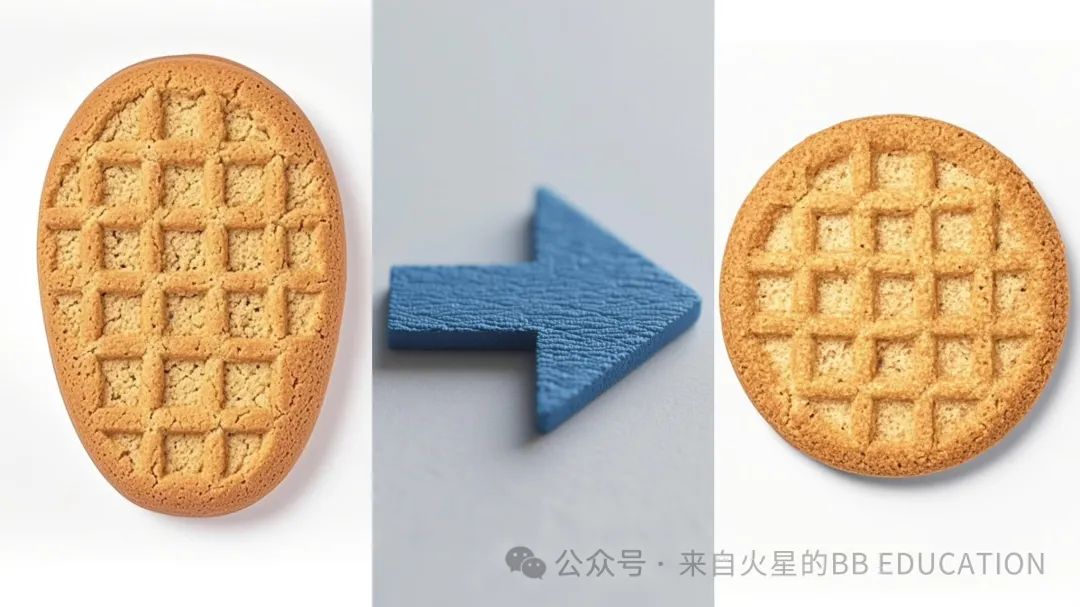

就像:

传统机器学习模型相对简单,

适合数据量小、特征明确、需快速部署或可解释性需求高的任务。

例如你假期回家stay,你妈骂不骂你主要取决于你是否早睡早起,你玩手机的频率以及主动做家务的效率。

这就是所谓的特征明确。

而这时有人给你介绍对象了。你决定去看看👀,但感觉不OK。

如果你想明确拒绝对方,得向介绍人解释清楚:

由于对方多次吃饭抠脚,bia ji嘴等。。。

这叫可解释性需求高。

常见于高风险(容易得罪人)、强监管(长辈监管)或需要用户信任的场景。

e.g.金融风控中,银行需要解释清楚拒贷的原因比如xx信用卡还款逾期等。这和拒绝相亲对象异曲同工嘛~~( ̀⌄ ́)~。

众所周知,相亲成功与否和双方的外形条件、经济水平以及嘴巴甜不甜关系也比较大。(特征明确)

但互相能否看对眼,对彼此有感觉这确实属于玄学范畴。😁

而深度学习就做的是这种“低可解释性”的操作。俗称玩抽象。

它和传统机器学习的不同之处在于深度学习里一系列连续的表示层。

这些分层表示是通过叫做神经网络的模型学习得到的。

所以深度学习的模型往往比传统机器学习更为复杂(结构复杂、参数众多、计算量巨大和数据需求大)。

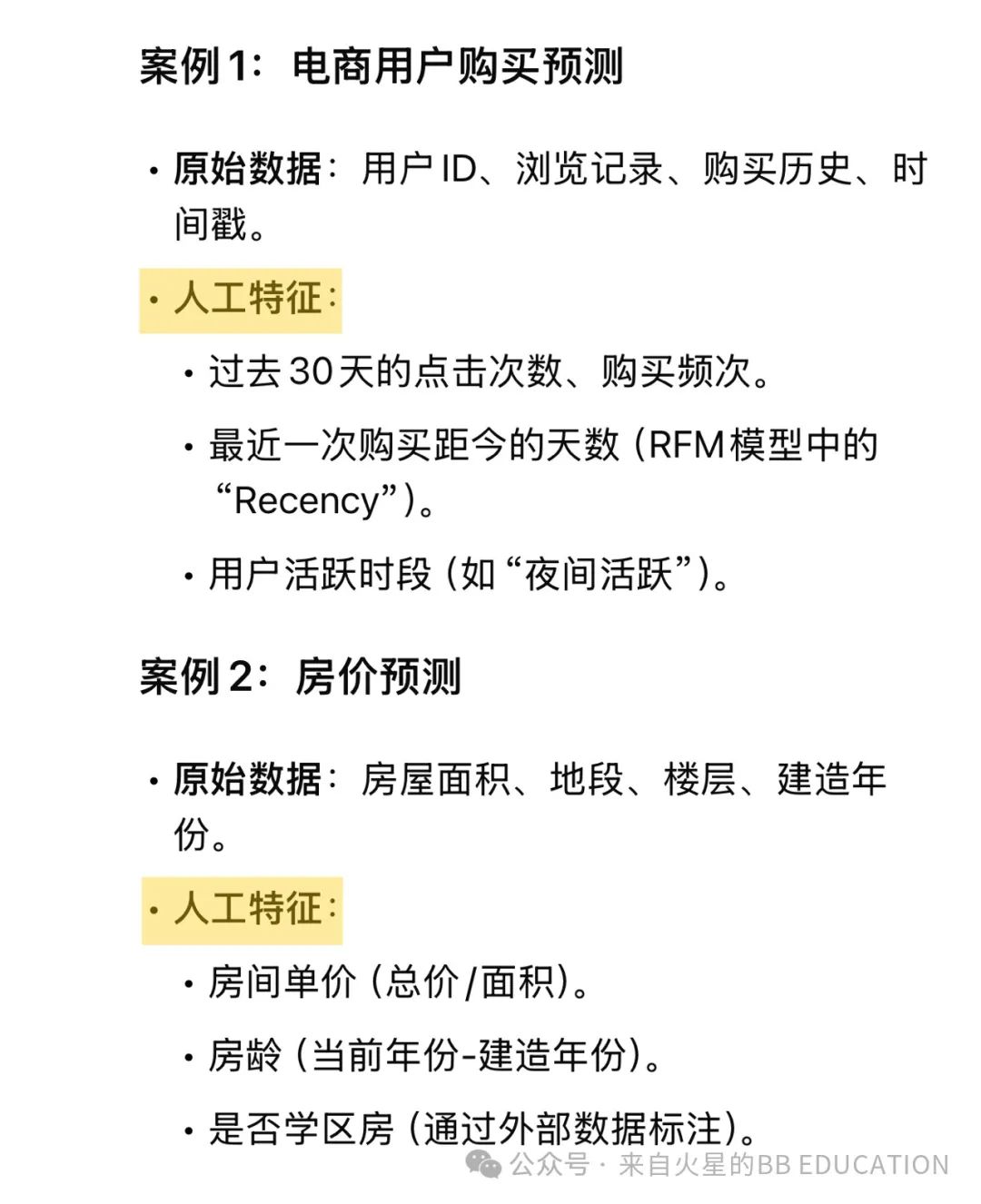

传统机器学习常依赖人工特征工程来学习,类似于从小听老师家长的话,被安排得明明白白的按部就班的小学霸;

而深度学习通过神经网络层级自动学习特征,属于不知道怎么回事谁的话也不听但每次都考满分的学神🤔。

举几个常见例子:

这是传统机器学习——

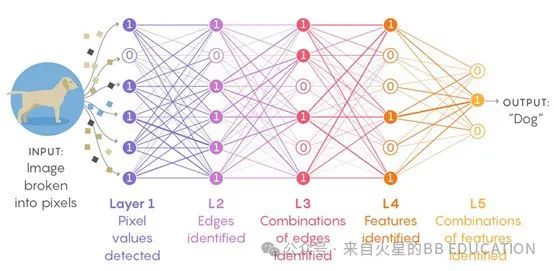

而这是深度学习——

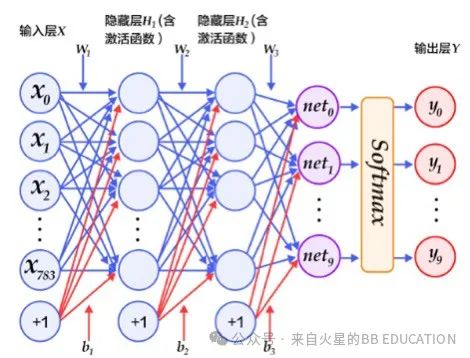

其中每一个小圈圈⭕️代表一个神经元。由它们组成的竖着的这部分是神经元的层(下图更简洁)。

输入层(Input Layer)和输出层(Output Layer)还比较好理解。隐藏层(Hidden Layer)是什么🤔🤔?

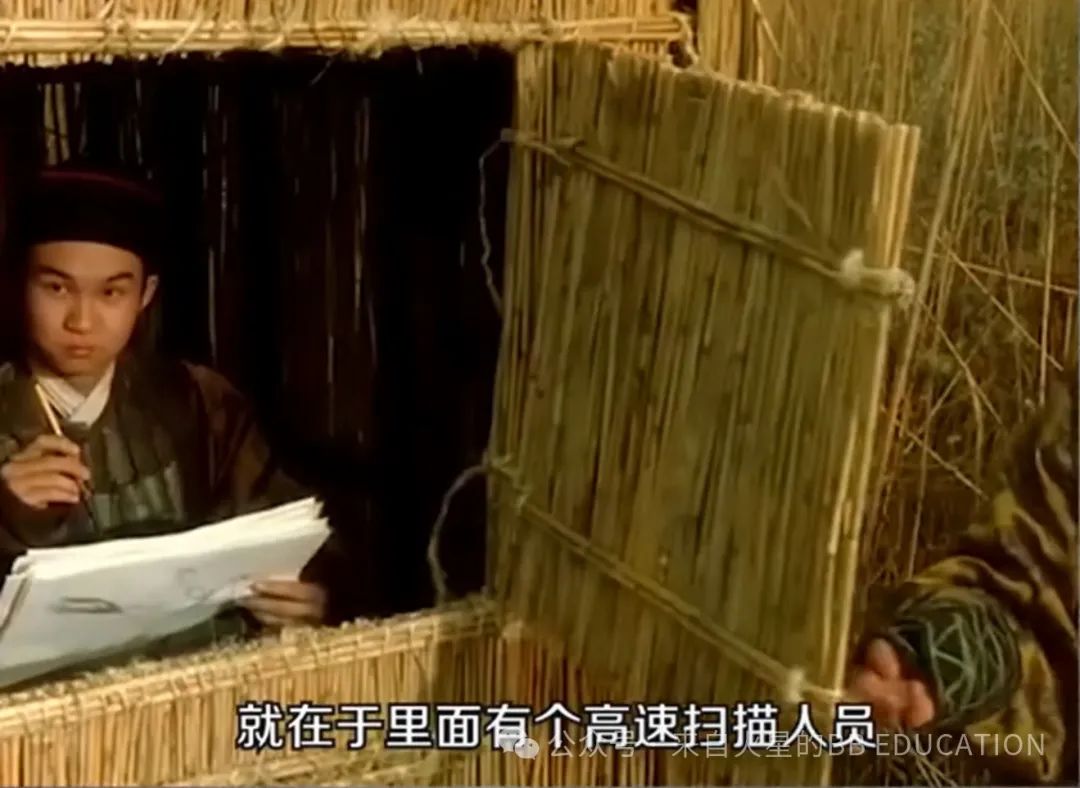

大家看过电影《天下无双》吗?

这可能是早期真“人工”智能?

大家可以把神经网络的每个隐藏层想象成这样一个高速扫描仪器。里面有高速扫描人员在玩抽象~~( ̀⌄ ́)~~。

传统机器学习有真·人工特征工程,深度学习神经网络有虚拟抽象·特征工程。

@.@

其实传统机器学习更擅长处理结构化数据,而深度学习更适合处理非结构化数据。

所以在面对各种非结构化原始数据,例如视频、文本、图像、语音等,使用深度学习的神经网络模型来处理会表现更好。

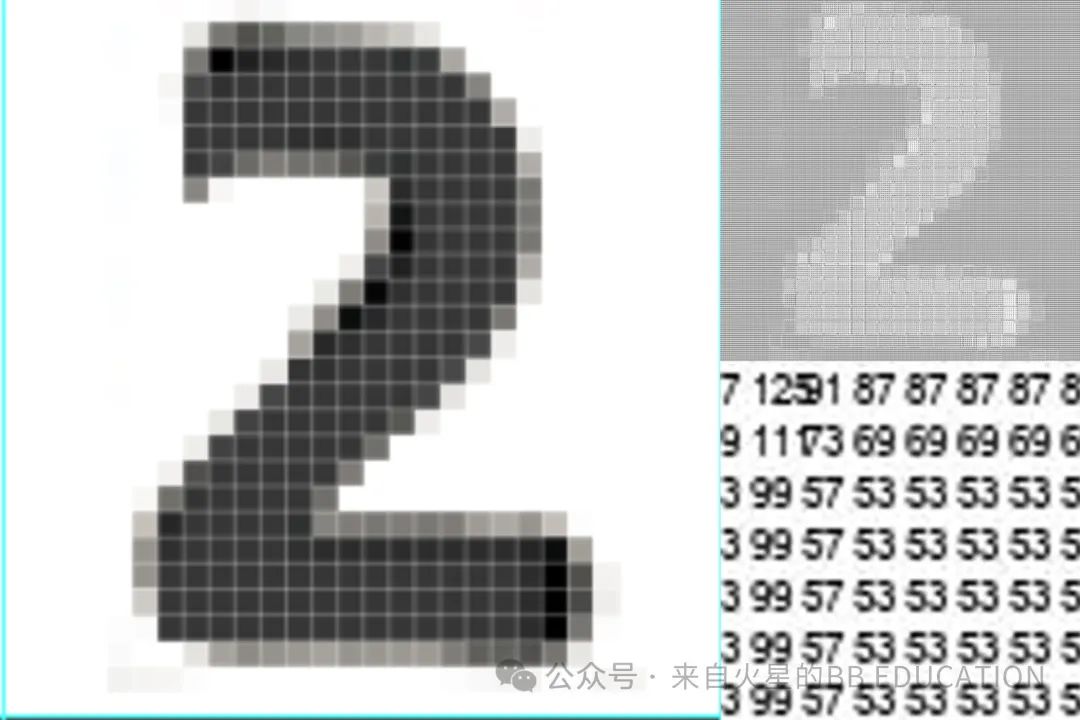

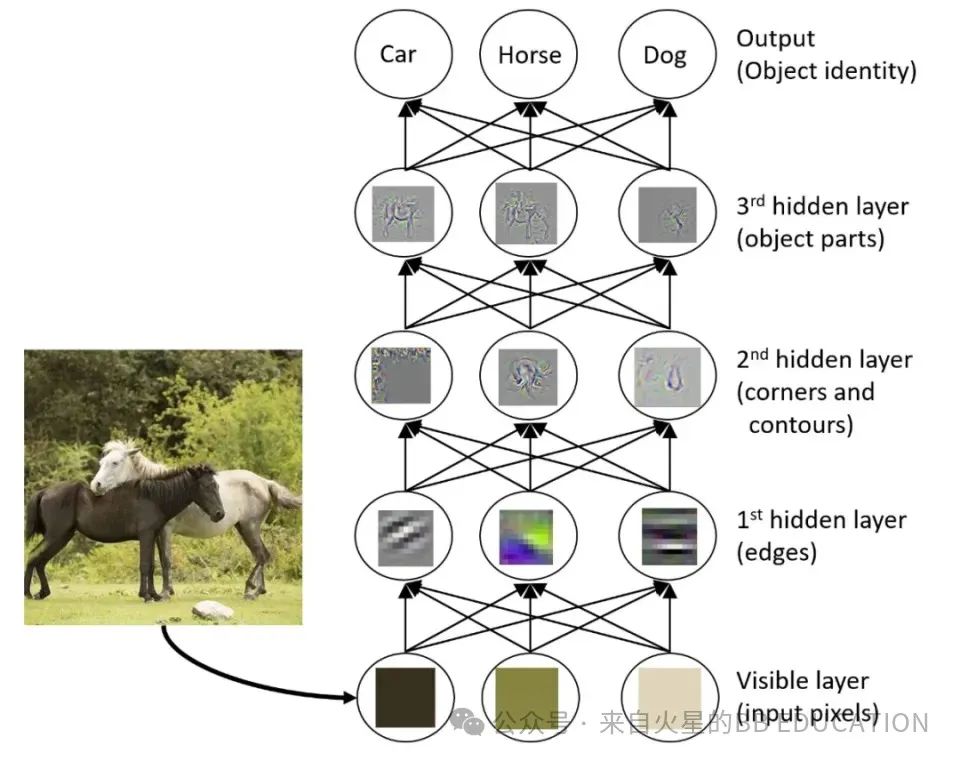

给输入层(Input Layer)输入以上类型的原始数据。比如在图像识别任务中,输入数据可能是图像的像素值。

这里有一个手写数字图,我们用Python把它的像素点的值display一下以方便观看👀:

右下角截取的是放大版的某些像素点的值。

这个原图的信息如下:

200*199=39800。

看起来好像不怎么大,其实有39800个像素点(if灰度图)。而RGB 图像每个像素点由红(R)、绿(G)、蓝(B)三个通道组成,每个通道都有一个数值表示其颜色强度。所以对于尺寸为 200×199 的 RGB 图像,输入神经网络的特征数量是 200×199×3 = 119400 个。

那如果有几十上百万张这样的图呢?

所以咱们需要强大的神经网络✌️!

然后以上这些类似于图像信息等等等的原始数据会经过一系列的数据预处理和格式转换。

比如归一化处理,

e.g.

或将数据标准化到均值为0、标准差为1的分布。

以及降维,例如降采样、主成分分析(PCA)、自动编码器等。【下图是Python演示的PCA降维⬇️】:

此时输入层会将数据分发给后续的隐藏层(Hidden Layer)进行进一步的处理和特征提取。

轮到隐藏层发力了,此时它们暗搓搓滴开始暗箱操作~~。

我一般叫隐藏层为“抽象层”。

呵~我们INTP最喜欢玩抽象~( ̀⌄ ́)~~

以下是隐藏层的大致任务——

(1)信息传递与计算;

(2)通过激活函数进行非线性变换,从而使模型学到更复杂的函数关系;

(3)当然还有特征提取与表示学习等。

之所以玩抽象,很大程度是因为层多(e.g.非线性变换的累积)➕反向传播(e.g.权重耦合性)等因素。

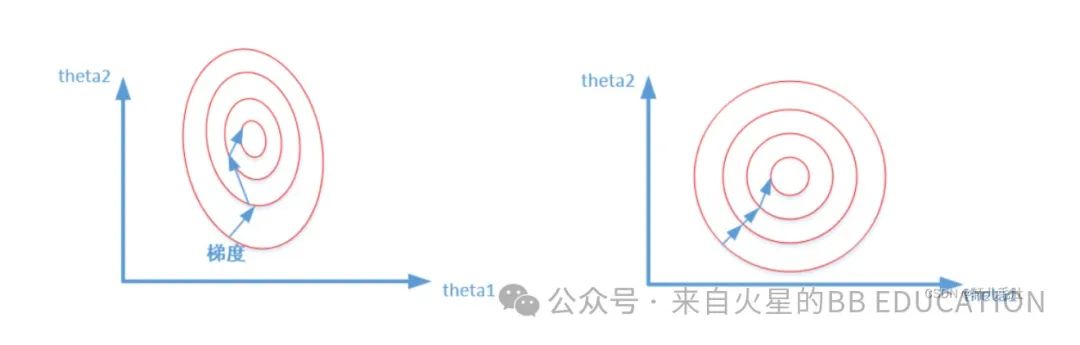

反向传播是深度学习中用于训练神经网络的核心算法,它基于链式法则,通过计算损失函数对每个参数的梯度,从而更新网络中的权重和偏置,使得模型的预测结果逐渐接近真实值。

如果没有学过微积分偏导可能不是很懂这里。但无所谓😑,下面⬇️这两个图可以加强理解。

这是偏导(只倒了一个轮子,另一个轮子看做常数)~~:

这是链式法则:

学废了吗?

@.@

深度学习算法和传统的机器学习一样,主要求的是权重(w)和偏置(b)。只不过层太多,深度学习玩的是一抹多的w和b...

For example:

![]()

所以很难去解释清楚,尤其是隐藏层暗搓搓地学到了什么具体特征。

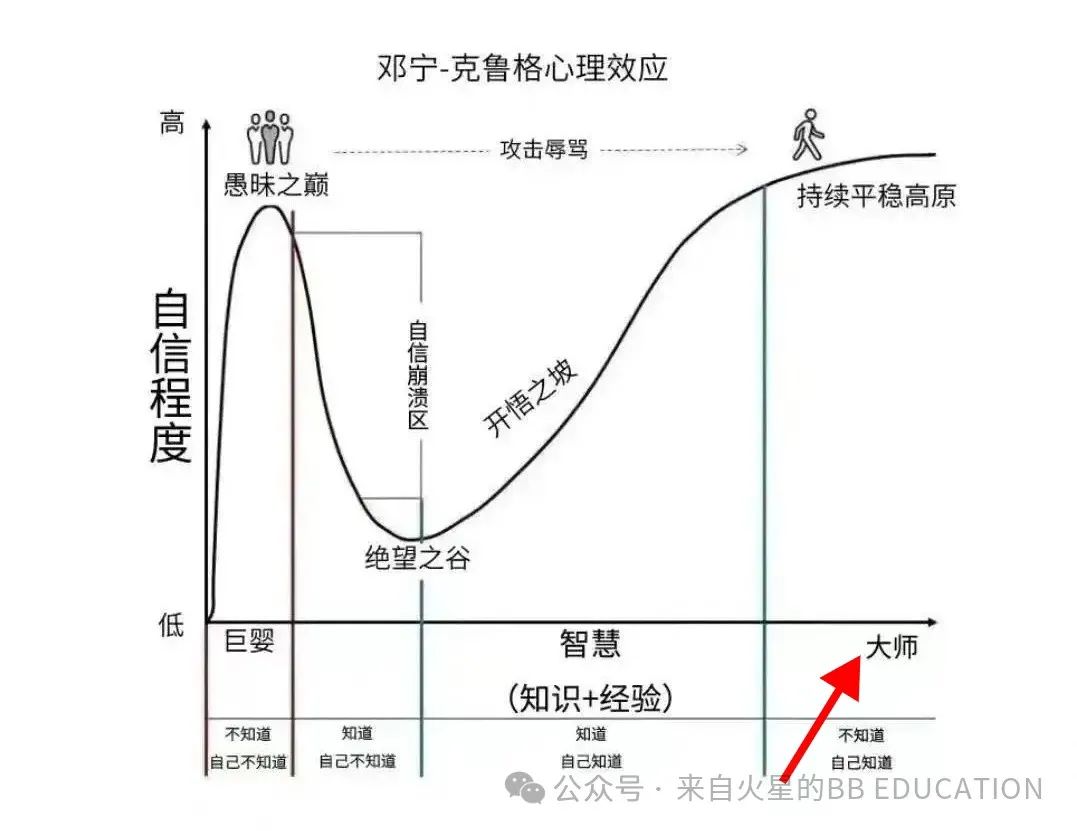

这就是高手的境界~~~!

大师,我悟了。

而图像识别在历经了无数张图像的训练后,大致摸清了一丁点儿小方向。

将某图像输入神经网络(假设是CNN模型),隐藏层的浅层网络可能首先提取的是一些低级的特征,比如边缘、颜色、纹理等;接着中层网络会提取一些形状、部件,这属于中级特征;高级特征比如物体整体、语义概念等,这些由深层神经网络提取。

具体怎么学到的,o(* ̄︶ ̄*)o,它只会拈花一笑,睥睨众生。

但是冰冷的数据会告诉你,这就是规律!这就是原理✌️😅。

很早以前我就有这种人机思维模式,所以秒懂深度学习的方法😆。比如有人会给我说,每个case不一样,人不一样,应该case by case。我会认为,表面看似不一样,底层逻辑和大致规律其实是一样的。

只不过有些规律超出了可解释范畴,就像深度学习的神经网络,随着层数增加,原始输入的特征被反复组合、抽象,最终与高层特征的关联性变得难以追溯。

而其参数量庞大,特征交互复杂,人类难以直观理解高维空间中的决策边界。

不理解,不代表不存在。

这下直接升华到了哲学层面。😄

。。。。。。

人工神经网络借鉴了人脑神经元工作的一些原理,实际上不含任何医学/生命科学知识。😄因为医学/生命科学依然是最复杂的学科,我们目前对人脑的工作机制认识还比较浅薄。

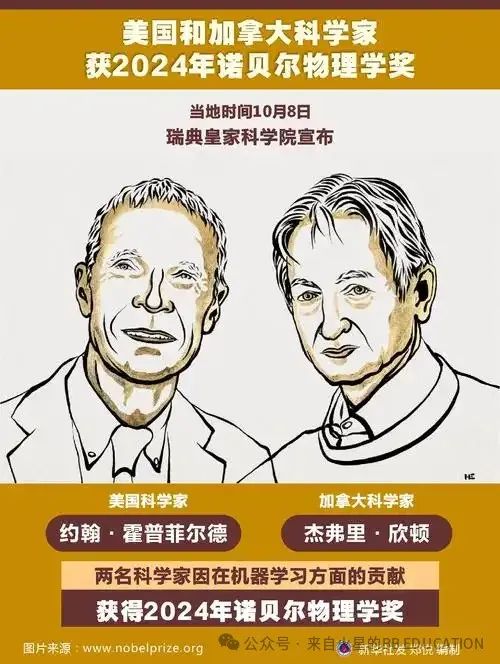

而且请注意,杰弗里・辛顿(Geoffrey Hinton)和约翰・霍普菲尔德(John Hopfield)获得的是2024年的诺贝尔物理学奖。前者被称为“神经网络之父”and“AI教父”,他也是2018年图灵奖得主。

所以别再出去说现代深度学习模型的学习机制和神经生物学中大脑的学习机制相同。丢撵~~

那么,为什么一定要了解深度学习呢?有什么意义。

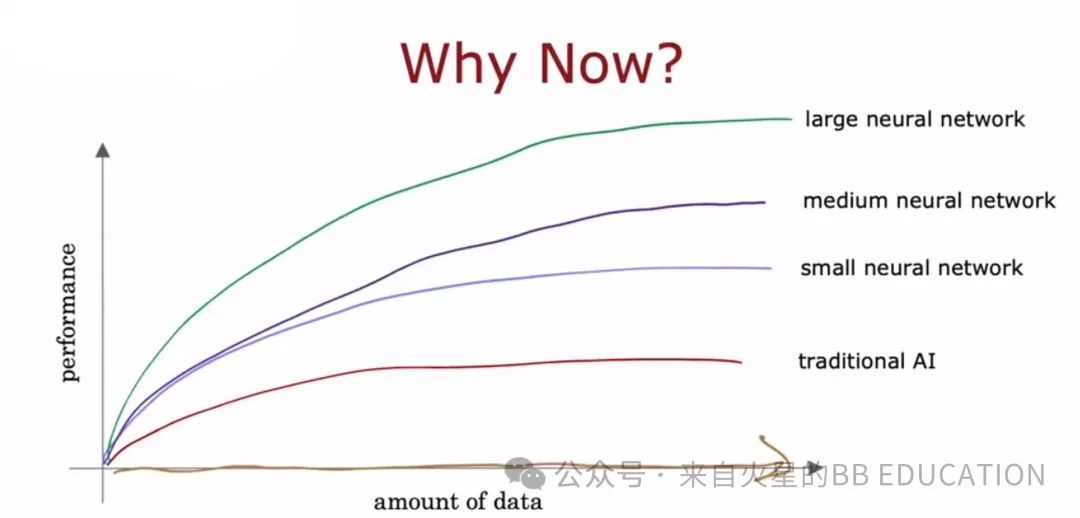

原因很简单,因为随着数据规模的不断增长和计算机硬件技术的不断提升(例如GPU、TPU的出现),传统机器学习在处理大规模数据和复杂任务时显示出了很大的局限性。

大概就是说,教小学生的方法不适用于教大学生了😅。

但传统机器学习在数据规模较小时还是很好用的,容易训练。它和深度学习是互补的关系。

我们目前正处在大数据主导的AI时代,那么仅仅学习传统的机器学习方法是远远不够的,掌握深度学习知识才具备更强核心竞争力。✌️✌️

时下最热门的各种大模型(如GPT-4.5,DeepSeek等),其技术本质就是基于深度学习的延伸。

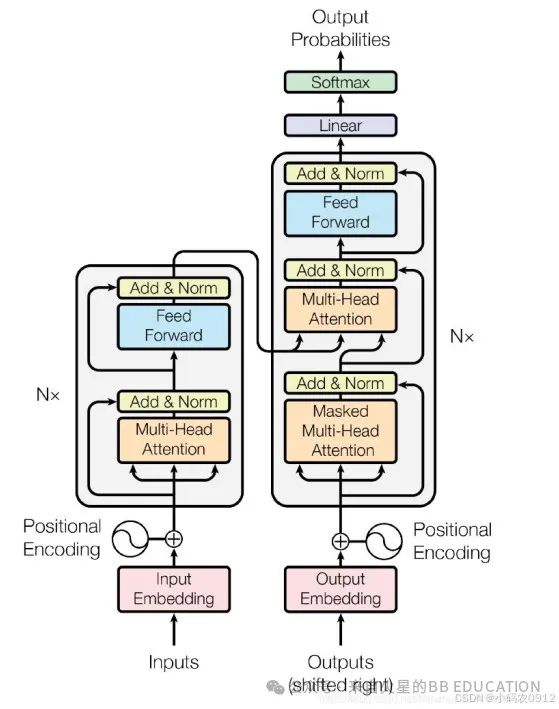

大模型的底层架构为深度学习中的神经网络模型,且通常采用多层级、高复杂度的结构。

传统深度学习的参数规模一般为千万到十亿级,而大模型的参数规模可达千亿到万亿级。

如果称传统深度学习是玩抽象的那位,大模型就是抽象之King。

大模型的核心底层架构如Transformer架构,它是深度学习中的自然语言处理(NLP)领域的标志性成果。【当然Transformer后来也应用于计算机视觉等其他领域,比如ViT】。

最后

如果你真的想学习人工智能,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

这里也给大家准备了人工智能各个方向的资料,大家可以微信扫码找我领取哈~

【注:以上部分图片用豆包AI和Python程序生成】

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献38条内容

已为社区贡献38条内容

所有评论(0)