神经网络调参步骤详解

需先设定基础参数,以保证模型能正常启动并开展训练,具体涵盖选取适宜的batch size与epoch。例如,batch size一般设为32、64或128,当下出现新趋势——动态batch size,可依据GPU内存自动调节。设定epoch值时,建议搭配early stopping与学习率调度器,如此便无需手动推测最优epoch数。如今调参无需手动逐一尝试,推荐使用Ray Tune、Optuna等

1.参数初始化与基础设定

需先设定基础参数,以保证模型能正常启动并开展训练,具体涵盖选取适宜的batch size与epoch。例如,batch size一般设为32、64或128,当下出现新趋势——动态batch size,可依据GPU内存自动调节。batch size过小或致训练不稳定,过大则会使内存消耗过多。设定epoch值时,建议搭配early stopping与学习率调度器,如此便无需手动推测最优epoch数。当前流行做法是采用Warmup + Cosine Annealing,其训练效果优于传统step decay。

2.学习率设定与模型结构优化

学习率如今有更智能的选取方式。除传统学习率衰减外,2025年较热门的是AdamW优化器搭配OneCycleLR。此组合在诸多任务中成效显著,尤其适用于transformer类模型。模型结构优化方面,当下NAS已颇为成熟。与其手动调整网络层数与宽度,不如借助AutoML工具让机器自主搜索最优架构。

3.损失函数选取与正则化策略

损失函数的选择更具灵活性。除传统交叉熵与MSE外,当下流行采用Focal Loss应对类别不平衡问题,运用Label Smoothing提升泛化能力。特别是在目标检测任务中,很多人开始采用IoU-aware损失函数。正则化方面,除传统Dropout外,DropPath、StochasticDepth等新技术更受青睐。此外,MixUp、CutMix等数据增强技术本质上亦属正则化范畴,效果颇佳。

4.高效调参与实验调整

如今调参无需手动逐一尝试,推荐使用Ray Tune、Optuna等自动调参工具,其支持贝叶斯优化,可自动探寻最优参数组合。尤其是Optuna的TPE算法,效率远超网格搜索。假设在训练YOLO模型时,可利用Optuna同时优化学习率、权重衰减、数据增强强度等多个参数。设定搜索空间后,让其运行一晚,次日便可直接获取结果。

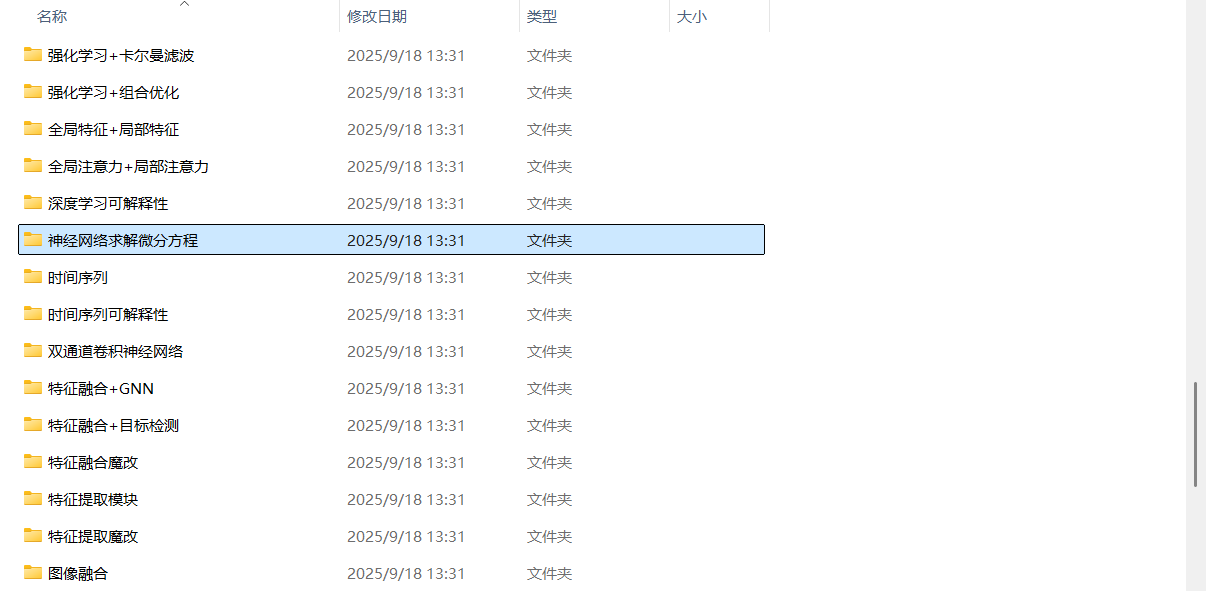

📗另外,我整理了十篇关于神经网络的最新论文及代码,方便大家参考。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)