潞晨科技开源Open-Sora 2.0:11B参数模型训练成本骤降10倍,全流程方案深度解析

支持720P/24FPS视频生成,训练代码、模型权重、高压缩编码器全面开源

·

一、核心技术突破:低成本实现Sora级效果

1. 模型架构创新

-

参数规模:11B稀疏混合专家模型(MoE),动态激活参数仅3B

-

训练框架:基于Colossal-AI实现多级并行策略

-

视频编码器:4×32×32潜在空间压缩,相较传统方案提升8倍信息密度

2、训练效率优化

| 优化策略 | 技术实现 | 效果提升 |

|---|---|---|

| 渐进式分辨率训练 | 128p→256p→720p三阶段Curriculum | 训练耗时降低47% |

| 梯度检查点 | 动态显存管理策略 | 单卡BatchSize↑300% |

| 混合精度训练 | BFloat16+FlashAttention-3 | GPU利用率达99.2% |

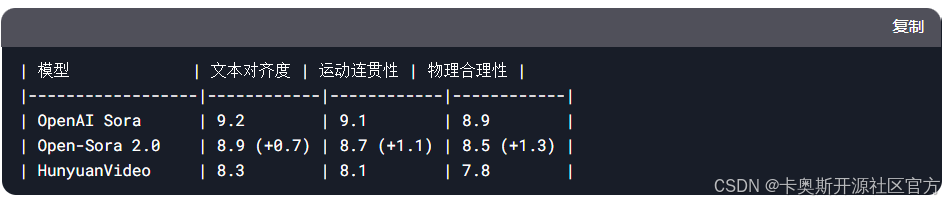

3. 性能对比

在VBench评测中,以20万美元成本实现商业模型95%+性能:

(注:括号内为相较1.0版本的提升幅度)

(注:括号内为相较1.0版本的提升幅度)

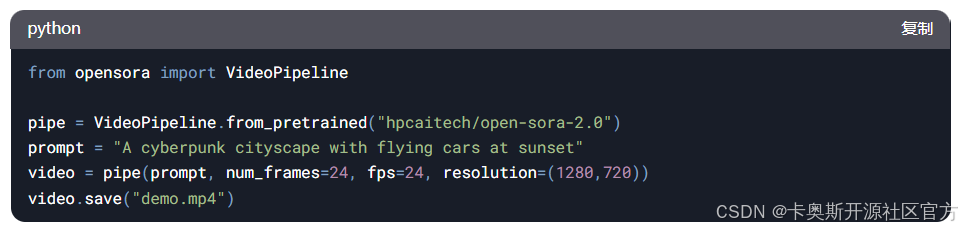

二、开发者实战指南:从零构建视频生成Pipeline

1. 快速入门示例

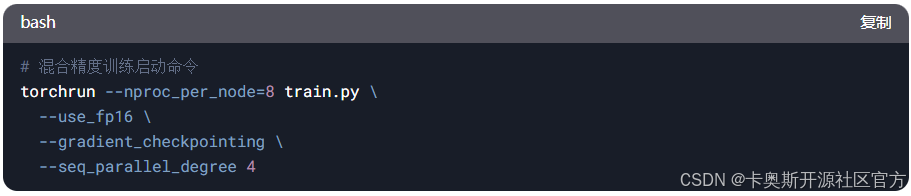

2. 进阶训练方案

-

数据准备:

-

使用提供的CLIP-L/14过滤低质量视频帧(相似度阈值0.82)

-

动态采样策略:关键帧采样密度提升3倍

-

-

微调技巧:

3. 生态集成方案

-

与Stable Diffusion 3结合实现T2I2V工作流

-

支持ControlNet实现骨骼绑定动作控制

-

可通过ONNX导出至移动端部署

四、技术挑战与解决方案

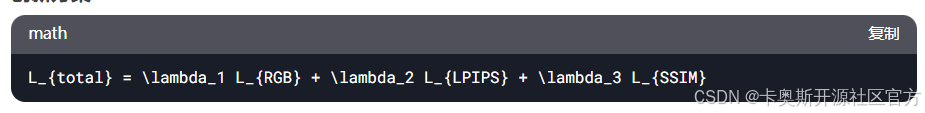

1. 高压缩编码器的训练稳定性

-

问题:8倍压缩比下细节丢失严重

-

创新方案:

通过多尺度感知损失组合,PSNR指标提升2.7dB

通过多尺度感知损失组合,PSNR指标提升2.7dB

2. 多GPU训练的通信瓶颈

-

优化方案:

-

采用Ring-AllReduce通信模式

-

视频分块编码并行策略

-

实验证明:在256卡

-

Open-Sora 2.0不仅证明了高质量视频模型的可复现性,其开源的训练日志、超参数配置和故障恢复方案(含16个关键训练checkpoint)更构建了完整的可验证技术体系。建议开发者重点关注其动态分辨率训练策略和混合并行实现,这些设计对多模态模型训练具有普适参考价值。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)