12篇成果入选CVPR 2026!百度实现视觉与多模态技术多点突破

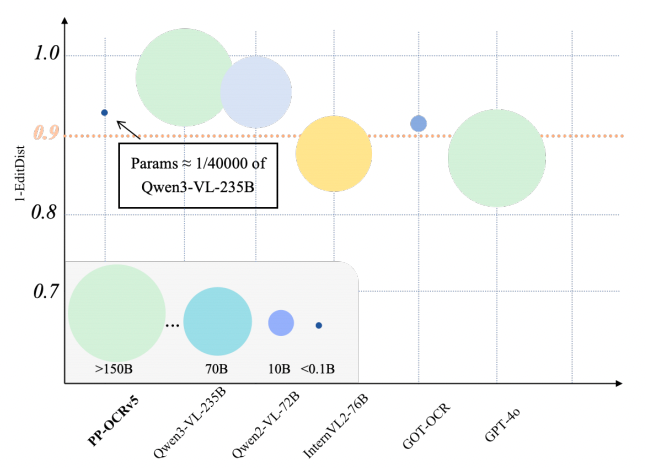

为了解决这一问题,我们提出了 PaddleOCR-VL,这是一种新颖的“由粗到精(Coarse-to-Fine)”架构,它专注于语义相关的关键区域,同时抑制冗余信息,从而同步提升解析效率与性能。在 OCR 任务中,PP-OCRv5以仅5M 的参数量(约为 Qwen3-VL-235B 的四万分之一),实现了与 GPT-4o、Qwen2-VL 等千亿级大模型相当的准确率(1-EditDist约为0.9

近日,计算机视觉领域顶级国际会议 CVPR 2026 公布论文录用结果。百度共12篇研究成果成功入选,相关论文覆盖多模态理解与生成、人脸活体识别、矢量地图、实时新视角合成、自动驾驶3D 场景重建与生成、3D+视频生成等多个前沿研究方向,体现了百度在视觉与多模态领域的持续技术积累与创新探索。

作为全球计算机视觉领域最具影响力的学术会议之一,CVPR 与 ICCV、ECCV 并列为视觉方向三大国际顶级会议。会议长期保持极高的学术标准与竞争强度,每年吸引来自全球顶尖高校与科技公司的大量投稿。

近年来,CVPR 论文投稿量持续攀升。根据会议官方邮件通知,2026 年共有16,092篇论文进入审稿流程,程序委员会最终推荐录用4,090篇论文,整体录用率为25.42%。CVPR 2026 将于6月3日至7日在美国丹佛举行。

以下为百度入选论文分享:

01.

PP-OCRv5: A Specialized 5M-Parameter Model Rivaling Billion-Parameter Vision-Language Models on OCR Tasks

项目链接:https://github.com/PaddlePaddle/PaddleOCR

论文简介:PP-OCRv5是一款仅5M 参数的超轻量级 OCR 系统,其核心亮点在于打破了“模型越大越好”的传统观念限制,通过数据为中心(Data-Centric)的系统化优化策略,在 OCR 性能上媲美甚至超越 GPT-4o 等千亿参数的视觉语言大模型(VLMs)。

技术创新: 论文首创了一套针对 OCR 数据的量化分析框架,从难度、准确性、多样性三个维度重构数据策略。关键发现包括:1)模型训练存在“难度甜点区”(中等难度数据最高效);2)模型对少量标签噪声具备一定的鲁棒性,从而为智能数据标注提供可能性;3)特征多样性是提升泛化能力的决定性因素。

应用价值: 作为工业级两阶段(检测+识别)解决方案,PP-OCRv5不仅解决了大模型产生幻觉、定位不准及算力昂贵的痛点,更在手写、多语言及自然场景下表现优越。同时该论文更向业界输出了一套通用的数据处理范式。有力证明了通过精细化的“数据工程”,小模型可以在 OCR 场景媲美大模型,这一方法论为 OCR 场景开发高效能、低成本的专家模型提供了具有实战价值的参考路径。

直观展示了 PP-OCRv5的极致性价比。在 OCR 任务中,PP-OCRv5以仅5M 的参数量(约为 Qwen3-VL-235B 的四万分之一),实现了与 GPT-4o、Qwen2-VL 等千亿级大模型相当的准确率(1-EditDist约为0.93),有力证明了 PP-OCRv5专用小模型在 OCR 任务上的巨大潜力。

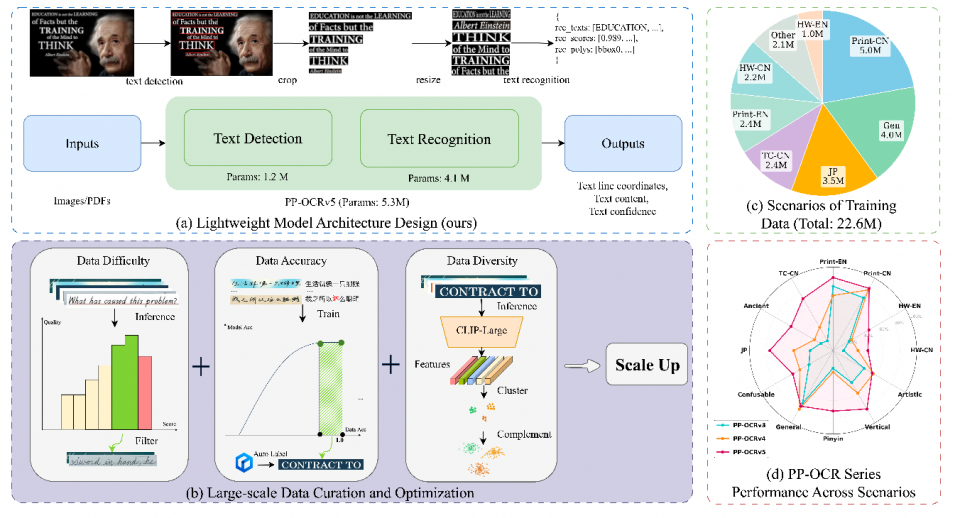

展示了 PP-OCRv5模型架构与数据驱动优化流程全景图,该图清晰地拆解了 PP-OCRv5“以数据驱动小模型”的技术路线。

-

经典的轻量化两阶段架构(检测1.2M+识别4.1M),确保推理速度;

-

数据清洗与优化流水线:通过置信度筛选(Data Difficulty)、噪声容忍实验(Data Accuracy)和 CLIP 特征聚类(Data Diversity)三大引擎,构建高质量训练集;

-

基于上述策略构建的2260万样本大规模多场景数据集分布;

-

最终成果:PP-OCRv5在手写、多语言、复杂背景等多场景下表现优异。

02.

PaddleOCR-VL: Boosting Document Parsing Efficiency and Performance with Coarse-to-Fine Visual Processing

项目链接:https://github.com/PaddlePaddle/PaddleOCR

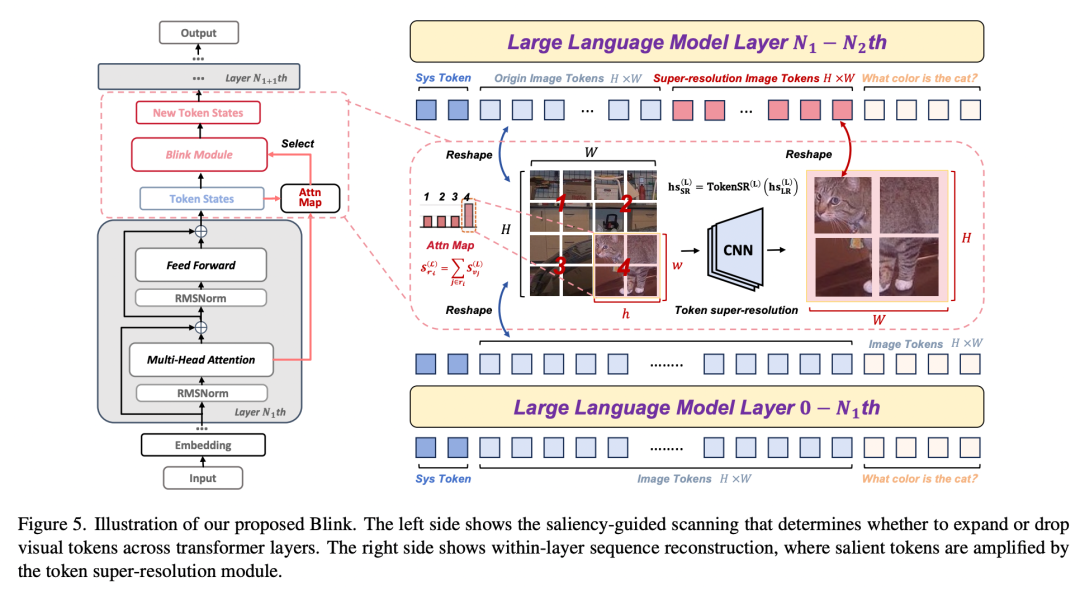

论文简介:文档解析是一项细粒度的任务,图像分辨率对解析性能有着至关重要的影响。虽然目前利用视觉语言模型(VLM)的前沿研究通过高分辨率输入提升了模型表现,但这往往会导致视觉 Token 数量呈二次方增长,从而显著增加了计算成本。

我们将这种低效归因于文档图像中存在大量的视觉区域冗余(如空白背景)。为了解决这一问题,我们提出了 PaddleOCR-VL,这是一种新颖的“由粗到精(Coarse-to-Fine)”架构,它专注于语义相关的关键区域,同时抑制冗余信息,从而同步提升解析效率与性能。具体而言,我们提出了一个轻量级的有效区域聚焦模块(VRFM),该模块利用定位与上下文关系预测能力来识别有效的视觉 Token。随后,我们设计并训练了一个紧凑且强大的0.9B 视觉语言模型(PaddleOCR-VL-0.9B),在 VRFM 输出的引导下进行细粒度识别,避免了对整幅大图的直接计算。

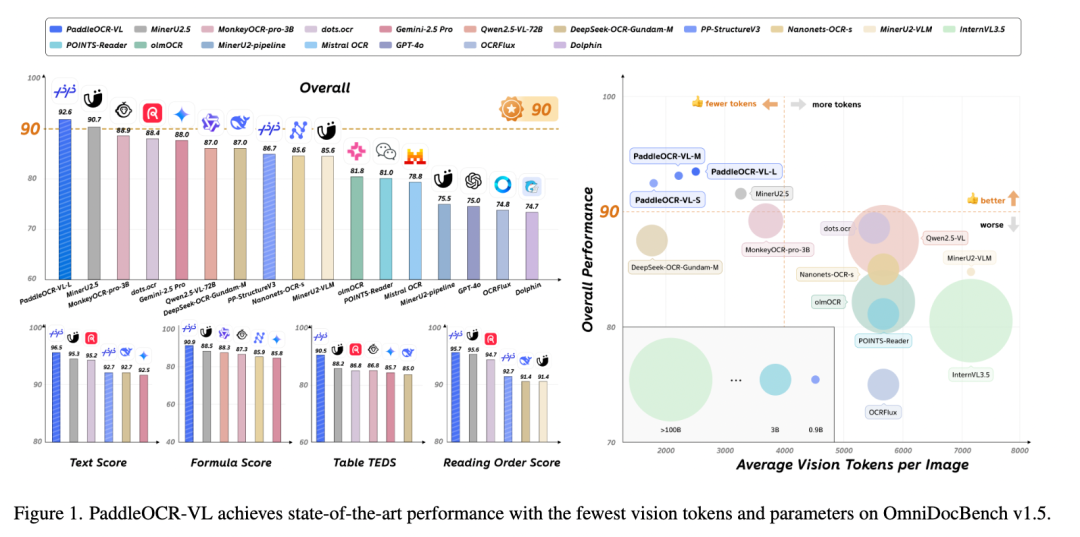

广泛的实验表明,PaddleOCR-VL 在页面级解析和元素级识别方面均达到了最先进(SOTA)的水平。它不仅显著优于现有解决方案,与顶级 VLM 相比也极具竞争力,并且在大幅减少视觉 Token 数量和参数量的同时,实现了极快的推理速度。这充分证明了针对性的“由粗到精”解析方案在实现准确、高效文档理解方面的卓越有效性。

-

(左侧)在 OmniDocBench v1.5权威榜单上,PaddleOCR-VL 在综合得分和子项指标上均超越了 MinerU2.5、GPT-4o、Qwen2.5-VL-72B 等国内外顶尖模型。

-

(右侧)PaddleOCR-VL 的三个版本(S, M, L)全部位于图表的最左上角(“黄金区域”)。这意味着它以极少的视觉 Token(通常只有竞品的1/3到1/2)和更小的模型参数,实现了比72B 等其他大模型更高的文档解析精度。

03.

FaithFusion: Harmonizing Reconstruction and Generation via Pixel-wise Information Gain

论文链接:https://arxiv.org/abs/2511.21113

论文简介:在可控的驾驶场景重建和3D 场景生成中,在巨大的视角变化下保持几何保真度,同时合成视觉上合理的(逼真的)外观是至关重要的。然而,将基于几何的3DGS(3D 高斯溅射)与外观驱动的扩散模型(Diffusion models)进行有效融合面临着固有的挑战,因为缺乏像素级的、3D 一致性的编辑标准,这通常会导致过度修复(over-restoration)和几何漂移(geometric drift)。

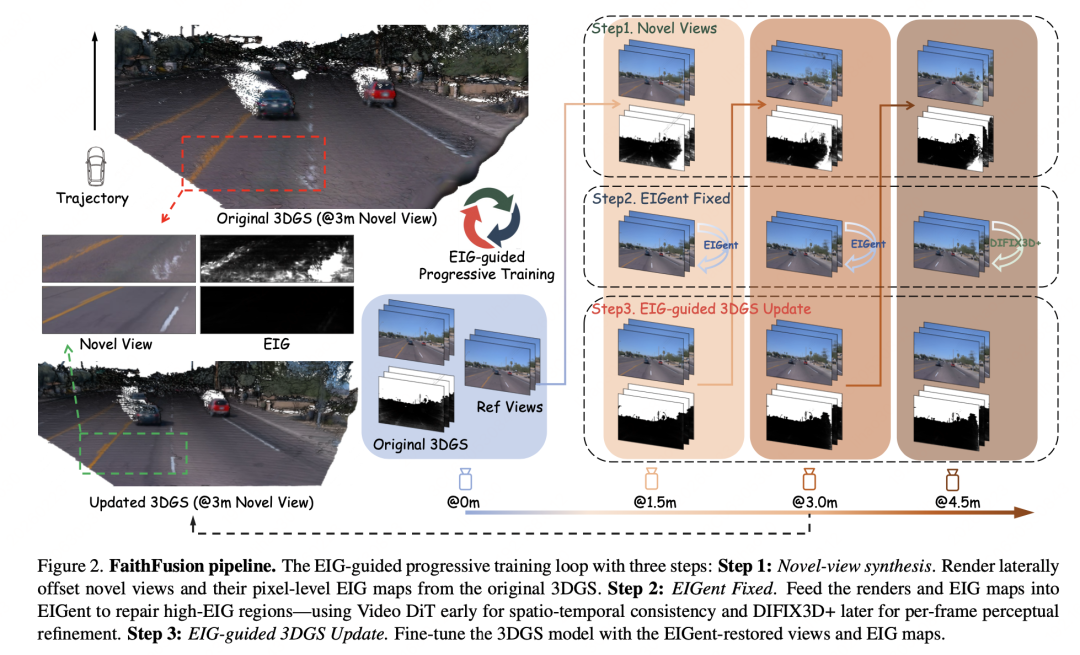

为了解决这些问题,我们引入了 FaithFusion,这是一个由像素级期望信息增益(Expected Information Gain, EIG)驱动的3DGS-扩散模型 融合框架。EIG 作为连贯的时空合成的统一策略:它引导扩散模型作为空间先验,去细化(优化)高不确定性的区域;同时,它通过像素级加权将编辑的内容提取(蒸馏)回3DGS 中。

由此产生的即插即用(plug-and-play)系统无需额外的先验条件或结构修改。

04.

Agentic Learner with Grow-and-Refine Multimodal Semantic Memory

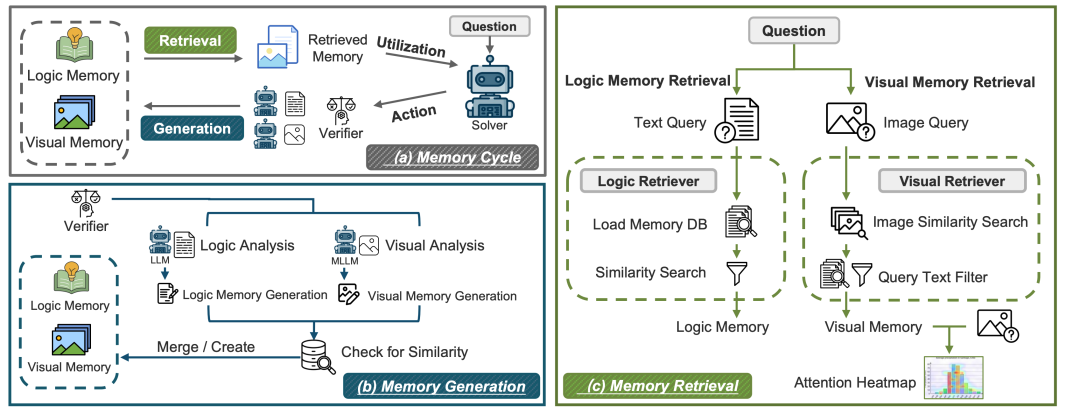

论文简介:提出了 ViLoMem,这是一种双流记忆框架,用于构建紧凑的、基于图式的记忆。它分别对视觉干扰模式和逻辑推理错误进行编码,使多模态大语言模型能够从成功和失败的经验中学习。遵循增长与优化原则,该系统逐步积累和更新多模态语义知识——保留稳定、可推广的策略,同时避免灾难性遗忘。在九个多模态基准测试中,ViLoMem 持续提高了 pass@1准确率,并显著减少了重复的视觉和逻辑错误。消融实验证实了具有明确干扰-幻觉分离的双流记忆的必要性,展示了面向终身学习和跨领域智能体学习的错误感知多模态记忆的价值。本技术面向百度视频理解、视频问答等业务场景提供解决方案,以更低的计算与存储成本,实现了更强的长时记忆建模能力。

ViLoMem 框架概述:

-

记忆循环:一种闭环学习机制,求解器会检索并利用逻辑记忆和视觉记忆。检索以文本问题及其配对图像为条件。然后,求解器执行推理步骤(动作),验证器对这些步骤进行评估,以过滤冗余或无效的轨迹。剩余的轨迹会根据其各自的类型用于更新两个记忆流。

-

记忆生成:一种错误归因框架,它利用大语言模型(LLM)进行逻辑分析,利用多模态大语言模型(MLLM)进行视觉分析,通过基于相似性的合并和创建操作生成结构化的记忆模式。

-

记忆检索:专门的双流检索机制。视觉记忆经历两个阶段的过程,包括图像嵌入检索和特定问题检索,因为视觉信息必须以图像内容和文本查询为条件。逻辑记忆通过问题分析和文本嵌入相似性进行检索。

05.

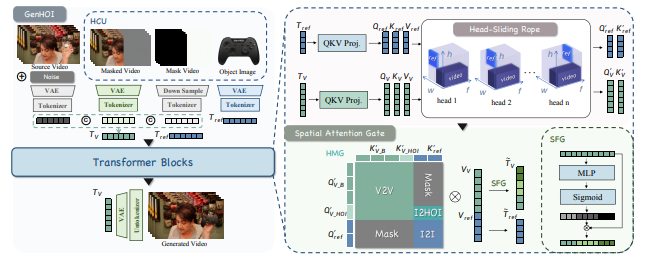

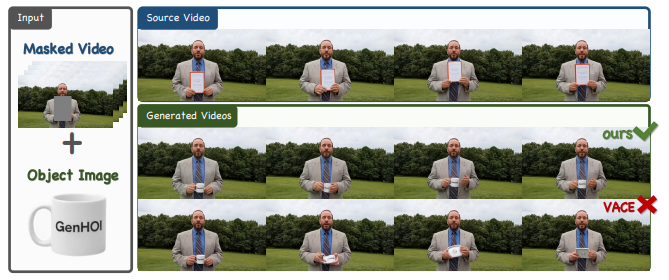

GenHOI: Towards Object-Consistent Hand–Object Interaction with Temporally Balanced and Spatially Selective Object Injection

论文简介:GenHOI (Towards Object-Consistent Hand-Object Interaction) 通过轻量化模块增强了预训练视频生成模型的换物能力,为实现高一致性、物理真实的手物交互(HOI)视频提供了新方案 。在视频编辑领域,传统扩散模型在处理手物交互时,常因缺乏精确的时间约束导致物体发生形变或身份丢失,尤其在长视频中极易出现“视觉衰减” 。

GenHOI 引入了 Head-Sliding RoPE(头滑动旋转位置编码),通过为参考物体分配特定的时间偏移,确保其影响力在全帧均衡分布,有效缓解了长序列生成中的物体外观退化问题 。配合空间注意力闸门(Spatial Attention Gate),模型能将模型注意力精准锁定在手物接触区域,在提升商品区域生成效果的同时,确保了背景视频的保真度 。

该方案极其轻量,新增参数量仅占原模型的0.95%,却能作为视频管线中的“交互增强插件”,确保动作与物体的物理契合,解决形变与结构崩溃问题 。在电商场景下,GenHOI 赋予了卖家“商品替换”的能力:无需重拍视频,即可将视频中的道具替换为新的商品(如将水杯替换为品牌奶茶或口红),且手部抓握动作自然严谨 。这种低成本、高一致性的视频创作方式能显著增强商品的沉浸式演示效果,助力电商平台提升转化率并降低拍摄成本 。

该图展示了预训练的通用模型,在较为复杂的手持商品展示场景中,较难完全避免物体纹理模糊或局部形变等外观退化现象。

GenHOI 则尝试通过时空注入机制的优化,在动态交互过程中提升物体的身份一致性,力争在遮挡或大幅度位移场景下,呈现出更自然、结构更稳健的互动视觉效果 。

06.

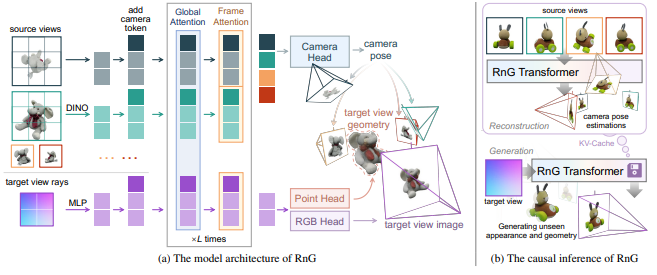

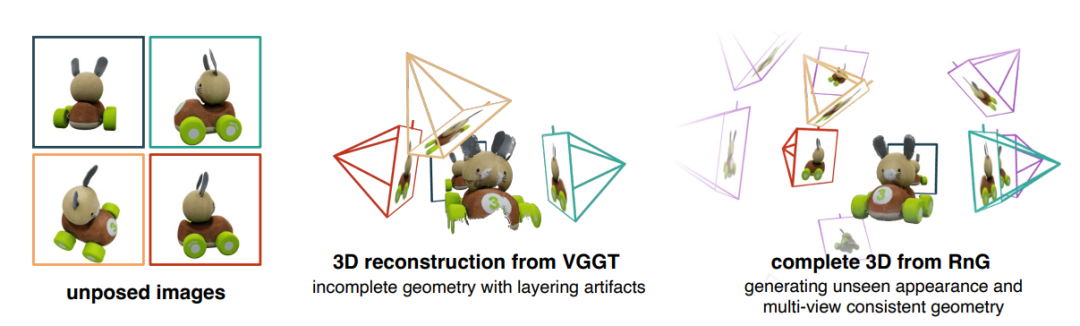

RnG: A Unified Transformer for Complete 3D Modeling from Partial Observations

论文简介:RnG (Reconstruction and Generation) 通过单一 Transformer 架构统一了3D 重建与新视角生成,为高动态、高一致性的视觉任务提供了新范式 。在视频生成领域,传统扩散模型虽能产生精美的视频结果,但常因缺乏底层3D 约束导致物体在运动中发生形变 。RnG 利用重建引导的因果注意力机制,确保生成的所有视角都严格遵循同一套隐式3D 表征 。 其推理速度比扩散模型快100倍以上,可在0.1秒内完成单帧生成 。这意味着它能作为视频生成管线中的“实时几何底座”,为模型提供极速且空间一致的参考帧,彻底解决视频闪烁与结构崩坏问题 。RnG 赋予了普通电商卖家“虚拟3D 扫描”的能力,无需昂贵的扫描设备或复杂的摄影位姿校准,只需利用手机随手拍摄几张商品照片,RnG 即可推断出物体完整的3D 几何与纹理。借助其高效的 KV-Cache 渲染技术,电商平台可以实现丝滑的360° 商品环绕展示或 AR 试穿试戴,让消费者在毫秒级延迟下从任意视角查看商品细节,极大提升转化率并降低退货率 。

传统模型只能重建出“看得到”的区域,导致几何结构破碎、重叠且严重缺失。

RnG 则展现了完美的“脑补”能力,生成了多视角一致且完整的3D 结构 。

07.

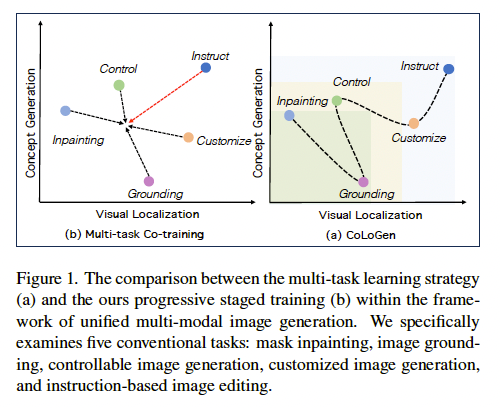

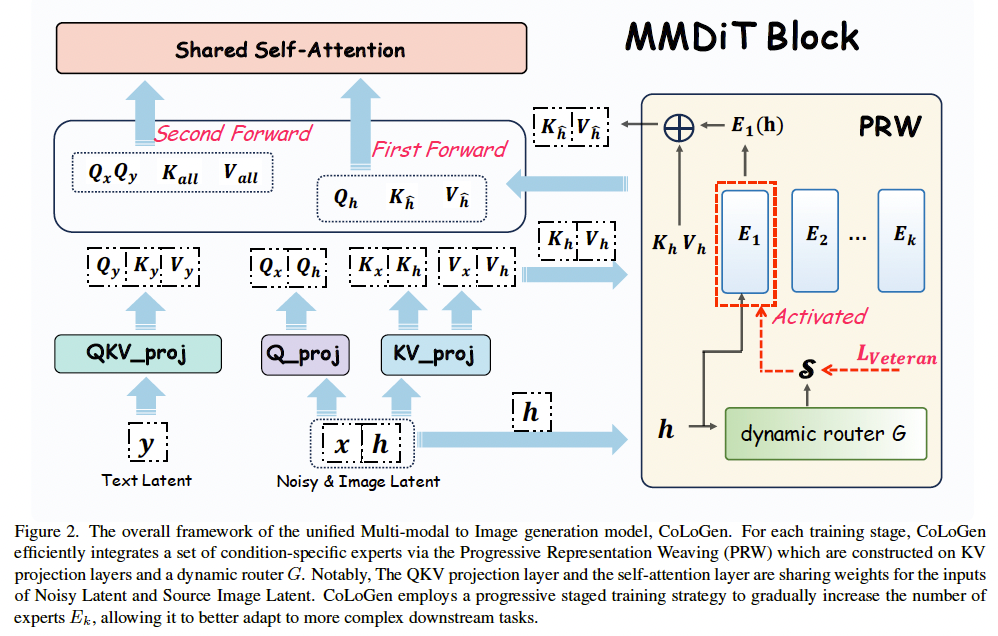

CoLoGen: Progressive Learning of Concept–Localization Duality for Unified Image Generation

论文简介:本文提出统一扩散生成框架 CoLoGen,解决多任务图像生成中普遍存在的“概念-定位表征冲突”:如 inpainting /个性化生成更依赖语义概念理解,而可控生成/grounding 更依赖空间定位精度,直接多任务联合训练会导致性能互相干扰。CoLoGen 采用“由易到难的渐进式课程学习”,先通过 mask inpainting 与 grounding 分别建立概念生成与定位能力,再扩展到深度/边缘/分割等多条件控制,最终在指令编辑与个性化生成中融合两类能力。核心创新模块为 PRW(Progressive Representation Weaving):通过动态路由选择轻量专家网络(KV 投影专家),并引入 Veteran Gate监督稳定专家分配,从而逐步“编织”概念与定位表征,实现统一模型在编辑、控制生成、个性化生成等任务上取得优于或可比 SOTA 的效果,在面向统一的图像生成/编辑等下游任务中具备较大潜力。

直观对比 Multi-task Co-training vs CoLoGen staged training,强调概念/定位能力分阶段融合。

PRW 模块通过选择专家生成适配的 Key/Value,实现概念与定位表征动态调度。

08.

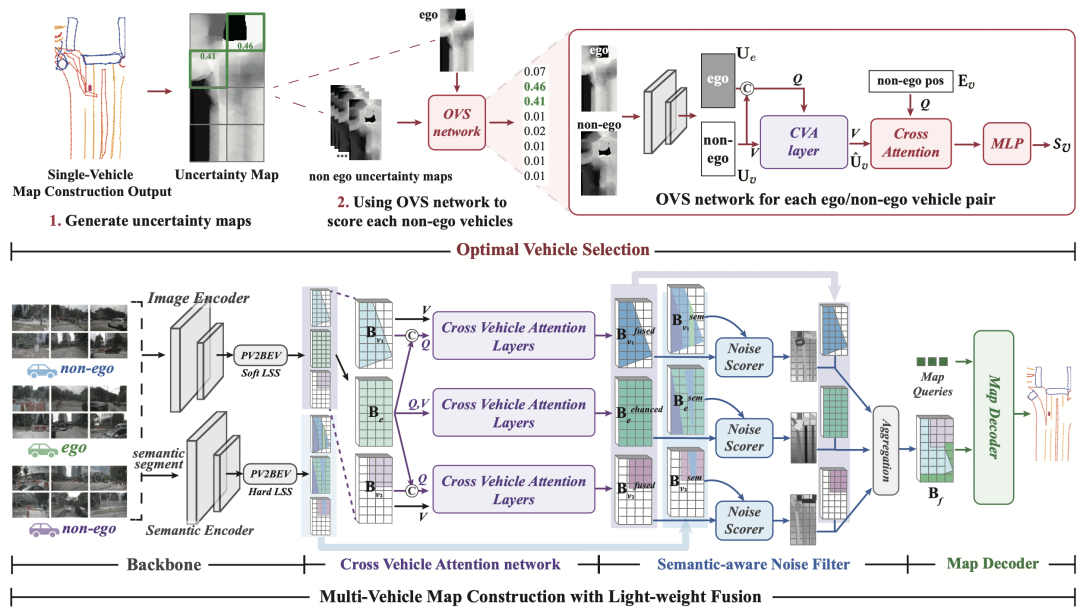

OptiMVMap: Offline Vectorized Map Construction via Optimal Multi-vehicle Perspectives

论文简介:本文提出 OptiMVMap,将多车协同建图建模为“先优选、再融合”的新范式,突破单车轨迹视角受限导致的遮挡与拓扑缺失问题。核心创新在于:一是设计不确定性感知的最优车辆选择(OVS)模块,从候选车辆中筛选最能补充自车盲区的少量视角,在显著降低计算开销的同时避免冗余共线视角;二是提出跨车注意力(CVA)与语义感知噪声过滤(SNF),实现对位姿误差与遮挡伪影的鲁棒对齐与抑制,从而在 BEV 层完成高质量融合。相比简单堆叠多车数据,该方法以更少视角获得更完整、拓扑更准确的矢量化地图。在 nuScenes 与 Argoverse2上显著提升 mAP,验证了不确定性引导选择在高精地图构建中的关键价值,具备面向规模化自动驾驶与众源建图系统的实际应用潜力。

OptiMVMap 总体框架(Select then Fuse):

-

首先,最优车辆选择模块(OVS)根据对自车 BEV 不确定性(尤其是遮挡与远距区域)的期望降低程度,对周围非自车进行排序,并选取紧凑的 Top-K 车辆。

-

随后,选中视角通过具备位姿误差鲁棒性的跨车注意力模块(CVA)进行对齐,再由语义感知噪声过滤模块(SNF)去除伪影并完成特征聚合,生成融合后的 BEV 表征。

-

最后,采用 DETR 风格解码器在融合 BEV 上进行查询,输出矢量化地图实例。该框架为即插即用设计,与具体检测器架构无关。

09.

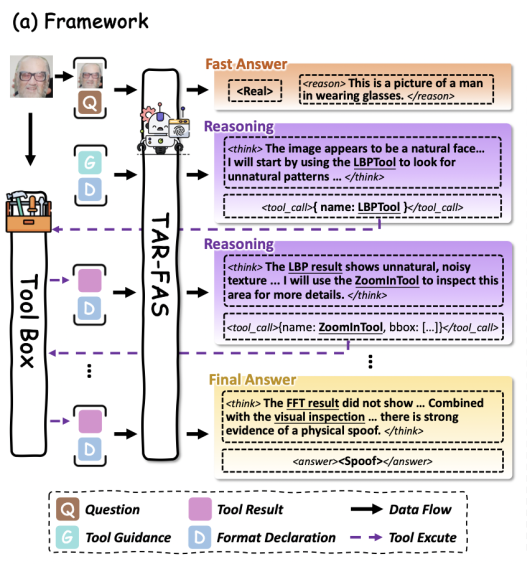

From Intuition to Investigation: A Tool-Augmented Reasoning MLLM Framework for Generalizable Face Anti-Spoofing

论文简介:TAR-FAS (Tool-Augmented Reasoning FAS) 框架将人脸防伪 (FAS) 从简单的二分类任务重构为“带视觉工具的思维链” (Chain of Thought with Visual Tools, CoT-VT) 模式 。针对大模型对微观伪造痕迹不敏感的问题,该框架允许模型在初步观察后,主动调用 FFT、LBP 等外部视觉工具,对图像的频域、材质、结构等细节进行深度取证。

论文提出了由专家模型引导的数据标注流水线,构建了包含1.6万条多轮工具调用推理轨迹的 ToolFAS-16K 数据集 。在训练阶段,通过 FAS 知识转移、格式注入及多样性工具组相对策略优化(DT-GRPO),使模型能自主学习高效的工具调用策略 。实验证明,TAR-FAS 在极具挑战性的1对11跨域测试协议下达到了 SOTA 性能,相比之前最优方法 HTER 降低了约 3%,显著提升了防伪检测的泛化性与可解释性。TAR-FAS 框架通过利用伪造图的频域和局部特征抽取更为针对的证据,为百度人脸活体鉴伪应对深度攻击提供了更好的防护手段。

TAR-FAS 通过借助外部视觉 Tool Box 实现了多轮推理,将活体检测过程重塑为 CoT-VT 范式,提升模型泛化性和可信度。

通过监督微调和 DT-GRPO 算法,可以根据任意自定义 Tool Box 微调预训练模型提升下游任务的泛化性和可信度。

10.

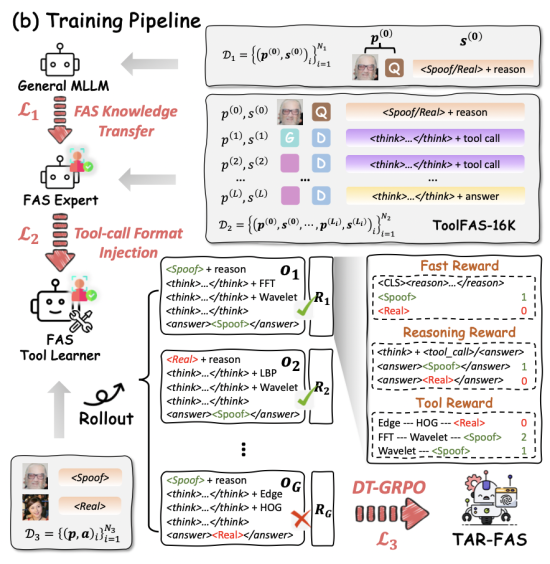

Hugging Visual Prompt and Segmentation Tokens: Consistency Learning for Fine-Grained Visual Understanding in MLLMs

论文简介:提出 FCLM,通过创新的一致性损失函数,在潜在空间强制对齐“视觉提示 Token(输入)”与“分割 Token(输出)”,实现了区域描述与像素级定位任务的相互增强。设计 Hybrid Region Extractor,融合像素级细节、语义引导及空间位置信息,生成高辨识度的视觉提示嵌入。引入详细定位指代表达分割(DL-RES)任务,填补了长文本复杂描述定位能力的评估空白。在 RefCOCO、ReasonSeg 等7项任务中达到 SOTA,展现了卓越的细粒度理解与泛化能力。其核心价值在于提升了AI对开放世界细节的感知与推理水平。

-

左侧 Grounding(定位任务): 这是一个“文到图”的过程。输入是图像和文本指令,通过 LLM 输出一个分割 [SEG],生成目标的分割掩码。

-

右侧 Captioning(描述任务): 这是一个“图到文”的过程。输入是图像和目标区域的掩码。掩码通过论文提出的“混合区域提取器”被编码为视觉提示<VP>,生成对该区域的详细文本描述。

-

语义一致性: 图中中间的双向箭头和热力图揭示了 <VP>(作为输入的提示特征) 和 [SEG](作为输出的分割特征) 虽然角色不同,但在潜在空间中指向的是同一个语义对象。FCLM 通过在特征分布上保持一致,实现了两个任务相互促进。

11.

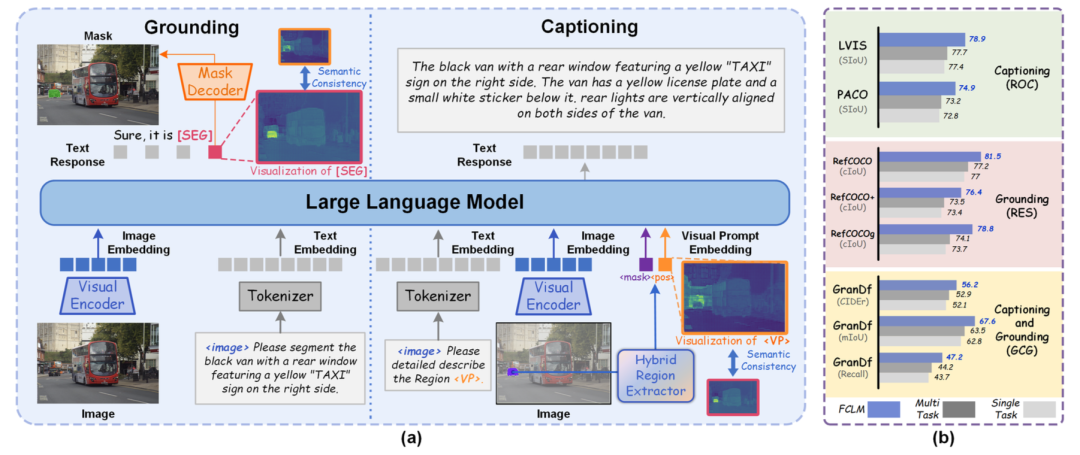

Blink: Dynamic Visual Token Resolution for Enhanced Multimodal Understanding

论文简介:现有多模态大模型在处理视觉信息时忽视了对显著区域的感知增强,从而导致理解偏差与幻觉问题。本文提出了名为 Blink 的动态视觉分辨率感知框架,模仿人类视觉“扫视与聚焦”的生理机制,通过显著性引导扫描与动态 Token 分辨率模块,在单次前向传播过程中动态识别并强化重要的视觉 Token,通过 Token 超分辨率(TokenSR)模块对待扩展的显著区域进行细粒度增强;同时,在后续注意力发生转移后丢弃不再关注的视觉 Token。该方法实现了广度探索与细粒度聚焦的自适应平衡,显著提升多模态大模型的视觉感知与推理能力。

Blink 具备良好的通用性与落地性:TokenSR 模块轻量可独立训练,并且以插件形式接入现有多模态大模型,无需改动主干结构,动态分辨率机制在单次前向传播内完成,兼顾性能提升与推理效率,为多模态大模型的视觉感知增强及进化提供了一种简单、高效且可扩展的解决方案。

12.

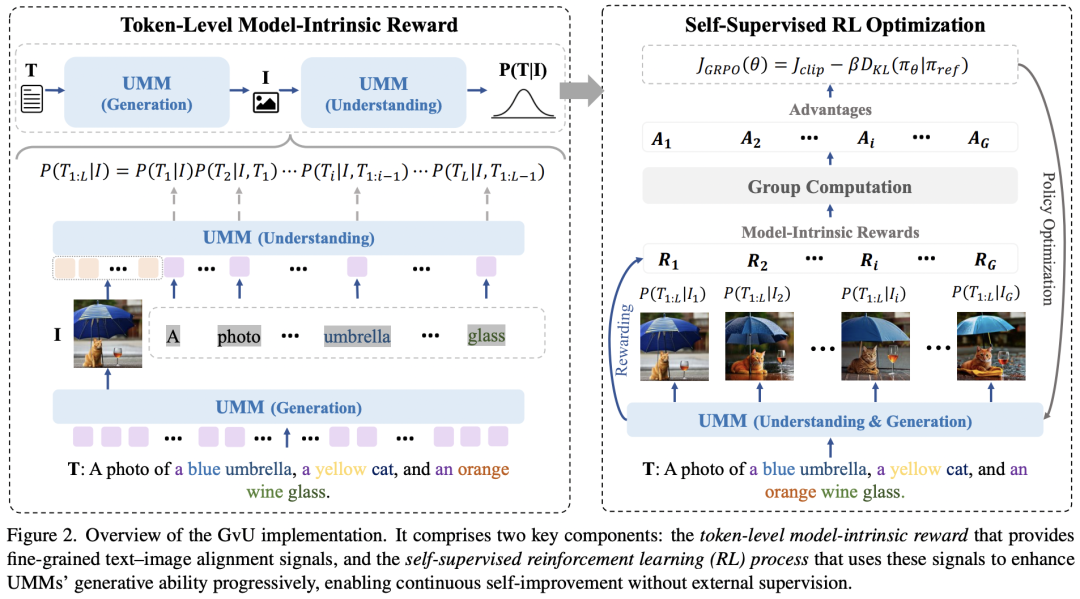

Learning to Generate via Understanding: Understanding-Driven Intrinsic Rewarding for Unified Multimodal Models

论文简介:本文针对统一多模态模型(UMMs)中“理解强、生成弱”的能力失衡问题,提出了一种基于模型内生认知能力的自监督强化学习框架。核心创新在于设计了 Token 级文本-图像对齐内在奖励机制(GvU):模型在生成图像后,利用自身理解分支对生成结果进行细粒度语义评估,并将理解与生成之间的语义差异转化为可优化的奖励信号,实现“自评估—自纠正—自提升”的闭环学习。通俗而言,相当于让模型在画完图后自己打分,并根据理解能力不断修正绘画策略,从而缩小理解与生成之间的能力鸿沟。

该方法无需额外标注或外部监督,显著提升复杂文本到图像生成的语义一致性与细粒度表达能力,同时反向增强模型的视觉理解能力。该研究为构建真正统一、可自进化的多模态系统提供了新思路,具有广泛应用潜力,如高精度内容创作、智能设计辅助及复杂视觉推理生成等场景。

关注【飞桨PaddlePaddle】公众号

获取更多技术内容~

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献57条内容

已为社区贡献57条内容

所有评论(0)