基于卷积-长短期记忆网络(CNN-LSTM)的数据分类预测 matlab代码,要求2019A及...

最近在研究时间序列数据的分类预测,发现CNN-LSTM这个组合挺有意思的。今天就来分享一下用Matlab实现CNN-LSTM的代码,顺便聊聊其中的一些细节。总的来说,CNN-LSTM在处理时间序列数据时表现出色,尤其是在特征提取和时间依赖关系捕捉方面。如果你有类似的需求,不妨试试这个组合,说不定会有意想不到的效果。比如,可以尝试不同的卷积核大小、LSTM单元数,或者加入Dropout层来防止过拟合

基于卷积-长短期记忆网络(CNN-LSTM)的数据分类预测 matlab代码,要求2019A及以上版本

最近在研究时间序列数据的分类预测,发现CNN-LSTM这个组合挺有意思的。CNN擅长提取局部特征,LSTM则能捕捉时间依赖关系,两者结合简直就是天作之合。今天就来分享一下用Matlab实现CNN-LSTM的代码,顺便聊聊其中的一些细节。

首先,我们得准备数据。假设我们有一个时间序列数据集data,每个样本有numFeatures个特征,时间步长为numTimeSteps。数据预处理这一步很重要,直接影响到模型的效果。

% 假设data是一个numSamples x numTimeSteps x numFeatures的矩阵

% labels是对应的标签,numSamples x 1

data = rand(100, 50, 10); % 100个样本,50个时间步,10个特征

labels = randi([0 1], 100, 1); % 二分类问题接下来,我们构建CNN-LSTM模型。Matlab的layerGraph函数可以帮助我们灵活地组合不同的层。

layers = [

sequenceInputLayer(numFeatures)

convolution1dLayer(3, 32, 'Padding', 'same')

reluLayer

maxPooling1dLayer(2, 'Stride', 2)

lstmLayer(64, 'OutputMode', 'sequence')

fullyConnectedLayer(2)

softmaxLayer

classificationLayer];这里有几个关键点:

convolution1dLayer:一维卷积层,卷积核大小为3,输出通道数为32。Padding设置为same,保证输出长度与输入一致。maxPooling1dLayer:一维最大池化层,池化窗口大小为2,步长为2,用于降维。lstmLayer:LSTM层,隐藏单元数为64,OutputMode设置为sequence,输出整个序列。

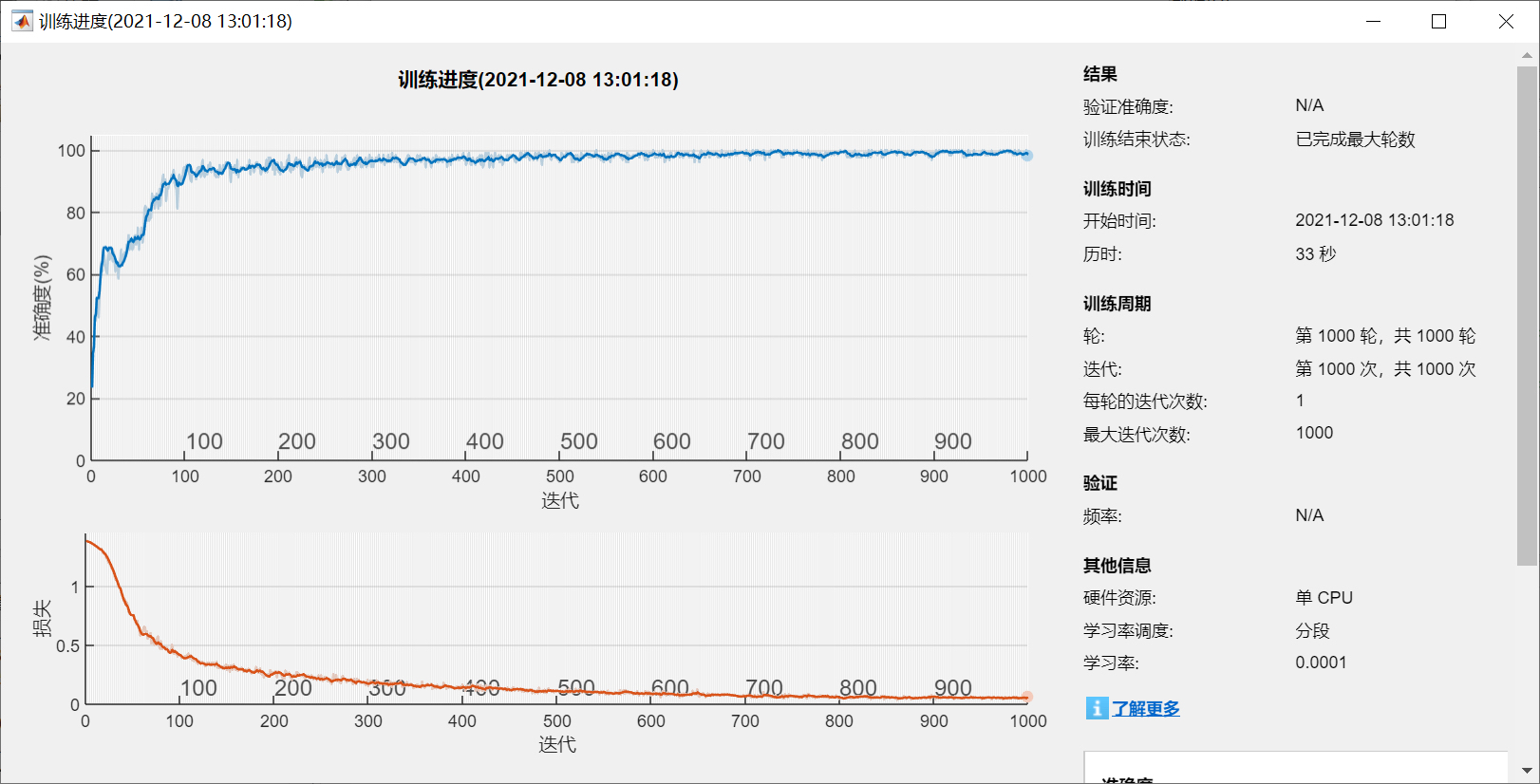

模型构建好后,我们需要设置训练选项。这里我们使用Adam优化器,学习率设为0.001。

options = trainingOptions('adam', ...

'MaxEpochs', 30, ...

'MiniBatchSize', 32, ...

'InitialLearnRate', 0.001, ...

'Verbose', false, ...

'Plots', 'training-progress');最后,开始训练模型。

net = trainNetwork(data, labels, layers, options);训练过程中,Matlab会实时显示训练进度和损失曲线,方便我们监控模型的表现。

基于卷积-长短期记忆网络(CNN-LSTM)的数据分类预测 matlab代码,要求2019A及以上版本

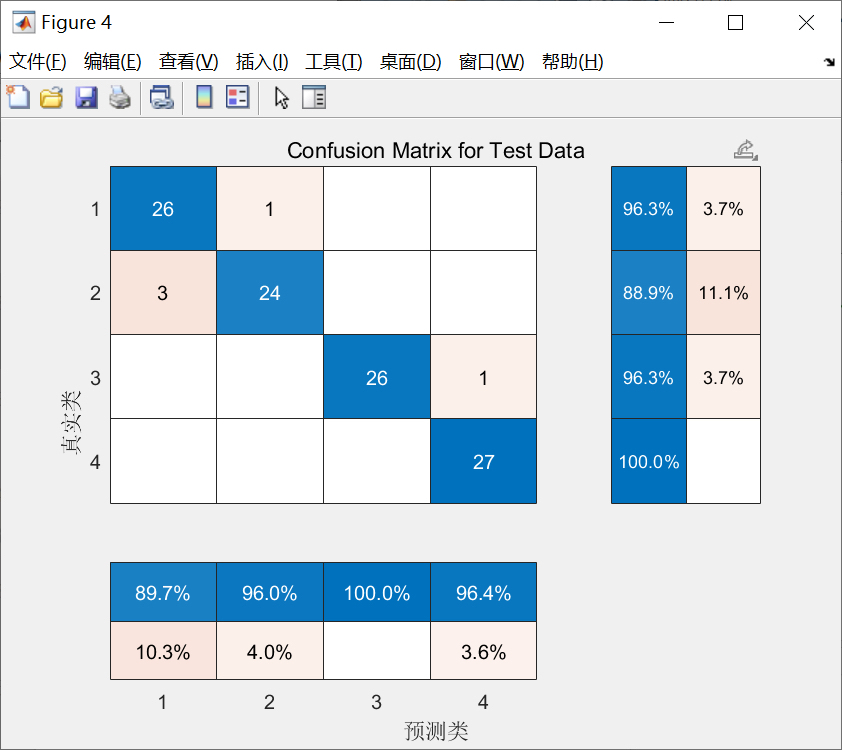

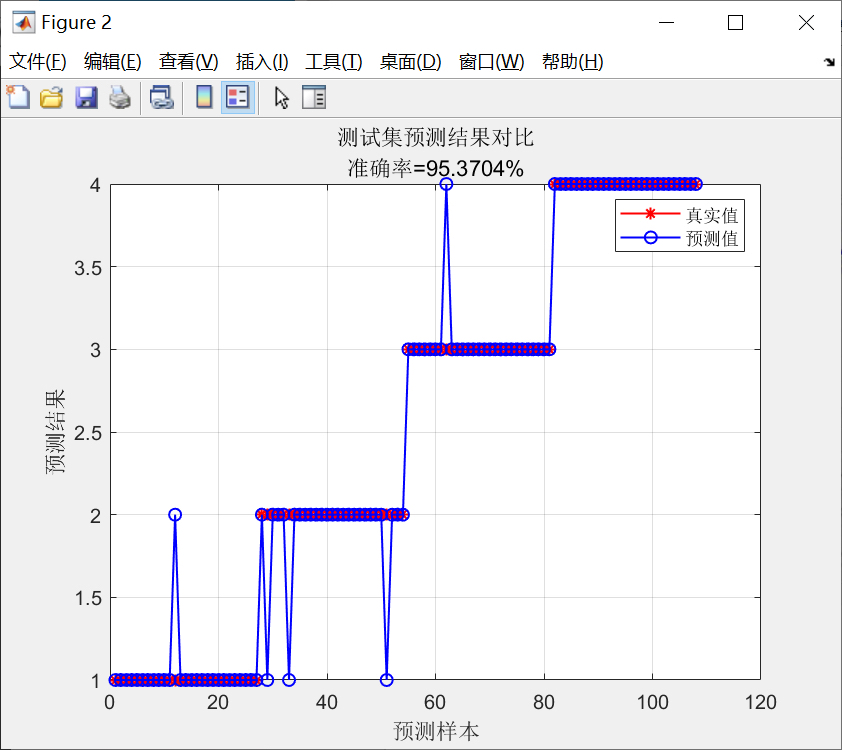

训练完成后,我们可以用测试集来评估模型的性能。

predictedLabels = classify(net, testData);

accuracy = sum(predictedLabels == testLabels) / numel(testLabels);

disp(['Test Accuracy: ', num2str(accuracy)]);这段代码简单明了,但实际应用中还有很多可以优化的地方。比如,可以尝试不同的卷积核大小、LSTM单元数,或者加入Dropout层来防止过拟合。

总的来说,CNN-LSTM在处理时间序列数据时表现出色,尤其是在特征提取和时间依赖关系捕捉方面。Matlab的实现也相对简单,适合快速原型开发。如果你有类似的需求,不妨试试这个组合,说不定会有意想不到的效果。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)