一文看懂神经网络:从原理到实战应用

本文介绍了神经网络的基本概念、核心结构和工作原理。神经网络是一种模拟人脑神经元连接方式的机器学习算法,具有自动特征提取、非线性建模和通用性强等特点。其核心结构包括人工神经元和网络分层设计,通过前向传播和反向传播实现数据学习。文章还分析了主流网络架构(如CNN、RNN)的应用场景,并指出神经网络在端到端学习方面的优势,以及数据依赖、计算资源消耗等局限。神经网络作为深度学习的基础,在图像识别、自然语言

一、什么是神经网络?

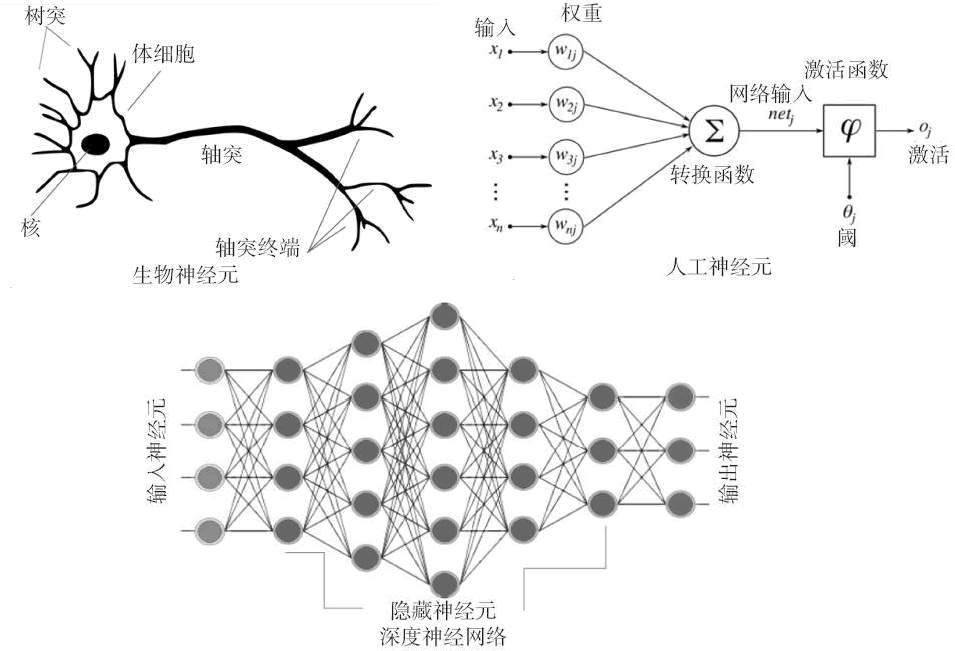

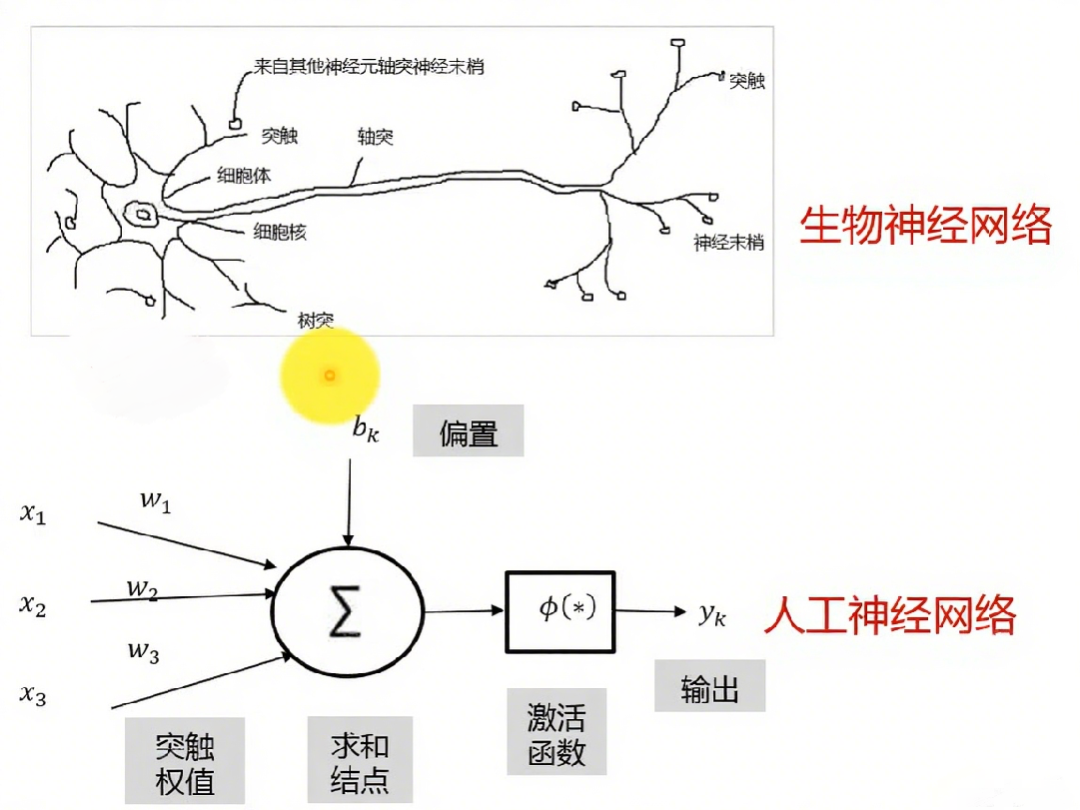

神经网络是机器学习领域的核心算法之一,灵感源于人类大脑神经元的连接方式。它通过模拟生物神经网络的“信息传递-处理”机制,实现对复杂数据(如非线性关系、抽象特征)的自主学习。作为深度学习的基础,神经网络在图像识别、自然语言处理等领域具有不可替代的价值。

核心优势:

-

自动特征提取:无需人工设计特征(如传统机器学习中的特征工程)

-

非线性建模能力:通过多层结构学习数据深层规律

-

通用性强:适配图像、文本、语音等多种数据类型

类比理解:

输入数据 → 感官信号

神经元 → 信息处理单元

连接权重 → 突触传递强度

最终输出 → 决策结果

二、核心结构解析

1. 人工神经元(最小单元)

-

输入:接收上一层数据(x₁, x₂...xₙ)

-

计算:加权求和 + 激活函数(z = Σwᵢxᵢ + b → a = σ(z))

-

关键激活函数:

-

Sigmoid(二分类概率)

-

ReLU(缓解梯度消失,隐藏层首选)

-

Softmax(多分类概率)

-

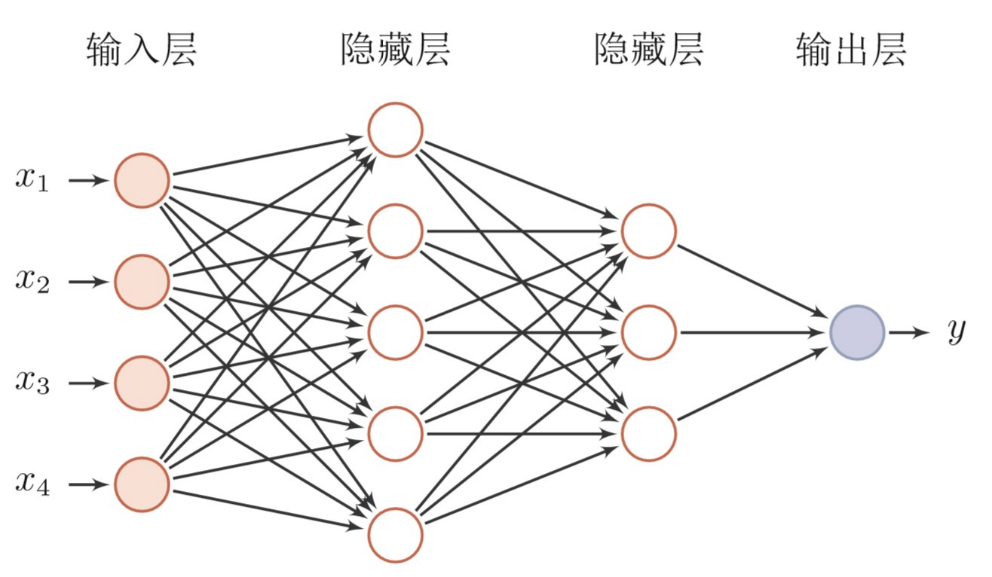

2. 网络分层设计

|

层级 |

作用 |

示例 |

|---|---|---|

|

输入层 |

接收原始数据(像素、词向量) |

32x32彩色图→3072个神经元 |

|

隐藏层 |

特征抽象提取(层数越深特征越高级) |

从边缘→纹理→物体部件 |

|

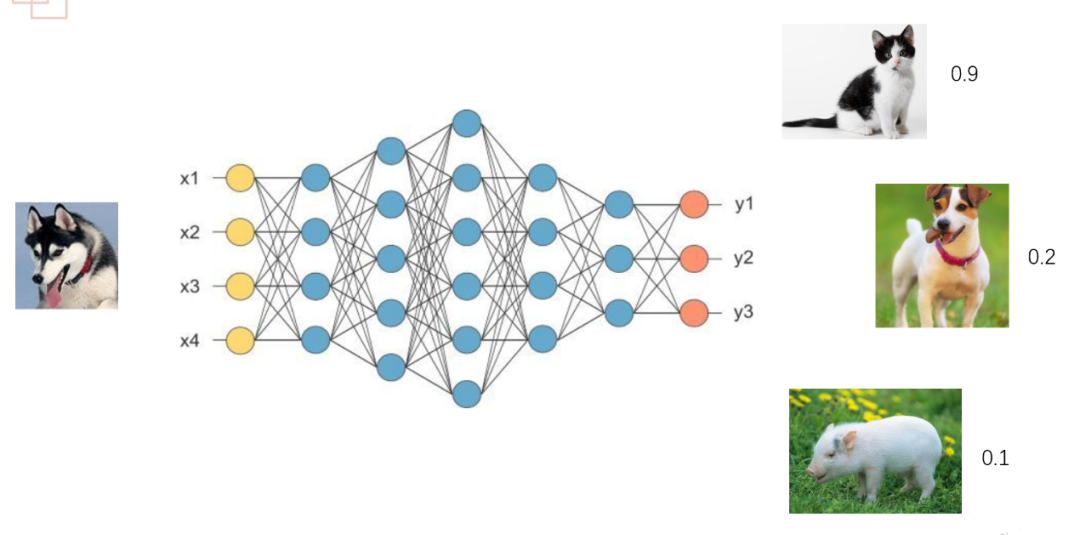

输出层 |

生成预测结果 |

二分类/多分类/回归 |

三、工作原理:数据如何被“学会”?

关键流程闭环:

-

前向传播:数据从输入层→隐藏层→输出层逐层计算

隐藏层输入:z⁽¹⁾ = W⁽¹⁾x + b⁽¹⁾ 隐藏层输出:a⁽¹⁾ = σ(z⁽¹⁾) 输出层结果:a⁽²⁾ = σ(W⁽²⁾a⁽¹⁾ + b⁽²⁾)

-

损失函数:量化预测值与真实值的差距

-

分类任务:交叉熵损失(Cross-Entropy)

-

回归任务:均方误差(MSE)

-

-

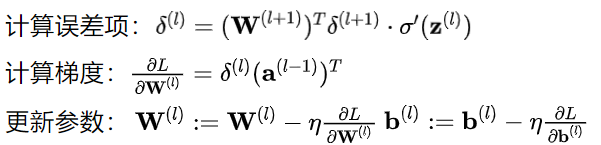

反向传播:通过梯度下降优化权重

w = w - η × ∂L/∂w (η:学习率控制步长)

四、主流网络架构与应用场景

|

网络类型 |

结构特点 |

典型应用 |

|---|---|---|

|

MLP(多层感知机) |

全连接结构 |

表格数据分析、金融风控 |

|

CNN |

卷积核局部感知/权值共享 |

图像识别、医学影像分析 |

|

RNN/LSTM |

时序记忆单元 |

语音识别、股票预测 |

|

Transformer |

自注意力机制 |

机器翻译、文本生成 |

|

GAN |

生成器-判别器对抗训练 |

AI绘图、数据增强 |

拓展学习:

为帮助理解CNN的卷积操作、RNN的时序处理等核心概念,我们整理了《神经网络实战图解》配套视频(含代码逐行解析):

🔗 完整学习资料👇

https://pan.quark.cn/s/e140c8b7dd09

五、优势与局限思考

✅ 优势:

-

端到端自动学习,降低人工特征工程成本

-

多层非线性结构拟合复杂关系

-

架构灵活适配多领域任务

⚠️ 局限:

-

依赖大量标注数据(小样本场景易过拟合)

-

计算资源消耗较大(深层网络需GPU加速)

-

可解释性弱(黑盒模型决策过程难追溯)

结语

神经网络通过模拟人脑的信息处理机制,构建了从数据特征抽象到规律学习的完整框架。随着CNN、Transformer等架构的演进,其在计算机视觉、自然语言处理等领域持续推动技术边界。理解其核心原理,将助力我们更理性地运用这一工具。

“技术的本质,是为复杂世界建立可计算的模型”

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)