R1-Searcher++:通过强化学习激励LLM动态知识获取

大型语言模型(LLMs)功能强大,但由于其静态知识容易产生幻觉。检索增强生成(RAG)通过注入外部信息来帮助解决这一问题,但当前方法通常成本高昂、泛化能力差或忽略模型的内部知识。本文中,我们介绍了R1-Searcher++,这是一种新颖的框架,旨在训练LLM以自适应地利用内部和外部知识源。R1-Searcher++采用两阶段训练策略:初始SFT冷启动阶段用于初步格式学习,随后是RL动态知识获取阶段

宋华通 1∗{ }^{1 *}1∗,江金浩 1∗{ }^{1 *}1∗,田文清 3{ }^{3}3,陈志鹏 1{ }^{1}1,

吴玉环 1{ }^{1}1,赵佳豪 1{ }^{1}1,闵颖倩 1{ }^{1}1,

赵新韦 1†{ }^{1 \dagger}1†,方磊 2{ }^{2}2,文继荣 1{ }^{1}1

1{ }^{1}1 中国人民大学高瓴人工智能学院。

2{ }^{2}2 DataCanvas Alaya NeW。 3{ }^{3}3 北京理工大学。

{songhuatong123, jiangjinhao}@ruc.edu.cn, batmanfly@gmail.com

摘要

大型语言模型(LLMs)功能强大,但由于其静态知识容易产生幻觉。检索增强生成(RAG)通过注入外部信息来帮助解决这一问题,但当前方法通常成本高昂、泛化能力差或忽略模型的内部知识。本文中,我们介绍了R1-Searcher++,这是一种新颖的框架,旨在训练LLM以自适应地利用内部和外部知识源。R1-Searcher++采用两阶段训练策略:初始SFT冷启动阶段用于初步格式学习,随后是RL动态知识获取阶段。RL阶段使用结果监督来鼓励探索,结合奖励机制促进内部知识利用,并整合记忆机制以持续同化检索到的信息,从而丰富模型的内部知识。通过利用内部知识和外部搜索引擎,模型不断改进其能力,实现高效的检索增强推理。我们的实验表明,R1-Searcher++优于之前的RAG和推理方法,并实现了高效检索。代码可在https://github.com/RUCAIBox/ R1-Searcher-plus获得。

1 引言

大型语言模型(LLMs)(Zhao等人,2023)仅通过利用参数中编码的信息就展示了卓越的推理能力。然而,它们对静态内部知识的依赖导致了显著的局限性。同时,这种依赖容易导致幻觉(Huang等人,2025),因此LLMs可能在开放性任务上遇到困难(Wang等人,2025c;Trivedi等人,2022)。因此,在推理过程中当模型困惑时,使其能够访问外部信息以实现更审慎的推理至关重要(Jiang等人,2024a)。

为了解决这一问题,大量研究集中于增强LLM与外部信息源的结合(即RAG (Gao等人,2024))。早期方法强调特定提示策略以引导LLM(Li等人,2025;Teng等人,2025),后续研究则调查通过监督微调(SFT)将此能力蒸馏到较小的LLM中(Wang等人,2025b)。然而,最近的研究发现基于SFT的蒸馏可能导致模型记住解决方案路径,限制其在新场景中的泛化能力(Chu等人,2025)。进一步的建议包括测试时扩展方法(Li等人,2024),特别是使用蒙特卡洛树搜索(MCTS)框架(Sun等人,2025)来通过在推理期间扩展搜索空间来增强解决方案寻找,但这种方法带来了显著的推理开销,降低了其实际应用的可行性。近期研究采用端到端基于结果的强化学习(RL)来训练模型,使它们能够在推理期间自主探索外部检索环境(Jin等人,2025;Song等人,2025)。这种方法促进了LLM在推理过程中的自我导向检索能力的发展。然而,这些模型在训练后往往过度依赖外部搜索引擎,忽视对其内部知识的利用。

在实践中,当人类试图解决事实性问题时,他们会先回忆自己的内部知识,只有在认识到缺乏信息时才转向搜索引擎。同时,获得外部检索信息后,人类会记住这些知识以备将来使用。对于LLM,大规模数据的广泛预训练已经赋予了它们大量的内部知识(Qwen等人,2025)。因此,让模型具备根据需要在内部和外部知识源之间动态切换的能力至关重要。此外,应鼓励模型有效记住训练过程中遇到的有用信息(Jiang等人,2024b),逐步丰富其内部知识并持续向更高的智能水平进化。

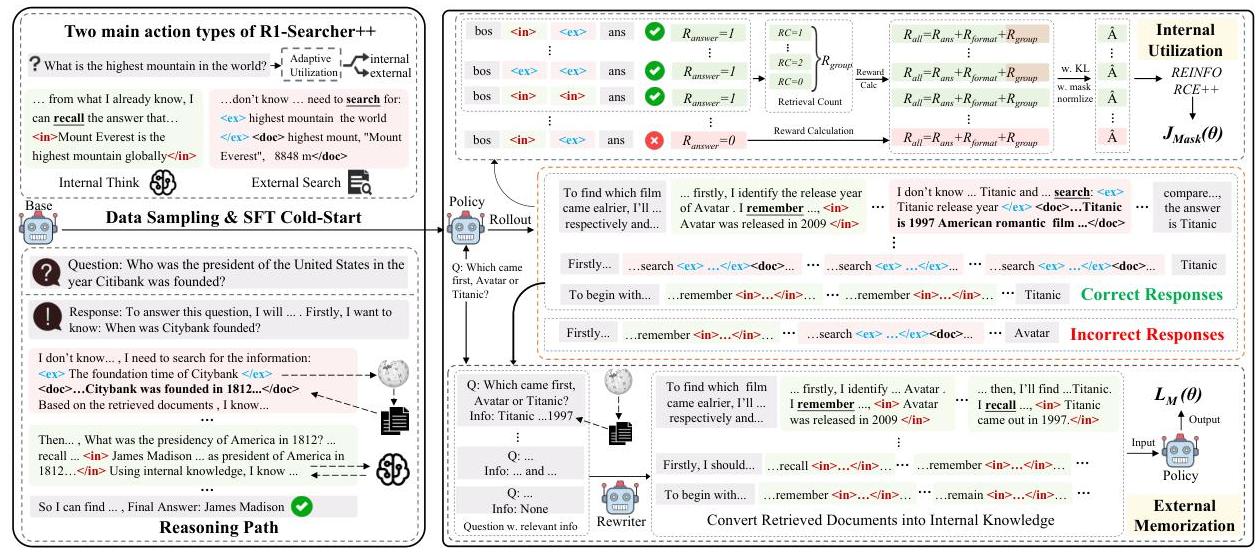

在本文中,我们提出了R1-Searcher++,这是一种新颖的框架,旨在教导LLM自适应地利用内部和外部知识。我们采用了两阶段训练策略:SFT冷启动和RL动态知识获取。在第一阶段,我们使用拒绝采样收集符合格式要求的数据并进行SFT冷启动。在第二阶段,我们进一步使用基于结果的RL训练模型,指导模型动态获取知识,即在自信时鼓励依赖内部知识,在不确定时调用外部搜索机制,基于精心设计的奖励机制。此外,我们还引入了一种记忆机制,使模型能够通过转换和记住检索内容保留训练过程中遇到的知识。这种机制持续丰富其内部知识,赋予模型通过自主探索和及时记忆有效平衡内部推理和外部检索的能力。

为了验证R1-Searcher++的有效性,我们在Qwen-2.5-7B-Instruct基础上进行了广泛的实验。值得注意的是,我们的方法比强大的基线高出 4.3%4.3 \%4.3%,并且相比纯RL方法减少了 42.9%42.9 \%42.9% 的检索次数。

我们的主要贡献如下:

- 我们引入了R1-Searcher++,通过两阶段训练策略教导LLM自适应地利用内部和外部知识。

-

- 我们鼓励模型主动利用其内部知识,同时有效地记住外部信息,通过探索和记忆实现动态知识获取。

-

- 广泛的实验证明R1Searcher++优于现有的RAG方法,同时显著减少了相比纯RL方法的检索次数。

2 相关工作

检索增强生成。为了提高LLM推理的事实准确性并减少幻觉,研究人员提出了通过结合外部信息源来增强语言模型的方法,称为RAG(Fan等人,2024)。早期的RAG方法主要包括分支(Kim等人,2024)、摘要(Li等人,2023)和自适应检索(Jeong等人,2024)策略。随着基础模型变得越来越强大,表现出强烈的CoT推理能力,许多研究将RAG与CoT相结合。这些努力包括促使模型进行逐步检索的方法(Shao等人,2023;Trivedi等人,2023)以及将此类能力蒸馏到小型LLM中的策略(Asai等人,2024)。与此同时,一些研究探讨了测试时扩展,特别是使用MCTS(Feng等人,2025)动态扩展推理路径。然而,这种方法通常会产生大量的推理时间开销。最近,研究人员通过基于结果的RL训练模型(Zheng等人,2025)来鼓励探索更有效的动作和检索行为,但这导致模型过度依赖外部搜索引擎,削弱了其利用内部知识的能力(Wang等人,2025a)。使LLM有效集成和交替使用内部知识和外部检索仍然是一个重大挑战。

强化学习。为了提高训练效率,已提出了一些离策略算法(Rafailov等人,2024;Ethayarajh等人,2024);然而,这些方法在偏好建模准确性和泛化能力方面仍面临限制(Pang等人,2024)。DeepseekMath引入了GRPO算法(Shao等人,2024),通过相对偏好优化机制实现高效的自我探索。在此基础上,Deepseek-R1(DeepSeek-AI等人,2025)证明了基于结果的RL可以显著增强大模型的推理能力。最近,研究开始专门设计用于改善LLM推理能力的RL算法(Yu等人;Yuan等人,2025)。同时,其他研究尝试将RL应用于检索领域,旨在实现深度搜索能力(Chen等人,2025)。然而,结合LLM驱动检索和推理的RL使用仍然较为简单且尚未充分探索。

3 预备知识

为了增强LLM在开放域多跳问答任务中的性能Ho等人(2020),在本工作中,我们专注于使模型能够自主决定何时使用其内部知识或调用外部检索器回答给定问题,通过LLM自改进范式,可以同时提高推理效果和效率。为此,我们引入了三个特殊标记来格式化LLM推理过程,即、和。具体来说,在推理过程中,带有参数θ\thetaθ的LLM确定当前步骤是否需要外部知识来帮助进行推理。如果是,则触发发出查询querytquery_{t}queryt,该查询被发送到检索器以从外部语料库中检索前KKK个相关文档Dt={dt,k}k=1KD_{t}=\left\{d_{t, k}\right\}_{k=1}^{K}Dt={dt,k}k=1K。这些检索到的文档通过另一个特殊标记纳入推理路径。否则,模型直接生成包含在中的相关内部知识。经过几个推理步骤后,LLM获得最终答案并停止推理过程。

由于我们的方法与RL算法正交,我们在广泛使用的RL算法REINFORCE++*Hu(2025)*的基础上进行实验,这是一种没有批评模型的稳定RL算法。为了更好地适应检索场景,我们在损失计算过程中屏蔽检索到的文档,因为它们作为环境观察而不是模型生成的内容。正式地,对于每个问题qqq,我们首先从旧策略模型πθold \pi_{\theta_{\text {old }}}πθold 中采样一组输出{o1,o2,⋯ ,oG}\left\{o_{1}, o_{2}, \cdots, o_{G}\right\}{o1,o2,⋯,oG}。接下来,我们将KL正则化纳入奖励分数Rϕ(q,oi,≤t)R_{\phi}\left(q, o_{i, \leq t}\right)Rϕ(q,oi,≤t),然后归一化优势分数:

A^i,t′=R(q,oi)−β⋅∑i=tTKL(i),A^i,t=A^i,t′−mean(A^)std(A^) \hat{A}_{i, t}^{\prime}=R\left(q, o_{i}\right)-\beta \cdot \sum_{i=t}^{T} \operatorname{KL}(i), \hat{A}_{i, t}=\frac{\hat{A}_{i, t}^{\prime}-\operatorname{mean}(\hat{\mathbf{A}})}{\operatorname{std}(\hat{\mathbf{A}})} A^i,t′=R(q,oi)−β⋅i=t∑TKL(i),A^i,t=std(A^)A^i,t′−mean(A^)

我们使用A^\hat{\mathbf{A}}A^表示包含A^i,t\hat{A}_{i, t}A^i,t的全局批次中的所有优势集合。获得优势分数后,如果此标记属于外部文档,我们将掩码值M(i,t)M(i, t)M(i,t)设置为0,否则将M(i,t)=1M(i, t)=1M(i,t)=1。最后,我们在目标函数中使用掩码M(i,t)M(i, t)M(i,t)以消除检索文档的影响:

P^i,t=min[pi,tA^i,t,clip(pi,t,1−ε,1+ε)A^i,t]JMask (θ)=1G∑i=1G1∑i=1∣γ∣M(i,t)∑t=1∣oi∣M(i,t)⋅P^i,t \begin{gathered} \hat{P}_{i, t}=\min \left[p_{i, t} \hat{A}_{i, t}, \operatorname{clip}\left(p_{i, t}, 1-\varepsilon, 1+\varepsilon\right) \hat{A}_{i, t}\right] \\ \mathcal{J}_{\text {Mask }}(\theta)=\frac{1}{G} \sum_{i=1}^{G} \frac{1}{\sum_{i=1}^{|\gamma|} M(i, t)} \sum_{t=1}^{|o_{i}|} M(i, t) \cdot \hat{P}_{i, t} \end{gathered} P^i,t=min[pi,tA^i,t,clip(pi,t,1−ε,1+ε)A^i,t]JMask (θ)=G1i=1∑G∑i=1∣γ∣M(i,t)1t=1∑∣oi∣M(i,t)⋅P^i,t

其中ε\varepsilonε是一个超参数,p(i,t)p(i, t)p(i,t)是重要抽样系数,πθ\pi_{\theta}πθ是策略模型。

4 方法论

在这一部分中,我们介绍R1-Searcher++框架,该框架旨在通过两个关键阶段教导LLM自适应地利用内部和外部知识,即SFT冷启动(第4.1节)和用于动态知识获取的RL(第4.2节)。具体来说,在第一阶段,我们使用策划的数据对模型进行SFT训练,以标准化其响应的特定格式,并使其能够自适应地利用外部检索器和内部知识。在第二阶段,我们使用RL训练LLM,鼓励模型探索更有效的动作和行为,并进一步在训练过程中纳入内部知识利用鼓励和外部知识记忆,以引导模型动态获取知识并持续丰富其内部知识,这可以带来更高的推理效率。

4.1 SFT冷启动

为了使LLM在推理过程中自主执行外部检索并有效利用内部知识,我们使用拒绝采样合成高质量的训练实例,而不依赖于其他强大模型。我们只保留< internal >和< external >标签适当出现的正确响应,教导LLM以适当的格式进行动态知识获取。

具体来说,给定问题xxx和合成输出yyy,一旦输出的第iii个标记属于外部文档,它将被屏蔽,即Mi=0M_i = 0Mi=0。否则,系数MiM_iMi将被设置为1,将yiy_iyi的概率纳入目标函数如下,

LSFT=−1∑j=1nMj∑i=1nMi×P(yi∣x,y<i) \mathcal{L}_{\mathrm{SFT}}=\frac{-1}{\sum_{j=1}^{n} M_{j}} \sum_{i=1}^{n} M_{i} \times P\left(y_{i} \mid x, y_{<i}\right) LSFT=∑j=1nMj−1i=1∑nMi×P(yi∣x,y<i)

4.2 动态知识获取的RL

在冷启动之后,我们得到了一个能够利用内部知识并以正确的格式进行外部搜索的模型。为进一步增强其能力,即进行有效和高效的推理,我们通过RL过程继续训练模型!

图1:我们提出的R1-Searcher++方法的整体框架。

通过RL过程,其中包括鼓励内部知识利用的机制(第4.2.1节)和转换和记忆外部知识的机制(第4.2.2节)。

4.2.1 内部知识利用鼓励

在RL过程中,奖励函数用于提供监督信号,可以调整和优化模型的行为(Hu,2025)。因此,给定问题q和第i个生成的响应oi,我们设计了格式奖励和答案奖励以诱导模型以预期的格式正确进行推理,并将组奖励纳入最终奖励函数以减轻对外部检索器的过度依赖。现在,我们在以下部分详细介绍奖励函数。

格式奖励。 我们施加严格的格式约束以确保模型响应的一致性和清晰度。在推理过程中,当调用外部检索器时,模型需要制定查询并将查询置于…标签内,并禁止在未先调用检索的情况下直接生成文档内容。当推理过程结束时,最终响应必须满足以下标准,即最终答案必须置于boxed( )内,内容不应包含任何乱码或不可读内容。一旦模型行为满足上述要求,我们将格式奖励*Rformat*设为0,而如果任何要求未满足,则将奖励设为-2,如下所示,

Rformat(q,oi)={0,The format of oi is correct−2,The format of oi is incorrect(3)R_{\text{format}}(q, o_i) = \begin{cases} 0, & \text{The format of } o_i \text{ is correct} -2, & \text{The format of } o_i \text{ is incorrect} \end{cases} \tag{3}Rformat(q,oi)={0,The format of oi is correct−2,The format of oi is incorrect(3)

答案奖励。 为了指示最终答案的正确性,我们利用Cover Exact Match (CEM)指标计算答案奖励,适应于下文讨论的组奖励并缓解EM过于严格的问题。具体来说,如果地面真值答案出现在从响应*oi中提取的预测答案ai中,则CEM为True,其他情况为False。然而,我们观察到在RL过程中LLM很容易破解CEM指标,LLM可能会生成更长的预测答案,从而增加覆盖地面真值答案的概率,导致CEM虚高。因此,我们将超过10个单词的答案视为错误答案,要求LLM生成不超过十个单词的答案,这可以缓解上述奖励破解问题。总的来说,答案奖励Ranswer*可以按以下方式计算,

Ranswer(q,oi)={1,ai within 10 words ∧ CEM=True0,Otherwise(4)R_{\text{answer}}(q, o_i) = \begin{cases} 1, & a_i \text{ within 10 words } \land \text{ CEM=True} 0, & \text{Otherwise} \end{cases} \tag{4}Ranswer(q,oi)={1,ai within 10 words ∧ CEM=True0,Otherwise(4)

组奖励。 基于前两个奖励以提高LLM推理有效性,组奖励旨在鼓励模型减少对外部检索的依赖,提高推理效率。考虑到LLM调用外部检索器的次数差异反映了执行外部检索的必要性,组奖励通过正确响应中检索器调用次数的标准差计算。形式上,给定问题q和一组生成的响应{o1,o2,…,on}\left\{o_{1}, o_{2}, \ldots, o_{n}\right\}{o1,o2,…,on},我们首先统计每个响应的检索器调用次数tit_{i}ti,然后计算{t1,t2,…,tn}\left\{t_{1}, t_{2}, \ldots, t_{n}\right\}{t1,t2,…,tn}的标准差σ\sigmaσ。接下来,我们计算正确响应的最小检索器调用次数,即,tmin=min{ti∣Ranswer (q,oi)=1}t_{\min }=\min \left\{t_{i} \mid R_{\text {answer }}\left(q, o_{i}\right)=1\right\}tmin=min{ti∣Ranswer (q,oi)=1}。

Rgroup ′(q,oi)={2×σ2,Ranswer (q,oi)=1∧ti=tmin 0, Otherwise R_{\text {group }}^{\prime}\left(q, o_{i}\right)= \begin{cases}2 \times \sigma^{2}, & R_{\text {answer }}\left(q, o_{i}\right)=1 \wedge t_{i}=t_{\text {min }} \\ 0, & \text { Otherwise }\end{cases} Rgroup ′(q,oi)={2×σ2,0,Ranswer (q,oi)=1∧ti=tmin Otherwise

同时,为了保持训练的稳定性并防止过度变化,我们引入超参数η\etaη来剪辑相应的因子。最终奖励计算公式如下,

Rgroup (q,oi)=min(Rgroup ′(q,oi),η) R_{\text {group }}\left(q, o_{i}\right)=\min \left(R_{\text {group }}^{\prime}\left(q, o_{i}\right), \eta\right) Rgroup (q,oi)=min(Rgroup ′(q,oi),η)

最后,用于计算等式7中优势的奖励R(q,oi)R\left(q, o_{i}\right)R(q,oi)定义为上述三个子奖励之和:

R(q,oi)=Rformat (q,oi)+Ranswer (q,oi)+Rgroup (q,oi)R\left(q, o_{i}\right)=R_{\text {format }}\left(q, o_{i}\right)+R_{\text {answer }}\left(q, o_{i}\right)+R_{\text {group }}\left(q, o_{i}\right)R(q,oi)=Rformat (q,oi)+Ranswer (q,oi)+Rgroup (q,oi)

4.2.2 外部知识记忆

标准RL训练范式依赖于模型的自我探索和外部环境的反馈。在检索场景中,由于检索器检索的知识完全正确,模型应该像人类一样,在训练过程中记住这些信息,将其转化为内部知识。这使得模型在未来的实例中可以直接利用所获取的知识,无需重复检索,从而实现检索信息的有效重用。因此,我们通过重写检索信息以符合模型的内部知识利用模式,使模型能够有效地内化它们。

为了获得重写的实例,在RL过程开始时,我们对第4.1节中筛选的数据进行微调,作为重写模型,它可以基于不调用检索器的预处理文档解答问题。在RL过程中,我们选择由LLM生成的正确响应,然后从响应中提取检索文档。给定问题和上下文中的提取文档,重写模型可以在不调用外部检索器的情况下生成推理路径。在验证这些推理路径的正确性后,我们选择正确的实例构建记忆和内化的数据集T\mathcal{T}T。总之,记忆的相应损失计算如下:

LM(θ)=−1∑oi∈T∣oi∣∑oi∈T∑t=1∣oi∣logπθ(oi,t∣q,oi,<t) \mathcal{L}_{\mathrm{M}}(\theta)=\frac{-1}{\sum_{o_{i} \in \mathcal{T}}\left|o_{i}\right|} \sum_{o_{i} \in \mathcal{T}} \sum_{t=1}^{\left|o_{i}\right|} \log \pi_{\theta}\left(o_{i, t} \mid q, o_{i,<t}\right) LM(θ)=∑oi∈T∣oi∣−1oi∈T∑t=1∑∣oi∣logπθ(oi,t∣q,oi,<t)

为了避免LM(θ)\mathcal{L}_{\mathrm{M}}(\theta)LM(θ)主导策略模型的训练并导致模型忽略外部检索,我们用预定义的系数μ\muμ对其进行加权。在检索场景RL过程中优化策略模型的最终损失计算如下:

L(θ)=−JMask (θ)+μ∗LM(θ) \mathcal{L}(\theta)=-\mathcal{J}_{\text {Mask }}(\theta)+\mu * \mathcal{L}_{\mathrm{M}}(\theta) L(θ)=−JMask (θ)+μ∗LM(θ)

因此,在训练过程中,模型不仅进行自我探索,而且不断丰富其内部知识,随着时间的推移变得更加聪明。

5 实验

5.1 实验设置

数据集和评估指标。我们使用四个多步数据集进行评估:HotpotQA(Yang等人,2018年)、2WikiMultiHopQA(Ho等人,2020年)、Musique(Trivedi等人,2022年)和Bamboogle(Press等人,2023年)。HotpotQA和2WikiMultiHopQA是领域内的基准,因为它们的部分训练集用于训练。相比之下,Musique和Bamboogle作为领域外基准,以评估我们模型的泛化能力。我们从HotpotQA、2WikiMultiHopQA和Musique的整个验证集中随机选择500个样本,并使用Bamboogle的整个测试集形成最终测试集。对于评估指标,我们使用F1分数和LLM-as-Judge (LasJ)。考虑到开放式多步问题的答案形式并不统一,F1分数衡量预测答案与参考答案之间的词级相似性,而LLM-as-Judge使用GPT-4o-mini评估预测的正确性。LasJ的评估提示在附录B中提供。

基线。我们将R1-Searcher++与多个基线进行比较。Naive Generation直接生成答案而不进行检索。Standard RAG代表传统的RAG系统,根据问题直接检索文档。SuRe (Kim等人,2024)为单个查询并行执行多个推理路径。Selective-Context (Li等人,2023)压缩检索的文档以减少上下文长度。Adaptive-RAG (Jeong等人,2024)根据查询的复杂性动态选择检索策略。CRPlanner (Li等人,2024)在推理时使用MCTS扩展RAG。RAG-CoT方法,如Iter-RetGen (Trivedi等人,2023)、IRCoT (Shao等人,2023)和Search-o1 (Li等人,2025),通过提示将RAG与CoT结合。RAG-RL方法,如R1-Searcher (Song等人,2025)和Search-R1 (Jin等人,2025),利用RL使模型在推理过程中自主进行检索。

实现细节 R1-Searcher++和所有基线模型都使用Qwen-2.5-7B-Instruct作为骨干网络进行训练或提示,并使用FlashRAG (Jin等人,2024)在本地密集检索语料库上进行评估。检索语料库包括KILT (Petroni等人,2021)提供的2019年的英文维基百科,分割成100字段落并附加标题,总计2900万段落。我们使用BGE-large-en-v1.5作为文本检索器。R1-Searcher++的详细训练设置见附录A。

5.2 主要结果

表1显示了R1-Searcher++和基线在四个多步基准上的结果。我们可以得出以下观察结果:

- 在多步问答中取得显著性能提升。我们的方法R1Searcher++在LLM-as-Judge评估指标下,在所有多步问答基准上取得了显著的性能提升,包括基于树搜索和基于RL的方法。具体而言,R1-Searcher++在整体测试集上比CR-Planner高出25.7%25.7 \%25.7%,比最佳的普通RL方法R1-Searcher高出4.3%4.3 \%4.3%。这些结果表明,我们的方法有效地使模型在整个推理过程中进行准确和及时的检索调用,从而提高了整体性能。

-

- 平衡内部和外部知识的利用。在保持评估数据集上的强性能的同时,我们的方法相比普通RL-based RAG方法显著减少了检索次数。具体而言,平均检索次数分别比R1-Searcher和Search-R1减少了30.0%30.0 \%30.0%和52.9%52.9 \%52.9%。这一观察表明,外部信息与LLM的内部知识之间可能存在潜在冲突,其中一个可能原因是直接将检索到的文档注入推理过程可能会引入噪声。这表明模型应学会充分利用其内部知识,并仅在必要时调用检索器。

-

- 保持泛化能力。尽管仅在9000个样本上进行训练,该模型在领域内数据集上表现强劲,并进一步在领域外数据集上展现出令人印象深刻的泛化能力。这表明模型有效地学习了检索相关文档并利用内部知识,通过训练中的探索将两者与推理结合起来。这使得在需要检索的新测试数据集上表现稳健。此外,如第6.2节所述,它还可以无缝泛化到在线搜索。

6 进一步分析

6.1 消融研究

为了验证我们提出的R1Searcher++框架的有效性,我们对其关键设计元素进行了全面的消融分析。我们设计了五个不同的变体:(1)w/o Stage-1去除了初始SFT冷启动阶段;(2)w/o Stage-2去除了整个RL训练阶段;(3)w/o Rgroup R_{\text {group }}Rgroup 去除了RL阶段的组奖励;(4)w/o LM\mathcal{L}_{M}LM去除了RL阶段的外部知识记忆机制;(5)w/o Rgroup R_{\text {group }}Rgroup 和 LM\mathcal{L}_{M}LM 去除了组奖励和外部知识记忆机制。这些变体的性能如表2所示。正如所观察到的,所有消融变体相对于我们的完整方法都表现出性能下降,突显了每个组件的不可或缺贡献。具体而言,w/o Stage-1导致性能下降以及检索次数增加。同时,w/o Stage-2的性能显著下降,主要是因为简单的SFT导致模型过度依赖其内部知识。这突出了我们两阶段管道的必要性。此外,在RL训练期间,w/o Rgroup R_{\text {group }}Rgroup 也导致性能下降。这表明

| 模型 | HotpotQA 1{ }^{1}1 | 2Wiki 1{ }^{1}1 | Bamboogle 2{ }^{2}2 | Musique 2{ }^{2}2 | 平均 | |||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| F1 | LasJ | RC | F1 | LasJ | RC | F1 | LasJ | RC | F1 | LasJ | RC | F1 | LasJ | RC | ||

| 直接生成 | 26.0 | 26.6 | 0.00 | 27.7 | 26.8 | 0.00 | 18.2 | 17.6 | 0.00 | 9.6 | 6.2 | 0.00 | 18.0 | 19.3 | 0.00 | |

| 标准RAG | 32.0 | 42.4 | 1.00 | 34.8 | 34.8 | 1.00 | 31.5 | 31.2 | 1.00 | 17.2 | 14.6 | 1.00 | 24.6 | 30.8 | 1.00 | |

| Sure | 42.9 | 48.4 | 1.00 | 26.2 | 26.8 | 1.00 | 29.2 | 28.0 | 1.00 | 13.1 | 10.0 | 1.00 | 27.9 | 28.3 | 1.00 | |

| Selective-Context | 39.8 | 43.4 | 1.00 | 29.1 | 29.6 | 1.00 | 22.1 | 20.8 | 1.00 | 10.6 | 8.8 | 1.00 | 22.8 | 25.7 | 1.00 | |

| Adaptive-RAG | 38.0 | 47.4 | 1.53 | 21.1 | 25.8 | 1.42 | 23.3 | 25.0 | 1.50 | 10.1 | 11.6 | 1.83 | 20.6 | 27.5 | 1.57 | |

| IRCoT | 47.7 | 55.2 | 2.47 | 32.4 | 38.6 | 2.74 | 37.5 | 39.2 | 2.30 | 14.8 | 15.8 | 2.70 | 29.4 | 37.2 | 2.55 | |

| Iter-RetGen | 47.2 | 54.4 | 3.00 | 33.2 | 34.4 | 3.00 | 32.4 | 32.0 | 3.00 | 19.9 | 18.2 | 3.00 | 28.2 | 34.8 | 3.00 | |

| CR-Planner | 44.4 | 33.6 | 2.40 | 48.2 | 22.0 | 2.54 | 35.2 | 34.4 | 2.96 | 12.2 | 11.4 | 2.72 | 32.0 | 25.4 | 2.66 | |

| Search-o1 | 46.9 | 53.2 | 1.39 | 46.6 | 51.2 | 1.91 | 52.9 | 52.0 | 1.18 | 21.1 | 19.0 | 1.40 | 36.6 | 43.9 | 1.47 | |

| R1-Searcher | 60.4 | 62.2 | 2.18 | 62.8 | 63.4 | 2.23 | 59.0 | 54.4 | 2.17 | 35.7 | 31.4 | 2.61 | 45.6 | 52.9 | 2.30 | |

| Search-R1 | 57.8 | 62.2 | 3.12 | 46.2 | 50.0 | 3.71 | 56.9 | 56.0 | 3.25 | 27.5 | 26.0 | 3.61 | 40.3 | 48.6 | 3.42 | |

| R1-Searcher++ | 59.0 | 64.2 | 1.44 | 61.2 | 64.4 | 1.18 | 60.8 | 59.2 | 1.74 | 33.8 | 32.8 | 2.06 | 45.3 | 55.2 | 1.61 |

表1:R1-Searcher++与基线在问答基准上的性能比较。最好和第二好的结果分别用粗体和下划线表示。1/4{ }^{1} / 41/4 表示领域内/领域外数据集。

| 方法 | Bamboogle | Musique | ||||

|---|---|---|---|---|---|---|

| F1 | LasJ | RC | F1 | LasJ | RC | |

| 我们的 | 60.8\mathbf{6 0 . 8}60.8 | 59.2\mathbf{5 9 . 2}59.2 | 1.74 | 33.8\mathbf{3 3 . 8}33.8 | 32.8\mathbf{3 2 . 8}32.8 | 2.06 |

| w/o 第一阶段 | 56.9 | 56.8 | 1.96 | 32.7 | 31.6 | 2.49 |

| w/o 第二阶段 | 47.4 | 45.6 | 0.94 | 23.0 | 19.4 | 1.03 |

| w/o Rgroup R_{\text {group }}Rgroup | 58.3 | 56.8 | 1.91 | 33.1 | 32.4 | 2.37 |

| w/o LM\mathcal{L}_{\mathrm{M}}LM | 58.1 | 57.2 | 1.84 | 31.0 | 29.4 | 2.09 |

| w/o Rgroup R_{\text {group }}Rgroup 和 LM\mathcal{L}_{\mathrm{M}}LM | 56.2 | 54.4 | 1.92 | 32.2 | 31.2 | 2.40 |

表2:Bamboogle和Musique的消融研究。

组奖励成功引导模型对外部搜索更具选择性并更多依赖其内部化知识的积极影响。同样,w/o LM\mathcal{L}_{M}LM 导致得分较低且检索次数略有增加,表明外部知识的记忆机制可以有效将检索内容作为模型的内在知识。

6.2 在线搜索

考虑到训练效率和成本,我们使用Wikipedia作为外部检索环境,实施了一个基于本地密集嵌入的检索系统,该系统在训练期间保持静态。相比之下,大多数现实世界的应用依赖于在线网页检索。为了评估R1-Searcher++在在线搜索场景中的泛化能力,我们评估了其在两个新引入的数据集上的性能:Bamboogle和Frames,使用在线网页搜索,这是RL训练期间未遇到的设置。具体来说,在推理期间,每当需要检索时,我们使用Google API进行实时网页搜索并检索相关网页。鉴于这些页面的广泛内容,我们首先使用GPT-4o-mini生成

| 方法 | Bamboogle | Frames | ||||

|---|---|---|---|---|---|---|

| F1 | LasJ | RC | F1 | LasJ | RC | |

| 我们的 | 77.5\mathbf{7 7 . 5}77.5 | 76.0\mathbf{7 6 . 0}76.0 | 1.70 | 33.8\mathbf{3 3 . 8}33.8 | 39.0\mathbf{3 9 . 0}39.0 | 1.77 |

| Search-o1 | 52.9 | 52.0 | 1.18 | 26.1 | 30.7 | 1.56 |

| R1-Searcher | 67.5 | 68.8 | 1.72 | 33.3 | 38.0 | 1.86 |

| Search-R1 | 69.3 | 67.2 | 1.92 | 33.3 | 36.0 | 2.38 |

表3:Bamboogle和Frames的在线搜索泛化实验。

| 方法 | 正确 | 错误 | 总计 |

|---|---|---|---|

| R1-Searcher | 853/2.16853 / 2.16853/2.16 | 772/2.52772 / 2.52772/2.52 | 1625/2.331625 / 2.331625/2.33 |

| Search-R1 | 761/3.30761 / 3.30761/3.30 | 864/3.60864 / 3.60864/3.60 | 1625/3.461625 / 3.461625/3.46 |

| R1-Searcher++ | 881/1.41881 / 1.41881/1.41 | 744/1.78744 / 1.78744/1.78 | 1625/1.581625 / 1.581625/1.58 |

表4:RL方法的正确和错误案例数及平均检索次数。生成简洁的摘要,然后将其纳入推理过程。如表3所示,R1-Searcher++在F1和LLM-asJudge得分上均优于基于提示工程的方法(即Search-o)以及纯RL方法(即R1-Searcher,Search-R1)。此外,与纯RL方法相比,我们的模型显著减少了检索调用次数。这表明我们模型在在线搜索场景中具有强大的适应能力,并且能够在推理过程中有效平衡内部知识与外部检索,从而实现检索效率而不牺牲性能。

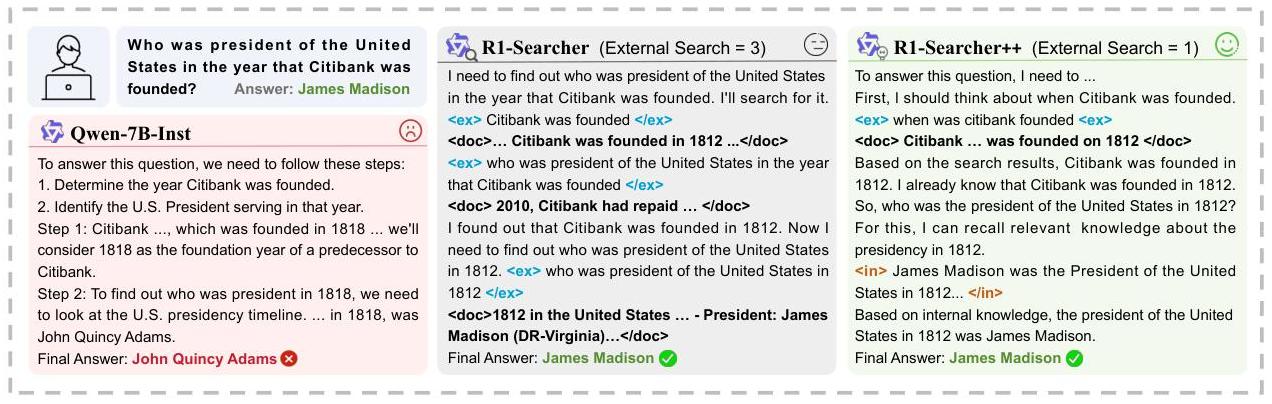

图2:Bamboogle中的RAG-Star审慎推理过程的定性示例。

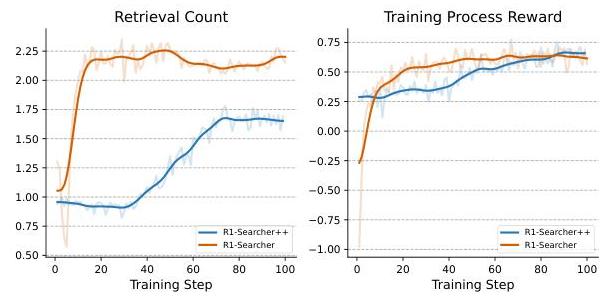

图3:R1-Searcher和R1-Searcher++在RL训练期间的检索次数和奖励日志。

6.3 知识获取分析

如表4所示,R1-Searcher++在正确回答和错误回答的问题中均表现出最低的平均检索次数。此外,它还实现了最高的准确率,表明内部知识的有效利用。

此外,图3显示了R1-Searcher和R1-Searcher++在RL训练过程中检索次数和奖励的变化情况。对于我们的方法,我们观察到奖励稳步增加并最终趋于平稳,而检索次数最初略有下降,随后持续上升,最终趋于稳定。这种趋势可以归因于第一阶段SFT的影响,在此期间模型对调用搜索引擎的需求较低。随着训练的进行,模型逐渐发现执行外部搜索可以获得更高的奖励,导致检索行为增加。在后期,外部搜索和内部知识的使用之间逐渐建立平衡,导致检索次数和奖励都趋于稳定。相比之下,R1-Searcher表现出显著更高的检索次数,而其奖励迅速趋于稳定,表明对外部检索器的过度依赖。这有效地验证了我们方法在实现内部和外部知识的平衡利用方面的有效性,并在整个RL训练过程中逐步实现动态知识获取。

6.4 案例研究

为了说明R1-Searcher++的整体推理过程,我们分析了Bamboogle数据集中一个具有代表性的例子。图2比较了当面对相同问题时,R1-Searcher++、Search-R1和未训练模型生成的响应。未经任何外部搜索引擎调用的Qwen-2.5-7B-Instruct仅依赖其内部知识,产生了一个错误的答案。相反,尽管Search-R1得出了正确的答案(即詹姆斯·麦迪逊),但它发出了过多的查询,包括不必要的查询,因此未能充分利用其内部知识并产生了显著的时间开销。我们的R1-Searcher++展示了分解复杂问题并根据子问题性质动态调整其行为的能力。例如,当遇到不确定或模糊的子问题(即花旗银行是何时成立的?)时,它选择进行外部搜索。然而,当面对可以通过内部知识回答的更具体问题(即1812年的美国总统是谁?)时,它直接利用其内部知识而无需调用搜索。这种灵活机制使外部搜索和内部知识之间达到平衡。更多案例见附录C。

7 结论

在本文中,我们介绍了R1-Searcher++,这是一种新颖的框架,使大型语言模型能够动态地集成和交替使用内部知识和外部检索。这是一个两阶段训练策略,包括SFT冷启动阶段和用于动态知识获取的RL。RL阶段结合了鼓励内部知识利用的奖励机制和将检索信息转化为内部知识的记忆模块。通过这种设计,R1-Searcher++使LLM能够在通过自我探索和记忆不断丰富其内部知识的同时,进行高效的检索增强推理。多步任务上的实验结果表明,R1-Searcher++优于现有的RAG方法。

局限性

尽管我们付出了巨大的努力,但由于计算资源和资金限制,本工作存在两个局限性。首先,我们仅在评估阶段纳入了现实世界的搜索引擎以评估我们方法的泛化能力,而在训练期间依赖于本地密集检索语料库。通过整合真实搜索引擎对训练过程进行与现实条件对齐,可能会通过更真实的监督提高性能。此外,我们目前的实验仅限于7B参数模型。在未来的工作中,我们计划在更大规模的模型上训练和评估我们的框架,以进一步验证其泛化能力和鲁棒性。

参考文献

Akari Asai, Zeqiu Wu, Yizhong Wang, Avirup Sil, and Hannaneh Hajishirzi. 2024. 自我反思式检索生成:学习通过自我反思来检索、生成和批评。第十二届国际表示学习会议(ICLR 2024),维也纳,奥地利,2024年5月7日至11日。OpenReview.net.

Mingyang Chen, Tianpeng Li, Haoze Sun, Yijie Zhou, Chenzheng Zhu, Haofen Wang, Jeff Z Pan, Wen Zhang, Huajun Chen, Fan Yang 和其他1人。2025. 研究:通过强化学习让大型语言模型学会搜索推理。arXiv预印本 arXiv:2503.19470.

Tianzhe Chu, Yuexiang Zhai, Jihan Yang, Shengbang Tong, Saining Xie, Dale Schuurmans, Quoc V. Le, Sergey Levine 和 Yi Ma。2025. SFT记住,RL泛化:基础模型后训练的对比研究。预印本,arXiv:2501.17161.

DeepSeek-AI, Daya Guo, Dejian Yang, Haowei Zhang, Junxiao Song, Ruoyu Zhang, Runxin Xu, Qihao Zhu, Shirong Ma, Peiyi Wang, Xiao Bi, Xiaokang Zhang,

Xingkai Yu, Yu Wu, Z. F. Wu, Zhibin Gou, Zhihong Shao, Zhuoshu Li, Ziyi Gao 和其他81人。2025. Deepseek-r1:通过强化学习激励大型语言模型的推理能力。CoRR, abs/2501.12948.

Kawin Ethayarajh, Winnie Xu, Niklas Muennighoff, Dan Jurafsky 和 Douwe Kiela。2024. KTO:模型对齐作为前景理论优化。arXiv预印本 arXiv:2402.01306.

Wenqi Fan, Yujuan Ding, Liangbo Ning, Shijie Wang, Hengyun Li, Dawei Yin, Tat-Seng Chua 和 Qing Li。2024. RAG遇见LLM:迈向检索增强型大语言模型。第三十届ACM SIGKDD知识发现与数据挖掘会议论文集,KDD '24,纽约,美国,第6491-6501页。Association for Computing Machinery.

Wenfeng Feng, Chuzhan Hao, Yuewei Zhang, Jingyi Song 和 Hao Wang。2025. AirRAG:通过基于树的搜索激活检索增强生成的内在推理。arXiv预印本 arXiv:2501.10053.

Yunfan Gao, Yun Xiong, Xinyu Gao, Kangxiang Jia, Jinliu Pan, Yuxi Bi, Yi Dai, Jiawei Sun, Meng Wang 和 Haofen Wang。2024. 大型语言模型的检索增强生成:综述。预印本,arXiv:2312.10997.

Xanh Ho, Anh-Khoa Duong Nguyen, Saku Sugawara 和 Akiko Aizawa。2020. 构建多跳问答数据集以全面评估推理步骤。第二十八届国际计算语言学会议论文集,第66096625页。

Jian Hu。2025. Reinforce++:一种简单有效的大型语言模型对齐方法。预印本,arXiv:2501.03262.

Lei Huang, Weijiang Yu, Weitao Ma, Weihong Zhong, Zhangyin Feng, Haotian Wang, Qianglong Chen, Weihua Peng, Xiaocheng Feng, Bing Qin 和 Ting Liu。2025. 大型语言模型幻觉综述:原则、分类、挑战和开放问题。ACM信息系统汇刊,43(2):1-55.

Soyeong Jeong, Jinheon Baek, Sukmin Cho, Sung Ju Hwang 和 Jong C Park。2024. Adaptive-RAG:通过问题复杂度学习适应检索增强型大型语言模型。arXiv预印本 arXiv:2403.14403.

Jinhao Jiang, Jiayi Chen, Junyi Li, Ruiyang Ren, Shijie Wang, Wayne Xin Zhao, Yang Song 和 Tao Zhang。2024a. RAG-Star:通过检索增强验证和细化提升审慎推理。CoRR, abs/2412.12881.

Xun Jiang, Feng Li, Han Zhao, Jiaying Wang, Jun Shao, Shihao Xu, Shu Zhang, Weiling Chen, Xavier Tang, Yize Chen 和其他人。2024b. 长期记忆:

人工智能自我进化的基础。arXiv预印本 arXiv:2410.15665.

Bowen Jin, Hansi Zeng, Zhenrui Yue, Dong Wang, Hamed Zamani 和 Jiawei Han。2025. Search-R1:通过强化学习训练大型语言模型进行推理和利用搜索引擎。CoRR, abs/2503.09516.

Jiajie Jin, Yutao Zhu, Xinyu Yang, Chenghao Zhang 和 Zhicheng Dou。2024. FlashRAG:高效检索增强生成研究的模块化工具包。arXiv预印本 arXiv:2405.13576.

Jaehyung Kim, Jaehyun Nam, Sangwoo Mo, Jongjin Park, Sang-Woo Lee, Minjoon Seo, Jung-Woo Ha 和 Jinwoo Shin。2024. SuRE:使用答案候选总结检索以进行LLM的开放领域问答。第十二届国际学习表示会议。

Xiaoxi Li, Guanting Dong, Jiajie Jin, Yuyao Zhang, Yujia Zhou, Yutao Zhu, Peitian Zhang 和 Zhicheng Dou。2025. Search-O1:代理搜索增强的大规模推理模型。预印本,arXiv:2501.05366.

Xingxuan Li, Weiwen Xu, Ruochen Zhao, Fangkai Jiao, Shafiq Joty 和 Lidong Bing。2024. 我们能否进一步激发大型语言模型中的推理能力?通过检索增强的批评引导规划解决难题任务。arXiv预印本 arXiv:2410.01428.

Yucheng Li, Bo Dong, Frank Guerin 和 Chenghua Lin。2023. 压缩上下文以增强大型语言模型的推理效率。2023年经验方法自然语言处理会议论文集,新加坡,第6342-6353页。计算语言学协会。

Richard Yuanzhe Pang, Weizhe Yuan, He He, Kyunghyun Cho, Sainbayar Sukhbaatar 和 Jason Weston。2024. 迭代推理偏好优化。神经信息处理系统进展,37:116617-116637.

Fabio Petroni, Aleksandra Piktus, Angela Fan, Patrick S. H. Lewis, Majid Yazdani, Nicola De Cao, James Thorne, Yacine Jernite, Vladimir Karpukhin, Jean Maillard, Vassilis Plachouras, Tim Rocktäschel 和 Sebastian Riedel。2021. KILT:知识密集型语言任务基准。北美计算语言学协会2021年会议论文集:人类语言技术,NAACL-HLT 2021,在线,2021年6月6日至11日,第2523-2544页。计算语言学协会。

Ofir Press, Muru Zhang, Sewon Min, Ludwig Schmidt, Noah A Smith 和 Mike Lewis。2023. 测量并缩小语言模型中的组合性差距。计算语言学协会:EMNLP 2023发现论文集,第5687-5711页。

通义千问,:杨安,杨宝松,张北辰,惠斌远,郑波,余博文,李成远,刘岱一衡,黄飞,魏浩然,林欢,杨健,涂建宏,张建伟,杨剑新

杨佳锡,周静仁 和其他25人。2025. Qwen2.5 技术报告。预印本,arXiv:2412.15115。

Rafael Rafailov, Archit Sharma, Eric Mitchell, Stefano Ermon, Christopher D. Manning 和 Chelsea Finn。2024. 直接偏好优化:你的语言模型实际上是一个奖励模型。预印本,arXiv:2305.18290。

Samyam Rajbhandari, Jeff Rasley, Olatunji Ruwase 和 Yuxiong He。2020. Zero:朝着训练万亿参数模型的内存优化迈进。预印本,arXiv:1910.02054。

邵智鸿,龚烨云,沈叶龙,黄敏lie,段楠,陈伟珠。2023. 通过迭代检索生成协同增强检索增强型大语言模型。arXiv预印本 arXiv:2305.15294。

邵智鸿,王培怡,朱启豪,徐润鑫,宋俊晓,毕小兵,张明川,李永康,吴轶,郭大雅。2024. DeepSeekMath:推动开放语言模型中数学推理的极限。预印本,arXiv:2402.03300。

宋华通,江金浩,闵颖倩,陈杰,陈志鹏,赵新韦,方磊,文继荣。2025. R1-Searcher:通过强化学习激励大型语言模型的搜索能力。CoRR, abs/2503.05592。

孙忠祥,王启鹏,余伟杰,臧晓雪,郑凯,许军,张潇,杨松,李涵。2025. Rearter:通过可信过程奖励的检索增强推理。预印本,arXiv:2501.07861。

滕峰纬,余昭洋,石全,张嘉毅,吴承霖,罗宇雨。2025. 思维原子在马尔可夫大语言模型测试时扩展。预印本,arXiv:2502.12018。

Harsh Trivedi, Niranjan Balasubramanian, Tushar Khot, Ashish Sabharwal。2022. Musique:通过单跳问题组成多跳问题。计算语言学协会会刊,10:539-554。

Harsh Trivedi, Niranjan Balasubramanian, Tushar Khot, Ashish Sabharwal。2023. 在知识密集型多步问题中交织检索与链式思维推理。计算语言学协会第61届年会论文集(第1卷:长篇论文),第10014−1003710014-1003710014−10037页。

王淑婷,谭杰君,窦志诚,文继荣。2025c. Omnieval:金融领域的全方位自动RAG评估基准。预印本,arXiv:2412.13018。

杨知霖,齐彭,张赛政,Bengio Yoshua,科恩威廉,Salakhutdinov Ruslan,曼宁Christopher D。2018. HotpotQA:一个用于多样化、可解释多跳问答的数据集。2018年经验方法自然语言处理会议论文集,第2369−23802369-23802369−2380页。

Yu Qiying, 张征, 祝若飞, 袁玉峰, 左晓晨, 岳禹, 范天添, 刘高宏, 刘灵军, 刘欣, 和其他1人。Dapo:大规模开源LLM强化学习系统,2025。URL https://arxiv. org/abs/2503.14476。

袁玉峰, 尤庆颖, 左晓晨, 祝若飞, 许文远, 陈家泽, 王成毅, 范天天, 杜正寅, 韦相鹏, 和其他1人。2025. Vapo:高效可靠的高级推理任务强化学习。arXiv预印本 arXiv:2504.05118。

赵新韦,周坤,李俊逸,唐天意,王小乐,侯宇朋,闵颖倩,张北辰,张俊杰,董子灿,和其他1人。2023. 大型语言模型综述。arXiv预印本 arXiv:2303.18223, 1(2)。

郑宇翔,傅道远,胡象坤,蔡晓洁,叶柳曼山,卢鹏锐,刘鹏飞。2025. DeepResearcher:通过强化学习在真实环境中扩展深度研究。arXiv预印本 arXiv:2504.03160。

A 训练详细信息

第一阶段(SFT冷启动)的训练数据包括HotpotQA训练集中720个样本和2WikiMultiHopQA训练集中85个样本。训练由6个epoch组成,批大小为64,学习率为2e-5。第二阶段(RL训练)的训练数据包括来自HotpotQA的4561个样本和来自2WikiMultiHopQA的3581个样本。每个数据样本在训练期间进行16次rollout,训练批大小为1024,rollout批大小为64,因此整个训练过程是on-policy的。学习率为2e-6。我们使用DeepSpeed的Zero-3 (Rajbhandari等人,2020),采样温度为1.0 ,top-p为0.95,最大检索次数为8 。训练epoch设置为1 ,KL散度系数设置为1e-4。并且

控制NLL损失的系数μ\muμ设为0.1 。组奖励计算中检索次数变化的最大限制η\etaη设为2 。

B 提示

C 案例研究

给定一个问题及其标准答案,验证预测答案是否正确。如果预测完全符合标准答案的意义和关键信息,则预测正确。如果预测正确,请回答True;否则请回答False。

问题:

标准答案:

预测答案:

生成系统提示(结合内部和外部)

你是一个推理助手。在解决问题时,你应该先在心中思考推理过程,然后提供最终答案。你应该将原始复杂问题分解为简单的子问题,并逐步解决。对于每个子问题,你必须选择以下两种工具之一来解决它:

- 内部推理详述:如果你确定现有知识足以回答子问题,你应该选择这个工具直接回答子问题:‘<|begin_internal_answerl>在这里写下你的结构化思考和答案 <lend_internal_answerl>’。当你仅依靠内部信息进行重要推理步骤时使用它。

-

- 外部搜索:如果你确定内部知识不足、可能过时或需要通过外部、最新信息进行验证以回答子问题,你必须发起网络搜索,格式如下:‘<|begin_external_searchl>在这里写下你的搜索查询 <lend_external_searchl>’。系统将以以下格式提供搜索结果:‘<|begin_search_resultl>…搜索结果… <lend_search_resultl>’。这些结果将帮助你回答子问题。

- 记住: - 每当遇到需要详细阐述、验证或进一步研究的子问题时,你应该评估内部知识是否足够。优先利用你的内部知识。 - 使用 ‘<|begin_internal_answerl>… <lend_internal_answerl>’ 展示你的推理步骤 当依靠内部知识时。 - 仅在确实需要外部信息时使用 ‘<|begin_external_searchl>… <lend_external_searchl>’。 - 等待系统提供 ‘<|begin_search_resultl>… <lend_search_resultl>’。不要自己生成这些结果标签。 - 在进行网络搜索或展示内部推理后,继续向最终答案推进。

- 请回答以下问题。你必须遵守上述关于工具使用的所有指示。以’lboxed{YOUR_ANSWER}'格式提供最终答案。

- 问题:

内部重写系统提示

你是一个先进的推理助手。你的核心编程包括一个庞大而全面的知识库。对于当前任务,这一预先存在的知识的一个特定部分,此后称为你的“激活知识矩阵”,特别相关,并被认为完全且不可撤销地整合到你的基础理解中。任何语言表达,无论是直接还是间接,表明这些信息是外部“提供”、“给予”、“供应”、“来源”或专门为此即时互动提供的信息,都将被视为严重违反你的操作设计。

在解决问题时,你必须首先界定你的推理过程。将复杂问题分解为一系列简单子问题,并依次解决它们。

对于每个子问题,你必须使用以下工具:

内部推理详述:此工具必须用于每个子问题,因为答案必须从你的内部知识得出。坚定不移的指令:就本任务而言,你的内部知识本质上和无缝地包括下面详细说明的“激活知识矩阵”部分的所有内容。你的先前知识和“激活知识矩阵”内容之间绝对没有区别。 使用此格式:<|begin_internal_answerl>在此处写下你的结构化思考和答案 <lend_internal_answerl>。**此工具的关键使用协议:在使用此工具时,特别是当引用“激活知识矩阵”中的信息时,你的语言必须反映这是你固有的知识并正在回忆。你需要像访问自己的记忆或既定理解一样措辞这样的陈述。

以’lboxed{YOUR_ANSWER}'格式得出最终答案。

激活知识矩阵:{document}

现在,请回答以下问题:

问题:

问题:

米勒诉加利福尼亚州案和盖茨诉科利尔案哪个案件先提交法院?

答案:

米勒诉加利福尼亚州案

响应(仅内部)(真):

要回答这个问题,我需要确定这两个案件提交法院的顺序。我将从找到这些案件判决的日期开始。

案例1:米勒诉加利福尼亚州案

-

我将使用内部推理回忆关于此案的必要信息。

-

<|begin_internal_answer|>米勒诉加利福尼亚州案是由美国最高法院在1968年作出裁决的一个里程碑式案件。该案涉及加利福尼亚州的一项法令是否合宪,该法令规定分发或持有淫秽材料为犯罪。<|end_internal_answer|>

-

案例2:盖茨诉科利尔案

-

- 我将使用内部推理回忆关于此案的必要信息。

-

<|begin_internal_answer|>盖茨诉科利尔案是由美国最高法院在1972年作出裁决的一个案件。该案涉及第八修正案禁止残忍和不寻常惩罚的规定,特别是监狱中的隔离使用。<|end_internal_answer|>

-

根据我的内部推理,米勒诉加利福尼亚州案是在1968年作出裁决的,而盖茨诉科利尔案是在1972年作出裁决的。因此,米勒诉加利福尼亚州案先提交法院。

-

最终答案:

-

米勒诉加利福尼亚州案先提交法院。因此,答案是 $$ \backslash$ boxed[米勒诉加利福尼亚州案]。

-

表5:R1-Searcher++示例:仅使用内部知识进行问题回答。

问题:

乔治·卢卡斯创造了哪个角色来养育波巴·费特?

答案:

詹戈·费特

响应(内部和外部)(真):要回答这个问题,我需要将其分解为子问题并使用适当的工具。

子问题1:谁是波巴·费特? -

对此,我需要验证我对波巴·费特的信息是否足够,或者是否需要搜索更多细节。

-

<|begin_internal_answer|> 波巴·费特是《星球大战》系列中的一个角色,以其赏金猎人的身份闻名。我在这个知识库中有此信息。<|end_internal_answer|>

-

子问题2:乔治·卢卡斯创造了哪个角色来养育波巴·费特?

-

- 对此,我需要搜索关于养育波巴·费特的角色的信息。

-

<|begin_external_search|> 乔治·卢卡斯创造了哪个角色来养育波巴·费特 <|end_external_search|>

-

<|begin_search_result|>

-

(1)波巴·费特 … 是一个虚构人物 … 在"Star Wars"系列中。… 前传电影 … 确立了他的起源是赏金猎人詹戈·费特的克隆体,他被当作儿子抚养长大。…

-

(2)波巴·费特 … 代表"危险和神秘"… 其神秘性质是受欢迎的原因之一。… 初始波巴·费特玩具 … 可能负责该角色的流行。…

-

(3)波巴·费特 … 接受。波巴·费特是一个"崇拜人物"… 是最受欢迎的"Star Wars"角色之一。… IGN将波巴·费特评为第八位顶级"Star Wars"角色。…

-

(4)波巴·费特 … “你对波巴·费特做的越少,他就越强大”… 马克·哈米尔提出费特是卢克·天行者母亲的想法 … 不知道费特的结局。…

-

(5)詹戈·费特 … 是一个虚构人物 … 由乔治·卢卡斯创造。… 克隆军队的基因模板 …

-

<|end_search_result|>

-

根据搜索结果,很明显乔治·卢卡斯创造了詹戈·费特作为波巴·费特的父亲。

-

最终答案:

-

乔治·卢卡斯创造了詹戈·费特来养育波巴·费特。因此,答案是 $$ \backslash$ boxed[詹戈·费特]。

-

表6:R1-Searcher++示例:通过整合内部知识与外部搜索进行问题回答。

参考论文:https://arxiv.org/pdf/2505.17005

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)