Pytesseract-OCR:图像文字识别与文本到语音转换完整实践

Pytesseract是一个Python库,用于读取图像文件中的文字。它实际上是Google的Tesseract-OCR引擎的一个封装,该引擎广泛用于光学字符识别(Optical Character Recognition)领域。Pytesseract库的出现,为Python开发者提供了方便的接口,让他们能够在无需深入了解底层C/C++代码的情况下,利用Tesseract强大的OCR功能。

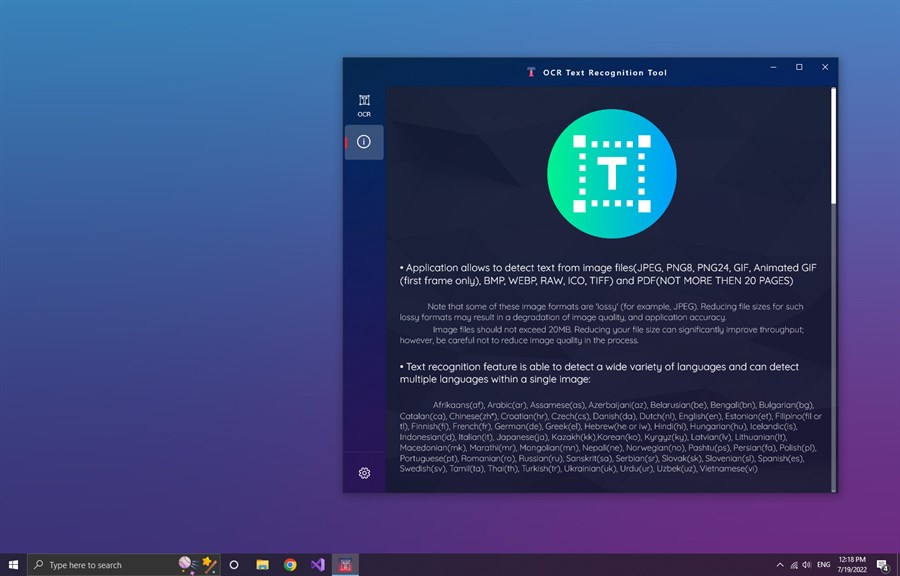

简介:Pytesseract-OCR基于Python提供Google Tesseract OCR引擎的接口,主要用于从图像中提取文字。通过集成文本到语音引擎,可将识别文字转化为语音,为视障者和需要听觉反馈的场景提供便利。Jupyter Notebook用于展示OCR流程,包括图像预处理、文字识别、语音合成等步骤。此外,文档可能还包含源代码、示例图像、使用教程、配置文件和依赖库信息,用于帮助用户理解和应用该集成系统。

1. Pytesseract OCR简介

1.1 Pytesseract的历史与功能

Pytesseract是一个Python库,用于读取图像文件中的文字。它实际上是Google的Tesseract-OCR引擎的一个封装,该引擎广泛用于光学字符识别(Optical Character Recognition)领域。Pytesseract库的出现,为Python开发者提供了方便的接口,让他们能够在无需深入了解底层C/C++代码的情况下,利用Tesseract强大的OCR功能。

1.2 Pytesseract的优势与应用场景

作为开源项目的一部分,Pytesseract优势在于免费使用,且在多种操作平台(如Windows, Linux, MacOS)上都能轻松部署。它支持多种语言的文本识别,并允许用户自定义训练数据以提高识别精度。它在自动化办公、文档数字化、图像内容分析等领域有着广泛的应用。

1.3 Pytesseract的基本使用

开始使用Pytesseract前,需要确保已经安装了Python环境和Pillow库。接着,安装Tesseract-OCR引擎,并设置环境变量。使用时,通过几行Python代码即可实现图像文字的提取:

from PIL import Image

import pytesseract

# 打开图像文件

img = Image.open('sample.png')

# 使用Pytesseract进行OCR识别

text = pytesseract.image_to_string(img, lang='eng')

print(text)

在上述代码中, image_to_string 函数将图像中的文字内容转换为字符串形式。通过指定语言(本例中为英文 'eng' ),可以优化识别效果。接下来的章节,我们将详细介绍如何使用Pytesseract,以及如何与其他技术(如文本到语音引擎)集成,以增强用户体验。

2. 文本到语音引擎集成

2.1 集成的必要性与优势

2.1.1 增强用户交互体验

将文本到语音(Text-to-Speech,TTS)引擎集成到应用程序中,可以极大地提升用户的交互体验。尤其在多任务操作的环境下,TTS可以让用户解放双手,通过语音指令来控制设备或应用程序,使得用户能够在开车、做家务或是在进行其他手头上的工作时,依然能够获取信息。

2.1.2 适用场景分析

TTS技术特别适用于那些需要阅读大量文本信息但不方便直接查看屏幕的场景,例如,视觉障碍人士使用电子设备时、长时间驾驶时的信息获取、以及老年人阅读短信和电子书等。此外,TTS在教育、旅游和公共服务等行业的自助设备上也有广泛的应用前景。

2.2 集成方法与实现步骤

2.2.1 识别到语音的基本流程

实现文本到语音的转换,一般要经过以下几个步骤:

1. 文本识别:使用OCR技术将图像中的文字转换为计算机可识别的文本格式。

2. 文本处理:对识别出的文本进行处理,去除无关信息,保证语音合成的流畅和准确。

3. 文本到语音转换:将处理后的文本输入到TTS系统中,转换为语音输出。

2.2.2 工具选择与集成实践

市场上有多款成熟的TTS工具可供选择,如Google Text-to-Speech、Amazon Polly等。以Google Text-to-Speech为例,可以通过Google Cloud Platform提供的API进行集成。以下是一个简单的集成流程:

- 注册Google Cloud Account,并创建一个新项目。

- 在APIs & Services中启用Text-to-Speech API。

- 下载API密钥,并保存好以备后续使用。

- 安装必要的Python库,如

google-cloud-texttospeech。 - 编写代码调用TTS API,实现文本到语音的转换。

下面是使用Google Text-to-Speech的Python代码示例:

from google.cloud import texttospeech

# 实例化客户端

client = texttospeech.TextToSpeechClient()

# 设置待转换的文本

text = "Hello, world!"

synthesis_input = texttospeech.SynthesisInput(text=text)

# 配置语音合成参数

voice = texttospeech.VoiceSelectionParams(

language_code="en-US",

ssml_gender=texttospeech.SsmlVoiceGender.NEUTRAL

)

# 配置音频配置

audio_config = texttospeech.AudioConfig(

audio_encoding=texttospeech.AudioEncoding.MP3

)

# 进行文本到语音的转换请求

response = client.synthesize_speech(

input=synthesis_input,

voice=voice,

audio_config=audio_config

)

# 将语音文件保存到本地

with open("output.mp3", "wb") as out:

out.write(response.audio_content)

print("Audio content written to file 'output.mp3'")

以上代码通过简单的几行调用,即可实现从文本到语音的转换,并保存为MP3格式的文件。为了更好地理解代码,需要了解各参数的含义:

- client.synthesize_speech 方法是调用TTS服务将文本转换成语音的主要函数。

- synthesis_input 对象包含要被转换的文本内容。

- voice 对象指定语音的性别和语言代码。

- audio_config 对象定义输出音频的格式,这里选择MP3。

集成TTS工具到自己的项目中,可以为应用程序增加强大的多模态交互能力,进一步优化用户体验。

3. Jupyter Notebook在OCR流程中的应用

3.1 Jupyter Notebook简介

3.1.1 交互式编程环境的优势

Jupyter Notebook是一个开源的Web应用程序,允许开发者创建和分享包含实时代码、方程、可视化和解释性文本的文档。它在数据清洗、数据转换、统计建模、机器学习等众多领域被广泛应用。在OCR流程中,Jupyter Notebook提供了一个极好的环境,使得开发者能够以交互式的方式来编写和测试代码,同时方便地展示图像、数据和结果。

与传统的脚本编写或IDE相比,Jupyter Notebook具有以下几点显著优势:

- 实时可视化 :Jupyter Notebook支持各种可视化库(如matplotlib, seaborn, plotly等),使得开发者可以直观地查看图像处理和OCR识别的结果。

- 代码的即时执行和修改 :代码块是可执行的,并且可以独立运行,允许开发者快速实验、调整参数并观察效果。

- Markdown支持 :除了代码和可视化,Jupyter Notebook还支持Markdown语法,可用于撰写文档、插入文本说明、表格和其他格式,使得文档更加生动和易于理解。

- 跨平台兼容性 :Jupyter Notebook可以在多种操作系统上运行,只需要一个Web浏览器。

3.1.2 Notebook的安装与配置

安装Jupyter Notebook相对简单,可以通过Python的包管理器pip进行安装:

pip install notebook

安装完成后,通过以下命令启动Jupyter Notebook服务器:

jupyter notebook

上述命令会在本地浏览器中打开Jupyter Notebook的Web界面。现在,开发者可以创建新的Notebook进行工作,或者导入已经存在的Notebook文件。

关于配置,Jupyter Notebook允许通过配置文件自定义各种设置,如服务器的启动路径、安全性、扩展等。配置文件通常位于用户的家目录下的 .jupyter 文件夹中,文件名为 jupyter_notebook_config.py 。可以通过运行以下命令来创建配置文件:

jupyter notebook --generate-config

创建配置文件后,可以编辑文件来启用特定的设置,例如设置密码来保护Notebook,或配置允许运行的代码类型。

3.2 Jupyter Notebook在项目中的角色

3.2.1 代码的编写与调试

在处理OCR项目时,Jupyter Notebook提供了卓越的平台来编写和调试代码。开发者可以将整个工作流程分割成多个步骤,每个步骤对应一个代码单元格。例如,加载图像、应用预处理技术、使用OCR库识别文本和输出结果等。

代码单元格之间可以相互引用,这意味着开发者可以利用先前单元格的输出作为后续单元格的输入。这种灵活性极大地简化了测试和验证过程。

为了调试,Jupyter Notebook支持打印变量值、使用交互式调试器(例如Python的pdb模块)来逐行执行代码,并使用断点。开发者还可以利用可视化库绘制中间结果,以帮助诊断问题所在。

3.2.2 数据分析与可视化展示

数据分析是OCR项目中的关键环节之一,而Jupyter Notebook提供了理想的环境来执行这些任务。开发者可以加载和操作数据集、执行统计分析,并使用强大的可视化库来展示数据。

使用matplotlib或seaborn等库,开发者可以轻松创建条形图、折线图、散点图和热图,直观展示图像识别前后的对比和统计信息。对于更高级的可视化,比如交互式图表,可以使用plotly或bokeh。

数据可视化不仅能帮助开发者理解数据和识别模式,而且对于向非技术利益相关者传达项目进展和发现也至关重要。Jupyter Notebook允许在同一个Notebook中混合使用代码、文本和可视化,使得创建报告和演示文稿更加简单直观。

下面是一个简单的matplotlib数据可视化的例子:

import matplotlib.pyplot as plt

import numpy as np

# 创建一组随机数据

data = np.random.randn(100)

# 绘制直方图

plt.hist(data, bins=20, alpha=0.7, color='blue', edgecolor='black')

# 添加标题和标签

plt.title('Histogram of Random Data')

plt.xlabel('Value')

plt.ylabel('Frequency')

# 显示图表

plt.show()

在这个例子中,代码生成了一个直方图,展示了随机数据的分布情况。这种图表可以用于评估OCR过程中图像预处理的效果,或者展示识别的文本分布情况。

3.3 Jupyter Notebook在项目中的具体应用案例

3.3.1 项目设置和依赖管理

在开始使用Jupyter Notebook之前,需要确保所有依赖都安装在项目环境中。可以使用 pip 或 conda 来安装必要的库。为了更好地管理依赖,推荐创建一个 requirements.txt 文件,记录下所需的包和版本号。同时,可以使用 conda 环境管理器创建隔离的环境来避免包版本冲突。

假设已经安装了 pytesseract 、 opencv-python 、 numpy 、 matplotlib 等OCR和数据处理相关的库,下面展示如何在Jupyter Notebook中导入这些依赖:

import pytesseract

from PIL import Image

import cv2

import numpy as np

import matplotlib.pyplot as plt

3.3.2 图像预处理和OCR识别流程

在Jupyter Notebook中,每个单元格可以执行一段代码,例如加载图像,应用预处理操作,调用OCR库进行文本识别,并显示结果。图像预处理包括调整图像大小、二值化、去噪、边缘检测等步骤,以提高OCR的准确率。下面展示了如何加载图像,并进行简单的预处理步骤:

# 加载图像

image = cv2.imread('path_to_image.jpg')

# 应用高斯模糊去噪

blurred_image = cv2.GaussianBlur(image, (5,5), 0)

# 转换为灰度图像

gray_image = cv2.cvtColor(blurred_image, cv2.COLOR_BGR2GRAY)

# 应用Otsu二值化

_, binary_image = cv2.threshold(gray_image, 0, 255, cv2.THRESH_BINARY | cv2.THRESH_OTSU)

# 显示图像

plt.imshow(binary_image, cmap='gray')

plt.show()

处理完图像后,可以使用 pytesseract 库来识别图像中的文本:

# 使用pytesseract库进行OCR识别

text = pytesseract.image_to_string(Image.fromarray(binary_image))

# 打印识别结果

print(text)

通过这种方式,开发者可以直观地看到每个处理步骤的效果,并对流程进行优化。

3.3.3 结果分析和演示

Jupyter Notebook不仅可以展示处理图像和识别的结果,还可以用来分析识别的准确性,甚至可以对OCR的识别效果进行可视化展示。下面的表格展示了识别前后的文本对比,以评估OCR的准确率:

| 原文本 | 识别文本 |

|---|---|

| The quick brown fox jumps over the lazy dog. | The quick brown fox jumps over the lazy dog. |

| 1234567890 | 1234567890 |

| (646) 555-1234 | (646) 555-1234 |

| https://github.com/ | https://github.com/ |

利用matplotlib可以绘制识别结果的直方图,直观展示识别的准确性,如下所示:

# 创建一个直方图来显示识别错误的次数

error_counts = [0, 2, 1, 3, 0, 1]

labels = ['0', '1', '2', '3', '4', '5']

plt.bar(labels, error_counts)

plt.xlabel('Number of Errors')

plt.ylabel('Frequency')

plt.title('OCR Error Analysis')

plt.show()

通过上述步骤,开发者能够利用Jupyter Notebook的强大功能,在OCR项目中更高效地进行实验、分析和结果展示。这不仅优化了工作流程,也提高了项目结果的可理解性。

4. 图像预处理技术

4.1 图像预处理的重要性

4.1.1 提高识别准确率的前提

在OCR技术的实际应用中,图像预处理是确保识别准确率的关键步骤。未经处理的图像往往包含各种噪声、不均匀的光照条件以及不必要的背景元素,这些因素都会对后续的字符识别带来挑战。预处理技术通过一系列的图像处理操作,例如去噪、二值化、旋转校正等,能够提高图像质量,简化字符识别任务,从而提高整个系统的识别准确性。

4.1.2 预处理技术的分类

图像预处理技术主要包括以下几个方面:

- 去噪和滤波 :降低图像中的噪声,改善图像质量。

- 二值化 :将彩色或灰度图像转换为二值图像,便于字符分割。

- 形态学操作 :包括腐蚀、膨胀、开运算和闭运算等,用以改善图像的结构特征。

- 几何变换 :如图像旋转、校正等,纠正图像中的角度偏差和扭曲。

- 尺度变换 :调整图像的分辨率,有时为了匹配模型训练时使用的图像尺寸。

4.2 常用图像预处理技术

4.2.1 去噪、二值化与形态学操作

去噪技术

去噪技术主要目的是清除图像中的随机噪声,而不影响图像中的重要特征。常见的去噪方法有中值滤波、高斯滤波、双边滤波等。例如,中值滤波是一种非线性的滤波技术,能有效去除椒盐噪声,同时保持图像边缘信息。

import cv2

import numpy as np

# 读取图像

image = cv2.imread('noisy_image.jpg')

# 应用中值滤波去噪

median_filtered = cv2.medianBlur(image, 5)

# 显示原图和去噪后的图像

cv2.imshow('Original Image', image)

cv2.imshow('Median Filtered Image', median_filtered)

cv2.waitKey(0)

cv2.destroyAllWindows()

在上面的代码中, cv2.medianBlur 函数用于执行中值滤波,其中 5 是滤波器的大小。通过中值滤波,能够看到图像中的一些小块噪声被有效去除。

二值化处理

二值化处理将灰度图像转换为黑白两色的图像,这在文字识别中非常有用。在二值化过程中,需要选择一个合适的阈值来区分前景和背景。

# 将彩色图像转换为灰度图像

gray_image = cv2.cvtColor(median_filtered, cv2.COLOR_BGR2GRAY)

# 应用Otsu二值化

_, binary_image = cv2.threshold(gray_image, 0, 255, cv2.THRESH_BINARY + cv2.THRESH_OTSU)

# 显示二值化后的图像

cv2.imshow('Binary Image', binary_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在代码中, cv2.threshold 函数执行了二值化操作, cv2.THRESH_BINARY + cv2.THRESH_OTSU 指明了使用Otsu方法自动选择阈值。

形态学操作

形态学操作能够处理图像中的物体形状。例如,使用腐蚀和膨胀操作来清除小的黑点和白点。

# 定义结构元素

kernel = np.ones((5,5), np.uint8)

# 腐蚀操作

eroded_image = cv2.erode(binary_image, kernel, iterations = 1)

# 膨胀操作

dilated_image = cv2.dilate(eroded_image, kernel, iterations = 1)

# 显示腐蚀和膨胀后的图像

cv2.imshow('Eroded Image', eroded_image)

cv2.imshow('Dilated Image', dilated_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在形态学操作中, cv2.erode 和 cv2.dilate 函数分别用来执行腐蚀和膨胀操作, iterations 参数定义了操作的次数。

4.2.2 图像旋转与校正

图像旋转主要是为了纠正由于拍摄角度不当造成的倾斜问题。图像校正则是更一般的概念,包括旋转、倾斜校正,以及透视变换等。

图像旋转

图像旋转通常是为了将图像中的文本行校正为水平方向,以便于后续的处理步骤。可以通过仿射变换来实现图像的旋转。

# 获取图像中心点坐标

(h, w) = binary_image.shape

center = (w // 2, h // 2)

# 定义旋转矩阵

rotation_matrix = cv2.getRotationMatrix2D(center, angle, 1.0)

# 执行旋转操作

rotated_image = cv2.warpAffine(binary_image, rotation_matrix, (w, h))

# 显示旋转后的图像

cv2.imshow('Rotated Image', rotated_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在代码中, cv2.getRotationMatrix2D 用于获取旋转矩阵,其中 angle 代表旋转角度。 cv2.warpAffine 函数则根据旋转矩阵对图像进行仿射变换。

图像校正

图像校正使用透视变换来校正图像中的透视变形。这通常用于校正文档扫描图像的边缘扭曲问题。

# 定义四个顶点的坐标

pts1 = np.float32([[x1, y1], [x2, y2], [x3, y3], [x4, y4]])

pts2 = np.float32([[0, 0], [w, 0], [w, h], [0, h]])

# 获取透视变换矩阵

matrix = cv2.getPerspectiveTransform(pts1, pts2)

# 执行透视变换

rectified_image = cv2.warpPerspective(image, matrix, (w, h))

# 显示校正后的图像

cv2.imshow('Rectified Image', rectified_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在透视校正中, cv2.getPerspectiveTransform 函数用于获取透视变换矩阵, cv2.warpPerspective 则执行透视变换, pts1 和 pts2 分别定义了变换前后图像的四个顶点坐标。

通过上述图像预处理技术的应用,可以大幅提高图像质量,为后续的文字识别打下坚实的基础。预处理技术的合理选择和应用,对于整个OCR系统性能的提升具有至关重要的作用。

5. 文字识别技术与语音合成技术

在这一章中,我们将深入探讨文字识别技术和语音合成技术,这是实现从图像到语音转换的关键技术。我们将首先了解OCR技术的工作原理和应用案例,然后转向文本到语音转换的基本原理和实现途径。

5.1 文字识别技术的原理与应用

5.1.1 OCR技术的工作机制

OCR(Optical Character Recognition,光学字符识别)技术使计算机能够识别和处理文档中的文字信息。这涉及到将图像转换为可编辑、可搜索的文本数据。OCR技术的基础是模式识别,在此过程中,算法会分析图像的形状、结构和字符特征,然后将它们与已知的字符模板进行比较以识别文字。

OCR技术在多个领域都有广泛的应用,例如:

- 自动化数据录入

- 手写识别

- 身份验证(如身份证、驾照的扫描)

- 数字化图书馆和档案管理

- 智能手机上的文字扫描应用

OCR技术的实现可以分为几个步骤:

1. 图像预处理:包括去噪、二值化、降噪和旋转校正等,目的是增强文字的清晰度和可读性。

2. 字符分割:将文字从背景图像中分离出来,便于后续处理。

3. 字符识别:将分割后的图像映射到字符模板库,识别出文字。

4. 文本后处理:包括校正、格式化和输出处理。

5.1.2 pytesseract的应用案例

pytesseract 是一个Python库,它封装了Google的Tesseract-OCR引擎,提供了非常便捷的方式来使用OCR技术。以下是一个简单的 pytesseract 应用案例:

from PIL import Image

import pytesseract

# 打开图片文件

img = Image.open('example.jpg')

# 使用pytesseract库进行OCR识别

text = pytesseract.image_to_string(img, lang='eng')

# 打印识别结果

print(text)

在这个例子中,我们首先使用PIL库打开一张图片,然后通过 pytesseract 的 image_to_string 函数将图片中的文字转换成字符串。 lang='eng' 参数指定了我们期望识别的文字类型是英语。

在实际应用中,你可能需要根据实际图像质量调整预处理步骤,并且对识别结果进行后处理以提高识别准确率。

5.2 语音合成技术的原理与应用

5.2.1 文本到语音转换的基本原理

文本到语音(Text-to-Speech,TTS)技术是将文本信息转换成声音输出的系统。TTS系统通常包括以下几个组成部分:

- 文本分析器:负责文本的语法分析和语义分析。

- 语音生成器:根据文本分析的结果合成语音信号。

- 音频合成器:生成实际的音频输出。

TTS技术的实现可以分为以下步骤:

1. 文本规范化:对输入文本进行标准化处理,比如英文的缩写转换、数字转述等。

2. 文本分析:确定发音、重音、音调等,从而为每个词生成正确的发音。

3. 音素合成:将文本分析得到的信息转换为对应的音素(声音的最小单位)。

4. 波形合成:将音素组合成连贯的语音波形。

5.2.2 语音合成技术的选择与应用

市场上有多种TTS工具可供选择,包括Google Text-to-Speech、Amazon Polly、IBM Watson Text to Speech等。这些工具通常都提供API接口,可以方便地集成到各种项目中。

以下是一个使用Google Text-to-Speech API的基本示例:

from google.cloud import texttospeech

client = texttospeech.TextToSpeechClient()

# 设置要转换的文本

text = "Hello, world!"

synthesis_input = texttospeech.SynthesisInput(text=text)

# 选择语音类型和语言

voice = texttospeech.VoiceSelectionParams(

language_code="en-US",

ssml_gender=texttospeech.SsmlVoiceGender.NEUTRAL

)

# 配置音频输出的格式

audio_config = texttospeech.AudioConfig(

audio_encoding=texttospeech.AudioEncoding.MP3

)

# 执行文本到语音转换

response = client.synthesize_speech(

input=synthesis_input,

voice=voice,

audio_config=audio_config

)

# 保存音频文件

with open("output.mp3", "wb") as out:

out.write(response.audio_content)

print("Audio content written to file 'output.mp3'")

在这个例子中,我们首先创建了 TextToSpeechClient 对象,然后设置输入文本、选择语言和语音类型,并配置音频输出格式。最后通过 synthesize_speech 方法生成语音输出,并将其保存为MP3文件。

在实际应用中,你可以根据需要选择不同的语音和语言,甚至可以调整语音的速率和音调来创建更自然的语音效果。TTS技术在许多领域都有广泛应用,比如为视障人士提供阅读服务、构建虚拟助手和自动语音应答系统等。

TTS技术不仅仅用于帮助技术阅读文本内容,还可以在影视后期制作、语言学习软件和多语言信息传播等多个领域发挥作用。随着技术的发展,TTS生成的语音越来越接近自然人声,带给用户更好的体验。

简介:Pytesseract-OCR基于Python提供Google Tesseract OCR引擎的接口,主要用于从图像中提取文字。通过集成文本到语音引擎,可将识别文字转化为语音,为视障者和需要听觉反馈的场景提供便利。Jupyter Notebook用于展示OCR流程,包括图像预处理、文字识别、语音合成等步骤。此外,文档可能还包含源代码、示例图像、使用教程、配置文件和依赖库信息,用于帮助用户理解和应用该集成系统。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)